假设在高速行驶中,车刹不住了,你的前方一边是一堆纸箱子,另一边是一根电线杆,情急之下,你会把方向盘转向哪里?看起来这是一个很白痴的问题,但在自动驾驶技术拔苗助长的今天,却非常具有讨论价值。

人云亦云的,不只是吃瓜群众,在工商业其实也没什么两样。由阿尔法狗引发的本轮人工智能大潮,迅速席卷全球。在汽车行业,无论是整车企业还是互联网技术公司,无人不谈人工智能和自动驾驶,企业在宣传页都必须加上“AI”或是“智”字。各种行业大会,各路大佬更是对人工智能的发展侃侃而谈,他们都想把自己装扮成智能方向的领航者。但事实却比我们看到的糗多了。

前不久《汽车人》发文《钱都白扔!自动驾驶技术走错了方向?》介绍了理论物理,凝聚态物理方向大牛,斯坦福大学的张首晟教授,他认为目前的人工智能技术还处于非常初级的阶段,看,“初级”的前面还有一个“非常”。他表示现在的人工智能还处于“仿生阶段”,这意味着人们并没有弄明白根本的原理是什么。

他说的根本原理就是事物的本质,也就是物理学的第一性原理,最终的表达通常是一个数学公式,如F=ma。笔者认为,数学是能与造物者沟通的惟一语言。

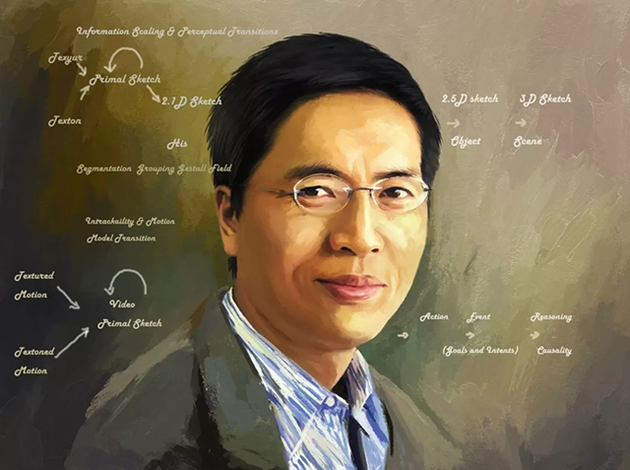

物理学是科学之母,基础物理又是物理之母,基础物理的表达往往就是一个数学公式。可张教授毕竟不是人工智能领域的开拓者,所以,本文我们不妨来看看人工智能界的大牛,美国加州大学洛杉矶分校计算机视觉、认知、学习与自主机器人中心主任朱松纯教授的观点。朱教授曾三次问鼎马尔奖(计算机视觉领域最高荣誉之一),两次担任美国视觉、认知科学、AI领域跨学科合作项目MURI负责人。简言之,这行儿资深的,没谁不晓得朱松纯的大名。

还是开篇的例子,以现在的自动驾驶技术,如果高速行驶当中的自动驾驶汽车,前方一边是一堆纸箱子,另一边是一根水泥电线杆子,刹不住车了,必须撞上去,人工智能会怎么选?如果人来开车,脑子都不用动,就会冲向纸箱一边。而如果交给现在的人工智能技术,大概率会是悲剧。

为什么?朱松纯教授说,在整个人工智能领域,深度学习只是分支中的分支,虽然现在在商业上非常火。深度学习的特点是只知其然不知其所以然,用鹦鹉学舌来比喻恰如其分,鹦鹉会学人说话,但它却不知道自己说的是什么意思。

首先应该清楚,如果把深度学习当作是人工智能,就相当于把海淀区看成了全中国。目前大部分以深度学习为核心研究方向的人工智能企业,也包括我国的几大互联网巨头,其核心产品依赖的都是深度学习。其实深度学习本身没有什么了不起的,它的本质就是统计数学中的多项式回归。这一点,早就有统计学和数学方面的专家公开表态了。这是一个笨方法,但借助着英伟达的GPU产品也确实可以一用。可问题在于深度学习,第一,不能理解事物之间的因果关系;第二,不能举一反三;第三,没有最基础的物理常识。由于没有物理常识,所以它并不晓得撞在箱子上会比撞在电线杆子上安全得多,它只会通过雷达传回的信号认为这是两个障碍物而已,无法分析其物理密度。

我们也曾说过,深度学习最需要的是在危险环境中的学习数据,这些数据从哪里找?由于不能够理解其因果关系,所以在路况中,它并不能够以人类司机的常识判断,如别人是否想超车、想并线或者躲大车这些情况。由于不能举一反三,一次事故所带来的学习信息并不能够保证在下一次的不同路况上,机器能够做出正确的判断。

朱松纯教授认为,一个很关键的地方,就是同样是在概率统计的框架下,当前大部分的深度学习方法属于一个被称作“大数据、小任务范式”,就是用大量的数据去训练特定的模式,如阿尔法狗下围棋。但朱教授提倡的是一个相反的思路,他认为人工智能的发展需要进入一个“小数据、大任务范式”,是用大量的任务,而不是大量的数据来塑造智能系统和模型。

朱教授做了一个比喻,一个18世纪的厨房和现代的厨房,作为人类来说,一眼就知道它们的功能是一样的。但是作为深度学习的人工智能来说,两者的信息极难被匹配。类似的,我们知道,在容器中或水龙头那里可以得到水,但机器会认为这里没有水。

人工智能并不神秘,当然它会在一个很具体的问题上,也就是前文所说的“小任务范式”,如下围棋,处理文字,筛选图片,语言翻译方面超过人类。但是汽车驾驶明显是属于大任务范式,使用同样的方法,难道不是走错了方向?也就难怪如今自动驾驶下的交通事故总是不绝于耳了。无法做到举一反三,那自动驾驶真的能给人们出行带来安全吗?

引用网上一位投资者的话:以目前的技术发展现状来说,人工智能离规模化商业应用,还是太遥远。所谓的高速发展马上要被证伪了。千万别说这几年会有大的技术突破,现在的技术研究都是在上个世纪前半叶的理论基础上进行的。理论基础都没升级,想着在软硬件层面修修补补就能有颠覆,骗人类自己还是骗人工智能呢?

这和张首晟教授的观点非常相似。没有基础理论的突破,没有真正能解开智能之谜的那个数学方程式,所谓的人工智能只能在小任务范式上得到发展和应用,而在汽车驾驶这种大任务范式上,还很难说靠谱。