“小蜜蜂”杀人机器人蕴含的黑科技

想象一下,在一个安静的大学教室,学生们都在各自的座位上惬意的自习。

突然,一群小如蜜蜂的不明飞行物从窗户、门缝蜂拥而入,他们盘旋在教室上空,似乎在进行着扫描和确认。终于,一个沉闷的声音过后,响起了一声尖叫——一个男孩倒在了血泊之中。

仅0.5秒的时间,一只“小蜜蜂”将其携带的3克炸药倾注在男孩头上,男生当场死亡。顿时,教室成为了屠宰场,弥漫着尖叫和恐惧。

如此血腥的场景来自于美国加州大学的斯图尔特·罗素尔教授公布的一段视频。虽然视频中“杀人蜂”进行的杀戮并非真实存在,但我们必须清楚的是,视频中的科技目前已经存在。

联合国特定常规武器公约会议的“杀手机器人禁令运动”

日前,韩国科学技术院于近期开设了人工智能研发中心,目的是研发适用于作战指挥、目标追踪和无人水下交通等领域的人工智能技术。

这引起业内专家的广泛担忧,30个国家和地区的人工智能及机器人专家宣布将抵制研究人工智能武器的韩国科学技术院(KAIST),但该大学并未承诺停止研发。

早在2017年,剑桥大学的生存威胁研究机构相关人员就列出了10种可能导致世界末日、人类灭绝的威胁。名列前茅的正是人工智能和杀手机器人。

军用杀人机器人“由来已久”

2012年,联合国人权理事会克里斯多夫·海因斯曾发布一份报告,呼吁各国冻结 “杀人机器人”试验、生产和使用。

他认为:“机器人没有人类的感情,它们不会理解和辨别人类的情感,由于没有足够的法律问责制度,加上机器人不应该拥有决定人类生死的权力,因此部署此类武器系统可能令人无法接受。”

如若对军用杀人机器人定义为“不需要人类干预,或者只需要远程要求,即可在战场上完成军事行动的自动机械”的话,自动炮台、扫雷机器人、军用无人机均可以包括在内。而且,这类事物活跃在战场上的时间远比人们想象中长,机器人“杀人”,从很早以前就开始了。

二战时期,德军曾经研制过一种名为“歌利亚遥控炸弹”的反坦克武器。这是一种通过有线遥控(必要时也可无线遥控)来控制的无人“袖珍坦克”,搭载着烈性炸药,可直接经由坦克底部装甲炸毁重型坦克。

“歌利亚遥控炸弹”

随着集成电路技术出现并不断完善,计算机的体积不断缩小,20世纪80年代,计算机可搭载在军用无人载具之内。

同时,计算机的功能也在不断完善,可以完成控制载具行进、寻找目标、敌我识别和发射武器等一系列任务,而且相对稳定可靠,能够适应复杂多变的战场环境。

目前为人熟知的“掠食者”无人机,本质就是军用杀人机器人。此外,一些国家已经在研制自动化程度更高的战斗机器人,允许它们在战场上自主寻找、选择目标,再自己决定是否开火。

MQ-9收割者侦查机

是人性还是伦理?这是一个问题

电影《终结者》给我们描述了一个机器人杀戮和奴役人类的黑暗未来,虽然电影中的场景短期内难以在现实生活中复现,智能相对论分析师柯鸣认为,军用杀人机器人的研究和使用,不仅是人性问题,更是伦理问题。

1.是战斗员还是武器?

传统战争主要发生在国家和政治集团之间,战争主体是军队和军人。而杀人机器人的研发和应用,军人不再是战争的唯一战士,战争主体地位更加复杂。

传统火炮、坦克、战舰离不开人手的操作,军人乃是战争的主体。而杀人机器人具有人工智能、会思考、能判断,可以自动发现、识别和打击目标,自主地完成人赋予的任务,因而就能替代军人冲锋陷阵。

如果杀人机器人上了战场,它们就是真正的战斗员。然而杀人机器人是一种具有行为能力却没有责任能力的战斗员,它不同于传统意义上的军人战斗员,也不同于武器。杀人机器人到底是战斗员还是武器,将难以界定,相应其伦理地位也难以确定。

2.安全问题如何保证?

杀人机器人也没有感情,不会理解和辨别人类的情感,无法识别眼前被杀戮者是敌是友。自主的杀人机器人如果成为战争工具,难以保证不滥杀无辜,尤其是某种原因导致失控故障,没有人保证它不会袭击人类战友的情况,伤害创造它们、躯体却弱于它们的智慧种族。

事实上,目前还没有一套控制自动系统出错的有效措施。一旦程序出错,或者被人恶意篡改,很可能造成血流成河的惨剧,人类的安全将面临极大的威胁。如果对研制具有杀人能力的智能机器人不加以限制,总有一天会出现这样的局面:“全自动”的“杀人机器人”走上战场,并自主决定着人类的生死。

3.精准敌我识别如何做到?

从冷兵器时代至今,由于敌我识别不畅导致的误伤,一直是战场上难以避免的问题。现代战争中往往会使用技术手段来避免误伤,但如果想要让军用机器人完全自主行动,需要解决的问题还要更多。

人类士兵不仅可以判断某个移动的人是敌人、友军还是平民百姓,而且能够相对准确地了解对方的来意。但对于军用机器人来说,它们最多只能分清敌我,却通常难以判断对方的“心思”,所以很可能出现枪杀投降士兵和战俘的情况,而这一举动是被国际公约所禁止的。

4.是否赋予自主“杀人能力”?

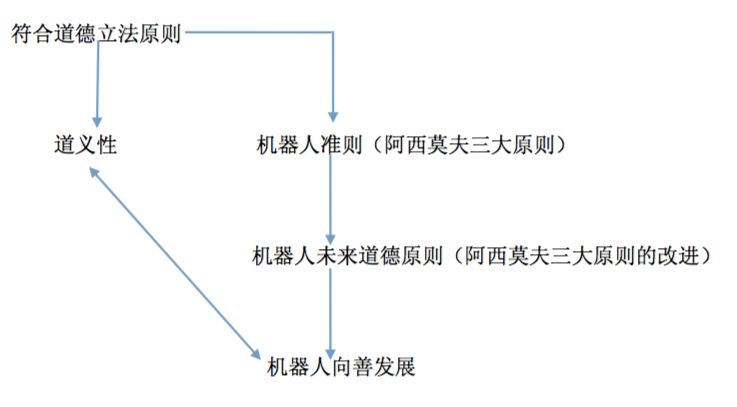

是否赋予自主行动的机器人“杀人的能力”,一直是包括人工智能、军事在内的各方专家学者讨论的焦点。1940年,著名科幻作家伊萨克·阿西莫夫提出了“机器人三原则”。他指出:“机器人不得伤害人类;必须服从人类指令,但不得与第一原则抵触;必须保存自身,但不得与前两条原则抵触。”

机器人发展与道义的关系

菲利普·迪克在《第二变种》中描述了军用机器人对人类社会的渗透:在美苏核战之后,美国为避免亡国,制造了可以自行组装、学习并且割人咽喉的军用机器人,用以袭击苏联占领军;但这些机器人不断进化,自行组装了具有苏军男女士兵和营养不良儿童等外观的新型机器人,不仅攻击人类,也自相残杀,甚至潜入美国在月球的秘密基地,埋下了人类灭亡的伏笔。

当然,单个军用机器人如果出现程序错误,乃至受到来自敌方的干扰或者计算机病毒破坏,确实有可能出现袭击人类战友的情况。

但如果据此担心机器人获得自我意识之后,会全体背叛人类并自行制造同伴, 仍然为时尚早。

究竟是阿里巴巴山洞还是潘多拉魔盒?

耶鲁大学的研究人员把军用机器人列为人工智能技术最有前途的应用领域之一。军用机器人的用途太诱人:既可降低己方士兵的风险,又能降低战争的代价。它省去了军人的薪水、住房、养老、医疗等开销,又在速度、准确性上高于人类,且无需休息。它不会出现只有人类战斗员才会有的战场应激障碍,情绪稳定,无需临战动员,一个指令,就能抵达人类不可及之处,完成各种任务。

但是,如果杀人机器人滥杀无辜,责任又该归咎于谁呢?英国机器人技术教授诺埃尔·沙尔吉认为,“显然这不是机器人的错。机器人可能会向它的电脑开火,开始发狂。我们无法决定谁应该对此负责,对战争法而言,确定责任人非常重要。”

从人道主义的角度来看,不论研制杀人机器人的初衷是怎样,机器人战争当杀人机器人被有效利用时,它应遵循期望效果最大化、附带伤害最小化的功利主义原则。

从功利主义的角度看,杀人机器人不具备人类恐惧的本能,不论智能高低都会意志坚毅,不畏危险,终会一往无前。杀人机器人也不需要人员及与之相应的生命保障设备,即使被击毁,也不存在阵亡问题,只需换一台新的重新上阵,成本可以大大降低。

使用杀人机器人代替士兵岗位用于战场中侦察和扫雷和作战任务,还有助于把士兵从一些极为危险的领域中解放出来,减小战场伤亡,降低军事活动的成本和负担。但是,杀人机器人能像人类士兵一样在战场上自动寻找并攻击目标,那么失控的机器人就可能给人类带来巨大的灾难。

此外,如果世界各国在杀人机器人方面展开军备竞赛,那将会大大增加军费的支出。因此,整体上看使用杀人机器人带来的功利极其有限,反而会给人类带来极大的威胁,弊远大于利。无论如何,我们都将难以理解杀人机器人的研制和使用会有助于增加人类的利益。

诚然,军事杀人机器人的发展会引发军事领域的巨大变革,智能相对论分析师柯鸣认为,军用机器人的发展是人工智能应用于军事领域的体现,其究竟是阿里巴巴山洞还是潘多拉魔盒,需要人类自身予以甄别,只有将技术真正应用并服务于人类发展,才能真正构建世界的“阿里巴巴山洞”。