深度学习技术往往比较复杂,从头开发的难度较大,但现在有一些公司提供了能帮助开发者轻松使用深度学习的自动化深度学习(ADL)平台,比如微软的 CustomVision.AI、谷歌的 Cloud AutoML、OneClick.AI。Data Science Central 近日发文对这三个平台进行了比较和盘点,机器之心对该文做了编译介绍。

阻碍我们使用深度学习方法的原因有很多,其中最主要的是深度学习方法很复杂和困难。

数据科学领域有一部分研究者和开发者已经选择学习这些新技术了,但在预测性和规范性建模的问题类型和技术方面(我们 90% 的工作就是这些),学习深度学习技术却与我们的大部分工作方向背道而驰。

至少在图像、视频、文本和语音识别与处理领域,人工智能(AI)已经成为了每个人的口头禅,但寻找有资格执行你的项目的数据科学家仍然很困难。

实际上我列举的图像、视频、文本和语音应用只是深度学习应用的一小部分。尽管这些是最为人所知且可能是最明显的应用,但深度神经网络(DNN)也能出色地预测时序数据以及解决复杂的传统的消费倾向问题。

去年 12 月份我在写数据科学 2018 年预测时,我注意到 Gartner 说在 2018 年 DNN 会成为 80% 数据科学家的标准工具组件。我的预测是:尽管能实现这种简洁性的***家提供商肯定会获得丰厚的回报,但绝不可能是在 2018 年。看来我预测错了。

2018 年才刚过去 4 个月,我就看到了三种旨在简化深度学习以让任何人(至少是任何数据科学家)都能使用该技术的不同平台。

***要求

所有的主要公司和几家小公司都为执行 CNN 或 RNN/LSTM 提供了极大简化的工具,但这仍然需要实验性地人工调整层的类型和数量、连接方式、节点和其它超参数(这些设置往往会影响最初的成功)。

我们希望有真正一键式的应用,让一般的数据科学家或甚至开发者都能成功构建图像或文本分类器。

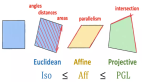

实现这一目标的最快方法是通过迁移学习。在深度学习领域,迁移学习是指将之前成功构建的大型的、复杂的 CNN 或 RNN/LSTM 模型在新的更有限的数据集上进行训练。

基本上而言,常用于图像分类的迁移学习会将更复杂的模型归纳为更少或之前训练过的类别。迁移学习不能创造原模型中没有的分类,但它可以学习创造子集或汇总类别。

其优势在于常常会执行超参数调节,这样你就知道模型将会训练。更重要的是,你只需不到 1 个小时时间,仅用几百张有标注图像就能构建一个成功的迁移模型。

但是,自动化深度学习的真正目标是完全自动化的超参数调节,而不是迁移学习。你在下面会读到,有的努力还在进行中,而有的则宣称已经实现了这一目标。

微软 CustomVision.AI

链接:https://www.customvision.ai

2017 年底,微软在 Microsoft Cognitive Services(微软认知服务)的旗帜下推出了一系列极大简化后的深度学习功能,涵盖图像、视频、文本和语音等各个领域。今年 1 月,他们又推出了完全自动化的平台 Microsoft Custom Vision Services(微软定制视觉服务)。

这个平台只是图像分类器,并且还向用户承诺只需少量图像就能使用微软的巨大的已有大型、复杂、多图像分类器库创建稳健的 CNN 迁移模型。

使用这个平台非常简单。只需将你的图像拖放到这个平台上然后继续即可。你需要一个即付即用的 Azure 帐户,基本的技术支持是每个月 29 美元。模型训练的时间不是明确的,但因为是迁移学习,所以应该会很快,因此也不会太贵(但也不是免费的)。

在项目设置过程中,你会被要求确定一个你的图像集将会迁移学习的一般域,目前可选的有:

- 一般(General)

- 食物(Food)

- 地标(Landmarks)

- 零售(Retail)

- 成人(Adult)

- 一般(紧凑)

- 地标(紧凑)

- 零售(紧凑)

尽管所有这些模型都可以在训练后通过 restful API 运行,但***三个类别(标记有「紧凑」)可以导出到任何 iOS 或安卓边缘设备上离线运行。在 iOS 11 上导出的格式是 CoreML 格式;在安卓设备上是 TensorFlow 格式。这应该能吸引可能不是数据科学家的应用开发者为他们的应用添加即时图像分类功能。

可以预见微软未来还会尽快地推出更复杂的功能。

谷歌 Cloud AutoML

链接:https://cloud.google.com/automl

同样在今年 1 月,谷歌也宣布了其类似的项目 Cloud AutoML。这个平台目前处于 alpha 开发阶段,需要邀请才能参与。

和微软一样,这个服务使用了谷歌自己预构建的复杂 CNN 分类器的迁移学习。他们推荐至少给每个标签提供 100 张图像来迁移学习。

目前还不清楚该平台在正式发布时会有哪些图像类别,但用户截屏显示至少有一般、人脸、logo、地标,也许还有其它一些。从谷歌分享的截图看,这些模型的训练时间大约为 20 分钟到几个小时。

根据我们可以找到的数据,这个平台的使用方式应该是通过 API。没有什么地方提到了导出代码离线使用的情况。早期的 alpha 用户包括迪斯尼公司和 Urban Outfitters。

可以预见很多新用户都没有有标注的数据,谷歌提供了它自己的人工标注服务,但要额外收费。

除了迁移学习之外,包括谷歌在内的主要公司都在推动自动化 CNN 和 RNN 优化调节的自动化方案。人工开发的模型是当前的常态,也是需要如此多不成功的迭代的原因。

谷歌将这种下一代技术称为 Learn2Learn。当前他们在实验用 RNN 来优化层、层类型、节点、连接和其它超参数。因为这基本上是非常高速的随机搜索,所以计算资源可能非常高。

接下来要做的是用进化算法来做同样的事情,这在时间和计算上都会高效得多。在最近的演示中,谷歌研究者展示了这种方法的优良结果,但他们仍然光是在优化上就花了 3 到 10 天。

OneClick.AI

链接:https://www.oneclick.ai

OneClick.AI 是 2017 年底出现在市场上的一个自动化机器学习(AML)平台,其中既包括传统的算法,也包括深度学习算法。

OneClick.AI 光是 AML 方面也值得一看了,其中包括数据融合、准备、特征工程、特征选择,后面还有并行的传统多模型,以确定其中***的模型。

但是,OneClick 的不同之处在于其既有图像算法,也有文本算法;使用的方法既有迁移学习,也有完全自动化的超参数调节来重新修改图像和文本深度学习模型。

不同于谷歌和微软,OneClick 在图像和文本上都准备好了。除此之外,他们还将 DNN 与传统算法组合到了一起,并且使用了 DNN 来做预测。

预测是使用 DNN 方面一个已经探索过的领域,但事实表明其表现能轻松超过 ARIMA 和 ARIMAX 等时序数据预测器。

对于这样一个提供了如此复杂的工具和技术的平台而言,它保持了「一键出模型」的简单易用性——我认为这是自动化机器学习的***要求,但也包括自动化深度学习。

他们用于优化深度学习模型的方法是专有的,但该公司的创始人兼 CEO Yuan Shen 描述说他们是用 AI 训练 AI——可能是一种深度学习优化方法。

哪个平台更好?

目前还没有什么标准可以评估哪个平台更好,但 OneClick.AI 提供了一个案例。

在今年初的一个黑客马拉松上,该团队测试比较了 OneClick 和微软的 CustomVision(谷歌的 AutoML 当时还不可用)。他们测试了两个图像分类问题。标记符合以下描述的照片:

奔跑的马或喝水的马:

裸照:

标记马的任务是一个多标签分类任务,裸照检测是一个二元分类任务。对于每个任务,他们都使用了 20 张训练图像以及另外 20 张测试图像。

- 标记马的准确度:90%(OneClick.ai)vs. 75%(微软 Custom Vision)

- 裸照检测准确度:95%(OneClick.ai)vs. 50%(微软 Custom Vision)

因为这个结果仅使用了迁移学习方面非常少量的样本,所以不具有统计意义。但还是能看到差别。

这是迁移学习方面的比较。我们很有兴趣了解自动化模型优化方面的比较。OneClick 准备好了。谷歌应该很快就会跟进。

你可能想问亚马逊的情况?在我们的调研中没看到亚马逊在自动化深度学习方面的计划,但也不会落后太远。

原文链接:

https://www.datasciencecentral.com/profiles/blogs/automated-deep-learning-so-simple-anyone-can-do-it

【本文是51CTO专栏机构“机器之心”的原创译文,微信公众号“机器之心( id: almosthuman2014)”】