Docker 很棒——越来越多的人在开发与分布中使用它。Docker 有很多优势:即时环境设置、独立于平台的 app、现成的解决方案、更好的版本控制、简化的维护。

但是在数据科学和深度学习方面,使用 Docker 有一些阻碍。你必须记住所有的 Docker 标志,以在主机和容器之间共享端口和文件,创建不必要的 run.sh 脚本,并处理 CUDA 版本和 GPU 共享。如果你曾经见过下面这个错误,你就会明白这种痛苦:

- $ nvidia-smi

- Failedto initialize NVML:Driver/library version mismatch

我们的目标

本文的目的在于为你介绍一系列 Docker 实用工具,以及我们经常在公司使用的 GPU-ready 样板文件。

因此,以下结果将不会出现:

- docker run

- --rm

- --device /dev/nvidia0:/dev/nvidia0

- --device /dev/nvidiactl:/dev/nvidiactl

- --device /dev/nvidia-uvm:/dev/nvidia-uvm

- -p 8888:8888

- -v `pwd`:/home/user

- gcr.io/tensorflow/tensorflow:latest-gpu

取而代之的是这种结果:

- doc up

酷!

我们实际上想要达到的:

- 通过一个指令管理我们的应用程序状态(运行、停止、移除)

- 把所有的运行标志保存到我们能够提交到 git repo 的单个配置文件

- 忘记 GPU 驱动程序版本不匹配和共享

- 在生产工具比如 Kubernetes 或 Rancher 中使用 GPU-ready 的容器

因此,这里是我们强烈推荐给每个深度学习者的工具清单:

1. CUDA

首先,你需要 CUDA 工具包,如果你打算自己动手训练模型,那这是必须要有的。我们推荐使用 runfile 安装程序类型而不是 deb,因为它不会在以后的更新中混淆依赖关系。

(可选)如何检查它是否工作:

- cd /usr/local/cuda/samples/1_Utilities/deviceQuery

- make

- ./deviceQuery #Shouldprint "Result = PASS"

2. Docker

你不想让海量的库污染你的计算机,也害怕版本出现问题。同样,你不必亲自构建和安装——通常,软件已为你创建好了,并包装在图像中。安装 Docker 很简单:

- curl -sSL https://get.docker.com/ | sh

3. Nvidia Docker

如果使用 Docker,必须有来自英伟达的实用程序(https://github.com/NVIDIA/nvidia-docker),它真正简化了在 Docker 容器内使用 GPU 的步骤。

安装非常简单:

- wget -P /tmp https://github.com/NVIDIA/nvidia-docker/releases/download/v1.0.1/nvidia-docker_1.0.1-1_amd64.deb

- sudo dpkg -i /tmp/nvidia-docker*.deb

现在,不用每次都用下列方式来共享英伟达设备:

- docker run --rm --device /dev/nvidia0:/dev/nvidia0 --device /dev/nvidiactl:/dev/nvidiactl --device /dev/nvidia-uvm:/dev/nvidia-uvm nvidia/cuda nvidia-smi

你可以使用 nvidia-docker 命令:

- nvidia-docker run --rm nvidia/cuda nvidia-smi

同样,你也无需担心驱动程序版本不匹配:英伟达的 docker 插件将会帮你解决问题。

4. Docker Compose

超级有用的实用程序,允许你在文件中存储 docker run 配置,并更轻松地管理应用程序状态。尽管它的设计目的是组合多个 docker 容器,但 docker compose 在你只有一个服务的时候依然非常有用。这里有一个稳定版本

(https://github.com/docker/compose/releases):

- curl -L https://github.com/docker/compose/releases/download/1.15.0/docker-compose-`uname -s`-`uname -m` > /usr/local/bin/docker-compose

- chmod +x /usr/local/bin/docker-compose

5. Nvidia Docker Compose

不幸的是,Docker Compose 并不知道 Nvidia Docker 的存在。幸运的是,有一个解决方法:有一个小的 Python 脚本,可以用 nvidia-docker 驱动程序生成配置。通过 pip 安装 Nvidia Docker Compose:

- pip install nvidia-docker-compose

现在你可以使用 nvidia-docker-compose 命令,而不是 docker-compose 了。

替代选择

如果你不想使用 nvidia-docker-compose,你可以手动传递音量驱动程序,只需把这些选项添加到 docker-compose.yml:

- #Yournvidia driver version here

- volumes:

- nvidia_driver_375.26:

- external:true

- ...

- volumes:

- -nvidia_driver_375.26:/usr/local/nvidia:ro

6. Bash 别名

但是 nvidia-docker-compose 需要输入 21 个字符,这太多了。

很幸运我们可以使用 bash 别名。在你最喜爱的编辑器打开~/.bashrc(有时是~/.bash_profile),输入以下代码行:

- alias doc='nvidia-docker-compose'

- alias docl='doc logs -f --tail=100'

通过运行 source ~/.bashrc 更新你的设置。

开始 TensorFlow 服务

现在我们准备好利用上述所有工具的优点。比如,我们运行一个 Tensorflow GPU 启用的 Docker 容器。

在项目目录中创建具有以下内容的 docker-compose.yml 文件:

- version:'3'

- services:

- tf:

- image:gcr.io/tensorflow/tensorflow:latest-gpu

- ports:

- -8888:8888

- volumes:

- -.:/notebooks

现在我们可以使用单个命令开始 TensorFlow Jupiter:

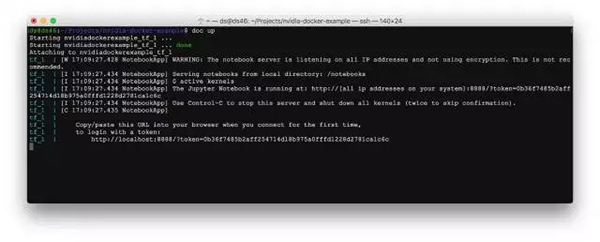

- doc up

doc 是 nvidia-docker-compose 的别名——它将使用正确的 volume-driver 生成已修改的配置文件 nvidia-docker-compose.yml,然后运行 docker-compose。

你可以使用相同的命令管理你的服务:

- doc logs

- doc stop

- doc rm

- #...etc

结论

但是这值得吗?下面让我们看一下其优缺点。

优点

- 无需考虑 GPU 设备共享

- 不必再为英伟达驱动程序版本担忧

- 摆脱了偏爱干净、简单配置的命令标志

- 再也不需要--name 标志管理容器状态

- 众所周知已记录并得到广泛使用的实用程序

- 你的配置已为编制工具做好准备,比如理解 docker-compose 文件的编制工具 Kubernetes

缺点

- 你不得不安装更多工具

它是生产就绪(production-ready)的吗

是的。在电影推荐应用 Movix 中,我们使用 GPU 加速的 TensorFlow 网络基于用户输入计算实时的电影选择。

我们在 Proxy API 的 Rancher 集群中有三台带有 Nvidia Titan X 的电脑。配置储存在常规 docker-compose.yml 文件中:因此在一个新服务器上部署应用程序或者设置开发环境变得很轻松。目前为止它的表现堪称***。

为机器学习的未来做好准备吧!

原文:https://hackernoon.com/docker-compose-gpu-tensorflow-%EF%B8%8F-a0e2011d36

【本文是51CTO专栏机构“机器之心”的原创译文,微信公众号“机器之心( id: almosthuman2014)”】