一、深度学习

说到深度学习,估计只要有接触的您,一定会知晓一二,其实深度学习就是机器学习领域的一个新研究方向。

刚刚开始的阶段,在语音识别和 计算机视觉等多类应用中取得了突破性的进展,尤其在语音领域。 其动机在于建立模型模拟人类大脑的神经大体结构,在处理训练数据(图像、 语音或文本)信号时,通过多个变换阶段分层对数据特征进行描述,进而给出数据的表达, 以图像数据为例, 灵长类的视觉系统中对这类信号的处理依次为: 首先是检测边缘,纹理等简单的初始形状特征,然后再逐步形成更复杂的视觉形状,同样地, 深度学习通过组合低层特征形成更加抽象的高层表示、属性类别或特征,给出数据的分层特征表示。

作为深度学习的“深度”,到底是怎么理解的???

深度学习之所以被称为“深度” ,其实想相对于那些传统机器学习而言。就好比我们的模型深度更加深入,在学习过程中,非线性操作的层级数比之前多很多。浅层学习主要是依赖人工特征,也就是依赖人工以往的经验去提取数据的特征,用模型学习后的特征表示是没有层次机构的单层特征。而深度学习是在原始输入数据上,通过逐层变化提取特征,将样本数据在原始的数据空间特征表示转换到新的特征空间(就好比SVM对于线性不可分的情况,可以利用核的思想,将原数据的特征空间投影到更高的空间去表达),然后自动去学习得到层次化的特征表示,从而更有利于物体的分类或特征的可视化。 深度学习理论的另一个理论动机是: 如果一个函数可用K层结构以简洁的形式表达,那么用 K-1层的结构表达则可能需要指数级数量的参数( 相对于输入信号) ,且泛化能力不足。

深度学习的概念最先有这个想法的是G.E. Hinton等人在2006年提出,主要就是将样本数据通过一定的训练方法得到多层网络结构的机器学习过程。传统的神经网络随机初始化网络中的权值,导致网络很容易收敛到局部最小值,为解决这一问题,Hinton提出使用无监督预训练方法优化网络权值的初值,再进行权值微调的方法,拉开了深度学习的序幕。

其实深度学习就是通过结构中大量单一神经元,每个神经元与海量其他神经元连接,其中连接强度就是我们所说的权值,是下训练学习过程中不断的去修改并决定网络的具体功能。

深度神经网络是由多个单层非线性网络叠加而成的,常见的单层网络按照编码解码情况分为3 类:只包含编码器部分、只包含解码器部分、既有编码器部分也有解码器部分。编码器提供从输入到隐含特征空间的自底向上的映射,解码器以重建结果尽可能接近原始输入为目标将隐含特征映射到输入空间。

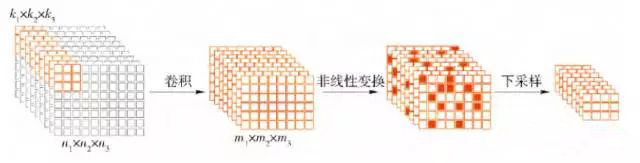

单层卷积的变换过程:

二、深度学习应用

深度学习已经在很多领域得到了大力的发展,尤其是语音,图像,视频等领域都得到了较大的进步,都优于以前的方法。现在比较热门的是人脸检测识别(刷脸),智能管理(考勤,车牌检测,监控),医学检查与预测(脑电波返回图可预测疾病等)等技术。下面根据所处理数据类型的不同, 对深度学习的应用进行介绍。

5. 1 深度学习在语音识别、 合成及机器翻译中的应用

微软研究人员使用深度信念网络对数以千计的senones( 一种比音素小很多的建模单元) 直接建模,提出了第 1 个成功应用于大词汇量语音识别系统的上下文相关的深层神经网络——隐马尔可夫混合模型(CD-DNN-HMM),比之前最领先的基于常规 CDGMM-HMM 的大词汇量语音识别系统相对误差率减少16%以上。

随后又在含有300h语音训练数据的Switchboard标准数据集上对CD-DNN-HMM模型进行评测。 基准测试字词错误率为18. 5%,与之前最领先的常规系统相比,相对错误率减少了33%。

H. Zen等人提出一种基于多层感知机的语音合成模型。该模型先将输入文本转换为一个输入特征序列,输入特征序列的每帧分别经过多层感知机映射到各自的输出特征,然后生成语音参数,最后经过声纹合成生成语音。训练数据包含由一名女性专业演讲者以美国英语录制的3.3万段语音素材,其合成结果的主观评价和客观评价均优于基于HMM方法的模型。

K. Cho等人提出一种基于循环神经网络(recurrent neural network,RNN) 的向量化定长表示模型(RNNenc 模型) ,应用于机器翻译。该模型包含2个RNN 一个RNN用于将一组源语言符号序列编码为一组固定长度的向量,另一个RNN将该向量解码为一组目标语言的符号序列。

在该模型的基础上,D. Bahdanau等人克服了固定长度的缺点(固定长度是其效果提升的瓶颈) ,提出了RNNsearch 的模型。该模型在翻译每个单词时,根据该单词在源文本中最相关信息的位置以及已翻译出的其他单词, 预测对应于该单词的目标单词。该模型包含一个双向RNN作为编码器,以及一个用于单词翻译的解码器。在进行目标单词位置预测时,使用一个多层感知机模型进行位置对齐。采用BLEU评价指标,RNNsearch模型在ACL2014 机器翻译研讨会( ACL WMT 2014) 提供的英 /法双语并行语料库上的翻译结果评分均高于RNNenc 模型的评分,略低于传统的基于短语的翻译系统Moses (本身包含具有4.18亿个单词的多语言语料库) 。另外,在剔除包含未知词汇语句的测试预料库上,RNNsearch的评分甚至超过了Moses。

5. 2 深度学习在图像分类及识别中的应用

5. 2. 1 深度学习在大规模图像数据集中的应用

A. Krizhevsky等人首次将卷积神经网络应用于ImageNet大规模视觉识别挑战赛(ImageNet large scale visual recognition challenge,ILSVRC) 中,所训练的深度卷积神经网络在ILSVRC—2012挑战赛中,取得了图像分类和目标定位任务的第一。其中,图像分类任务中, 前5选项错误率为15. 3%,远低于第 2 名的26. 2% 的错误率;在目标定位任务中,前5选项错误率34%,也远低于第 2 名的50%。

在ILSVRC—2013 比赛中,M.D. Zeiler 等人采用卷积神经网络的方法, 对文献的方法进行了改进,并在每个卷积层上附加一个反卷积层用于中间层特征的可视化,取得了图像分类任务的第一名。其前5选项错误率为11. 7% , 如果采用ILSVRC—2011数据进行预训练,错误率则降低到11. 2% 。在目标定位任务中,P. Sermanet等人采用卷积神经网络结合多尺度滑动窗口的方法,可同时进行图像分类、定位和检测,是比赛中唯一一个同时参加所有任务的队伍。多目标检测任务中,获胜队伍的方法在特征提取阶段没有使用深度学习模型,只在分类时采用卷积网络分类器进行重打分。

在ILSVRC—2014比赛中,几乎所有的参赛队伍都采用了卷积神经网络及其变形方法。其中GoogLeNet小组采用卷积神经网络结合Hebbian理论提出的多尺度的模型,以6.7%的分类错误,取得图形分类“指定数据”组的第一名; CASIAWS小组采用弱监督定位和卷积神经网络结合的方法,取得图形分类“额外数据” 组的第一名,其分类错误率为11%。

在目标定位任务中,VGG小组在深度学习框架Caffe 的基础上,采用 3 个结构不同的卷积神经网络进行平均评估,以26%的定位错误率取得“指定数据”组 的 第 一 名;Adobe组选用额外的2000类ImageNet数据训练分类器,采用卷积神经网络架构进行分类和定位,以30%的错误率,取得了“额外数据” 组的第一名。

在多目标检测任务中,NUS小组采用改进的卷积神经网络——(network in network,NIN)与多种其他方法融合的模型,以37%的平均准确率(mean average precision,mAP) 取得“提供数据” 组的第一名;GoogLeNet以44%的平均准确率取得“额外数据” 组的第一名。从深度学习首次应用于ILSVRC挑战赛并取得突出的成绩,到2014年挑战赛中几乎所有参赛队伍都采用深度学习方法,并将分类识错率降低到6.7%,可看出深度学习方法相比于传统的手工提取特征的方法在图像识别领域具有巨大优势。

5. 2. 2 深度学习在人脸识别中的应用

基于卷积神经网络的学习方法,香港中文大学的DeepID项目以及FB的DeepFace项目在户外人脸识别(labeled faces in thewild,LFW)数据库上的人脸识别正确率分别达97.45%和97.35%,只比人类识别 97. 5%的正确率略低一点点。DeepID项目采用4层卷积神经网络(不含输入层和输出层)结构,DeepFace 采用 5 层卷积神经网络(不含输入层和输出层,其中后3层没有采用权值共享以获得不同的局部统计特征)结构。

之后,采用基于卷积神经网络的学习方法,香港中文大 学 的DeepID2项 目将 识 别 率 提 高 到 了99.15%,超过目前所有领先的深度学习和非深度学习算法在LFW数据库上的识别率以及人类在该 数 据 库 的 识 别 率。DeepID2项目采用和DeepID项目类似的深度结构,包含4个卷积层,其中第3层采用2×2邻域的局部权值共享,第 4 层没有采用权值共享,且输出层与第 3、4层都全连接。

5. 3 深度学习在视频分类及行为识别中的应用

A. Karpathy等人基于卷积神经网络提供了一种应用于大规模视频分类上的经验评估模型, 将Sports-1M数据集的100万段YouTube视频数据分为487类。该模型使用4种时空信息融合方法用于卷积神经网络的训练,融合方法包括单帧( single frame) 、不相邻两帧 (late fusion) 、相邻多帧(early fusion) 以及多阶段相邻多帧( slow fusion);此外提出了一种多分辨率的网络结构,大大提升了神经网络应用于大规模数据时的训练速度。该模型在Sports-1M上的分类准确率达63.9%,相比于基于人工特征的方法(55.3%),有很大提升。此外,该模型表现出较好的泛化能力,单独使用slow fusion 融合方法所得模型在UCF101动作识别数据集上的识别率为65.4%,而该数据集的基准识别率为43.9% 。

S. Ji 等人提出一个三维卷积神经网络模型用于行为识别。该模型通过在空间和时序上运用三维卷积提取特征,从而获得多个相邻帧间的运动信息。该模型基于输入帧生成多个特征图通道,将所有通道的信息结合获得最后的特征表示。该三维卷积神经网络模型在TRECVID数据上优于其他方法,表明该方法对于真实环境数据有较好的效果;该模型在KTH 数据上的表现,逊于其他方法, 原因是为了简化计算而缩小了输入数据的分辨率。

M. Baccouche等人提出一种时序的深度学习模型,可在没有任何先验知识的前提下,学习分类人体行为。模型的第一步,是将卷积神经网络拓展到三维自动学习时空特征。接下来使用RNN方法训练分类每个序列。该模型在KTH上的测试结果优于其他已知深度模型,KTH1和KTH2上的精度分别为94.39%和92.17%。事实上,深度学习的应用远不止这些,但是本文只是分别从数据的维度上(音频文本,一维;图像,二维;视频,三维)对深度学习的典型应用进行详细介绍,目的在于突出深度学习带来的优越性能以及其对不同数据的应用能力。其他应用还包括图像超分辨率重建、纹理识别、行人检测、场景标记、门牌识别等。

三、深度学习的问题及趋势

深度学习算法在计算机视觉(图像识别、视频识别等)和语音识别中的应用, 尤其是大规模数据集下的应用取得突破性的进展,但仍有以下问题值得进一步研究:

- 无标记数据的特征学习

目前, 标记数据的特征学习仍然占据主导地位,而真实世界存在着海量的无标记数据,将这些无标记数据逐一添加人工标签,显然是不现实的。所以, 随着数据集和存储技术的发展,必将越来越重视对无标记数据的特征学习,以及将无标记数据进行自动添加标签技术的研究。

- 模型规模与训练速度、 训练精度之间的权衡

一般地,相同数据集下,模型规模越大,训练精度越高,训练速度会越慢。例如一些模型方法采用ReLU非线性变换、GPU 运算,在保证精度的前提下,往往需要训练5~7d。虽然离线训练并不影响训练之后模型的应用,但是对于模型优化,诸如模型规模调整、超参数设置、训练时调试等问题,训练时间会严重影响其效率。故而,如何在保证一定的训练精度的前提下,提高训练速度,依然是深度学习方向研究的课题之一。

- 与其他方法的融合

从上述应用实例中可发现,单一的深度学习方法,往往并不能带来最好的效果,通常融合其他方法或多种方法进行平均打分,会带来更高的精确率. 因此, 深度学习方法与其他方法的融合,具有一定的研究意义。