智东西(公众号:zhidxcom)

编 | origin

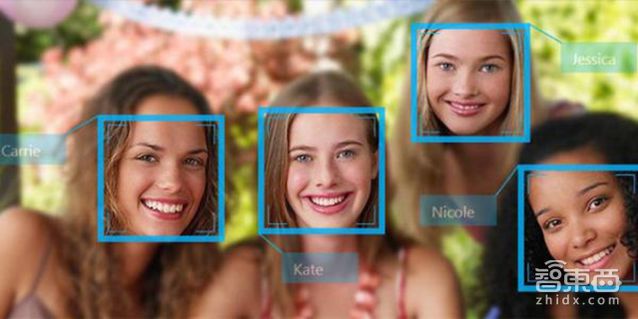

YannLeCun作为深度学习领域的大牛,近几年带动Facebook的人工智能项目飞速前进,其势头比之谷歌也不落下风。如今Facebook的人脸识别技术DeepFace已经能够识别超过4亿张人脸,而YannLeCun对此并不满足,他认为机器视觉不该满足于从图片中进行识别,下一步机器应当从视频中“学习常识”。

五年前,研究者们在图像识别的准确性上,取得了巨大的突破。这背后的技术,人工神经网路,促成了近来人工智能的繁荣。它使谷歌和Faceboo得以让你在自己的相册中使用搜索功能,也让一批使用面部识别的应用程序得以问世。

Facebook的AI研究团队负责人兼纽约大学教授,开创性地将神经网络运用在了机器视觉领域。他认为这个领域仍然有很大的发展空间,这个领域取得的进步可能会催生出懂得常识的软件系统。

问:现在的机器视觉水平如何?

YannLeCun:如果你的图片有显著的主体,那么只需要标注主体的类别就好。如果有足够多的数据——大概每个类别一千张图片,那么我们就能识别相当具体的事物:比如某个品牌的汽车,某个特定品种的植物,某种特定血统的狗。我们还能识别更抽象的事物,比如风景图、日落,婚礼或者生日party。就在五年前我们还不清楚这个问题是可以解决的。(现在我们已经把它攻克了)但是这并不是说视觉问题已经解决了。

问:那什么关键问题是还没解决的?

YannLeCun:在为图片和视频自动生成字幕和注释这方面,人们已经努力了很多年。此前已诞生过一些看上去很可观的方式,但实际上它们并没有那么可靠。它们的适用范围极大受限于它们是如何被训练的。对于大多数系统,如果你给它们提供包含其他种类物体或者是处在非常规情境下的图片,它们的识别状况会惨不忍睹。它们不具备常识。

问:视觉和常识有什么联系?

YannLeCun:这取决于你在和谁交流——即使在Facebook内部,大家对此也有不同的意见。你可以和一套智能系统只用语言交流,问题是语言是一条带宽很低的信息通道。人们能够通过语言传递大量信息是因为他们拥有很多的背景知识来解释这些信息。

其他人认为,向AI系统提供足够信息的唯一方法是将其视觉感知作为基础,而视觉图像的信息含量比语言要大得多。这时如果你再告诉机器“这是一个智能手机”,“这是一个压路机”,“这有些东西你能推动但那些不行”,那么机器可能会学习到关于这个世界如何运行的一些基本知识。

这有点像婴儿的学习方式——而婴儿在没有明确指示的情况下就能非常多地了解这个世界。

我们非常想让机器通过看视频或者其他的途径来获得大量的体现了现实世界规律的事实。这将最终使它们获得常识。幼年动物与婴儿出生后头几个月的学习过程非常有趣——他们仅仅通过观察就在短时间内对这个世界产生了惊人的理解。而现在的机器仍然会被各种方式轻易地愚弄,因为它们对这个世界的认识实在是太少了。

问:在让智能系统通过观察进行学习这个方面,有什么进展?

YannLeCun:一套学习系统应该是可以预测未来的,我们对这个想法非常感兴趣。你向学习系统展示几帧视频,然后它来预测接下去会发生什么。如果我们能训练出一套能完成这种工作的系统,那么我想我们就搭建起了无监督学习系统的基础技术。我认为,这会是一个节点,为许多有趣的东西开创可能性。它的应用范围也不会仅局限于机器视觉——这是我们在AI领域不断进取的重要组成部分。