1. 设置文件数、***返回行

使用简单limit抽样数据时是否开启优化选项,默认是false

- set hive.limit.optimize.enable=true ;

使用limit做数据的子集查询时保证的最小行数据量,默认是100000

- set hive.limit.row.max.size=1000000;

使用简单limit查询数据子集时,可抽样的***文件数,默认是10

- set hive.limit.optimize.limit.file=10;

2. 并发执行

- set hive.exec.parallel=true; 默认为false

- set hive.exec.parallel.thread.number=8; 线程数

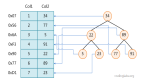

3. 数据倾斜

- set hive.groupby.skewindata=true;

数据倾斜时负载均衡,当选项设定为true,生成的查询计划会有两个MRJob。***个MRJob 中,Map的输出结果集合会随机分布到Reduce中,每个Reduce做部分聚合操作,并输出结果,这样处理的结果是相同的GroupBy Key有可能被分发到不同的Reduce中,从而达到负载均衡的目的;第二个MRJob再根据预处理的数据结果按照GroupBy Key分布到Reduce中(这个过程可以保证相同的GroupBy Key被分布到同一个Reduce中),***完成最终的聚合操作。

4. 分组优化

- set hive.multigroupby.singlemar=true;

当多个GROUP BY语句有相同的分组列,则会优化为一个MR任务

5. 聚合操作

- set hive.map.aggr=true;

在map中会做部分聚集操作,效率更高但需要更多的内存。

6. 合并小文件

- set hive.merg.mapfiles=true;

合并map输出

- set hive.merge.mapredfiles=false;

合并reduce输出

- set hive.merge.size.per.task=256*1000*1000;

合并文件的大小

- set hive.mergejob.maponly=true;

如果支持CombineHiveInputFormat则生成只有Map的任务执行merge

- set hive.merge.smallfiles.avgsize=16000000;

文件的平均大小小于该值时,会启动一个MR任务执行merge。

- set mapred.max.split.size=100000000;

- setmapred.min.split.size.per.node=100000000;

- setmapred.min.split.size.per.rack=100000000;

- set hive.input.format=org.apache.hadoop.hive.ql.io.CombineHiveInputFormat;

hive.input.format=……表示合并小文件。大于文件块大小128m的,按照128m来分隔,小于128m,大于100m的,按照100m来分隔,把那些小于100m的(包括小文件和分隔大文件剩下的),进行合并。

7. map/reduce数目

7.1. map数目设置:

当input的文件都很大,任务逻辑复杂,map执行非常慢的时候,可以考虑增加Map数,来使得每个map处理的数据量减少,从而提高任务的执行效率。

假设有这样一个任务:

- select data_desc, count(1), count(distinct id),sum(case when …),sum(casewhen ...),sum(…) from a group by data_desc

如果表a只有一个文件,大小为120M,但包含几千万的记录,如果用1个map去完成这个任务,肯定是比较耗时的,这种情况下,我们要考虑将这一个文件合理的拆分成多个,这样就可以用多个map任务去完成。

- set mapred.map.tasks=10;

- create table a_1 as select * from a distribute by rand(123);

这样会将a表的记录,随机的分散到包含10个文件的a_1表中,再用a_1代替上面sql中的a表,则会用10个map任务去完成。每个map任务处理大于12M(几百万记录)的数据,效率肯定会好很多。

7.2. reduce数目设置:

参数1:hive.exec.reducers.bytes.per.reducer=1G:每个reduce任务处理的数据量

参数2:hive.exec.reducers.max=999(0.95*TaskTracker数):每个任务***的reduce数目

reducer数=min(参数2,总输入数据量/参数1)

set mapred.reduce.tasks:每个任务默认的reduce数目。典型为0.99*reduce槽数,hive将其设置为-1,自动确定reduce数目。

8. 使用索引

- set hive.optimize.index.filter= true;

自动使用索引

- set hive.optimize.index.groupby=true;

使用聚合索引优化GROUP BY操作

【本文为51CTO专栏作者“王森丰”的原创稿件,转载请注明出处】