上周,Google一反常态的公布了其数据中心的内部照片,这引起了所有科技爱好者的关注。这比互联网的新对手Facebook公布自己数据中心的设计晚了18个月。除了照片,Google只附加了小学生看书说话式的文字。而Facebook将数据中心的设计蓝图全部公开,任何人可以参考。

图:James Hamilto

过去,数据中心被Google视为核心技术,因此Google对自己数据中心的细节总是三缄其口。一般而言,每当Google公开一项技术,意味着Google已经掌握了更先进的技术。即便如此,已经被Google“解密”的技术依然值得深入研究、学习。(注:作者James Hamilton目前系AWS专注数据中心效率研究的副总裁,此前供职于微软未来数据中心团队。)

但这些公开的照片有些不平常,这些照片来自Google正在使用的数据中心,看来Google已经掌握了更深层次技术,这些照片并不会给竞争对手透露核心机密。Google并没有披露这些照片的细节,Google提供的文字描述语焉不详。我发现Google数据中心的机械设计值得注意,于是我花时间对其进行了研究。为了更好的了解Google数据中心的特别之处,让我们先了解传统的数据中心的硬件架构。

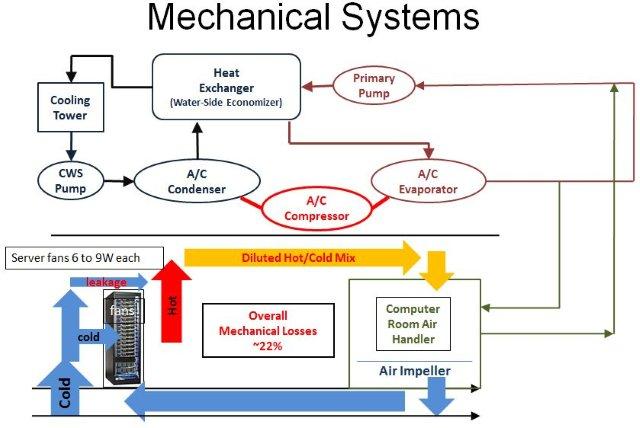

图:传统数据中心硬件构架

传统的数据中心设计方案有太多显而易见的问题,这些方案已经使用了40年,无法与时俱进。最明显的问题在于:

没有冷/热风道,这让冷热空气泄露并与混合;

空气处理室(CRAH)与服务器之间的距离太远,传输空气的成本非常昂贵;

这是一个封闭的系统,热空气被冷却后循环使用,而不是将热空气排出,让新鲜的冷空气来冷却服务器。

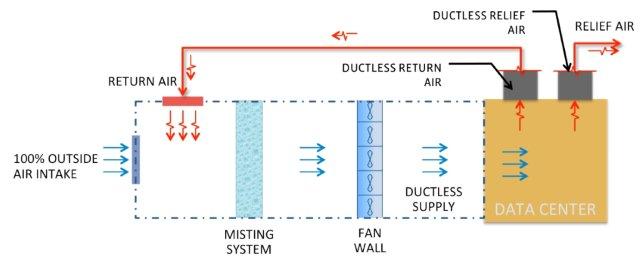

Facebook Prineville Oregon的数据中心就是一个***的案例:

图:Facebook Prineville数据中心硬件架构

我是一个Facebook Prineville数据中心的粉丝。Facebook彻底抛弃了水冷设备,它们不仅昂贵而且费电。(CSDN注:Facebook在Prineville的数据中心地处在喀斯开山脉的雨影区,空气干燥而干净,昼夜温差大,夜间只有4摄氏度,适宜采用自然空气冷却。详见:《Facebook开源数据中心王国》)全部使用彼此隔离的风道,室外的热空气通过蒸发皿降温,数据中心所在的建筑被看作一个巨大的整体,散热效率非常高。#p#

让我们看看Google爱荷华州的Concil Bluffs数据中心:

图:Concil Bluffs数据中心内部

你可以看到一张经过挑选的照片,一个巨大的房间,而不是被分成若干独立的区域。完全采用风道设备,彻底避免服务器或机架产生的空气泄露。冷空气直接流入服务器,热空气并不会流回,而是通过热交换器将热量传递出去。空气流动控制格外重要,空气流动经济性(air-side economization)是提升散热效率的关键。提高空气流动经济性的关键是让冷空气流入服务器,而不是让服务器排出热空气(Facebook采用了全封闭的风道来提高空气流动经济性)。

通过这些照片,我们看到Google全面进行了颠覆性的尝试。Google把整个建筑视为风道的一部分,并没有完全弃用水冷系统,而是将其升级进化,从而提高水冷系统的效率。通过Google在芬兰Hamina数据中心照片,我们看到在热风道上多组热交换器。

图:Hamina数据中心内部

气流如何工作?

在Mayes County数据中心这样照片里,我们看到数以百计的风扇直接将热空气排入密闭的风道,从冷却塔来的冷水通过包裹金属外层的水管输送到风道顶端的热交换器,热空气迅速被冷却避免在风扇周围聚集。

图:Mayes County数据中心巨大的风道。大量的风扇将热空气排入风道,不锈钢包裹的水管将冷水输送到顶部的热交换器。

数据中心内部保持80华氏度(约等于26.67摄氏度),略高于其它数据中心。80华氏度的空气进入服务器内部,然后被加热。服务器后部的风扇将被加热到 接近120华氏度的空气排入封闭的风道,热空气上升,并被顶部的热交换器冷却,被冷却的空气会从下方的活动地板排出。Google数据中心高级总监Joe Kava表示:“一旦水冷管泄露,后果非常严重。我们的设计经过了多年考验,万无一失。”

水冷的核心优势是输送水比输送空气成本更低,而且水的热容积更大。Google的设计思想是尽可能让水通过各种方式到达机架,这并不是工业界***次这么做,但Google做的几近***。IBM的iDataPlex也将水直接通到机架后面,许多高密度的HPC系统也采用了这种方式。

固然直通到机架的水冷系统拥有高效率,但我更青睐空气流动经济系统。任何一个系统都可以屏蔽户外的热空气,并让冷空气长途跋涉输送给服务器(请见本文***张图片)。我依然倾向将外部空气输送到服务器的方法,然而,随着服务器密度不断增加,单位空间的功率也随之增长,水冷系统就十分必要了。正如Google将水冷系统覆盖到服务器,亦如IBM在上世纪80年代采用的热导模块。热导模块在当时是非常先进的水冷系统,由Green Revolution Cooling提供,该公司还使用了将服务器完全浸入油中的冷却方式。