AtomoVideo:AIGC赋能下的电商视频动效生成

1. 概述

当今电商领域,内容营销的形式正日趋多样化,视频内容以其生动鲜明的视觉体验和迅捷高效的信息传播能力,为商家创造了新的机遇。消费者对视频内容的偏好驱动了视频创意供给的持续增长,视觉内容作为连接消费者和商品的桥梁,在广告系统中正变得日益重要。

然而,与传统的图文内容相比,视频内容的制作难度和成本都要高得多。制作一个高质量的视频需要专业的技能、设备以及时间,这使得成品的质量层次不齐,且难以批量化生产。随着人工智能和生成式内容创造(AIGC)技术的进步,使得通过智能化手段批量制作优质视频创意成为可能,并且能够为客户带来显著价值。

近日,OpenAI Sora 的发布让人们看到了视频智能创作的曙光,如今各大团队也纷纷开始了“国产版 Sora”的探索之路,在 Sora 出现之前,阿里妈妈智能创作与AI应用团队在视频 AIGC 领域已有近一年的研究和探索,与业务相结合,我们孵化出了🔗 尺寸魔方、商品视频动效生成等基于扩散模型的视频生成和编辑工具。本文将聚焦于商品视频动效生成,介绍我们在视频 AIGC 应用于视频创意上的探索与实践。

借助自研的AtomoVideo 视频生成技术(中文:阿瞳木视频,项目地址:https://atomo-video.github.io/),我们探索出了一种自动化地将电商平台上现有的图片素材转换为高质量的视频动效的方法,并在万相实验室、广告投放平台等场景进行了落地和上线,服务于广大阿里妈妈广告客户。

|

|

|

|

2. 核心技术

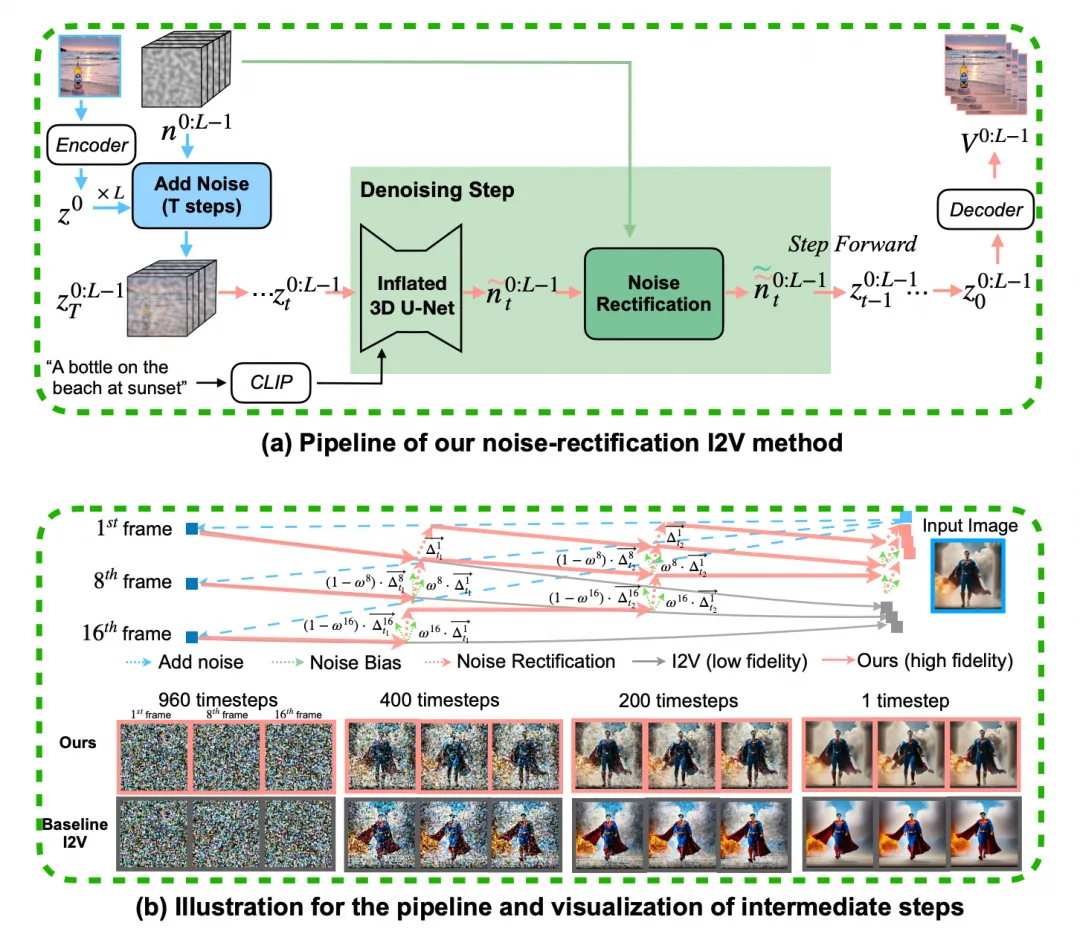

整个商品视频动效的生成过程面临诸多挑战,尤其是在电商场景下,商品主体的细节是不允许被改变的,也是商家非常在意的基本准则。因此,如何在保持商品外观准确性的同时进行更加合理的动效视频生成,是非常值得探索的问题。我们在现有T2V模型的基础上,提出使用 Noise Rectification(无需训练的噪声矫正器)来实现图像到视频的生成,为了进一步提升视频连贯性和保真度,进而提出 AtomoVideo(阿瞳木视频生成技术) 将基础模型进行升级,赋能电商视频动效生成。

2.1 Noise Rectification: 无需训练的噪声矫正器

文本到图像生成(T2I)在过去一年取得了飞速的发展,诸多设计行业从业者、科技爱好者利用 Stable Diffusion WebUI、ComfyUI 等开源工具已经可以生成摄影级图像和实现商业级落地应用。相比之下,受限于训练机器资源和数据集收集困难等挑战,视频生成远没有图像生成领域发展迅速,近半年,随着 Pika、Gen-2 等视频编辑工具的出现,社区中也涌现了许多文本到视频生成(T2V)的工作,为了将此类 T2V 的工作迁移至我们的商品动效生成中,我们提出了一种无需训练的噪声矫正器(Noise Rectification),可以自然地实现 T2V 到 I2V 的转变。

具体来说,我们对给定图片添加一定步数的噪声,以此来模拟训练过程中的加噪过程,这样我们便获得了含有输入图像信息的噪声先验,在此基础上进行降噪即可保留一定输入图片的风格等信息。然而,这种“垫图”式 T2V 生成方式在电商领域对给定图片做动效生成时,会丢失大量原图像中的细节信息,严重破坏原有图片的美观度。为此,我们专门设计了一个与“垫图”生成可以完美配合的噪声矫正器(Noise Rectification),噪声矫正器流程图如下所示:

Noise Rectification示意图

考虑到模型训练无法达到完美损失,即模型预测噪声总会存在偏差,从而导致视频保真度的降低。为了缓解模型在 DDIM 去噪过程中的误差累积(指实际添加的噪声与每一步中模型预测的噪声的差异),对于每一步模型预测的噪声,我们利用初始采样的噪声,对其进行“噪声矫正”,即 通过计算预测噪声和真实噪声之间的差异,采样加权的计算方式对预测的噪声进行适当调整。通过这种设计,我们的方案可以消除第一帧的噪声误差,使得第一帧达到完美保真,同时其余帧也会和第一帧保持时序内容上的一致。本方案提出的“垫图+噪声矫正”策略,不需要引入额外的训练,直接作用于动效模型的推理阶段,即可提高图生视频的保真度。更多技术细节请参见我们的论文:

- Title:Tuning-Free Noise Rectification for High Fidelity Image-to-Video Generation

- 链接:https://arxiv.org/abs/2403.02827

- 项目主页:https://noise-rectification.github.io/

使用该方案后的前后对比效果如下,能够明显看到动效视频与给定图像一致性的提升,结合可控生成技术,我们可以完美还原商品细节。但这种针对 T2V 模型的噪声校正策略在更多通用场景下会存在动效幅度较小的缺点,关于这一点的解决,我们将在下一章节进行介绍我们的改进。

输入图像 | 生成动效(直接垫图生成) | 生成动效(使用Noise Rectification生成) |

|

|

|

|

|

|

2.2 AtomoVideo:高保真度的I2V模型升级

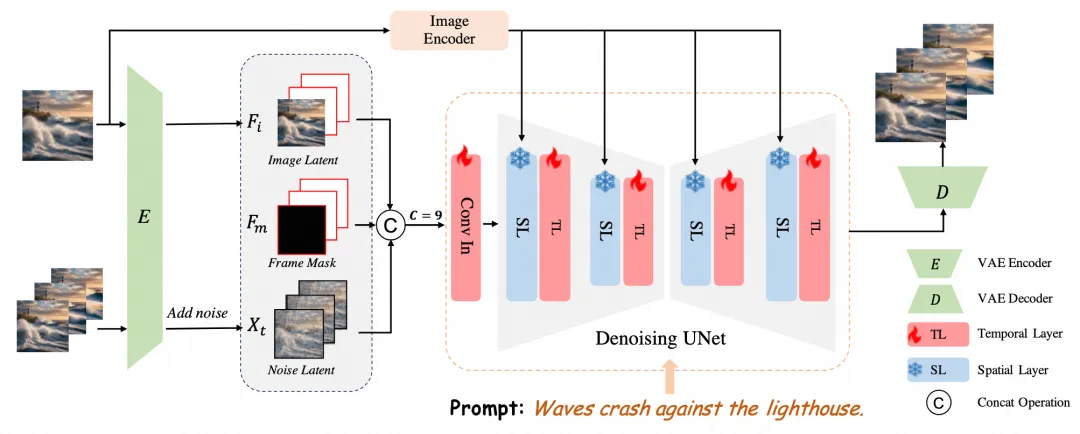

在商品信息注入和噪声矫正器的加持下,商品动效生成已经具备了不错的生成效果,我们也基于以上改进在万相实验室上线了动效生成模块的第一版,但由于所使用的基础模型为 T2V 模型,并非适用于本任务的 I2V 模型,且生成时长仅有2s,在淘内场景下使用受限。为此,我们专门研发了更适用于本任务的 I2V 基础模型,称为 AtomoVideo(中文:阿瞳木视频),该模型对视频的时序一致性和图像保真度提升显著,模型结构框架图如图所示:

AtomoVideo 模型结构图

我们对模型做了如下几个改进,包括优质数据集构建、多粒度图像注入、渐进性动作强度训练等。

1) 优质数据集构建:收集内部千万规模的“文本-视频”数据对,利用美观度、文本视觉相关性、主体检测(过滤人物视频)、动效强度检测等方式,清洗得到优质视频数据子集,用于视频生成模型训练。同时我们与设计师合作构建了一个更加优质的数据集,汇集了大量在美观度和动效质量上均表现出色的高清视频。

2) 多粒度图像注入:为增强 I2V 生成的图像保真度和时序一致性,我们使用了多粒度的图像注入方法,在扩散模型输入侧将图像的low-level和high-level语义进行输入,在我们实验中,这可以在完美还原给定图像保真度的同时,增加生成视频的时序一致性。

3) 训练方法:我们观察到大多数其他工作(如Pika、Gen2等)很难生成动作幅度大的视频,还有一些工作在生成动作幅度较大的视频时,稳定性较差。为了克服这一点,我们使用了渐进性动作强度增加的多阶段训练方式,由低动效视频数据集开始,逐步增加至高动效数据集进行训练,我们发现这可以帮助模型在生成较大动作幅度视频的同时,依然能够维持较好的时序稳定性。

经过如上的改进和大规模训练,我们将基础模型升级为可产生4s,720P的视频生成模型。更多相关细节可以阅读我们的技术报告:

- Title:AtomoVideo: High Fidelity Image-to-Video Generation

- 链接:http://arxiv.org/abs/2403.01800

- 项目主页:https://atomo-video.github.io

部分生成示例如下,更多示例可前往项目主页浏览:

输入图片 | 输入文本 | 输出视频 |

| Muppet walking down the street in a red shirt, cinematic. |

|

| Flying through an intense battle between pirate ships in a stormy ocean. |

|

| a singer of a music band |

|

此外,我们将I2V基础模型的原始T2I模型部分进行了参数固定,而仅对新增的时序建模层和输入层进行训练,因此,我们可以将社区广泛使用的图像 ControlNet 与 AtomoVideo 进行结合,这也是我们相比于 SVD 等视频开源模型的优势。结合 T2I 领域预训练好的 ControlNet,可以实现局部控制生成,以尽量还原商品细节,当前我们上线版本已全部切换为该模型。

2.3 动效场景模板适配

由于输入商品图像的质量一定程度会影响动效生成的效果,有较多图片中并未包含任何动态元素,这种情况下,进行图像到视频的转换显得比较困难,容易产出“偏静态”的视频。因此,基于以上考量,我们与设计师共建了视频动效场景模板,并针对每个不同的场景描述定制化了特殊的动态描述。其中视频动效场景列表包含了诸如“山间云海”、“海底世界”等动态场景,同时在大促节日时,会专门设计一批用于节日宣传的动态模板进行投放(如下图是在38大促期间设计的两个动效模板)。

场景模板名称 | AIGC图片 | 动效视频 |

粉色烟花 |

|

|

粉色世界 |

|

|

3. 业务应用

当前,电商视频动效生成已经在阿里妈妈-万相实验室(https://agi.taobao.com)和广告投放平台进行上线,支持广告主在线生成视频动效。以下是生成的一些样例:

输入图片 | 动效视频 |

|

|

|

|

|

|

|

|

|

|

|

|

4. 总结与展望

近半年,AIGC 视频生成技术取得了令人瞩目的飞跃发展。随着 GEN-2、PIKA 1.0、Sora 等视频创作工具和模型的出现,影视制作和多媒体设计等行业正迎来一场创造力的革新风暴,这些技术正在推动视频内容制作向着更高的逼真度和更强的可控性迈进。本文介绍了我们团队在视频 AIGC 赋能视频广告创意的探索和实践,通过基于扩散模型的视频生成技术,结合可控生成技术,使得静态电商图片栩栩如生地“动”了起来,实现了在电商领域的视频 AIGC 应用落地。

然而,目前的技术实现还远未触及视频生成的真正潜力,在视频画面的稳定性、内容创造的可控性以及视频时长等关键要素上,仍有很大的进步空间值得我们探索。Sora 的出现也让我们看到了未来视频创作工具大规模应用的曙光,Diffusion Transformer、Scaling Up 等关键技术给了我们很多启发,在未来,希望不断提升基础模型生成效果的同时,用视频 AIGC 技术赋能更多业务场景。

本文转载自 阿里妈妈技术,作者:智能创作与AI应用