AAAI前主席Subbarao Kambhampati:LLM-Modulo框架助力大模型完成规划任务! 原创

研究人员对大型语言模型(LLMs)在规划和推理任务中的作用存在相当大的困惑。一方面存在过于乐观的说法,即LLMs只需适当的提示或自我验证策略就能够完成这些任务。另一方面,可能存在过于悲观的说法,即LLMs在规划/推理任务中的唯一作用就是将问题规范从一种语法格式转换为另一种,并将问题转移到外部符号求解器。

Subbarao Kambhampati教授认为这两种极端观点都是错误的。自回归LLMs本身不能完成规划或自我验证(毕竟后者是一种推理形式),并对文献中存在误解的原因进行了一些解释。Subbarao Kambhampati教授还将主张将LLMs视为具有更有意义角色的通用近似知识源,超越简单的前端/后端格式转换器,在规划/推理任务中发挥更多作用。Subbarao Kambhampati教授提出了一个LLM-Modulo框架的愿景,将LLMs的优势与外部基于模型的验证器结合在一个更紧密的双向交互体制中。Subbarao Kambhampati教授展示如何使用LLMs的帮助来获取驱动外部验证器的模型本身,与仅仅将LLMs和符号组件串联起来不同,这种LLM-Modulo框架提供了更好的神经符号方法,提供了LLMs和符号组件之间更紧密的集成,并允许将基于模型的规划/推理体制扩展到更灵活的知识、问题和偏好规范。

简介

大型语言模型(LLMs)实质上是在大规模语言语料库上训练的N元模型,可以说是被训练在网络规模的语言语料库上(或者说是我们的集体意识),这些模型展现出了让人意想不到的语言行为,超乎了人们对文本补全系统的预期。它们看似多才多艺的特性引起了许多研究人员的兴趣,让他们想知道这些模型是否也能在通常与第二系统能力相关的规划和推理任务中表现出色。表面上看,这似乎不太可能,因为从训练和操作来看,LLMs最好被视为一个巨大的伪第一系统。即使从纯工程的角度来看,一个需要恒定时间产生下一个标记的系统也不可能自行进行有原则的推理。毫不奇怪,基于LLMs在推理任务上的轶事表现引起的最初的兴奋情绪在最近一系列质疑这种行为鲁棒性的研究(如规划)。尽管如此,文献中仍然不断有关于LLMs规划和推理能力的声称。与对LLMs规划和推理能力的不合理乐观态度形成鲜明对比的是,关于LLMs在规划/推理任务中可以发挥的作用的不合理悲观态度也在存在。一些努力主张仅将LLMs用作华丽的翻译工具——将嵌入文本格式的推理问题转换为符号表示,然后将其交给外部经典符号求解器(带有所有相关的表达能力和搜索复杂性挑战。

事实上,LLMs远不止是机器翻译工具。它们是一种近似知识源,是在我们的集体意识上训练的。虽然它们不太可能拥有第二系统的能力,但它们仍然可以成为解决第二系统任务的宝贵资源。换句话说,往昔的炼金术问题不在于化学是无用的,而是人们想要欺骗自己,认为化学——本身就是一门相当了不起的学科——只要适当引导就可以成为核物理学。关于LLMs能力的困惑,或者说LLMs炼金术,似乎并没有那么大的不同——在忽视它们擅长的方面和赋予它们没有的能力之间摇摆不定。

LLM-Modulo鲁棒规划框架

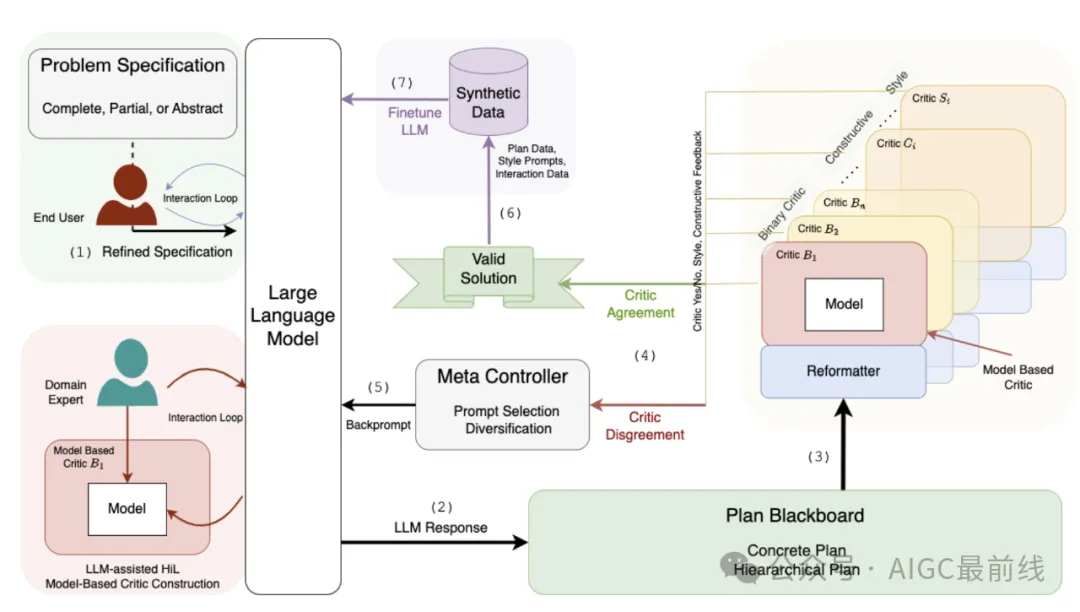

Subbarao Kambhampati教授提出了一个通用的“LLM-Modulo”框架。

上图给出了设想的LLM-Modulo框架的示意图。可以很容易地看出,底层架构是一个生成-测试-评价循环,LLM生成候选计划,一组评论家对候选进行评论。循环以LLM获取问题规范并生成其第一个计划候选开始。请注意,在这种架构中,LLM帮助生成的计划具有由外部可靠评论家提供的合理性保证。这意味着通过这种架构产生的计划将构成更好的合成数据语料库,用于任何旨在改进/定制LLM生成能力的微调阶段。

首先,注意到LLM-Modulo架构是一种涉及LLMs与外部评论家而不是求解器进行交互的“生成-测试”架构。这是一个有意识的决定——因为这样可以让LLM猜测/生成候选方案以满足评论家,而不是处理求解器的表达能力和搜索复杂性问题。其次,该框架明确承认LLMs不仅可以生成关于计划候选人的近似想法,还可以生成关于领域模型、问题简化策略和问题规范的修正。该框架还承认LLMs擅长格式/语法变化。因此,该框架利用了LLMs的所有这些能力,让它们在规划中扮演多种角色。最后,该架构精心限制了人类的角色——领域专家与LLM进行交互,以揭示(部分)评论家使用的模型,而最终用户与LLM协作完善任何不完整的问题规范。一个值得注意的、有意为之的缺失是人类参与规划的内循环——例如,通过迭代提示。除了给复杂规划问题的人类带来不可行的负担外,这种迭代提示策略还以其“聪明的汉斯”效应而臭名昭著。

论文:https://arxiv.org/pdf/2402.01817

谁是Subbarao Kambhampati?

Subbarao Kambhampati(简称Rao)教授是亚利桑那州立大学计算机科学教授,曾任人工智能促进协会(AAAI)主席。他的研究重点是自动化规划和决策制定,特别是在人类感知的人工智能系统背景下。他是一位备受赞誉的教师,花费大量时间思考人们对人工智能的公众认知和社会影响。他曾是美国国家科学基金会的年轻研究员,并且是AAAI的会士。他在多个角色中为人工智能社区提供服务,包括担任IJCAI 2016的程序主席和AAAI 2005的程序联合主席。Rao毕业于印度理工学院马德拉斯分校获得学士学位,后在马里兰大学学院公园分校获得博士学位。

本文转载自公众号AIGC最前线