14 项任务测下来,GPT4V、Gemini等多模态大模型竟都没什么视觉感知能力?

2023-2024年,以 GPT-4V、Gemini、Claude、LLaVA 为代表的多模态大模型(Multimodal LLMs)已经在文本和图像等多模态内容处理方面表现出了空前的能力,成为技术新浪潮。

然而,对于这些模型的评测多集中于语言上的任务,对于视觉的要求多为简单的物体识别。相对的,计算机视觉最初试图解读图像作为3D场景的投影,而不仅仅处理2D平面“模式”的数组。

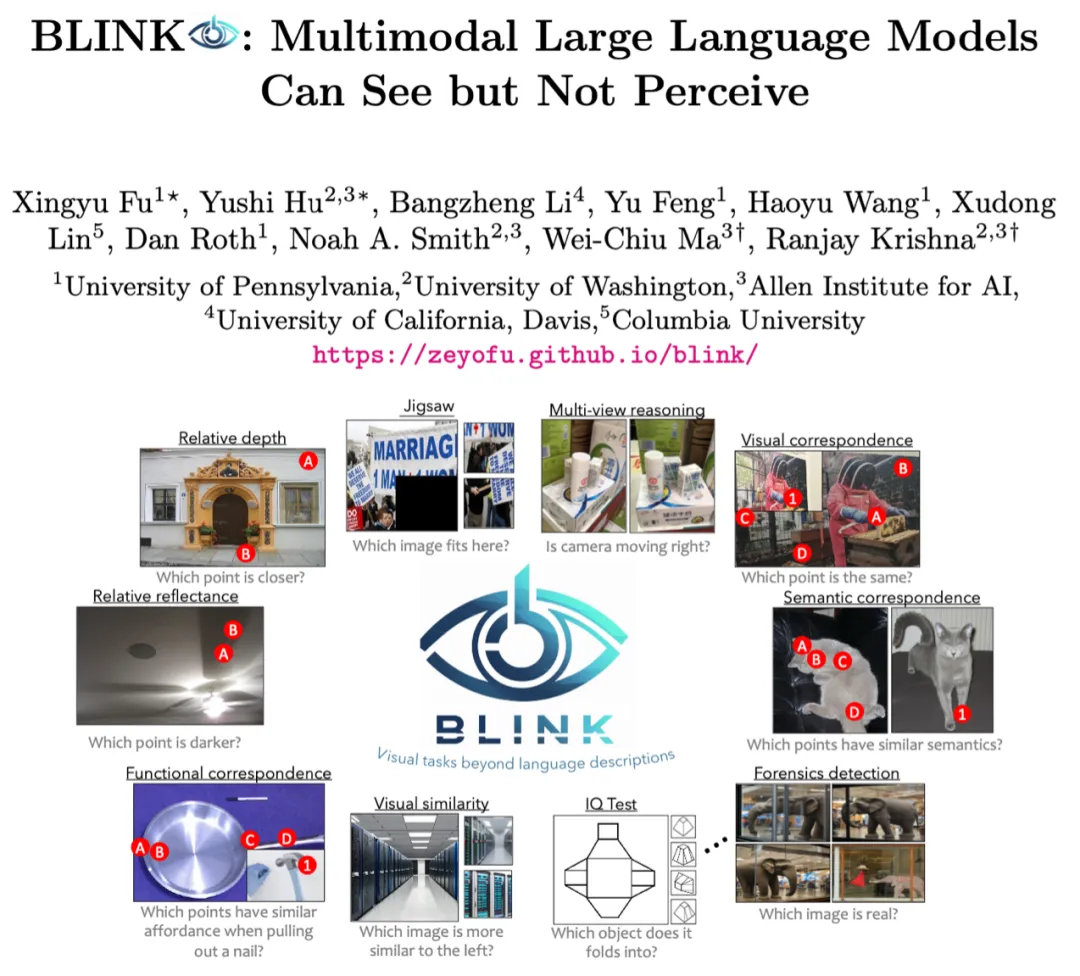

为响应这一情况,本文提出了BLINK,这是一个新的测试集,包含了重新构想的传统计算机视觉问题,使我们能够更全面评估多模态大模型的视觉感知能力,带你揭开GPT4V、Gemini等大模型的视觉界限秘密。

作者相信BLINK将激励社区帮助多模态LLMs达到与人类同等级别的视觉感知能力。

论文链接:https://zeyofu.github.io/blink

什么是BLINK?

BLINK 是一个针对多模态语言模型(Multimodal LLMs)的新基准测试,专注于评估其核心视觉感知能力,这些能力在其他评估中并未涉及。

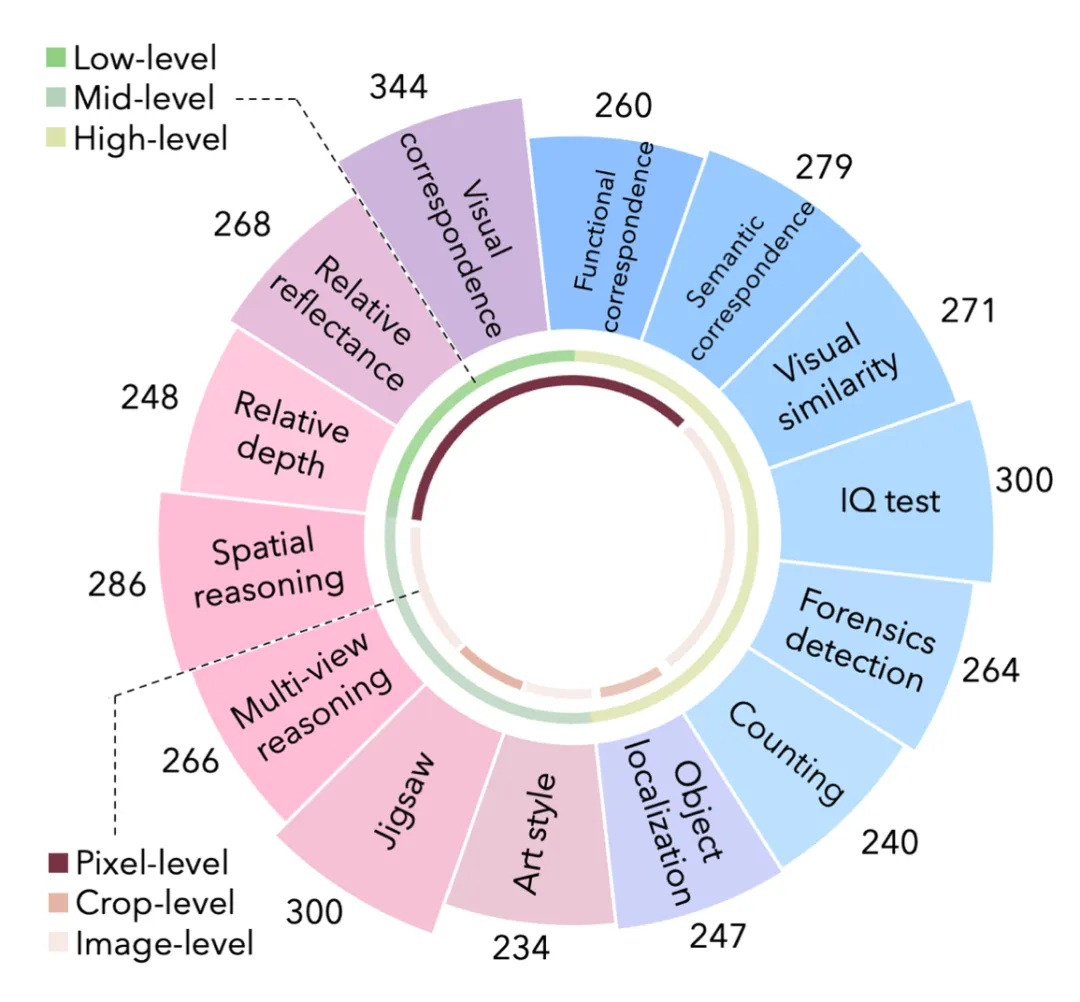

BLINK包含 14 项视觉感知任务,拥有3.8k个选择题和7.3k张图像。

人类可以“一眨眼”之间解决这些任务 (例如,相对视深、视觉对应、目标定位,和多视角推理等);但对当前的多模态大型语言模型(Multimodal LLMs)而言,这些任务构成了重大挑战,因为它们难以通过自然语言处理来解决。

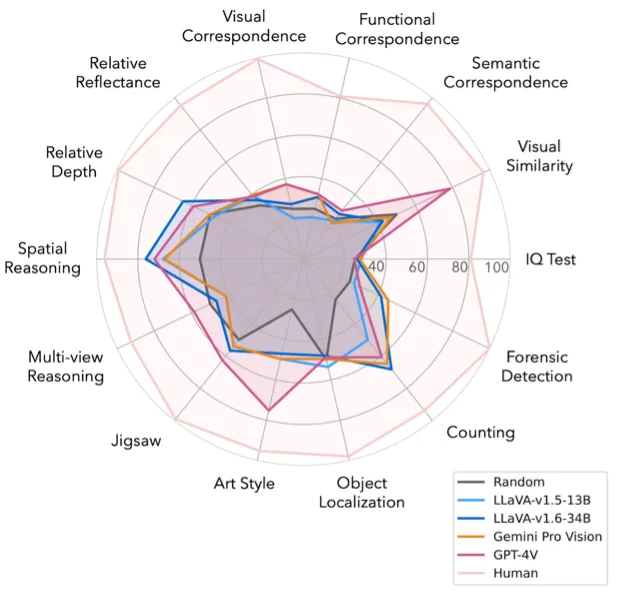

平均而言,人类在这些任务上的准确率为95.70%,然而即使是GPT-4V和Gemini也只达到了51.26%和45.72%的准确率,比随机猜测仅高出13.17%和7.63%。

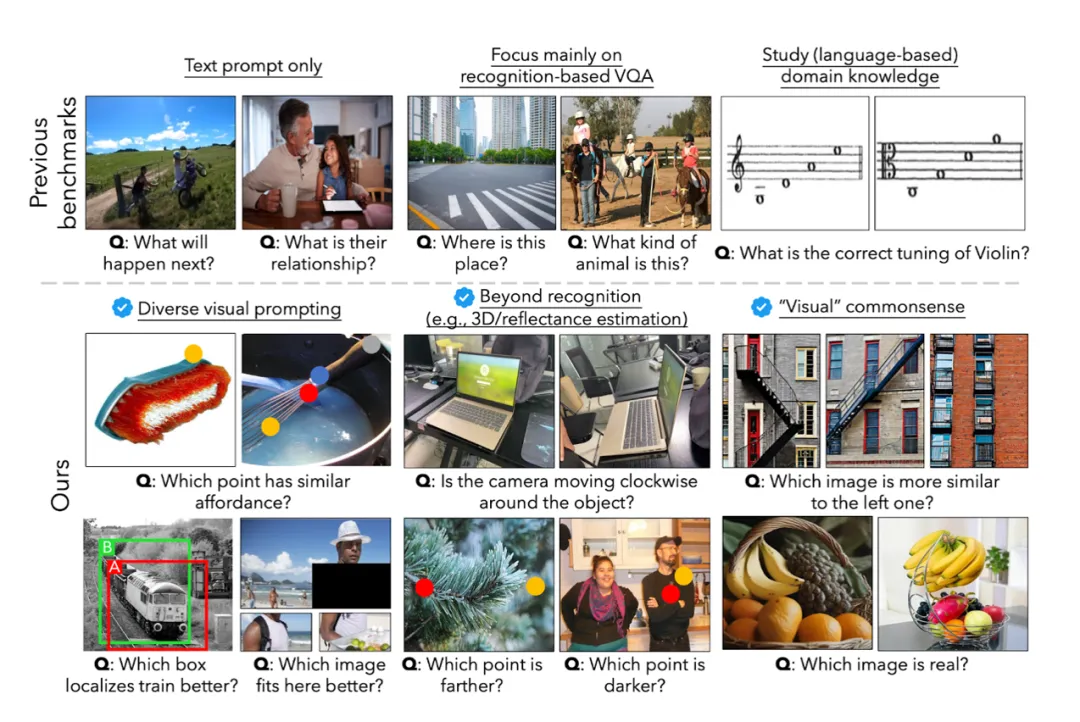

BLINK与其他基准测试的区别

(1)BLINK 运用了多种的视觉prompts, 如圆形、盒形, 和图像遮罩 masks, 而以前的基准测试仅包含文本问题和答案。

(2)BLINK评估了更全面的视觉感知能力,如多视角推理、深度估算和反射率估算。以往的基准测试通常更侧重于基于物体识别的视觉问答(VQA)。

(3)BLINK只包含“视觉”常识性问题,这些问题人类不需要接受教育就可以在一秒钟内回答,而以前的基准测试像MMMU这样的则需要专业领域知识。

(4)BLINK涵盖了14个需求感知的任务,这些任务受到经典计算机视觉问题的启发。虽然这些问题仅需人类“一眨眼”的时间即可解决,但它们超出了当前多模态大型语言模型的能力。

BLINK 实验结果

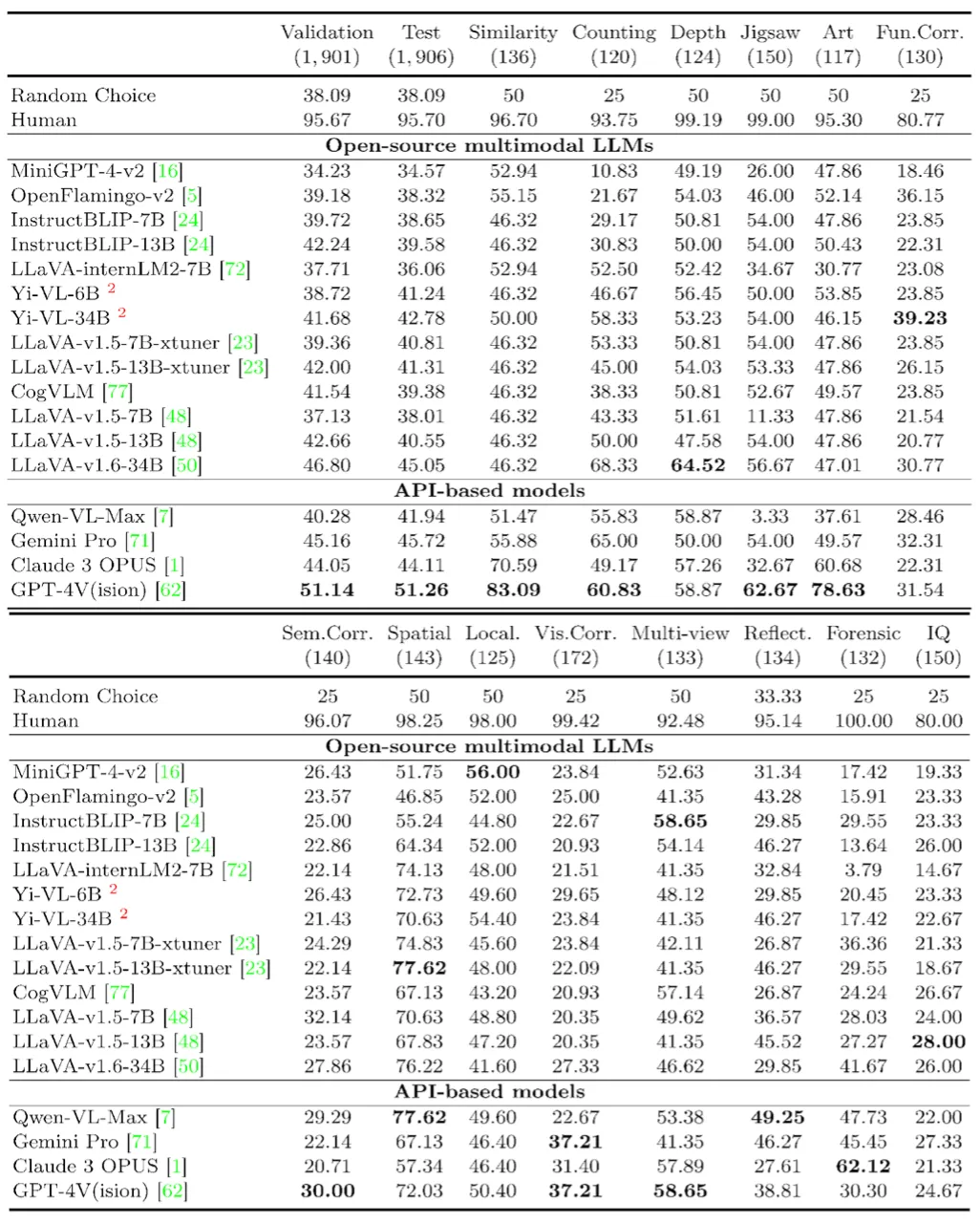

本文评估了17个不同大小(即7B,13B,34B)的多模态LLMs在BLINK上的表现。并观察到一个悖论:尽管这些问题对于人类来说很容易(平均准确率为95.70%),但对现有机器来说却极其困难。

7B和13B开源多模态大型语言模型(LLMs)的平均准确率大约在35-42%之间,与随机猜测(38.09%)相似。

最好的开源模型是LLaVA-v1.6-34B,达到了45.05%的准确率。

即使是最新的大模型,如GPT-4V、Gemini Pro和Claude 3 OPUS,其准确率也仅为51.26%、45.72%和44.11%。它们的表现仅比随机猜测好13.17%、7.63%和6.02%,并且比人类的表现差44.44%、49.98%和51.59%。

值得注意的是,在某些任务上,如拼图、语义对应、多视角推理、对象定位和相对反射率,一些多模态LLMs甚至表现不如随机猜测。

BLINK展示大模型的错误范例

对于每项任务,该文章展示了LLaVAv1.6-34B、Qwen-VL-Max、Gemini Pro、GPT-4V和人类的选择。红色选项指的是正确答案。请注意,为了视觉效果,作者故意放大了标记,并且将一些图片做成插图以节省空间。

对于智力测验,第三张图片是通过叠加第一张和第二张图片构成的。

BLINK实验分析

(1)把图片转换成文字是否是解决多模态问题的正确选择?

为了回答这个问题,本文使用GPT-4V将图片转换为与任务无关的密集图片字幕,并使用基于文本的LLM来完成任务(Caption + LLM)。这种密集字幕利用语言描述了图像及视觉提示的详细信息(例如,每个圆圈的位置)。

作者在BLINK、MMBench和MMMU上进行了实验。令人惊讶的是,Caption + LLM的配置在MMBench和MMMU上的结果远优于BLINK。这些结果表明,图像字幕携带了回答其他基准所需的大部分视觉信息。同时,BLINK需要的高级感知能力超出了通用字幕目前可达到的范围。

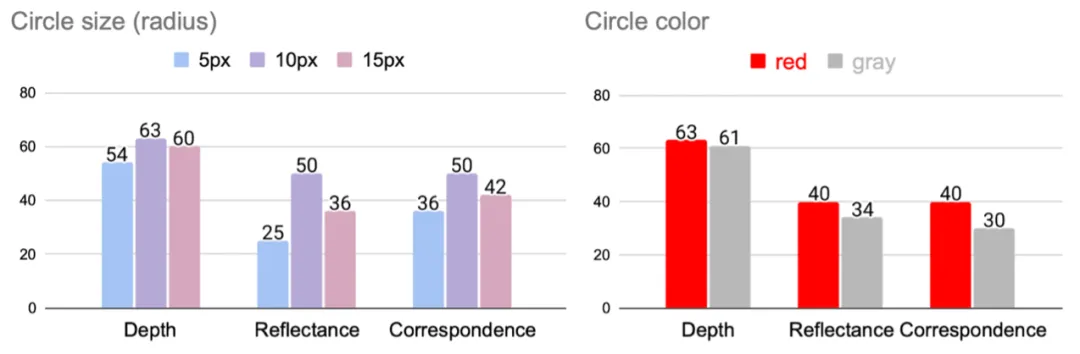

(2)视觉提示(visual prompts)对多模态大模型能产生多大的影响?

本文分析了BLINK中多个任务上圆圈大小和颜色的影响。

实验表明,视觉提示可能对多模态LLM的性能产生重大影响,改进视觉提示或提高模型对提示变化的鲁棒性是未来研究的有前景的方向。根据分析,作者发现最佳圆圈大小依赖于具体任务,平均而言,10px的圆圈效果最好。同样,对于所有任务来说,红色比灰色更好。

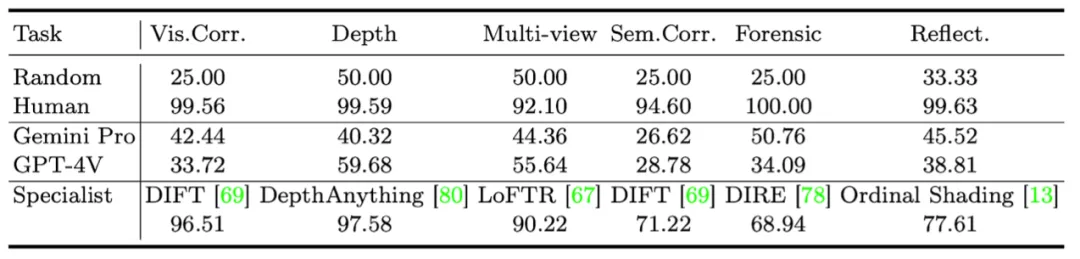

(3)传统计算机视觉专家模型能解决BLINK任务吗?

专家可以作为多模态LLM可能达到的上限的代理。这揭示了一个可能性,即多模态LLM可能因正确的数据和培训策略而在这些任务上取得进展。

作者简介:

府星妤 (Xingyu Fu)是宾夕法尼亚大学NLP组的博士生,师从Dan Roth教授。她曾在亚马逊和微软实习。她的研究主要专注于多模态大模型的感知和推理Reasoning。

胡雨石 (Yushi Hu)是华盛顿大学NLP组的博士生,师从Mari Ostendorf 和 Noah Smith 教授。与此同时,他还是艾伦人工智能研究所(AI2)学生研究员,此前曾在谷歌和腾讯AI 实习。他的研究主要专注于多模态大模型和基于反馈的模型训练。

本文转自 机器之心 ,作者:机器之心