腾讯、上海科大开源InstantMesh,图片直接生成3D模型

腾讯PCG ARC实验室和上海科技大学的研究人员联合开源了创新模型——InstantMesh。

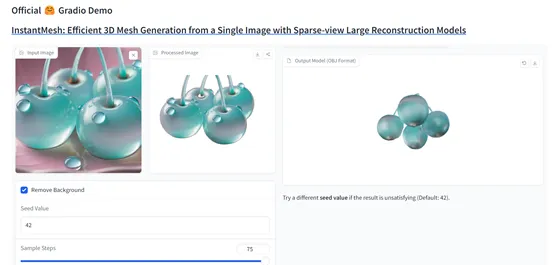

用户通过InstantMesh上传一张图片,只需要十秒的时间就能将图片变成360度全视角的3D模型。并且可以下载模型将其放在3D Max、玛雅等专业软件中,以简化游戏、广告、家居、虚拟现实等开发流程。

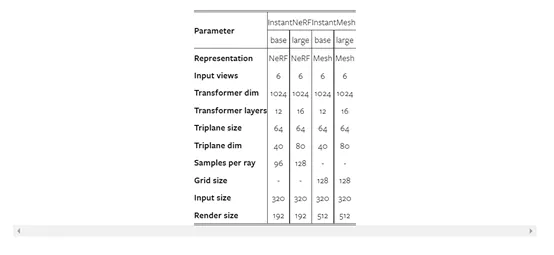

研究人员在公开数据集Google Scanned Objects、OmniObject3D等InstantMesh进行了综合测试。

结果显示,其生成的3D模型在视觉质量和几何精度上都显著优于现有最新方法,如LGM、CRM等。在多视角的合成任务上,InstantMesh也明显优于SV3D等知名扩散模型。

开源地址:https://github.com/TencentARC/InstantMesh

在线demo:https://huggingface.co/spaces/TencentARC/InstantMesh

论文地址:https://arxiv.org/abs/2404.07191

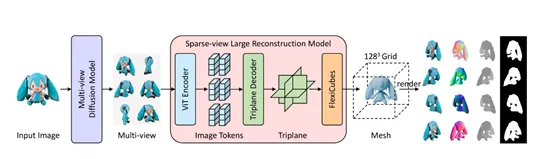

InstantMesh的技术创新在于,将多视图扩散模型和稀疏视图重建模型相结合使用。

首先利用多视角扩散模型生成一组一致的多视角图像,然后利用稀疏视图重建模型直接预测3D网格,整个过程只需要十几秒甚至几秒就能完成。

为了提高训练效率,并在3D网格表示上应用几何监督信息,InstantMesh还引入了一个可微分的等值面提取模块。这种方法能够直接在网格表面上进行优化,从而提高训练效率和模型生成的质量。

多视图扩散模型

多视图扩散模型的主要作用是将一张静态的2D图片中生成一系列新的视角图像,这些图像覆盖了目标物体的多个方向。

首先,接收用户输入的图片,并利用Zero123++模型生成一系列的新视角图像,包括了物体的正面、侧面、上面、下面和背面等360度视角图片。

这可以帮助InstantMesh捕捉到图片的全方位信息,为后续的3D网格预测打下坚实的基础。

简单来说,整个过程就像玩拼图游戏一样,例如,需要从一张完整的图片中找到所有可能的视角,然后将它们拼凑起来,形成一个完整的立体图像。

所以,也可以把多视图扩散模型理解成InstantMesh的“眼睛”,帮助它深度剖析每一张上传的图片。

稀疏视图重建模型

稀疏视图重建模型则主要负责将,多视图扩散模型生成的视图拼装成3D模型。首先通过其内部的神经网络架构,提取输入图像的特征,并将其与先前的知识结合起来,以便更好地理解物体的结构和外观。

利用提取到的特征和辅助知识,稀疏视图重建模型能预测出一个初步的3D网格模型,包含了物体的基本形状和结构,但是在质量和细节方面还差很多。

所以,研究人员使用了可微分的等值面提取模块对网格表面进行几何监督,大幅度优化3D模型的细节和平滑度。

此外,这种直接在网格表面进行监督训练的优化方法,避免了体素渲染的高计算消耗,同时能利用全分辨率的RGB图像、深度图和法线图作为训练监督,也使得生成的3D模型更加适合于后续的渲染、编辑和分析等应用。

本文转自 AIGC开放社区 ,作者:AIGC开放社区