精细化图像编辑!LocInv:优化交叉注意力泄漏问题(国科大&巴塞罗那自治大学)

论文链接:https://arxiv.org/pdf/2405.01496

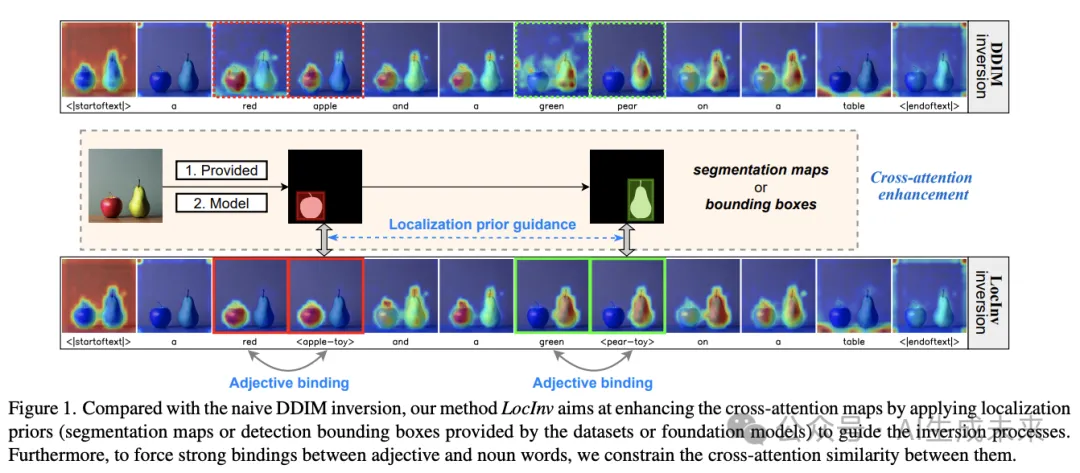

大规模文本到图像(T2I)扩散模型展示了基于文本prompt的显著生成能力。基于T2I扩散模型,图像编辑研究旨在赋予用户通过改变文本prompt来操作生成的图像。然而,现有的图像编辑技术往往会在超出预期目标区域的意外区域进行编辑,主要是由于交叉注意力图中的不准确性。为了解决这个问题,本文提出了感知反演(LocInv),它利用分割图或边界框作为额外的定位先验来在扩散过程的去噪阶段中优化交叉注意力图。通过动态更新文本输入中对应于名词的token,本文迫使交叉注意力图与文本prompt中的正确名词和形容词紧密对齐。基于这种技术,本文实现了对特定对象的精细图像编辑,同时防止对其他区域进行不需要的更改。本文的方法LocInv,基于公开可用的Stable Diffusion,在COCO数据集的子集上进行了广泛评估,无论是在定量上还是在定性上都得到了优越的结果。

介绍

文本到图像(T2I)模型取得了显著的进展,并展示了生成多样且逼真图像的前所未有的能力。T2I模型是在庞大的语言-图像数据集上进行训练的,需要大量的计算资源。然而,尽管它们具有令人印象深刻的能力,但它们并不直接支持实际图像编辑,并且它们通常缺乏精确控制图像中特定区域的能力。

最近的关于文本引导图像编辑的研究允许用户仅使用文本prompt来操纵图像。在本文中,专注于文本引导编辑,旨在改变图像中特定源对象的视觉外观。现有的一些方法[29, 37, 39, 52]使用DDIM反演来获得图像的初始潜在代码,然后在去噪阶段应用他们提出的编辑技术。然而,目前的文本引导编辑方法容易导致图像区域的意外变化。这是由于现有编辑技术在交叉注意力图的精确性上的重度依赖所致。

DPL观察到DDIM和NTI的交叉注意力图不仅与相应的对象相关。这一现象归因于交叉注意力泄漏,这是阻碍这些图像编辑方法应用于复杂多对象图像的主要因素。为了解决这个问题,DPL通过引入额外的注意力损失来增强交叉注意力。然而,DPL依赖于名词及其相关对象之间相对较弱的连接。这种连接有时倾向于较弱,并导致性能不佳。此外,鉴于最近文本为基础的分割和检测基础模型的进展,现在可以很容易地将强大的定位先验自动引入到通用应用中。

在本文中,引入了定位先验以提供增强的对抗交叉注意力泄漏的方法。引入定位先验后,本文的方法,名为定位感知反演(LocInv),涉及在每个时间步更新与对象相关的token表示,这是一种类似于动态prompt学习的技术。在分割和检测场景中,本文优化了两个损失,即相似性损失和重叠损失,以确保交叉注意力图与提供的先验密切对齐。此外,为了适应形容词描述其相关名词词的情况,本文还加入了额外的相似性损失来加强它们之间的联系。在实验中,本文对从MSCOC收集的COCO-edit数据集上的交叉注意力图的质量进行了定量评估。本文进一步将LocInv与P2P结合起来,与其他图像编辑方法进行比较。LocInv展现出优越的评估指标和改进的用户评估。此外,本文还以定性的方式展示了Word-Swap和Attribute-Edit的prompt编辑结果。

相关工作

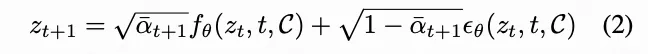

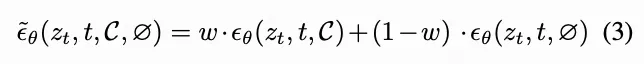

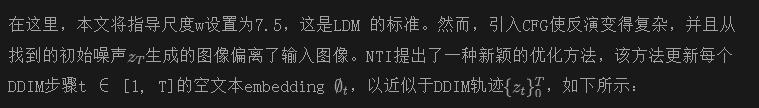

基于反演的编辑 主要依赖于DDIM反演,该方法通过确定性地计算和编码上下文信息到潜在空间中,然后使用这种潜在表示重构原始图像,在编辑任务中显示了潜力。然而,当应用无分类器指导(CFG)时,DDIM在文本引导扩散模型中被发现缺乏必要的意义编辑。利用对空文本embedding的优化,Null-Text反演(NTI)在应用CFG时进一步提高了图像重建质量,并保留了Stable Diffusion模型丰富的文本引导编辑能力。负面prompt反演(NPI)和ProxNPI在生成类似的竞争性重建结果的同时,减少了反演步骤的计算成本。直接反演通过在每个时间步调整编辑方向来进一步增强反演技术,以提供必要的内容保护和编辑保真度。IterInv 将反演泛化到DeepFloyd-IF T2I模型。

文本引导编辑 方法[3, 10, 26, 28, 29]采用了大型预训练文本到图像(T2I)模型来进行可控图像编辑。其中,Imagic和P2P通过Stable Diffusion(SD)模型尝试进行结构保持编辑。然而,Imagic 需要为每张图像微调整个模型。而P2P则无需对模型进行微调,而是通过将原始图像的交叉注意力映射分配给相应文本token中的编辑后图像来重新训练图像结构。InstructPix2Pix是对P2P的扩展,允许使用人类般的指令进行图像编辑。NTI进一步使P2P能够处理真实图像。最近,pix2pix-zero提出了噪声正则化和交叉注意力指导,以重新训练给定图像的结构。DiffEdit通过对比根据不同文本prompt条件预测而生成突出显示输入图像区域的mask。PnP证明了通过操纵T2I模型中的空间特征和自注意力映射可以保留图像结构。

还有文本引导修补方法[15, 33, 38, 45]来实现给定用户特定mask的编辑目的。例如,Blended diffusion从预先训练的无条件扩散模型中进行了调整,并使用CLIP分数鼓励输出与文本prompt对齐。混合潜在扩散(BLD)进一步扩展到了LDM。然而,修补方法主要集中在填充指定区域的任意对象,同时确保与周围区域的视觉连贯性。这些方法并不固有地保留源对象和目标对象之间的语义相似性,这是图像翻译效果所需的。

基于文本的分割和检测模型旨在在预训练后利用语言泛化特性对任意类别进行分割或检测。其中最具代表性的基于prompt的分割模型之一是SAM。给定一张图像和视觉prompt(框、点、文本或mask),SAM分别使用图像和prompt编码器对图像和promptembedding进行编码,然后将它们合并在一个轻量级的mask解码器中,以预测分割mask。类似的工作还包括CLIPSeg、OpenSeg、GroupViT等。对于基于prompt的目标检测器,GroundingDINO以将DINO检测器与语言预训练相结合,实现了开放集泛化,成为最先进的方法之一。除此之外,MaskCLIP、Xdecoder、UniDetector也提供基于prompt的检测器。通过利用这些基础模型,本文可以获取定位信息作为有价值的语义先验,以增强图像反演。这反过来又有助于整体提高图像编辑性能。

方法

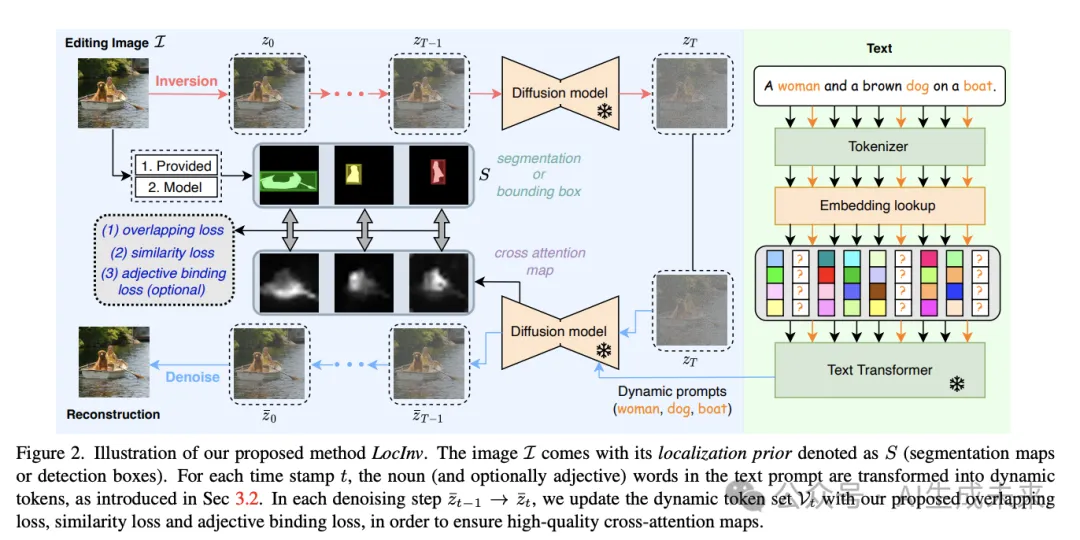

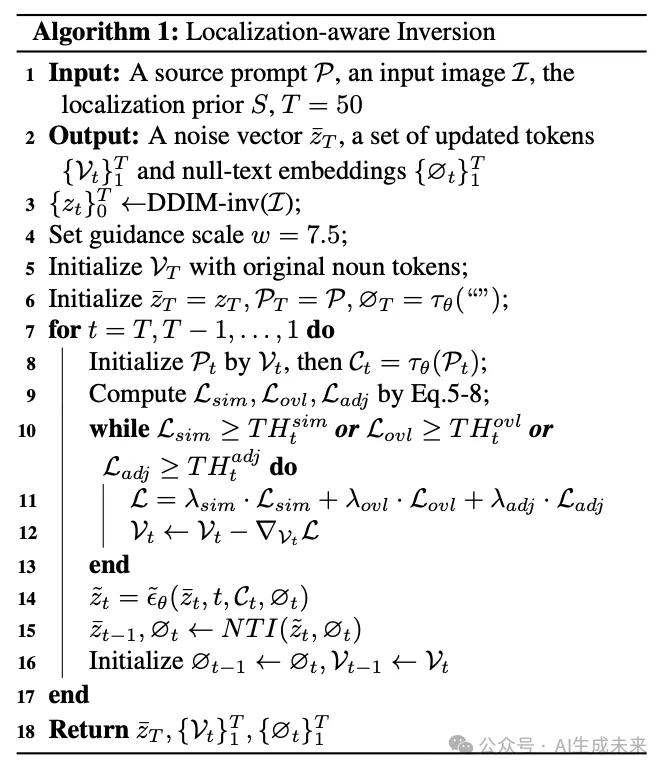

在本节中,提供LocInv的描述。本文方法的示意图如下图2所示,伪代码如下算法1所示。

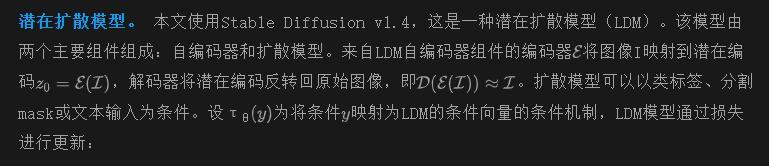

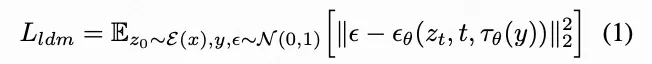

初步

动态Prompt学习

基于文本的图像编辑采用由初始prompt 描述的图像,并旨在根据用户指定的修改后prompt 对其进行修改。初始prompt用于计算交叉注意力图。正如在前文中讨论的那样,当面对复杂情景时,交叉注意力泄漏是现有基于文本的编辑方法面临的挑战。DPL引入了三种损失来增强注意力图与名词之间的对齐,这依赖于图像和prompt之间固有的连接,在现实世界的情况下并不总是可靠的。本节介绍本文的方法,称为LocInv,它利用从现有分割图(分割先验)或检测框(检测先验)派生的定位先验。这些信息可以在最近基础模型的帮助下轻松获得,并有潜力显著增强交叉注意力图的质量。为简化起见,本文统一将分割图和检测框表示为S。

LocInv: Localization-aware Inversion

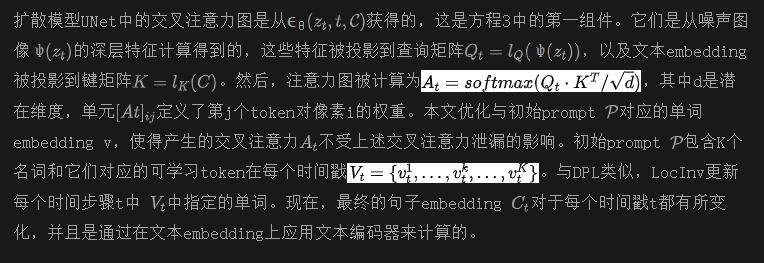

为了在每个时间步更新token表示,本文提出了几种损失来优化embedding向量Vt:本文设计了一个损失来处理交叉注意力图与其相应位置先验S之间的相似性,另一个损失则确保高度重叠。

相似性损失。 相似性定义为注意力图和位置先验之间的余弦距离。

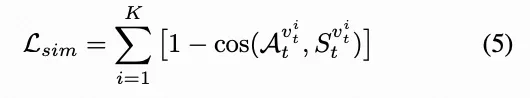

然而,本文的实验结果表明,仅使用相似性损失会导致较低的交并比(IoU)曲线。鉴于注意力图是连续函数,本文另外引入了一个重叠损失来温和地限制交叉注意力。

重叠损失。 该损失被定义为定位先验中注意力图所占比例,如下所示:

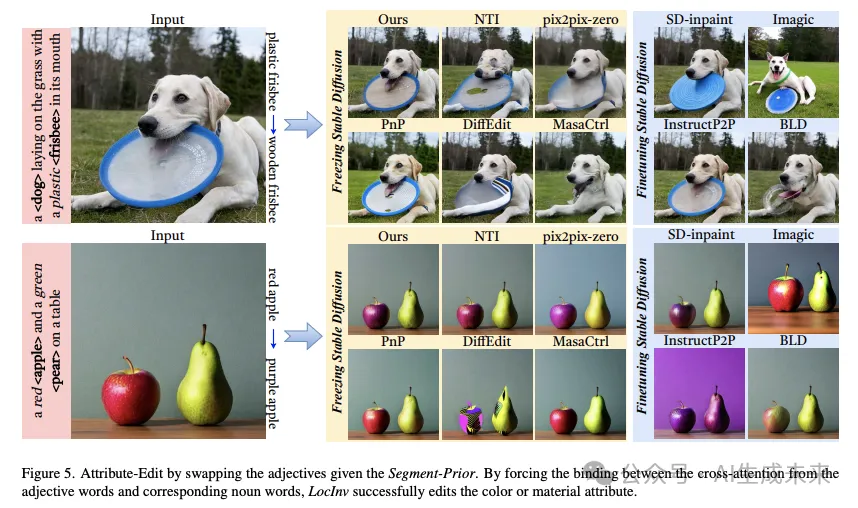

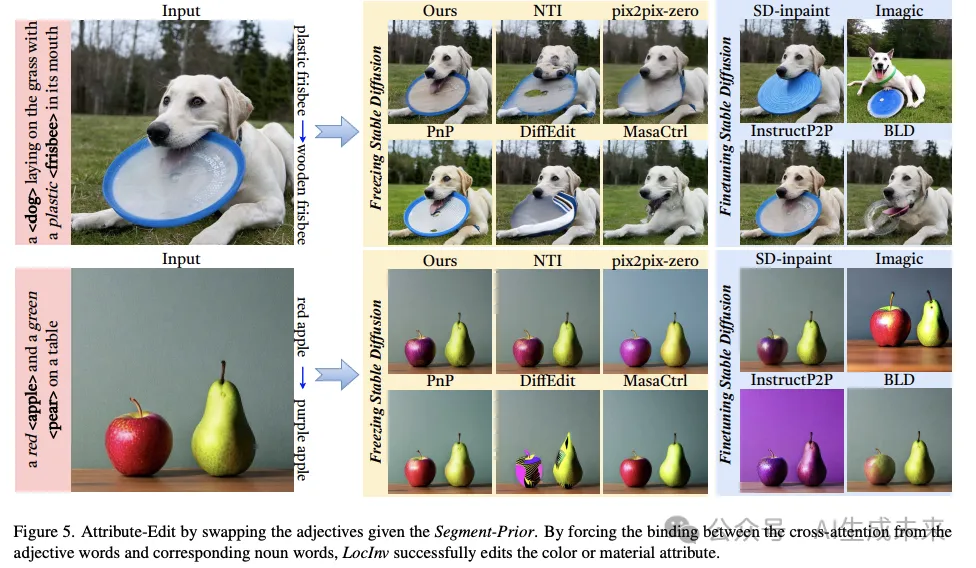

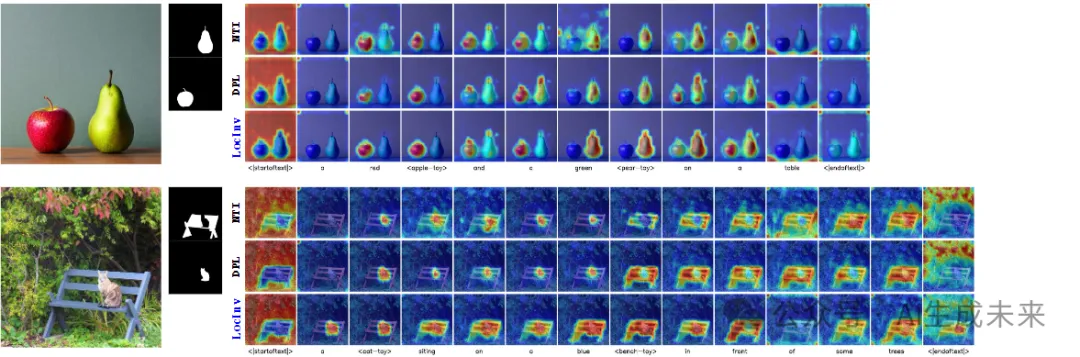

形容词结合

现有的文本引导图像编辑方法主要集中在将源对象转换为目标对象。然而,通常用户希望改变对象的外观。在文本引导图像编辑中,通常会通过改变由形容词描述的对象属性来实现这一点。然而,现有的方法在编辑源对象的属性时失败了(如下图5所示)。本文将这种情况归因于形容词和其对应名词之间的交叉注意力不一致(如上图1所示)。

实验

本文基于开源的Stable Diffusion 进行了各种实验来展示LocInv,这是根据以前的方法 [37, 39, 52] 进行的。所有实验都在R6000 GPU上完成。

数据集。 为了对超参数进行定量消融研究,并部分用于定性编辑比较,本文从MS-COCO数据集 [30] 中选择了315张图像作为COCO-edit的子集。本文从各种搜索prompt(包括飞机、苹果、香蕉、熊、长椅等概念)中构建了这个子集,并存储了用于实验的地面真实分割/检测图像。总体上,有7个带有单个对象(名词)的搜索prompt,以及6个带有多个对象的prompt。更详细的信息请参见原文附录资料。

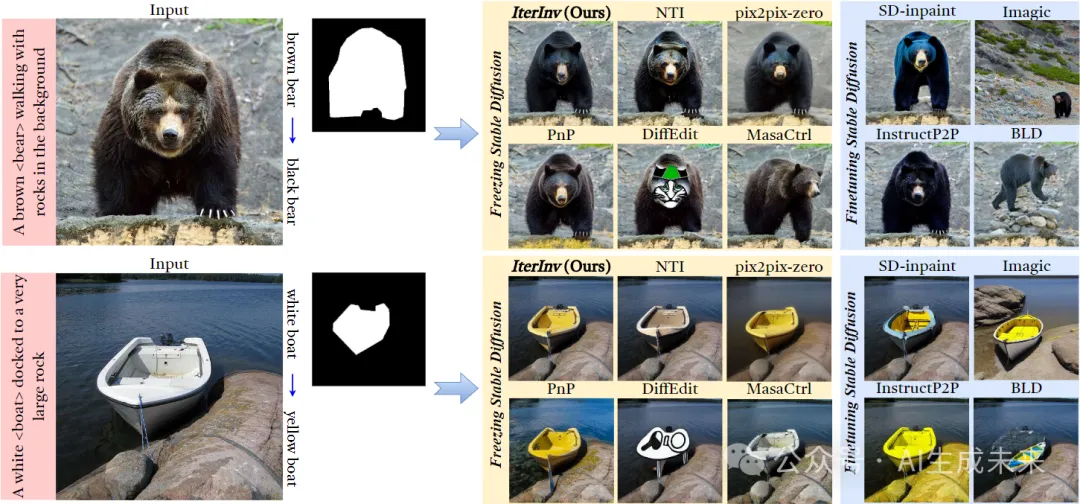

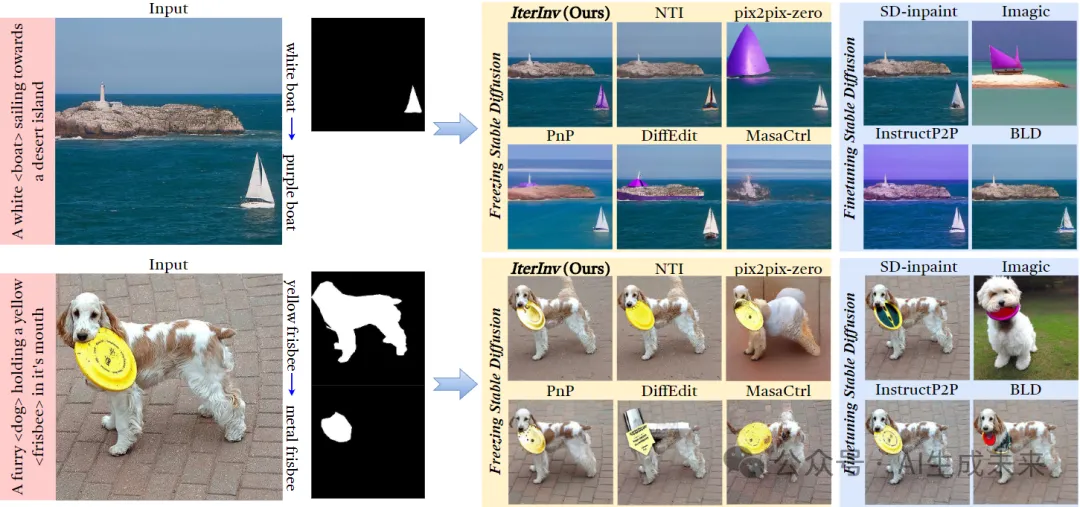

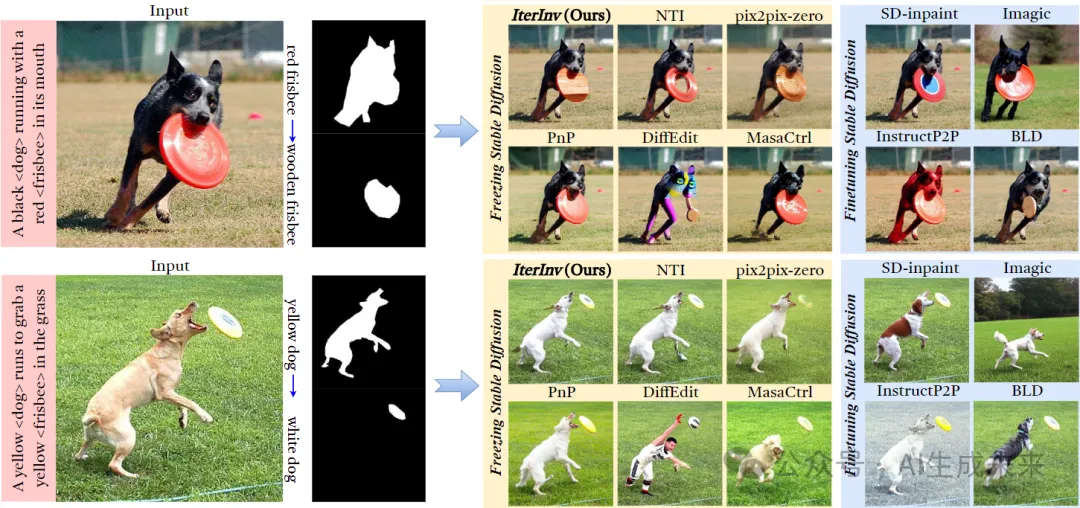

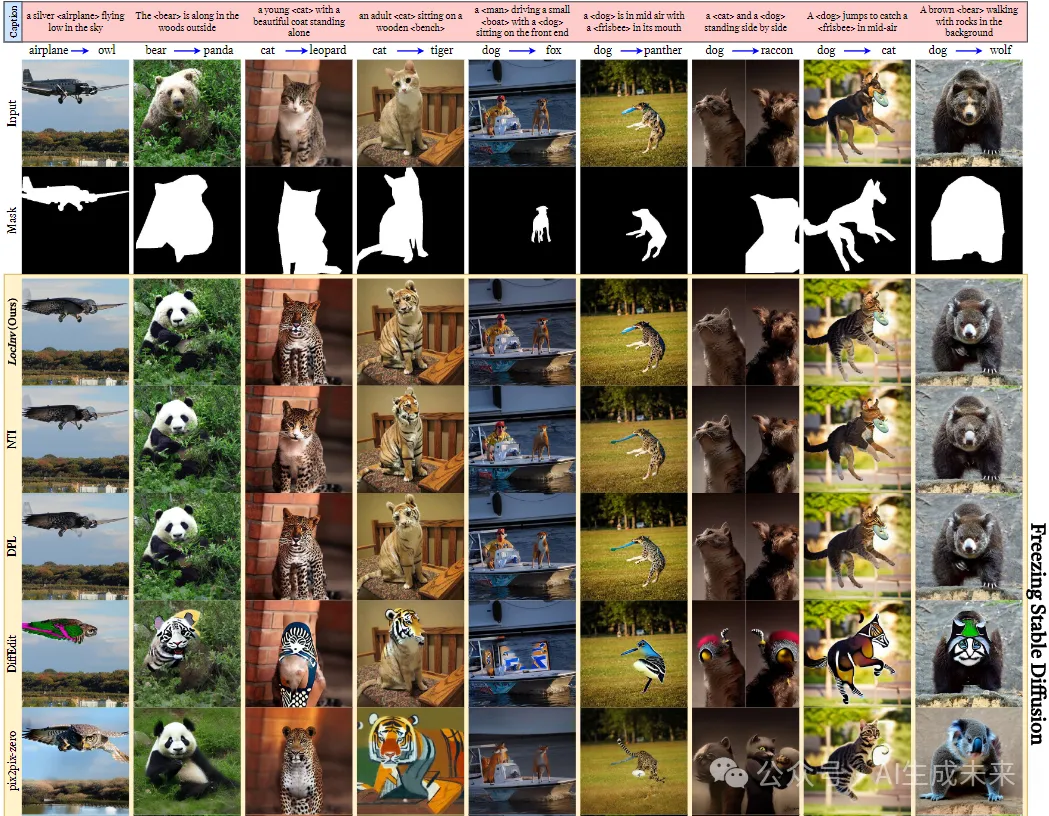

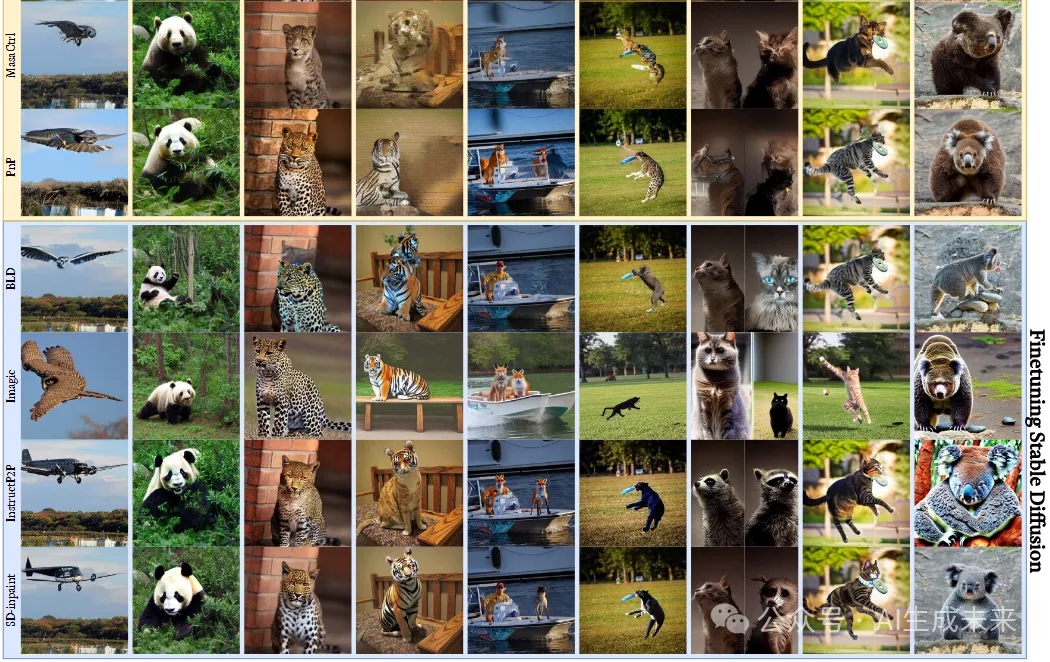

比较方法。 本文组织了两组方法进行定性和定量比较。第一组方法是冻结Stable Diffusion模型,包括NTI、DPL、pix2pix-zero、PnP、DiffEdit 和 MasaCtrl。第二组方法是对大型预训练的T2I模型进行微调,作为特定的图像编辑模型,例如SD-inpaint、InstructPix2Pix和 Imagic,或者将mask视为涂鸦位置进行修复,包括SD-inpaint和 BLD。

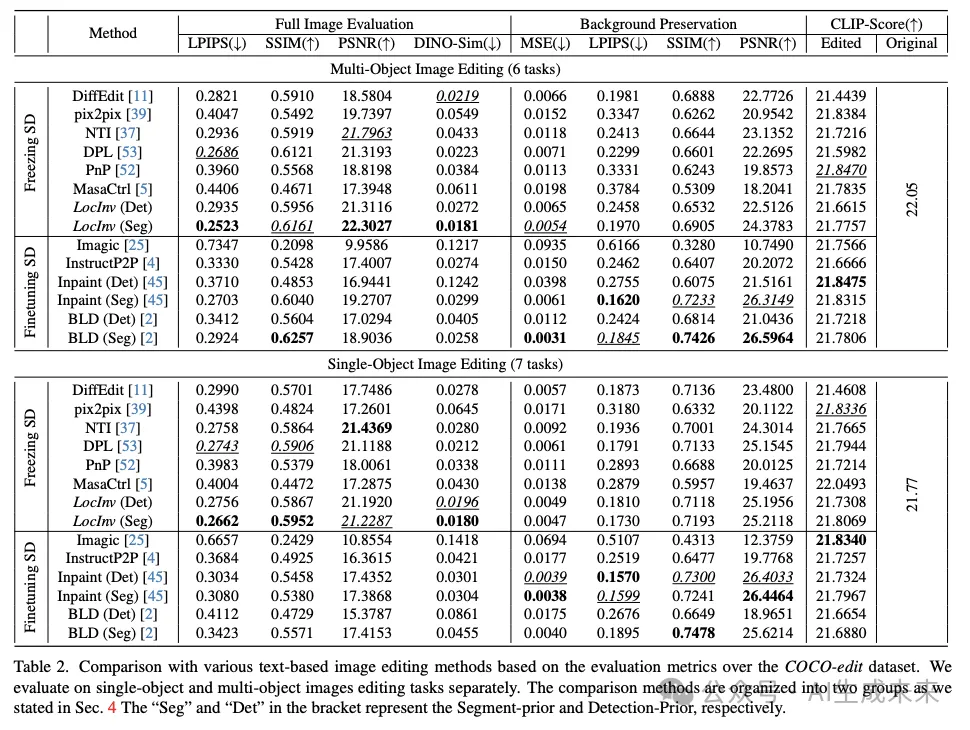

评估指标。 为了定量评估方法的性能,本文采用了一些成熟的度量标准,包括 LPIPS、SSIM、PSNR、CLIP-Score和 DINO-Sim,来评估编辑后的完整图像。此外,为了说明背景保留的质量,本文按照 DirectInversion的方法计算了 LPIPS、SSIM、PSNR 和 MSE 指标,用于mask外的区域。

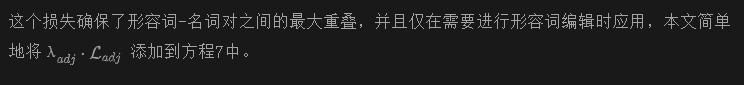

消融实验

对于消融研究,本文在COCO-edit数据集上进行实验。为了定量评估LocInv的定位性能,本文将阈值从0.0变化到1.0,从交叉注意力图中获取分割mask。然后,本文使用分割真值计算交并比(IoU)指标进行比较。本文的方法可以同时使用分割图和检测边界框作为定位先验。在这里,本文考虑了这两种情况的超参数。

在下图3中,本文对相似性损失和重叠损失进行消融研究。从图 3-(c)(g) 可以看出,仅应用其中一种损失并不能确保令人满意的性能。在经验上,本文发现分割和检测先验的最佳超参数为 对于形容词绑定损失,由于缺乏足够的图像-文本对进行消融研究,本文经验性地将超参数设置为 。本文中的所有结果均使用这些超参数设置生成。

图像编辑评估

对于图像编辑,将LocInv与P2P图像编辑方法结合起来。在本文中,主要关注包括词语交换和属性编辑在内的定位编辑任务。

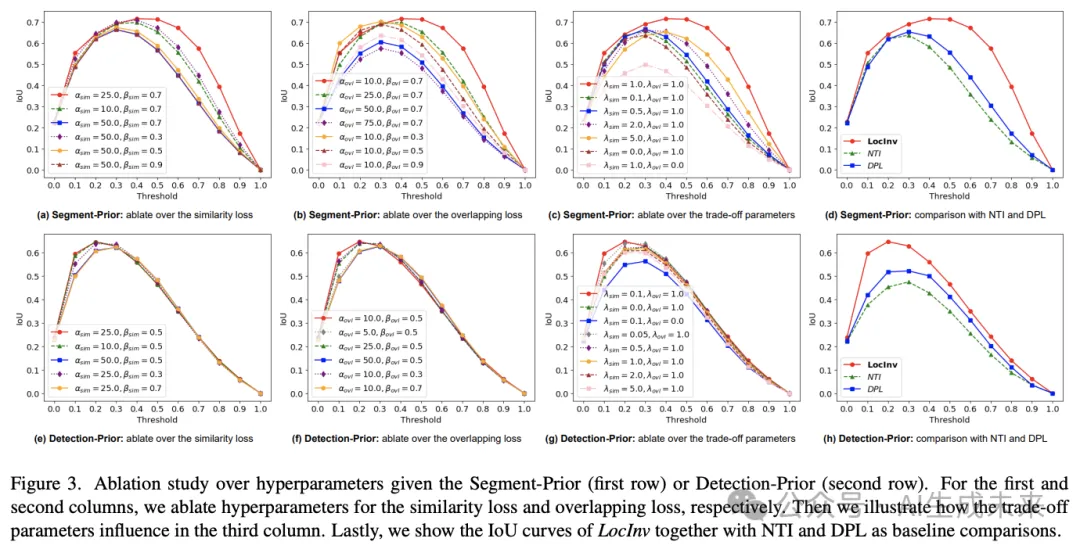

词语交换。如下图4所示,本文通过使用分割图作为定位先验,比较了LocInv与各种方法在原始图像中交换一个对象的效果。本文的方法LocInv更成功地将源对象转换为目标对象,并保持语义相似性。

在下表2中,针对COCOEdit数据集中每组图像设计了一个编辑任务(详细信息请参见原文补充材料)。在单个对象和多个对象的编辑任务中,LocInv在完整图像评估方面表现更好,并且仅在背景保留方面(因为这些方法不会更改背景像素)比涂鸦方法[2, 45]差一些。值得注意的是,LocInv不需要对基本模型进行微调,从而具有更好的时间复杂度,并且在T2I模型中没有遗忘。

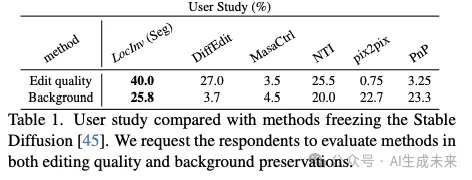

在下表1中,询问了二十位参与者从编辑质量和背景保留两个方面评估图像编辑性能。在两种情况下,LocInv都优于这六种冻结SD模型的方法。用户研究的详细信息请参见补充材料。

属性编辑。 此外,LocInv在另一个编辑方面表现突出,即其他方法往往忽视的属性编辑。这种能力在下图5中有所体现。

通过强制形容词词语与其对应的名词对象进行绑定,本文实现了准确修改它们的属性(颜色、材质等)的能力。

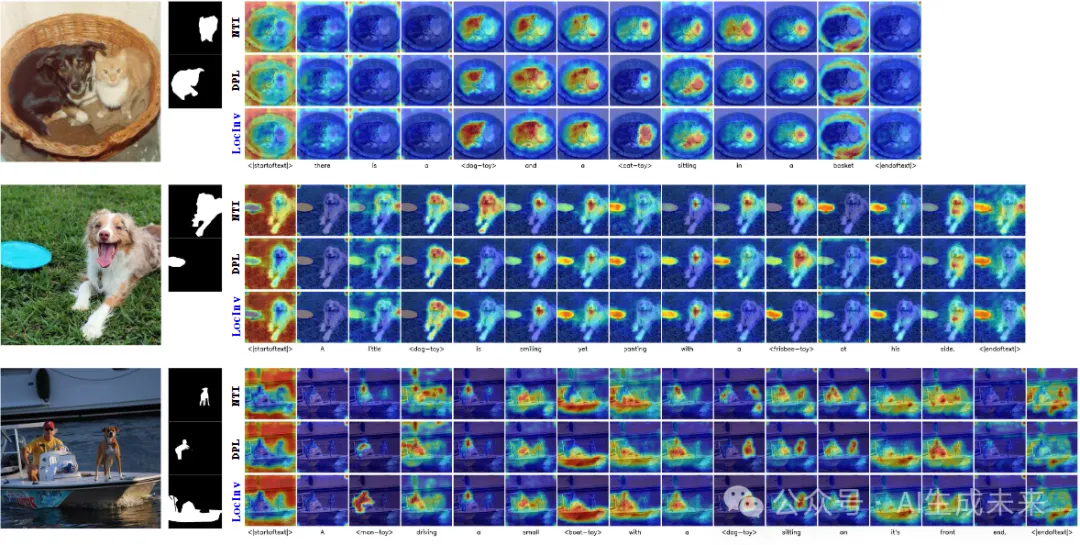

与以前的方法(包括NTI、DDIM和DPL)相比

我们的方法显著改进了交叉注意力图

结论

本文提出了基于定位感知的反演(LocInv)来解决使用文本到图像扩散模型进行图像编辑时的交叉注意力泄漏问题。本文建议使用分割或检测作为先验来更新prompt中每个名词词语的动态token。由此产生的交叉注意力图对交叉注意力泄漏的影响较小。因此,这些大大改进的交叉注意力图导致了文本引导图像编辑的显着改进结果。实验结果证实,LocInv在复杂的多对象场景中取得了优异的结果。最后,展示了本文的方法还可以将形容词词语绑定到它们对应的名词,从而为形容词生成准确的交叉注意力图,并允许属性编辑,这在以前的文本引导图像编辑中尚未得到很好的探索。

本文转自 Chuanming Tang等 ,作者:AI生成未来