聊一聊生成式视角下的实体对齐

引言

基于知识图谱嵌入的方法在实体对齐领域取得了巨大成功。本文以生成模型的视角重新解构了目前实体对齐方法的范式,展示了其与生成模型间的相似之处,并从理论上揭示了现有的基于生成对抗网络的方法的局限性。通过引入新的互变分自编码器(Mutual-VAE)作为生成模型,本文构建了一个生成式实体对齐框架(GEEA)。GEEA实现了知识图谱之间的实体转换,并且能够从随机噪声中生成新的实体。通过理论分析、实体对齐实验,以及实体合成实验等,系统地展示了生成模型在实体对齐及实体合成任务上的强大能力。

背景

实体对齐的结果往往被用于丰富不同的知识图谱,但不同的知识图谱中通常存在一些目标知识图谱中没有的实体,这些实体被称为“悬挂实体(dangling entity)”。如果可以将这些实体从源知识图谱转换到目标知识图谱,将在许多任务中节省大量时间和精力。

从随机变量生成新实体可以应用到多个新兴领域,如元宇宙、游戏、剧本设计等。在这些领域中虚拟角色仍依赖于手工编写或随机算法,而丰富、相互联系的角色对构建沉浸式虚拟世界至关重要。这些内容可以利用知识图谱来存储,并通过实体合成生成新的具有丰富关系的角色信息。

方法

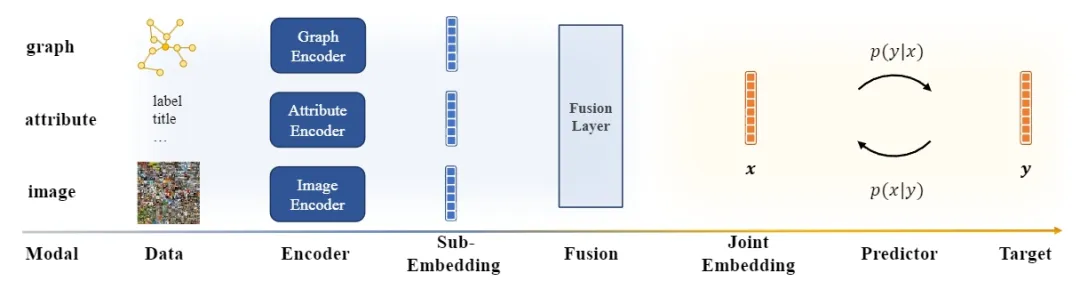

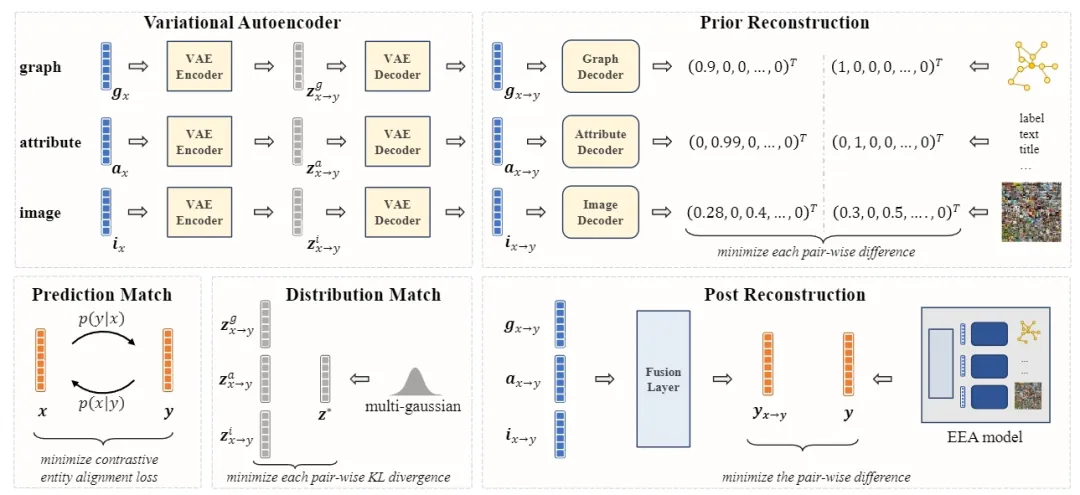

如下图所示,本文设计的生成式实体对齐框架可分为5个模块:

- 变分自编码器利用不同的变分自编码器可分别将不同模态的信息编码到预设的正态空间,再通过对应的解码器将其重新解释为输入向量。通过采用适当的损失函数,该变分自编码器模块可学习到生成随机样本的能力。

- 重构先验信息变分自编码器所输入输出的信息均为嵌入向量,与原始的图结构信息等并不一致。因此框架中还包含一个先验重构层,其目标是将不同模态的嵌入重新转换为原始的输入特征。

- 知识融合对于不同模态的输入嵌入可通过融合层得到一个归一化的嵌入,这样就可以利用对应的损失函数来最小化多模态、不同源的知识间的差异,使得模块学习到知识融合的能力。

- 分布对齐值得注意的是,在第1步中,被变分自编码器所编码后的输出可以通过训练使其服从于正态分布,这样便可在生成阶段从正态分布中采样再经过解码层获得输出向量,之后通过第2步重构其先验特征。

- 重构后验信息由于所涉及到多种知识表示,必须保证变分自编码器所生成的不同模态的输出能够互洽。通过将生成的不同模态的输出向量重新输入至第3步中的融合层,便可得到一个重构后的融合向量,这样就可以对比其与原有向量间的差异来评估自洽性。

实验

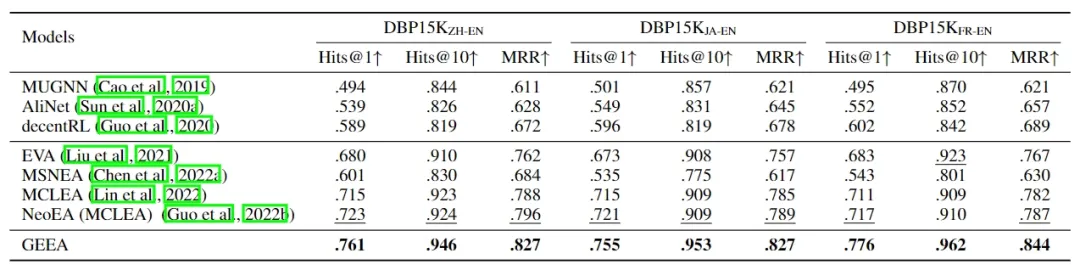

如下图所示,在多个实体对齐数据集上,引入了生成目标的GEEA显著优于其他方法。

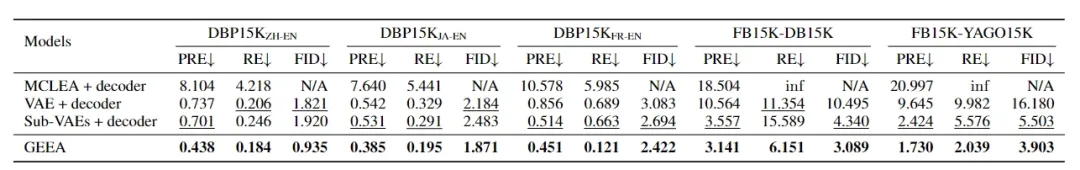

同时,在实体合成结果上,本文所提出的GEEA也要优于一些生成模型或是生成模型与实体对齐模型的结合:

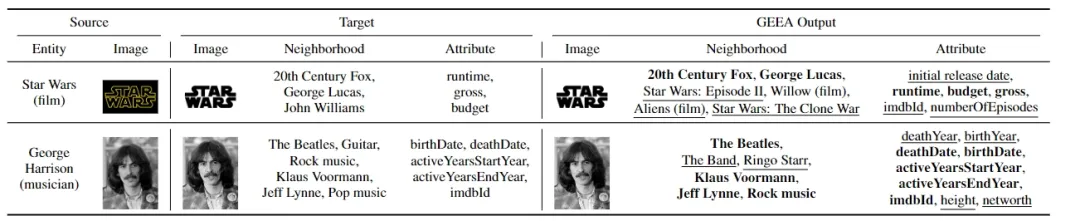

下表展示了一些实体合成的结果,其中输入的源知识图谱实体在目标知识图谱中并不存在。可以看出,GEEA所生成的属性和邻居甚至包含了一些原本知识图谱中并不存在但正确的内容。对于图片信息,由于目前方法均采用预训练的图片向量而非引入视觉模型的缘故,在GEEA中直接取距离最近的目标知识图谱图片作为输出。

总结

本文对如何利用生成模型进行实体对齐与实体合成进行了理论分析,并提出GEEA来解决现有基于生成模型方法的局限性。实验证明,GEEA在实体对齐和实体合成任务均较现有方法有着显著优势。未来工作将专注于设计新的多模态编解码器以进一步增强模型的生成能力。

本文转载自:ZJUKG

作者:郭凌冰