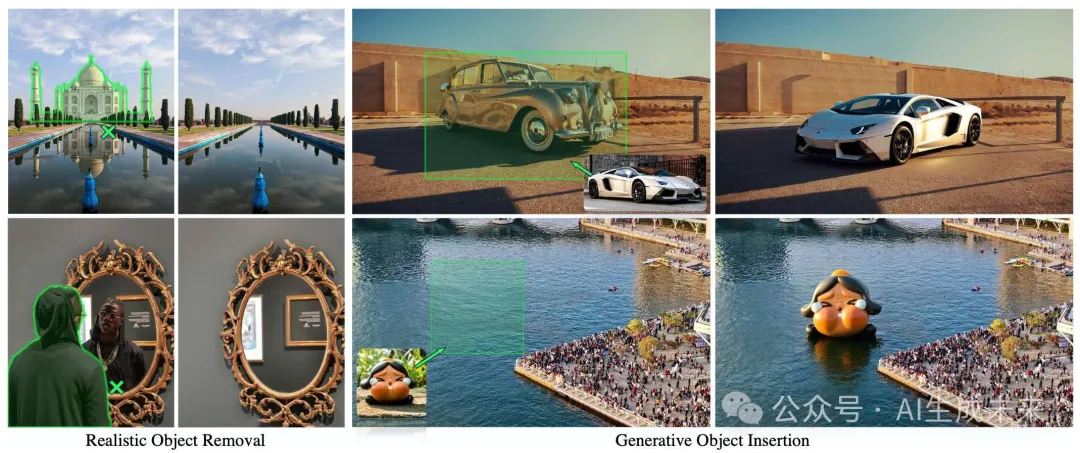

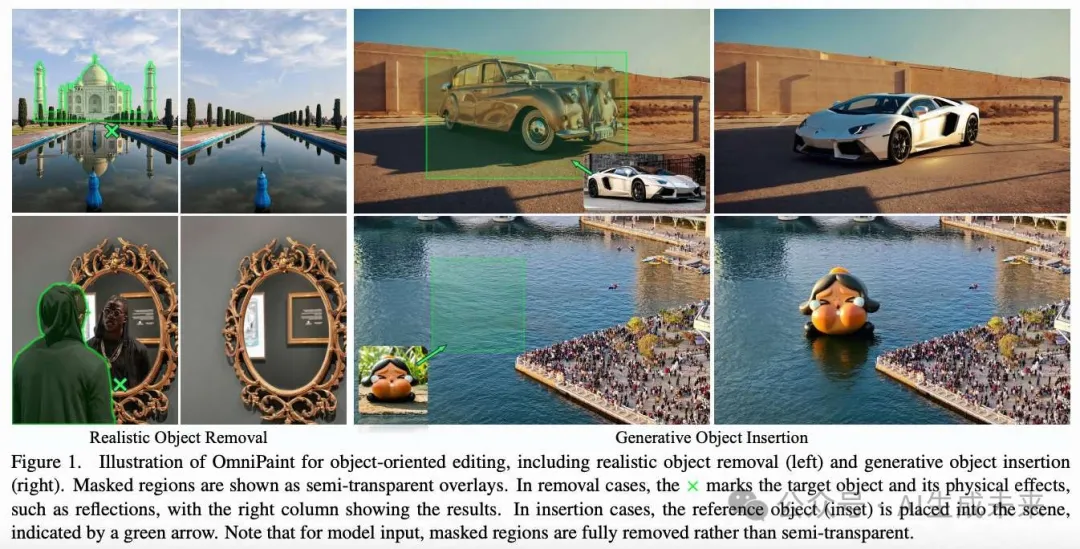

"一键消除"与"无缝融入"超丝滑!CycleFlow+扩散先验让OmniPaint引领图像编辑新时代

论文链接:https://arxiv.org/pdf/2503.08677

项目链接:https://www.yongshengyu.com/OmniPaint-Page/

git链接:https://github.com/yeates/OmniPaint

亮点直击

- 提出了一种基于扩散的解决方案,用于在对象移除和插入时实现物理和几何一致性,包括阴影和反射等物理效果。

- 引入了一种渐进的训练流程,其中提出的CycleFlow技术支持无配对的后期训练,减少了对配对数据的依赖。

- 进一步开发了一种新颖的无参考指标,称为CFD,用于通过幻觉检测和上下文一致性评估来衡量对象移除的质量。

总结速览

解决的问题

基于扩散的生成模型在实现逼真的对象移除和插入时面临挑战,主要包括物理效果(如阴影和反射)的复杂相互作用以及配对训练数据的不足。

提出的方案

引入 OmniPaint,一个统一的框架,将对象移除和插入重新概念化为相互依赖的过程,而不是孤立的任务。

应用的技术

- 利用预训练的扩散先验。

- 实施渐进的训练流程,包括初始配对样本优化。

- 通过 CycleFlow 技术进行大规模无配对细化,支持无配对的后期训练。

- 开发一种新颖的无参考指标 CFD,用于评估对象移除质量。

达到的效果

- 实现了精确的前景消除和无缝的对象插入。

- 保留了场景的几何和内在属性。

- 提供了物理和几何一致性,包括阴影和反射。

- 建立了高保真图像编辑的新基准。

方法

OmniPaint 框架

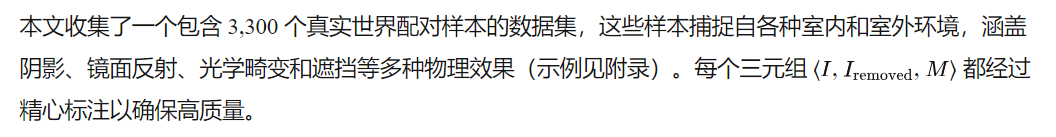

数据收集和掩码增强

为了增强模型对各种掩码变化的鲁棒性,对对象移除和插入应用了不同的增强策略。对于移除,通过形态学变换引入分割噪声,随机应用具有可配置参数的膨胀或腐蚀。通过扰动边界并添加或删除几何形状(如圆形、矩形)来模拟不精确的掩码。附录中提供了增强示例和效果分析。对于对象插入,由于不需要显式的对象检测,我通过扩展分割掩码到其边界框或凸包来简化掩码增强,以确保适应各种参考对象格式。参考对象图像增强遵循先前的工作[34]。

训练流程

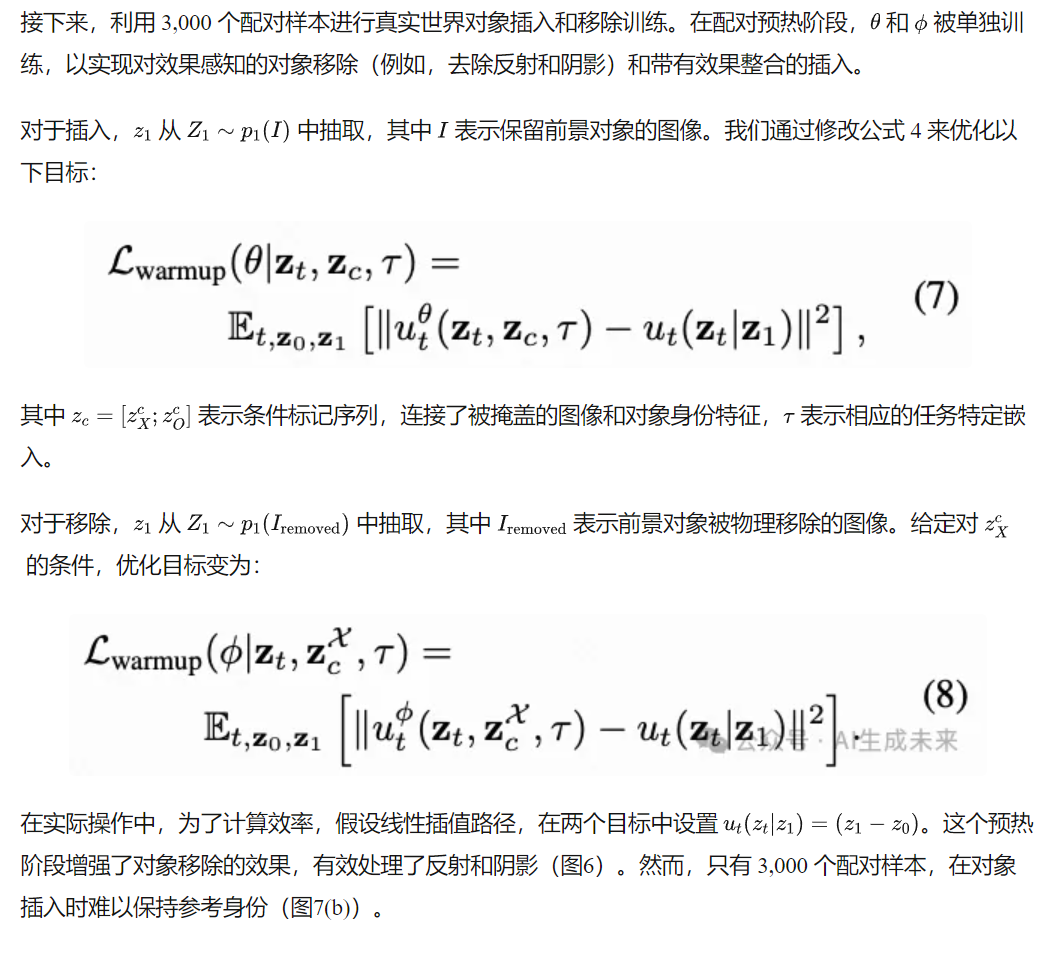

本文的实验中,观察到当前的训练数据不足以维持对象插入的参考身份,如下图 7(b) 和附录表 A 所示。通过训练模型引导配对数据,类似于 ObjectDrop,是一个简单的解决方案,但需要一个可靠的过滤机制,这仍然是一个开放的挑战。

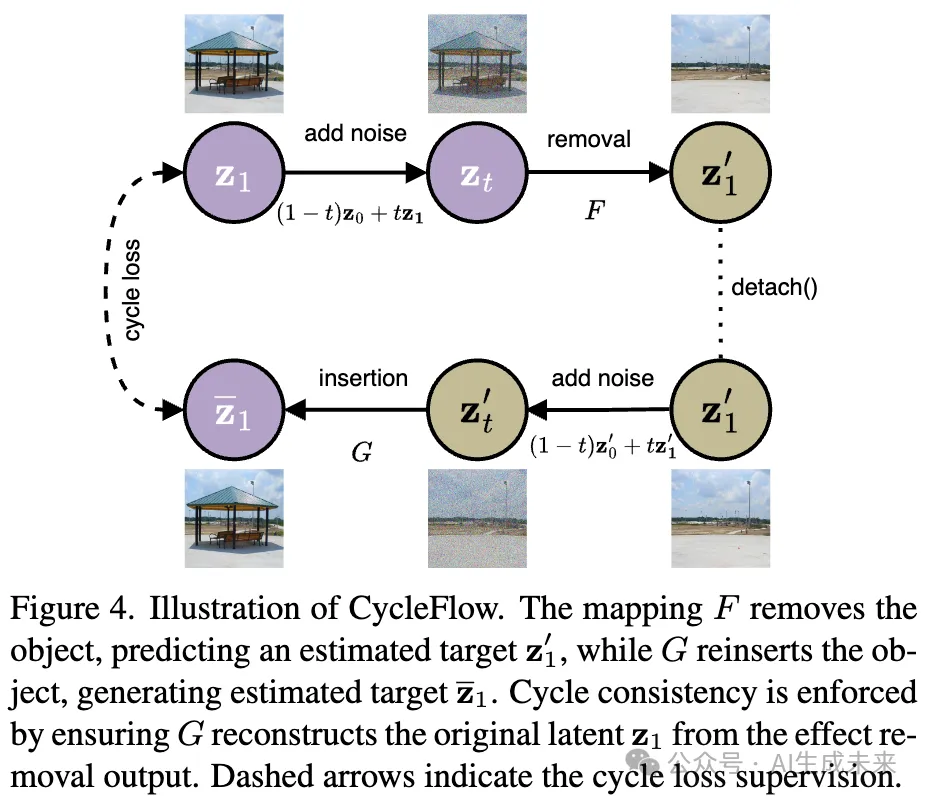

幸运的是,对象插入和对象移除在数学上是互补的逆问题(即,每个问题可以被视为反转另一个问题)。受循环一致性方法 [45, 57] 的启发,本文提出利用未配对数据,而不是依赖配对增强。特别是,我们利用大规模对象分割数据集,这些数据集缺乏显式的移除对,以增强对象插入。本文介绍了我们的三阶段训练流程:(1)修复前置训练,(2)配对预热,(3)CycleFlow 未配对后期训练。

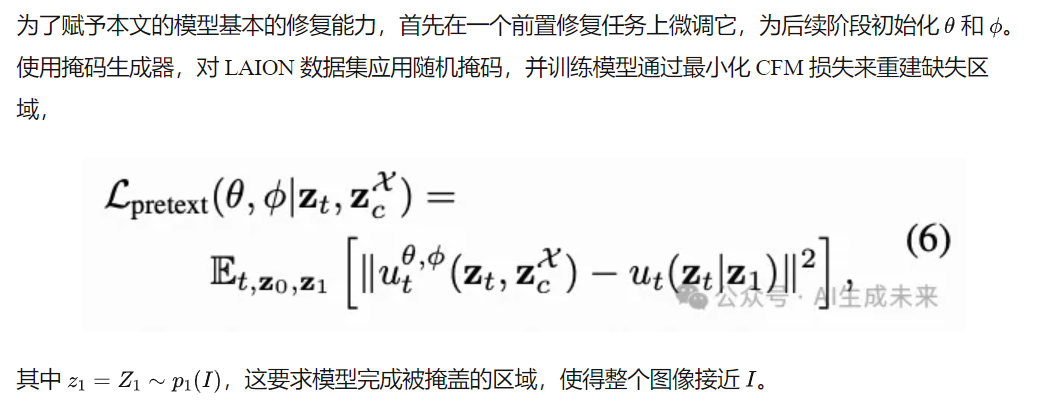

修复前置训练

配对预热

CycleFlow 无配对后期训练

为了加强这种循环一致性,我们定义了一个循环损失:

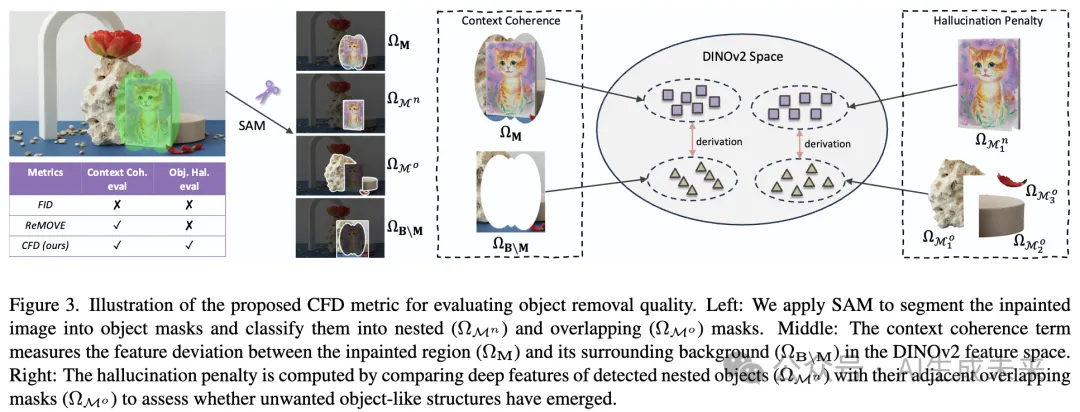

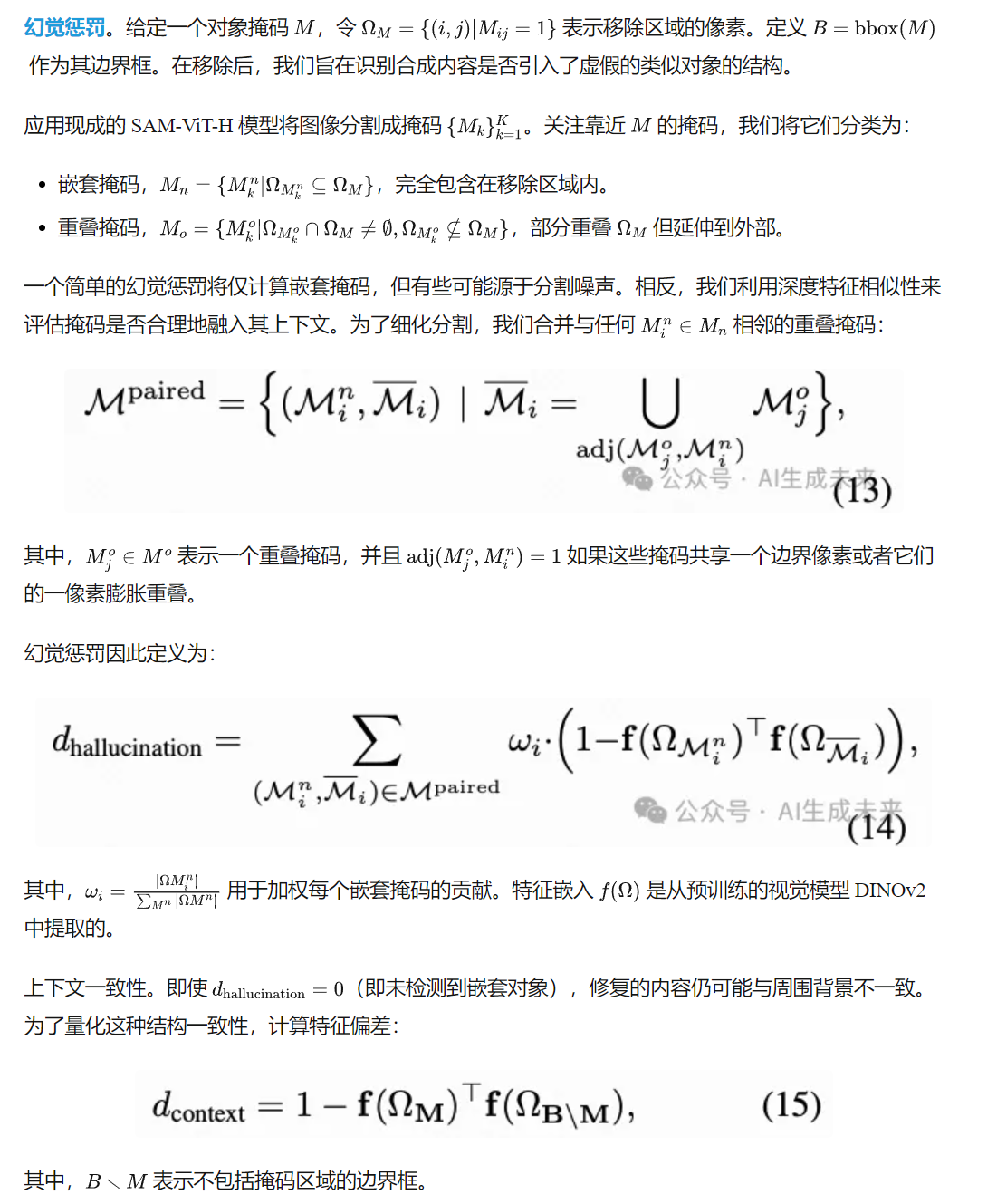

上下文感知特征偏差 (CFD) 评分

引入上下文感知特征偏差 (CFD) 评分,以定量评估对象移除性能。如下图 3 所示,CFD 包含两个组成部分:一个幻觉惩罚项,用于检测和惩罚在移除区域中出现的不需要的类似对象的结构,以及一个上下文一致性项,用于评估修复区域与周围背景的融合程度。

最终 CFD 指标。最终的 CFD 分数计算为:

较低的 CFD 表示更好的移除质量——即幻觉最小化和无缝的上下文融合。

实验

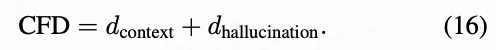

CFD 分析

通过定性分析,以确定本文的 CFD 得分是否有效捕捉上下文连贯性和幻觉伪影,从而相比现有指标(如 ReMOVE),提供更可靠的对象移除质量评估。如下图 2 所示,FLUX-Inpainting] 会生成明显的幻觉——如船只、人形或漂浮的罐子等虚幻对象——但仍能获得较高的 ReMOVE 得分。相比之下,CFD 通过使用 SAM 分割修复区域,并检查嵌套和重叠掩码内的特征级差异,有效地惩罚这些幻觉。同样,虽然 LaMa 在掩码区域内插值背景纹理,但其有限的生成先验常常由于对象效果检测不足而导致幽灵般的伪影。相反,OmniPaint 通过完全消除目标对象而不引入不必要的伪影,表现出更高的移除保真度,这在其显著较低的 CFD 得分中得以体现。

通过同时量化不必要对象的出现和上下文对齐,CFD 与人类视觉感知高度一致。这些发现证实了 CFD 是一种稳健的评估指标,有助于确保对象移除不仅实现无缝融合,还能最大限度地减少错误内容幻觉。

实验设置

在对象移除方面,与端到端修复模型 MAT 和 LaMa、基于扩散的 SDInpaint 以及 FLUX-Inpainting 进行对比,以确保公平的骨干对比。此外,我们还包括最近的开源对象移除方法 CLIPAway、PowerPaint 和 FreeCompose。实验在两个基准上进行:我们捕获的300个真实世界对象移除案例的测试集,调整为512X512进行测试,以及 RORD数据集,包含1000对原始540X960分辨率的样本,均提供物理移除对象的真实数据。我们报告 PSNR、SSIM、感知相似性指标(FID、CMMD、LPIPS)以及对象移除特定指标,包括 ReMOVE 和我们的 CFD 得分。

在对象插入方面,与 Paint-by-Example (PbE)、ObjectStitch、FreeCompose、AnyDoor和 IMPRINT进行对比。由于 ObjectStitch 和 IMPRINT 没有公开实现,我们从作者处获取官方代码、检查点和测试集。我们的插入基准由565个512X512分辨率的样本组成,将 IMPRINT 测试集与我们捕获的真实世界案例结合。每个样本包括一张背景图像、一张参考对象图像和一个二值掩码。参考图像通过 CarveKit进行背景移除预处理。为了评估身份一致性,使用 CUTE、CLIP-I、DINOv2和 DreamSim 测量插入对象与其参考对象之间的特征相似性,后者更符合人类感知。除了局部身份保留外,还使用无参考指标 MUSIQ 和 MANIQA 评估整体图像质量。

为确保公平,在所有基线中应用相同的图像-掩码对,并使用官方实现及其默认超参数,如推理步骤数。对于 OmniPaint,在推理过程中使用 Euler Discrete Scheduler,并将推理步骤数设置为28,以进行主要的定量和定性实验。附加实现细节在附录中提供。

对象移除性能评估

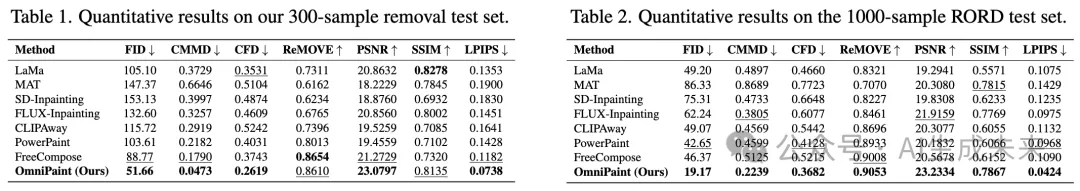

对 OmniPaint 在真实对象移除中的表现进行了评估,并与修复和对象移除方法进行了比较。如下表 1 和表 2 所示,OmniPaint 在所有数据集上始终优于之前的方法,获得了最低的 FID、CMMD、LPIPS 和 CFD,同时保持了较高的 PSNR、SSIM 和 ReMOVE 得分。这些结果突显了其在移除对象的同时保持结构和感知保真度的能力,有效抑制了对象幻觉。

下图 6 展示了在具有挑战性的真实案例中的视觉比较。在第一行中,OmniPaint 成功移除了对象及其玻璃反射,而所有基线方法均未能做到。第二行强调了 OmniPaint 在自然光照下消除阴影的能力,而其他方法则留下了残余伪影。第三行展示了在遮挡场景中的强大修复能力,确保无失真的无缝背景重建。通过有效处理反射、阴影和遮挡,OmniPaint 在生成连贯且真实的对象移除结果方面超越了之前的方法。

对象插入性能评估

对 OmniPaint 在对象插入方面的表现进行了评估,并与先进方法进行了比较。如表 3 所示,OmniPaint 在所有对象身份保留指标上均获得最高分,包括 CLIP-I、DINOv2、CUTE和 DreamSim,显示出其与参考对象的优越对齐。此外,在整体图像质量上也优于所有基线方法,MUSIQ 和 MANIQA的测量结果表明其具有更好的感知真实感和无缝集成。

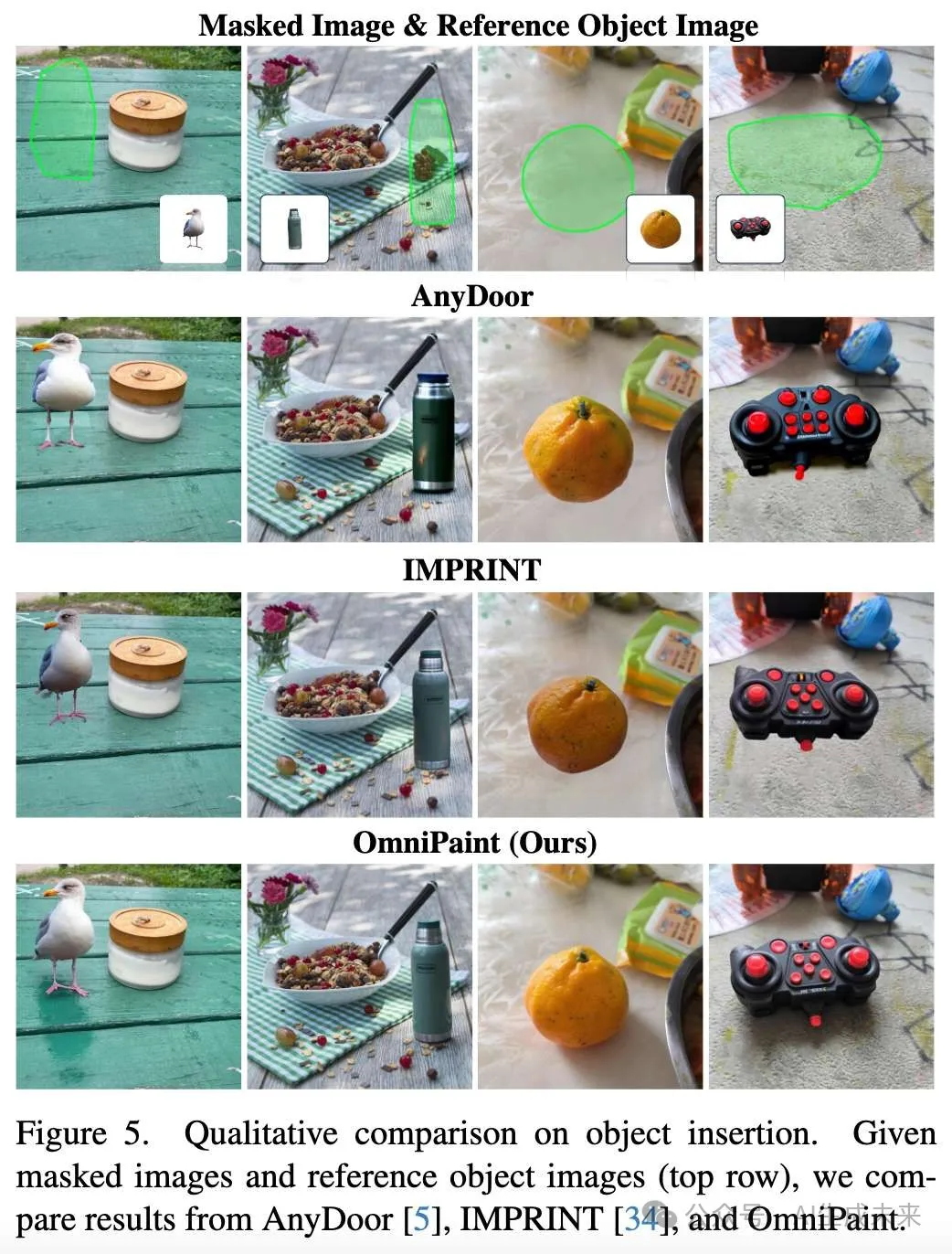

下图 5 展示了视觉比较。给定一个掩码输入和一个参考对象,OmniPaint 生成的插入对象在形状、纹理和光照一致性方面更为准确。相比之下,其他方法在身份失真、错误阴影或明显的融合伪影方面存在困难。值得注意的是,OmniPaint 在确保插入对象自然地与场景几何和光照对齐的同时,保留了细节。通过保持高保真度的身份保留和提升感知质量,OmniPaint 为真实对象插入设立了新的标准。

超参数分析

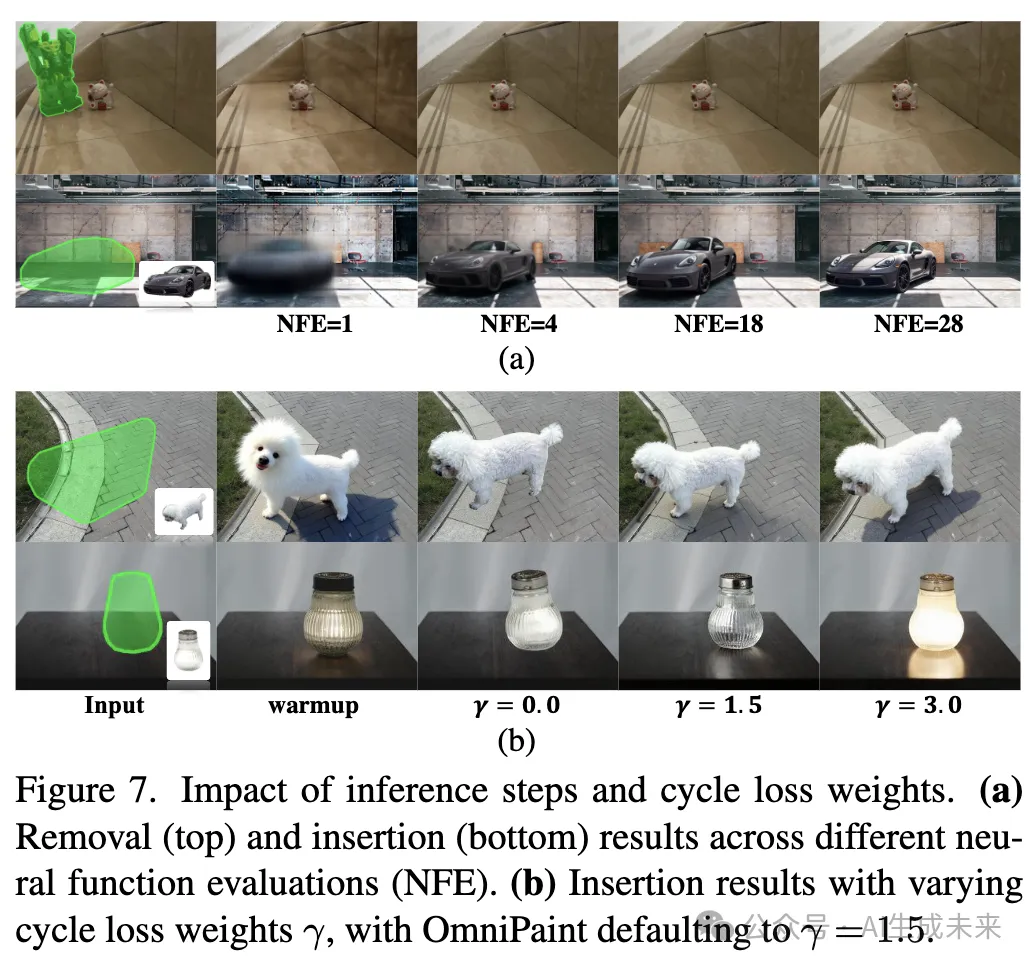

神经函数评估。分析了神经函数评估(NFE)对对象移除和插入的影响,如图 7(a) 所示。较低的 NFE 值,如 1 或 4,会导致明显的模糊,尤其是在掩码区域内。有趣的是,对于移除任务,即使 NFE=1 也能有效消除对象及其相关效果。在 NFE=18 时,对象被干净地移除,没有残留伪影,而插入的对象表现出高保真度和真实的阴影与反射。进一步增加 NFE 到 28 仅带来微小的收益,表明收益递减。尽管如此,将 NFE=28 设为默认值,以确保最佳的视觉质量。

结论

本文提出了用于面向对象图像编辑的OmniPaint,将对象移除和插入重新概念化为相互依赖的任务。通过利用预训练的扩散先验和由初始配对样本优化及后续通过 CycleFlow 进行的大规模无配对精细化组成的渐进训练流程,OmniPaint 实现了精确的前景消除和无缝的对象集成,同时保留了场景几何和其他内在属性。大量实验表明,OmniPaint 有效地抑制了对象幻觉并减轻了伪影,新颖的 CFD 指标提供了对上下文一致性的稳健、无参考评估。

本文转自AI生成未来 ,作者:AI生成未来