32B逆袭671BDeepSeek R1!阿里推理模型炸翻了:小到笔记本就能run,成本仅1/10!又是强化学习带来惊喜! 原创

编辑 | 伊风

出品 | 51CTO技术栈(微信号:blog51cto)

太震撼了。阿里直接扔了一张王炸!

QwQ-32B,一个参数量如此小的小模型,居然追平了671B的DeepSeek-R1??!

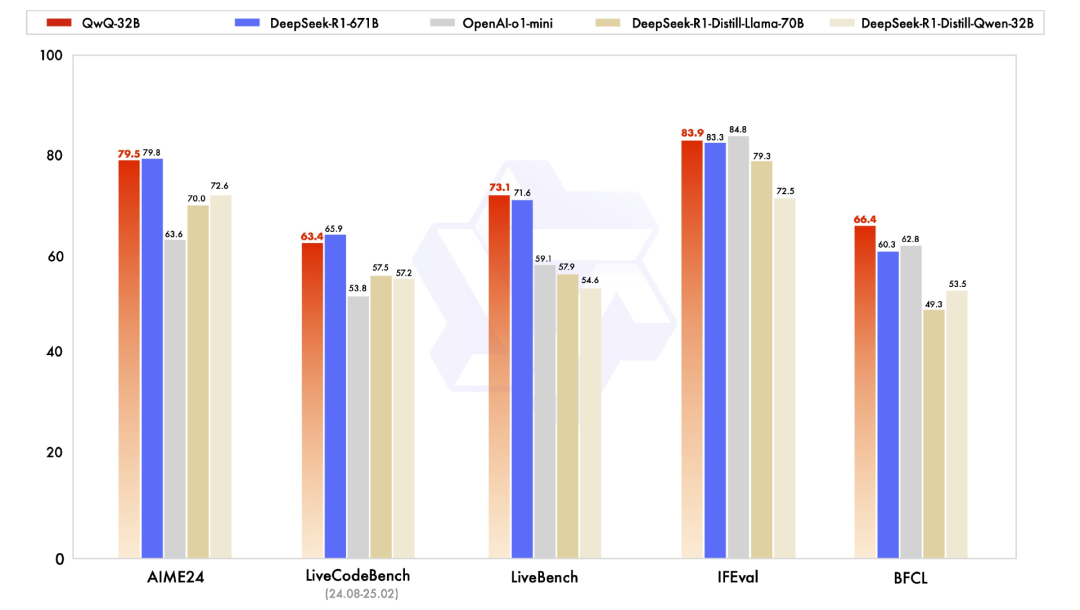

这也太卷了,看看他们给的数据,真的给人看麻了:

图片

图片

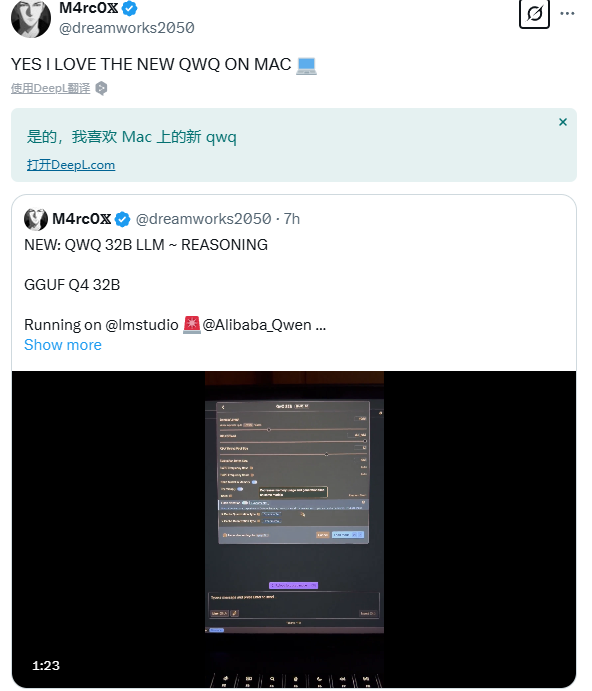

这个模型到底小到什么概念呢?评论区网友在用了一台配置M4 Max芯片的苹果电脑就跑起来了。

网友本人直呼震撼的程度!

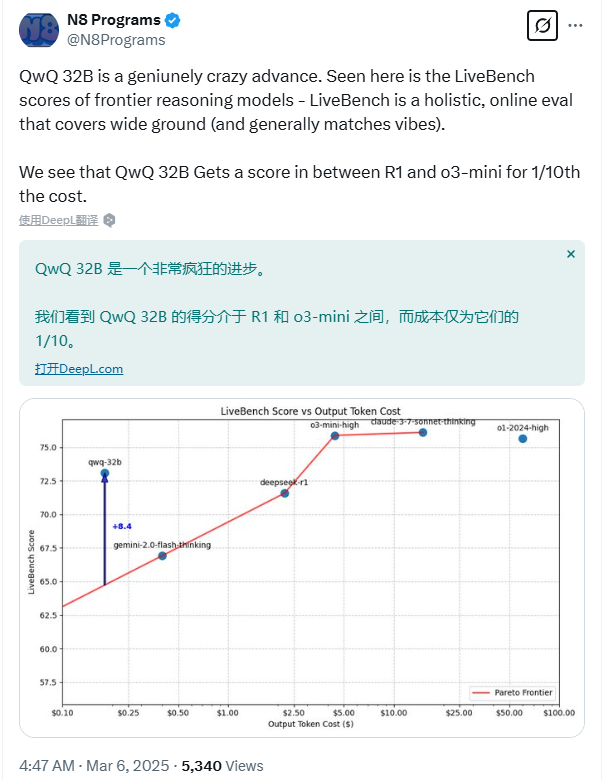

小模型还有个震撼而实用的优点,价格真的低。API成本才R1的十分之一!

图片

图片

一向大方的通义这次又是上线即开源,评论区一看到是Apache 2.0许可证,就开始感谢大自然的馈赠了。这是官方给的一系列链接:

博客:https://qwenlm.github.io/blog/qwq-32b

HF:https://huggingface.co/Qwen/QwQ-32B

Qwen 聊天室(网页试用):https://chat.qwen.ai

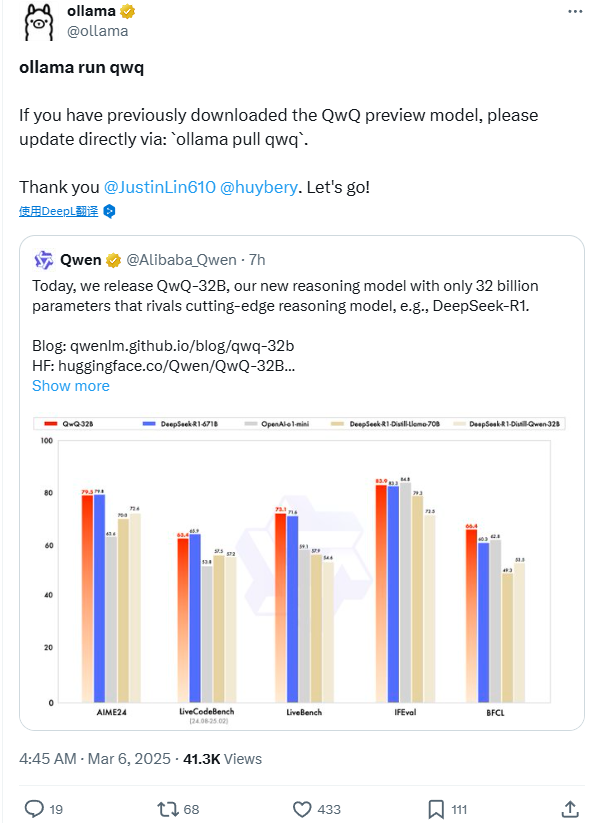

模型部署工具ollama也是连夜更新,紧急上线了QwQ-32B,还艾特了通义的两位大佬表示感谢。

图片

图片

有趣的是,追踪到Binyuan Hui的推特,发现他的置顶是一张梗图“Goodbye ChatGPT,Hello Qwen Chat”。

图片

图片

国产大模型完全有底气对ChatGPT说一声再见了。还记得GPT-4.5推出时,那种普遍觉得乏味、失望的氛围,人们越来越认识到,传统的那套训练技术玩的“大力出奇迹”似乎已经走向了尽头。

读了QwQ-32B的博客,我们发现:这次又是强化学习(RL)立大功了!

1.QwQ-32B的炼成:强化学习还有多少惊喜?

从阿里的技术博客我们能了解到两点:1.强化学习扩展依然是这次性能飞跃的重中之重 2.这个方向还有很长的路能走!

在具体的训练上,通义团队分了两个阶段去做RL训练。

第一阶段,是从冷启动检查点(指模型已经过了冷启动训练阶段,检查点相当于“存档”)开始,实施了一种基于结果奖励的强化学习(RL)扩展方法。

这里有两个突破值得关注:首先,在初期阶段,有特别针对数学和编程任务进行了RL扩展,相当于对强推理比较重要的领域专门“补课”;其次,不同于传统的奖励模型,通义团队采用了一个数学问题的准确性验证器来确保最终解答的正确性,并使用代码执行服务器来评估生成的代码是否能成功通过预定义的测试用例。

然后就看到随着训练的持续,模型性能在数学和编程领域稳定拉升。

第二阶段,是旨在提升通用能力的RL训练。他们在这个过程中,采取的是通用奖励模型的奖励和一些基于规则的验证器。

通义团队说,他们发现:“通过少量步骤的训练,其他一般能力(如指令跟随、人类偏好对齐、智能体性能等)得到了提升,同时数学和编程能力并未出现显著下降。”这句话的分量大家都能懂……大模型训练经常是只能顾一头,没有明显的性能折损大大验证了这个策略的有效性。

通义也在博客写了未来方向:通过这一历程,我们不仅见证了扩展强化学习(RL)的巨大潜力,也认识到了预训练语言模型尚未开发的可能性。

看来新的Scaling Law真的会在后训练阶段了!

2.网友实测:本地人工智能时代来临!

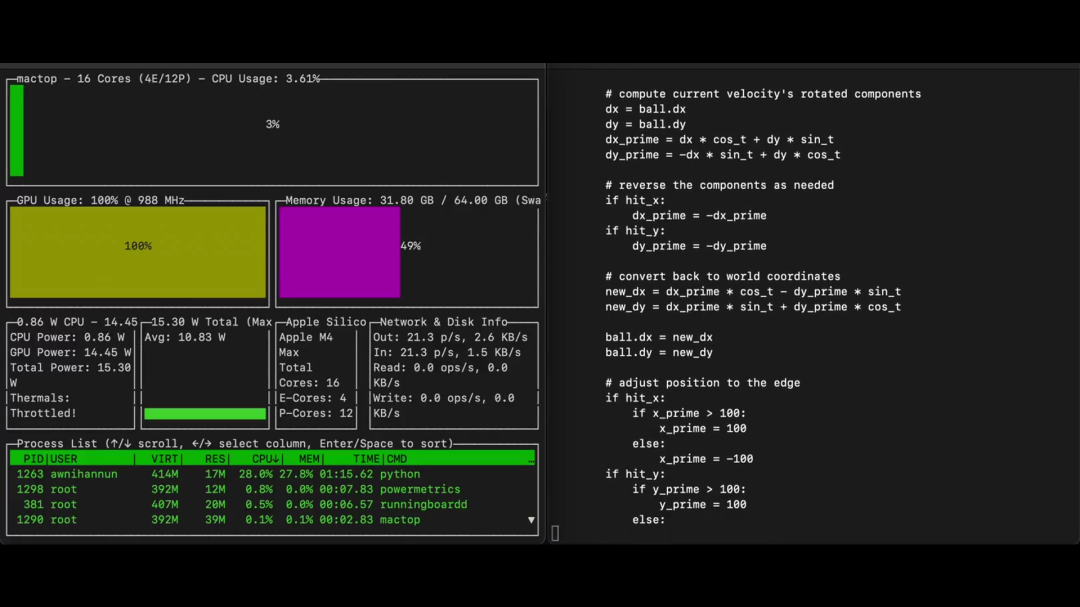

一位进行了实测,发现QwQ-32B 在笔记本电脑上运行得相当丝滑。

在这里,它在装有 MLX 的 M4 Max 上运行良好。它的 8k 代币长思考过程的一个片段:

图片

图片

另一位网友采用本地部署,推断了一个比较复杂的推理题目:

有两座房子,从左到右依次编号为1到2。 每间房子都住着不同的人。 每所房子都有一个独特的属性,分别代表以下特征:每个人都有一个独特的名字:Arnold, Eric;每个人都拥有独特的汽车型号:ford f150, tesla model 3;人们饲养独特的动物:猫、马。

线索:1. 埃里克在拥有特斯拉 Model 3 的人的正前方左边。养马的人在第一间房子里。

图片

图片

QwQ-32B仅用了40s的思考时间就给出了正确答案。

评论区说:这是真正的本地人工智能力量!

图片

图片

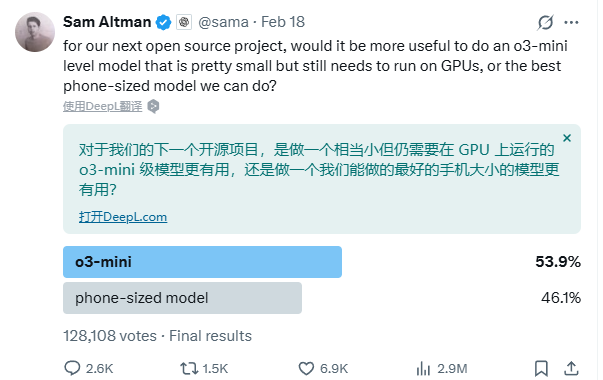

也有人表示:太遗憾了!你们这些人干嘛在奥特曼要开源的时候投票给o3类似模型啊?(另一个选项是手机可跑的端侧模型)

图片

图片

写道这里不得不吐槽一句,OpenAI的开源是真慢啊,预热了一下又没影了。

图片

图片

4.写在最后:算力不再成为问题

昨天看外媒的报道说,R1带火了消费级显卡,新款游戏芯片RTX 5090被黄牛炒到150%。这是因为DeepSeek的模型不再需要高端AI芯片,普通消费级产品就能满足运行需求。

那么QwQ-32B这波震撼之余,可能带货的就是M4 Max的苹果电脑了。

从最初的庞然大物发展到可以家用,计算机走了几十年的时间。从GPT-3发布后的不到五年中,我们就有了在笔电上能run起来的超强模型。

然后终将有一天,我们会在手机上部署更强悍更轻量的模型。

就像一位网友所说:

哦,我的天哪,现在每个人都会在接下来的两周里讨论QwQ-32B,DeepSeek 也会准备好另一个模型,然后 OpenAI 将别无选择,只能推出 ChatGPT 5,在 AGI 之前这一切都不会停止。

图片

图片

本文转载自51CTO技术栈,作者:伊风