回复

冲,DeepSeek-R1/V3推理系统架构设计被开源了!

DeepSeek开源周并未结束,One More Thing:DeepSeek-V3/R1 推理系统概述以及高达545%的成本利润率:

- 通过以下方式优化吞吐量和延迟

🔧 跨节点EP驱动的批量扩展

🔄 计算-通信重叠

⚖️ 负载均衡

- DeepSeek在线服务的统计数据

⚡ 每个H800节点每秒73.7k/14.8k输入/输出 tokens

🚀 成本利润率545%

图片

图片

DeepSeek-V3 / R1 推理系统的优化目标是:更大的吞吐,更低的延迟。

图片

图片

大规模跨节点专家并行(EP)

由于DeepSeek-V3/R1模型具有高度稀疏性,每层256个专家中仅激活8个,因此必须采用大的overall batch size来为每个专家提供足够的expert batch size,以实现更大的吞吐和更低的延迟。具体实现包括:

- Prefill阶段:采用EP32,MLA和共享专家DP32,一个部署单元由4节点组成,每个节点有32个冗余路由专家,每张卡有9个路由专家和1个共享专家。

- Decode阶段:采用EP144,MLA和共享专家DP144,一个部署单元由18节点组成,每个节点有32个冗余路由专家,每张卡有2个路由专家和1个共享专家。

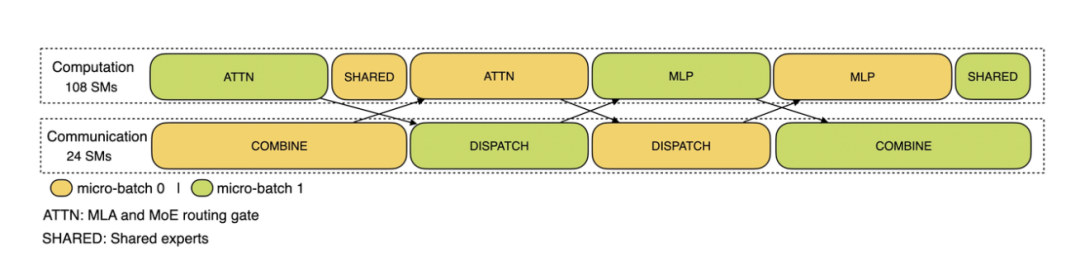

计算-通信重叠

为了掩盖由多机多卡专家并行引入的通信开销,系统采用了双batch重叠策略,以提高整体吞吐量:

- Prefill阶段:两个batch的计算和通信交错进行,一个batch在进行计算时可以掩盖另一个batch的通信开销。

图片

图片

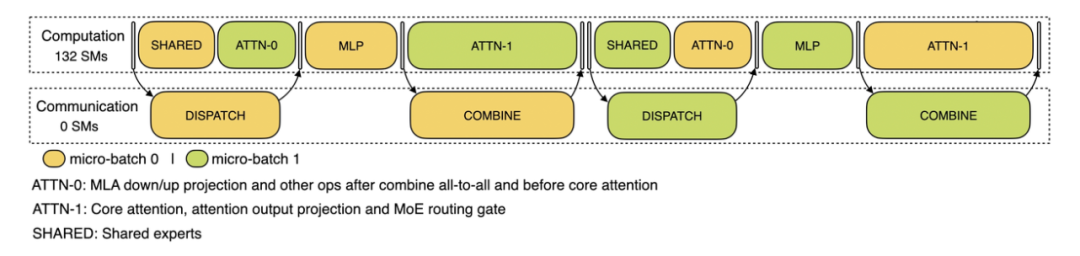

- Decode阶段:将attention部分拆分为两个stage,共计5个stage的流水线,以实现计算和通信的重叠。

图片

图片

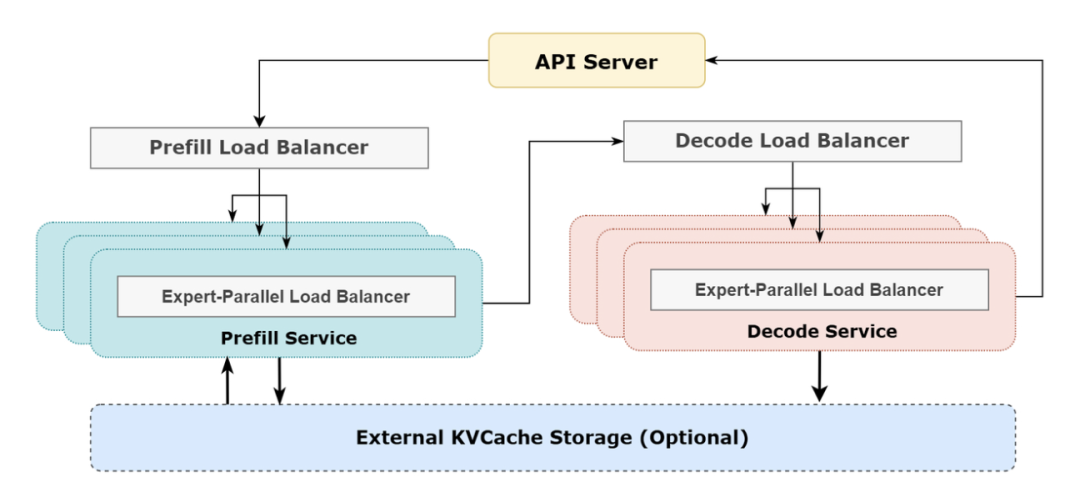

负载均衡

由于采用了大规模并行(包括数据并行和专家并行),需要为每个GPU分配均衡的计算负载和通信负载,以避免性能瓶颈和资源浪费:

- Prefill Load Balancer:确保各GPU的计算量(core-attention计算负载)和输入的token数量(dispatch发送量)尽量相同。

- Decode Load Balancer:确保各GPU的KVCache占用量(core-attention计算负载)和请求数量(dispatch发送量)尽量相同。

- Expert-Parallel Load Balancer:确保每个GPU上的专家计算量均衡,即最小化所有GPU的dispatch接收量的最大值。

实际统计数据

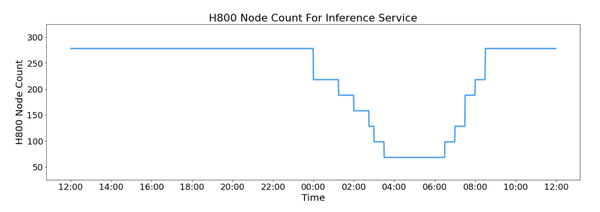

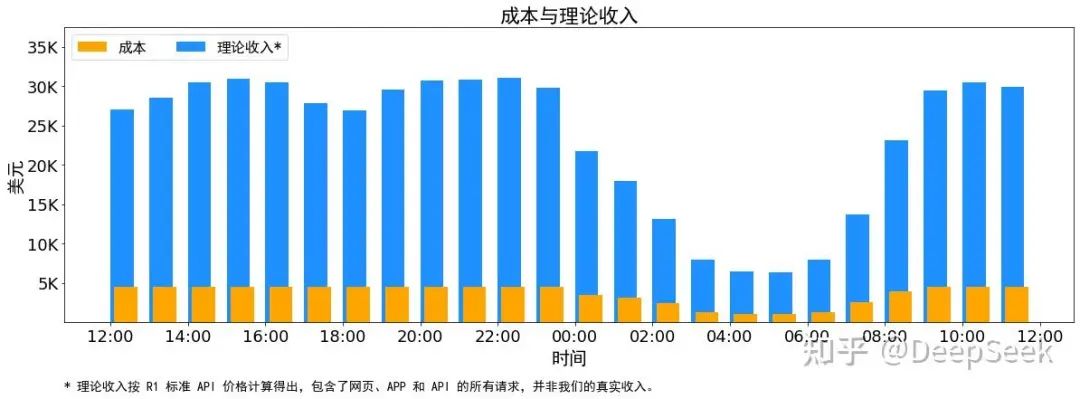

DeepSeek V3和R1的所有服务均使用H800 GPU,并采用与训练一致的精度格式(FP8和BF16),以最大程度保证服务效果。在最近的24小时内,DeepSeek V3和R1推理服务的峰值占用为278个节点,平均占用226.75个节点。尽管理论上一天的总收入为$562,027,成本利润率545%,但实际收入会因V3的定价较低、收费服务占比和夜间折扣等因素而有所不同。

图片

图片

本文转载自PaperAgent

已于2025-3-4 11:12:35修改

赞

收藏

回复

相关推荐