又一突破!跨模型的Function_Calling来了

介绍

大型语言模型(LLM)通过工具调用能够与外部数据源进行交互。这项技术让开发者能够利用LLM来获取、交互和操作外部资源(比如数据库、文件和API等)。

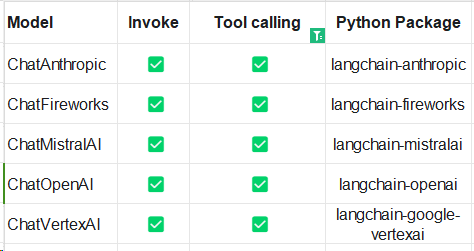

随着越来越多的LLM提供商开始提供工具调用功能,我们注意到市场上出现了多种多样的接口。为了解决这个问题,LangChain推出了一个标准化的接口,这样用户就可以轻松地在不同的LLM提供商之间进行切换。

这个标准化接口包括以下几个方面:

- ChatModel.bind_tools:这个方法允许您将工具的定义附加到模型的调用过程中。

- AIMessage.tool_calls:这是一个新增的属性,它使得从模型返回的 AIMessage 中获取工具调用变得更加简单。

- create_tool_calling_agent:这是一个构建代理的函数,适用于任何实现了 bind_tools 并且能够返回 tool_calls 的模型。

下面,我们将详细解释这些组件。

ChatModel.bind_tools

为了让模型能够使用工具,我们需要告诉它哪些工具是可以使用的。这可以通过向模型提供一个包含工具定义的列表来实现,这些工具定义包括了工具参数的模式。不同的模型提供商可能需要不同的格式,但是 ChatModel.bind_tools 提供了一个统一的接口,让您可以指定哪些工具对模型来说是可用的。

这意味着,无论您使用的是哪种工具调用模型,代码的结构都将非常相似。

如果我们想使用不同的工具调用模型,我们的代码看起来会非常相似:

那么调用 llm_with_tools 会是什么样子呢?这就是 AIMessage.tool_calls 的用武之地。

AIMessage.tool_calls

在过去,当使用工具调用模型时,模型返回的工具调用可能会放在 AIMessage.additional_kwargs 或 AIMessage.content 中,这取决于模型提供商的API,并遵循特定于提供商的格式。现在,AIMessage.tool_calls 提供了一个标准化的接口来获取模型的工具调用。这样,在调用了绑定了工具的模型之后,您将得到一个包含 tool_calls 属性的输出,其中列出了所有的工具调用。

在调用了绑定工具的模型之后,您将得到以下形式的输出:

其中 AIMessage 有一个 tool_calls: List[ToolCall] 属性,如果有工具调用,它将被填充,并将遵循工具调用的标准接口:

也就是说,无论您是在调用 Anthropic、OpenAI、Gemini 等,只要有工具调用,它将以 AIMessage.tool_calls 形式作为 ToolCall 出现。

我们还添加了一些其他属性,用于处理流式工具调用块和无效工具调用。有关这些的更多信息,请阅读工具调用文档 这里。

create_tool_calling_agent

利用LLM的工具调用能力来构建代理是一个非常强大的应用场景。我们已经有了一个 create_openai_tools_agent() 构造函数,它可以方便地构建一个符合OpenAI工具调用API的代理。但是,这个构造函数并不适用于Anthropic和Gemini等模型。现在,有了 bind_tools() 和 tool_calls 这两个新接口,我们推出了 create_tool_calling_agent(),它能够与任何支持工具调用的模型一起工作。

我们可以使用 VertexAI 替代:

或者 OpenAI:

等等。

有关新代理的完整文档,请查看 https://python.langchain.com/docs/modules/agents/agent_types/tool_calling。

总结

我们预计,将原生工具调用功能引入LLM的趋势将继续下去。我们希望这个标准化的工具调用接口能够帮助LangChain用户节省时间和精力,并使他们能够更容易地在不同的LLM提供商之间进行切换。

本文转载自 AI小智,作者: AI小智