传统RAG的局限被打破!三个轻量级智能体分工协作,如何让问答系统更精准? 原创

近期,公司在AI相关项目,尤其是问答系统领域,对回答的准确率和表述质量提出了更高的要求。用户提出的问题不仅限于基础性问题,还可能涉及多样化、复杂化的场景。也就在上周五快下班的时候,项目经理向我反馈,之前的项目团队支持的某客户在使用问答系统时,除了查询私有知识库中的信息外,还会提出以下几类问题:

- 可直接由大语言模型(LLM)回答的问题:例如通用知识或常识性问题。

- 非知识库相关的口头表达:如“谢谢”、“再见”等社交性语句。

- 需要多步推理的复杂问题:例如涉及逻辑推理或上下文关联的问题。

然而,之前项目团队采用的RAG技术存在一定的局限性:无论用户提出何种问题,系统均默认从知识库中检索答案,再交由LLM生成回答。针对非知识库问题(如口头表达),团队通过在prompt层面设置固定回复的方式进行处理。虽然这种方法能够部分解决问题,但其设计不够优雅,且无法有效应对需要多步推理的复杂问题。项目经理希望我能提出一种更优化的解决方案,以应对上述挑战。为此,我向他提出了一种轻量级的多智能体方案,在不修改检索器和LLM的前提下,优化整个RAG流程。

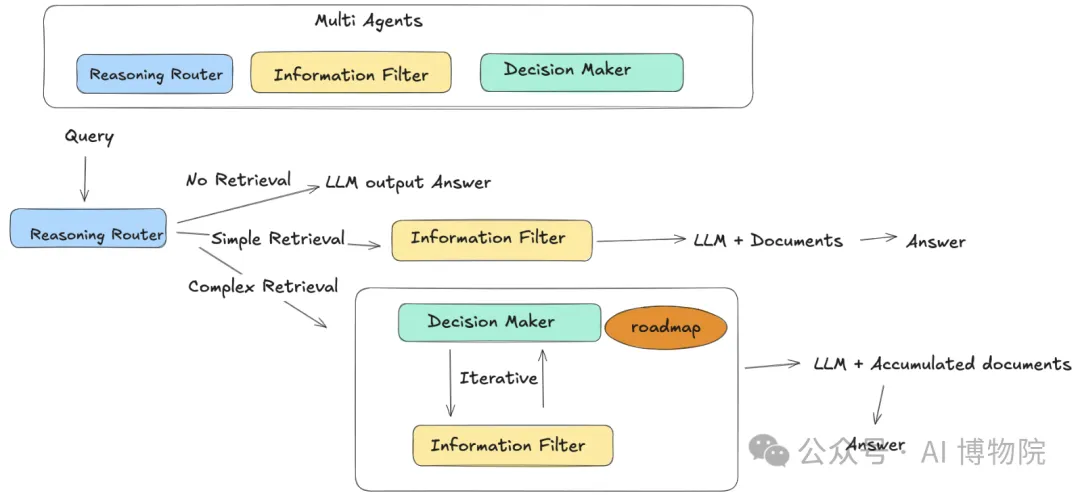

架构图

定义三个智能体

我们设计了三个专门的智能体——推理路由器(Reasoning Router)、信息过滤器(Information Filter)和****决策制定者(Decision Maker)——以促进检索器与大型语言模型(LLM)之间的通信,每个轻量级智能体扮演不同的角色,通过有针对性的指令协同管理RAG(Retrieval-Augmented Generation)管道的各个方面。这种统一设计确保了高效的协调,同时保持了边缘部署的简洁性。三个智能体分别负责评估是否需要检索、生成有效的查询以及选择适合 LLMs 的信息。

推理路由器(Reasoning Router)

从高层次视角确定给定问题的最佳推理策略。根据当前状态(即问题),它通过最多两步操作选择行动:

- 决定检索必要性:如果输出[No Retrieval],则问题直接由LLM处理,利用其内部知识生成答案。

- 确定问题复杂性:如果输出[Retrieval],还会评估问题是否需要复杂推理。

- 对于简单问题,生成一个并与检索器交互以获取文档。检索到的文档随后由信息过滤器处理,提取出适合LLM的相关内容。最后,LLM使用过滤后的文档生成问题的答案。

- 对于复杂问题,输出[Planning],这将触发需要多个智能体协调的多步推理策略。

具体示例如下:

- 示例1(无需检索):

a.输入问题:q = "What is the capital of France?"

b.输出:[No Retrieval]

c.解释:该问题属于常识性问题,可直接由LLM回答,无需检索。

- 示例2(简单问题,需检索):

a.输入问题:q = "What is the population of Paris in 2023?"

b.输出:[Retrieval]<population of Paris 2023>

c.解释:该问题需要从外部知识库中检索最新数据。

- 示例3(复杂问题,需多步推理):

a.输入问题:q = "How does the economic policy of Country A affect its trade relations with Country B?"

b.输出:[Planning]

c.解释:该问题涉及多步推理,需要分解为多个子目标并逐步解决。

过滤器(Information Filter)

用于处理和过滤检索到的信息,以识别适合LLM的内容。其状态空间包括问题、检索到的文档以及当前的推理目标(如果在[Planning]模式下运行)。

决策者(Decision Maker)

根据当前状态在[Planning]策略中确定最佳行动。其状态空间包括问题、LLM生成的路线图以及推理历史中积累的文档。根据当前状态,智能地选择行动以评估进展并决定下一步操作。

智能体如何协作?

直接回答策略(Direct Answering Strategy)和单次检索策略(Single-pass Strategy)已在推理路由器(Reasoning Router)的定义中介绍,分别对应于输出[No Retrieval]和[Retrieval]。

多步推理策略(Multi-Step Reasoning Strategy)对应于推理路由器输出的[Planning]。该策略旨在解决需要LLM生成高层次路线图以及多次检索-过滤循环的复杂问题,通过以下三个阶段实现迭代式信息收集和推理:

- 生成路线图(Generate Roadmap):LLM将复杂问题分解为一系列结构化的子目标,为智能体提供高层次的指导。这些子目标定义了解决问题的步骤和所需的信息类型。

- 迭代检索与过滤(Iterative Retrieval and Filtering):根据生成的路线图,智能体通过多次检索-过滤循环逐步收集相关信息。每次循环中,推理路由器确定当前子目标是否需要检索,信息过滤器提取相关文档,决策制定者评估进展并决定下一步操作。

- 综合与生成答案(Synthesis and Answer Generation):在完成所有子目标后,LLM综合收集到的信息,生成最终答案。这一过程确保了复杂问题能够得到全面且准确的回答。

通过这三种策略,我们的多智能体系统能够自适应地处理不同复杂度的问题:

- 直接回答策略(Direct Answering Strategy):适用于通用知识问题,提供即时响应。

- 单次检索策略(Single-pass Strategy):高效处理基于事实的问题,通过一次检索-过滤循环获取答案。

- 多步推理策略(Multi-Step Strategy):通过引导式迭代推理解决复杂问题。

prompt如何设计

Reasoning Router

推理路由器将按照以下步骤进行评估并输出相应的动作:

- 评估问题:

a.分析问题的特异性、复杂性和清晰度,判断是否需要检索或规划。

b.确定问题是否属于LLM的现有知识范围,或者是否需要外部信息支持。

- 决策类别:

a.如果问题复杂且需要规划,输出:[Planning]。

b.如果问题需要特定信息(如最新事件或LLM知识范围外的细分领域),输出:[Retrieval] ‘YOUR QUERY HERE‘。

c.如果问题可以直接由LLM回答,输出:[No Retrieval]。

- 输出格式:

a.无需检索:[No Retrieval]

b.需要检索:[Retrieval](适用于简单问题)

c.需要规划:[Planning](适用于复杂问题)

其对应的prompt可以如下设计:

Information Filter

信息过滤器的状态空间根据系统当前采用的策略不同而有所区别:

- 单次检索策略(Single-pass Strategy):

q:输入问题。

retrieved documents:从检索系统中获取的相关文档。

状态空间:S2 = {q, retrieved documents}

- 多步推理策略(Multi-step Reasoning Strategy):

q:输入问题。

retrieved documents:从检索系统中获取的相关文档。

current objective:当前推理目标(在多步推理模式下)。

状态空间:S2 = {q, retrieved documents, current objective}

它会进行文档分析并按照下面的格式进行输出:

示例

- 单次检索策略:

问题:What is the population of Paris in 2023?

检索到的文档:包含巴黎人口统计数据的多篇文档。

信息过滤器输出:

2. 多步推理策略:

问题:How does the economic policy of Country A affect its trade relations with Country B?

当前目标:分析Country A的经济政策。

检索到的文档:多篇关于Country A经济政策的文档。

对应的prompt如下设计:

Decision Maker

决策者的状态空间为:S3 = {q, Accumulated Documents, Roadmap}

- q:输入问题。

- Accumulated Documents:当前累积的文档(来自之前的检索-过滤循环)。

- Roadmap:由LLM生成的推理路线图(在多步推理策略中)。

主要职责是根据当前状态评估推理进展,并决定是否需要进一步检索或直接生成最终答案。其动作空间包括以下两种可能的操作:

- [Retrieval]:

请求额外的检索-过滤循环,生成子查询以获取更多相关信息。

适用场景:当前累积的文档不足以解决所有子目标。

- [LLM]:

将当前累积的所有文档传递给LLM,生成最终答案。

适用场景:当前累积的文档已足够解决所有子目标。

它的输出格式如下:

示例

- 需要进一步检索:

问题:How does the economic policy of Country A affect its trade relations with Country B?

当前状态:

Roadmap:下一步需要分析Country B的贸易政策。

Accumulated Documents:包含Country A经济政策的文档。

决策者输出:

- 生成最终答案

问题:How does the economic policy of Country A affect its trade relations with Country B?

当前状态:

Accumulated Documents:包含Country A经济政策和Country B贸易政策的文档。

Roadmap:所有子目标已完成。

决策者输出:

通过决策制定器的动态评估和决策,系统能够在多步推理策略中灵活调整检索和生成过程,确保复杂问题得到全面且准确的回答。

对应的prompt如下:

总结

通过引入多智能体协作的RAG优化方案,成功解决了传统RAG技术在处理多样化问题时的局限性。然而,这种设计较为依赖模型的能力,尤其是Reasoning Router的准确性。一旦Reasoning Router判断错误,最终结果可能不如预期。因此在资源允许的情况下,可以考虑使用一个7B小模型进行fine-tuning以提升Reasoning Router的表现。

本文转载自公众号AI 博物院 作者:longyunfeigu

原文链接:https://mp.weixin.qq.com/s/GizZiM1JeF2Mc2Ui8coCGg