时序+图像+文本,多模态增强的时序预测模型

今天给大家介绍一片最新的多模态时间序列预测工作。这篇文章采用了时间序列、图像、文本三种模态的数据形式,进行时间序列预测,增强底层信息的输入,提升时序预测效果。

论文标题:Time-VLM: Exploring Multimodal Vision-Language Models for Augmented Time Series Forecasting

下载地址:https://arxiv.org/pdf/2502.04395

1.研究背景

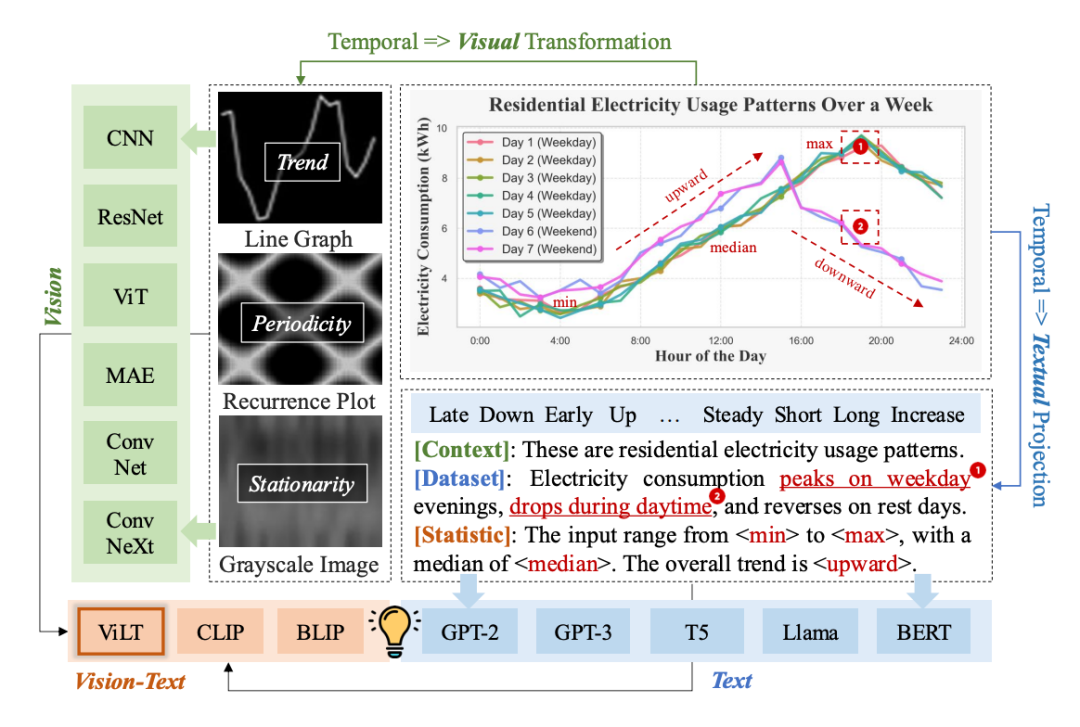

传统的时间序列预测方法,都是最基础的时间序列形式数据进行建模的。然而,最近一些工作将文本信息、图像信息等模态引入时间序列建模中。例如,将时间序列转换成文本形式输入到LLM,或者将时间序列转换成图像数据输入图像模型。

文本和图像数据各有优势。文本形式可以提供丰富的上下文语义信息,而图像形式可以非常直观的提升时间序列的形状信息。如何融合不同模态的信息实现时间序列预测,在目前的多模态大模型阶段是一个值得深入研究的优化点。

这篇文章就提出了一种融合时间序列、图像、文本等3种模态信息的时间序列预测模型,利用各个模态的输入进行优势互补,提升时间序列预测整体的效果。

图片

图片

2.建模方法

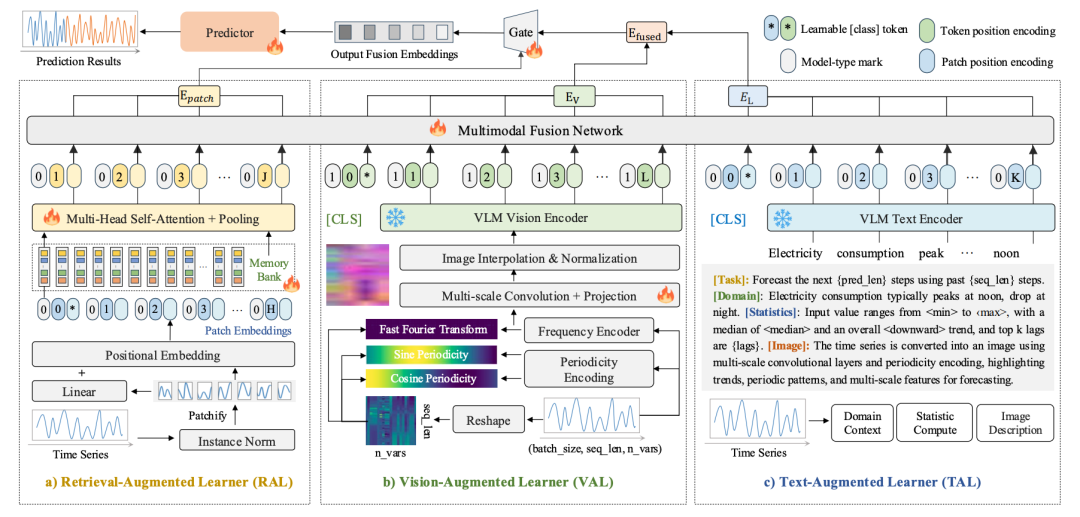

本文的核心建模方法可以分为4个部分:时间序列模态建模、图像模态建模、文本模态建模、多模态融合。下面对这4个主要模块展开进行介绍。

时间序列模态输入:本文采用了Patch+检索的时序表征抽取方式。首先将时间序列分割成patch,然后使用多个可学习的query向量,和各个patch或者patch内部表征计算attention,相当于用可学习query去提取各个patch以及patch内部的重要信息,得到对应的时间序列表征。Patch间attention检索表征和patch内attention检索表征使用加权求和的方式进行融合。

图像模态输入:在图像模态部分,会使用傅里叶变换将原始时间序列映射到频域,并且使用三角函数构建每个时间步的相对位置关系。再加上原始的时间序列,共得到有3个channel的张量,维度为Batch_size、序列长度、变量数量、3(3为原始序列、傅里叶变换结果、三角函数位置信息)。接下来使用层次的卷积分别进行不同维度的信息提取。最后,将卷积输出的表征通过resize和插值的方法转换成目标尺寸的图片上,得到最终的图像模态输入。再输入到多模态视觉模型中,得到表征。

文本模态输入:对于文本模态,文中主要以数据集的描述为输入,结合相应的prompt,经过一层多模态文本模型,得到文本表征。

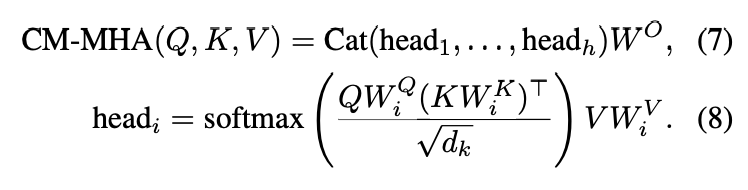

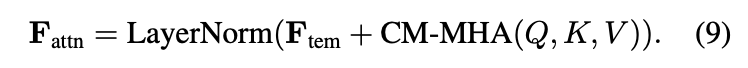

多模态融合:对于上述3种类型模态的输入,分别使用一个Encoder提取最终表征。时间序列模态使用self-attention和pooling进行提取。图像和文本模态使用预训练的图文模型(如CLIP等)分别提取图像和文本表征,模型参数冻结。在上层使用一个Multimodal Fusion Network进行多模态信息的融合。MFN的核心是使用时序模态的表征作为query,多模态保证作为key和value,进行跨模态attention。最后,再使用一个gate网络,对时序表征和多模态表征进行加权融合。整体计算过程如下:

图片

图片

图片

图片

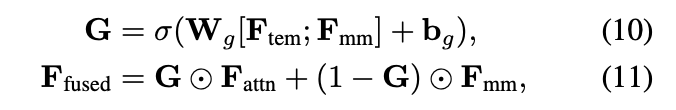

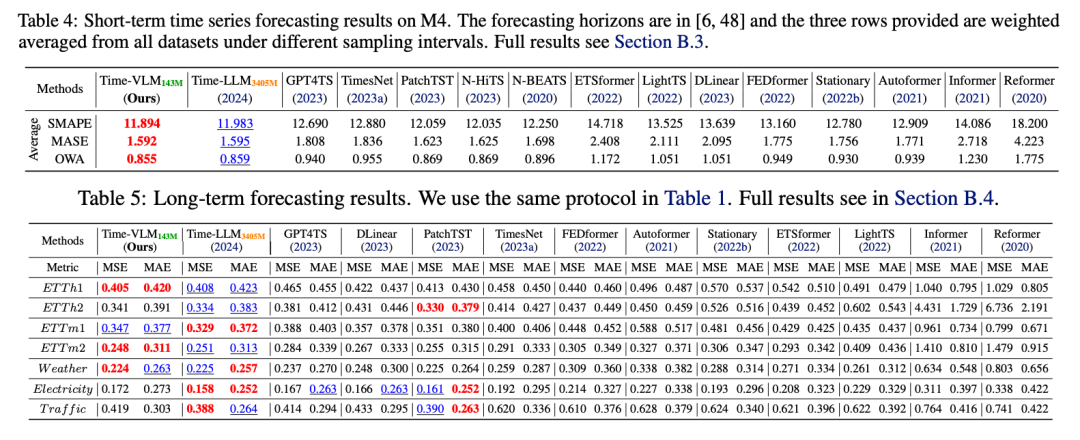

3.实验效果

通过在长期、短期时间序列预测上的效果对比可以发现,本文提出的方法取得了显著的效果提升,验证了多模态信息引入的有效性。

图片

图片

本文转载自圆圆的算法笔记