Anthropic秘密「混合模型」 Claude 4首曝细节,硬刚GPT-5!深度推理模型来了 精华

Anthropic终于要开始搞点事情啦!

近期的「推理模型」热潮中,Anthropic除了其CEO打了几个嘴炮外,还没有掏出一个拿得出手的产品。

在这样下去,可能要退出AI一线模型玩家行列了。Anthropic自己显然不想看到这种情况发生。

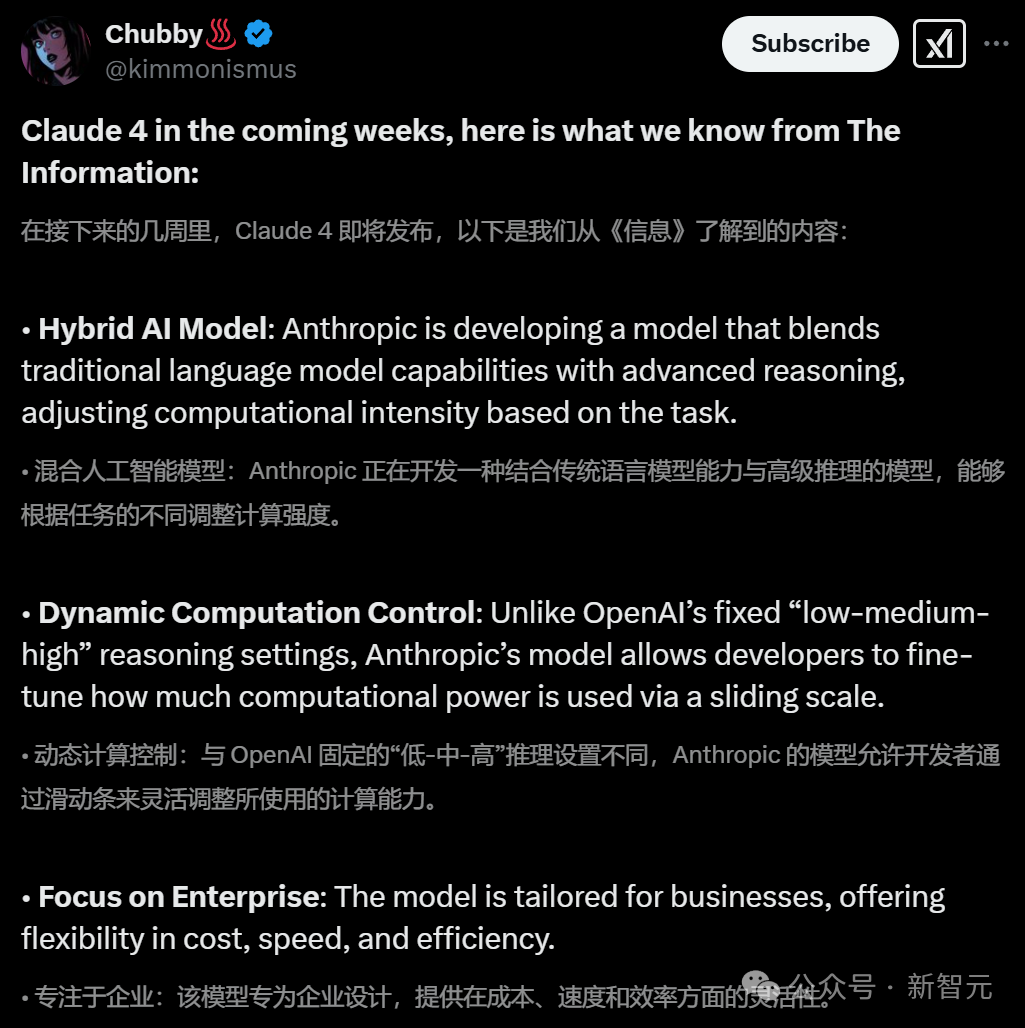

就在刚刚,有消息称,Anthropic会在未来几周内发布其全新的「混合AI」模型。

Anthropic版「推理模型」,测试时计算完全掌控

在OpenAI去年秋季发布其「推理模型」后,谷歌以及国内众多AI公司纷纷推出了自己的模型。作为一个主要的竞争对手,Anthropic在这场推理竞赛中却明显缺席。

现在,我们知道了原因——Anthropic开发的是一款融合了推理能力的混合AI模型。

具体来说,这种「混合模型」可以使用更多的计算资源来计算复杂问题,但也能像传统LLM一样快速处理更简单的任务,无需额外计算。

此外,模型还可以让客户控制它在查询时使用的算力——换句话说就是,它在解决问题时「推理」的时长。

开发者可以通过一个滑动条来调整模型在尝试找出答案或完成任务时将处理或生成的token数量。

通过将滑动条设置为「0」,开发者可以将Anthropic模型作为一个普通的、非推理AI使用,类似于OpenAI的GPT-4o。

OpenAI也有类似的功能,允许开发者控制其推理模型「思考」的时间。

但开发者仅限于「低」、「中」和「高」三种设置,很难预测模型在这些级别上实际会处理多少token——因此,也很难预测单次查询的成本。

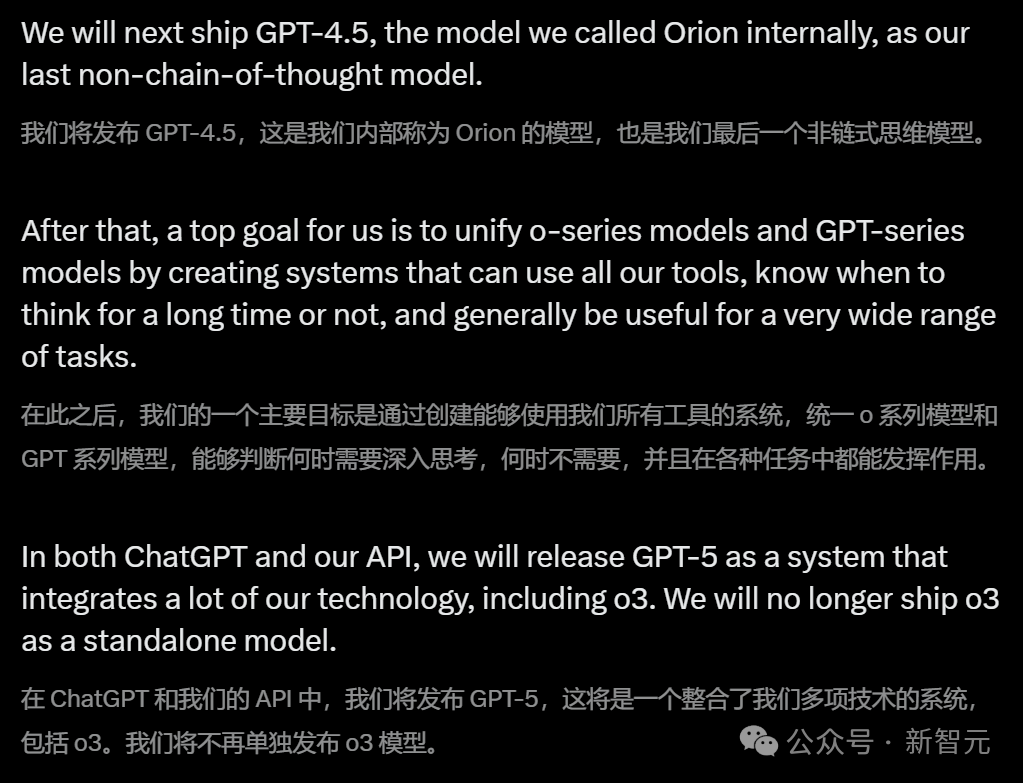

现在,OpenAI可能转而成为追随者。

在外界看来,这和Anthropic尚未公开的技术路线可谓是如出一辙。(去年11月The Information曾做过相关预测)

从Anthropic和OpenAI设计模型和产品的方式,我们可以清晰地看出它们在竞争激烈的AI市场中的战略定位。

OpenAI显然更希望ChatGPT成为面向消费者或个人专业人士的突破性应用,这可能就是它在推理模型中使用低-中-高命名法的原因,因为这更容易让普通用户理解。

Anthropic则更专注于企业市场,这就是为什么它致力于开发能让开发者通过滑动条方式更好地控制成本、速度和定价的功能。

据知情人士透露,Anthropic即将推出的模型在编程方面也取得了特别显著的进展,这已经成为生成式AI在企业中最强大的应用之一。

当允许Anthropic模型使用最长时间「思考」时,在某些编程基准测试中,它的表现已经超过了客户目前能访问到的最先进的OpenAI推理模型(即o3-mini high)。

这位人士表示,虽然OpenAI的推理模型在更学术性的问题上表现更好,比如竞争性编程问题,但Anthropic的模型更擅长处理企业工程师可能遇到的实际编程任务。

例如,Anthropic的模型更善于理解由数千个文件组成的复杂代码库,并能一次性生成可用的完整代码行。

不过,仍然悬而未决的重要问题是,Anthropic的新模型将收取多少费用,以及它是否会比OpenAI最近发布的o3-mini推理模型更便宜。后者因比OpenAI最受欢迎的非推理模型GPT-4o更便宜而给开发者留下了深刻印象。

目前还不清楚像DeepSeek和谷歌最新的Gemini模型这样的超低价AI是否会推动所有模型的价格趋近于零。

就目前来看,市场上似乎在进行着两场不同的竞争:

- 在AI开发的前沿,那些在推理或编程方面能够逐步改进的模型将继续保持定价优势;

- 在另一个更大的市场中,那些「够用就好」(good-enough)的模型则可能会继续展开价格战。

对于这个全新的「混合模型」,有网友认为,Anthropic新模型的成败将取决于它的成本,毕竟性能也很强的o3-mini是一个小模型,成本很低。

当然,也有网友质疑说,「滑动条」并不是一个好的设计,这位叫eric的网友评论称,「我只希望回复是正确的,不想在每次后续中都需要调整。」

「我们确实处于模型交互体验尴尬阶段。」他评价说。

2027年收入飙至345亿美元

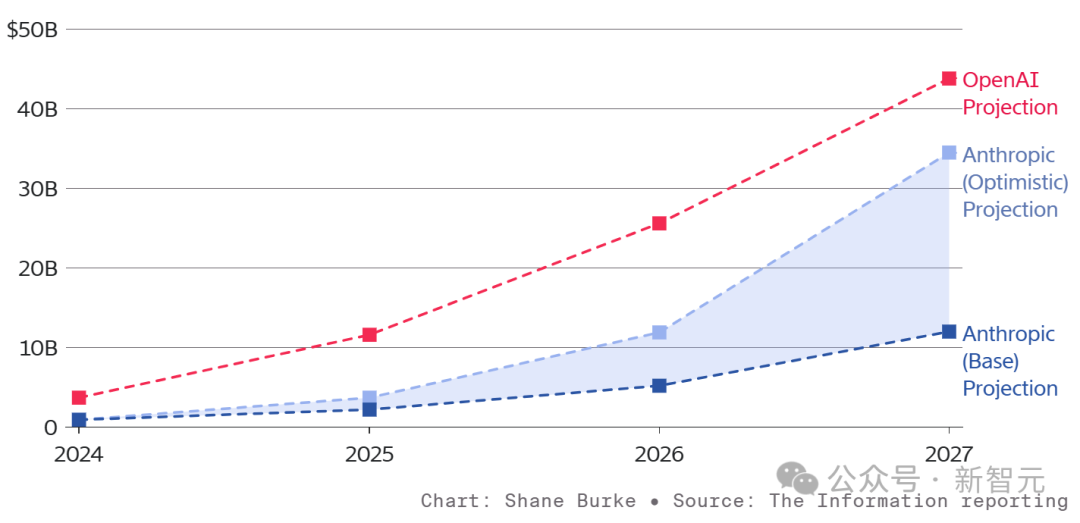

根据The Information的报道,Anthropic在2023年烧了56亿美元现金后,计划在2025年将支出减少近半,并在2027年实现高达345亿美元的收入。

要实现这样的增长,Anthropic需要大幅缩小与市场领导者OpenAI之间的差距。目前OpenAI的收入可能是Anthropic的5倍以上——在2027年实现4,400亿美元的收入。

Anthropic和OpenAI一直是企业在生成式AI投资方面的风向标,因此科技投资者正密切关注两家公司的表现。

在最可能的基本情况下,Anthropic表示其收入将从2025年的22亿美元增长至2027年的120亿美元。

目前外界并不知道Anthropic在2024年的具体收入,不过其月收入从年初的约800万美元上升到年底的约8,000万美元,这表明其全年收入在4亿至6亿美元之间。

Anthropic即将推出的新一代旗舰模型Claude有望支持其宏伟的增长目标。据知情人士透露,新模型预计在未来几周内发布。

然而,最近像DeepSeek这样的超低成本模型的发布,引发了人们对AI公司是否需要降价以保持竞争力的质疑。

在DeepSeek发布后,Anthropic也是少数几个没有大幅降低模型价格的AI实验室之一。

从Anthropic的融资材料来看,公司认为通过API向企业提供技术服务的机会,要大于与ChatGPT等聊天机器人竞争。

OpenAI的ChatGPT在普通用户以及程序员、营销人员和律师等专业人士群体中取得了突破性成功,截至去年底,其订阅收入每月超过3.33亿美元。

超越OpenAI?

在Anthropic发送给投资者的融资材料中,公司管理层预计到2027年API收入将达到200亿美元,是OpenAI同期预测API收入的3倍。

即使在基准预测情况下,Anthropic的API收入也将超过OpenAI。(Anthropic的其余预期收入来自向企业和专业用户销售Claude)

Anthropic表示,其技术可以改变办公场景,如生成或审查法律文件、实现软件工程自动化等。

诸如代码托管平台GitLab,法律搜索公司LexisNexis,以及开发Cursor编程助手的Anysphere,都是Claude的主要客户。

目前,Anthropic正寻求以580亿美元的投前估值融资20亿美元,而OpenAI则试图以2,600亿美元的投前估值进行融资。

除收入差距外,影响两家公司估值差异的另一个因素是Anthropic与转售其AI的云服务商(主要是亚马逊)之间的协议。

OpenAI通过与微软的业务合作获得20%的收入分成,而Anthropic此前向部分投资者透露,当客户通过亚马逊购买其模型时,需要向亚马逊支付更高比例的分成。

在Anthropic管理层预计的2027年345亿美元收入中,近2/3将来自其API业务,其中大部分销售将通过亚马逊等合作伙伴实现。亚马逊已承诺向该公司投资数十亿美元,并正在为其开发专用数据中心服务器集群。

资金消耗

估值差距的另一个因素是:OpenAI的运营效率可能高于Anthropic。

- Anthropic去年烧掉的现金比计划高出近30亿美元。其中,超过50%是来自一次性支付的数据中心使用费。

- OpenAI在2024年上半年仅消耗了3.4亿美元现金(未来几年会有所增加),并在在同期产生了数倍于Anthropic的收入。

- AI模型开发成本占据了Anthropic支出的大部分。其中,单在服务器上就投入了15亿美元。

- OpenAI去年在训练成本上的支出约为30亿美元(包括数据购买等额外支出)。

- Anthropic的研发人员成本达到了1.6亿美元,但不包括股权激励支出(一项重要的非现金支出)。

- OpenAI在2024年上半年报告的股权激励支出为15亿美元。

- 截至2024年底,Anthropic拥有915名员工,其中521人从事研发工作;预计到2025年底,这一数字将翻倍至1,900人。

- 截至2024年9月,OpenAI的员工人数已超过1,600人。

对此,Anthropic向投资者表示,今年的现金支出预计是30亿美元,较去年的56亿美元大幅减少。此外,公司将会在2027年实现现金流转正。

本文转自新智元 ,作者:新智元