EVEv2.0,视觉语言分开编码,多模态视觉语言理解;视觉信息引导与标记逻辑增强减少大语言模型幻觉

研究背景与意义

在当前的人工智能研究领域,视觉-语言模型(VLMs)正迅速发展,特别是在大型语言模型(LLMs)和视觉模型(LVMs)取得显著进展的背景下。本文提出的EVEv2.0模型,旨在解决现有编码器驱动的VLMs在多模态理解和推理中的局限性。研究表明,现有的编码器驱动方法在灵活性和适用性上存在一定挑战,尤其是在处理复杂的视觉信息时。因此,EVEv2.0通过引入无编码器的设计,试图减少视觉和语言之间的干扰,从而提升模型的整体性能和可扩展性。

研究方法与创新

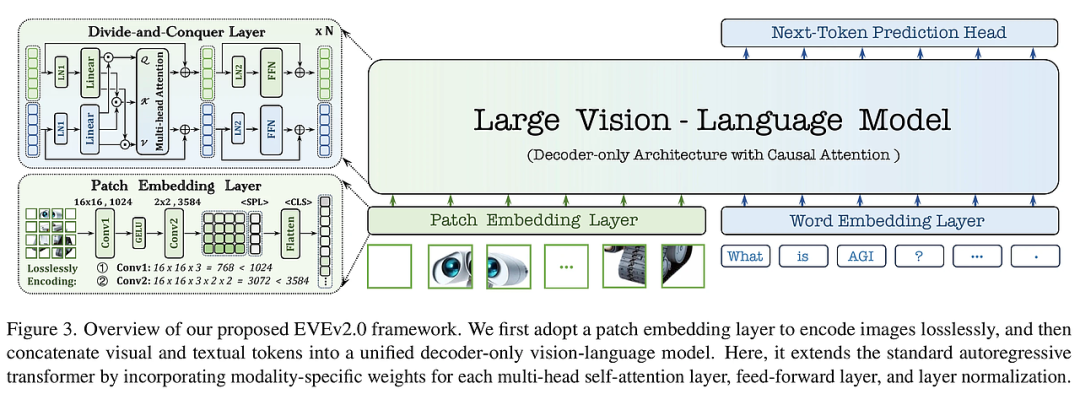

EVEv2.0的核心创新在于其全新的“分而治之”架构,旨在有效整合视觉和语言信息。该模型通过以下几个关键策略实现了创新:

- 去耦合设计:EVEv2.0将视觉和语言的处理模块进行分离,使用不同的注意力矩阵和规范化层,以减少模态间的干扰。

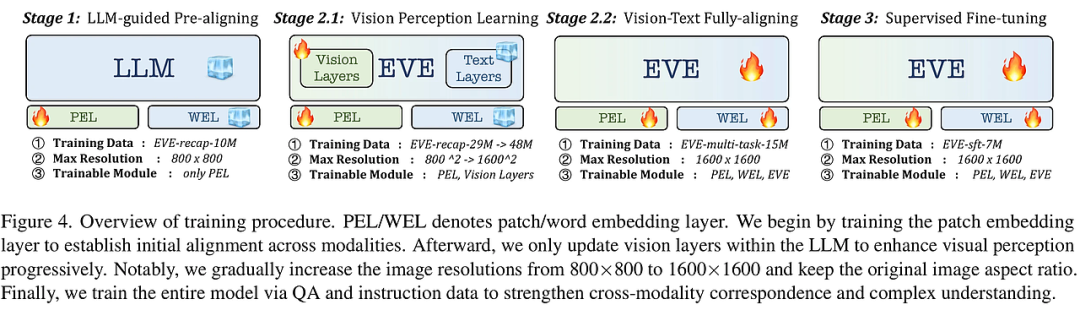

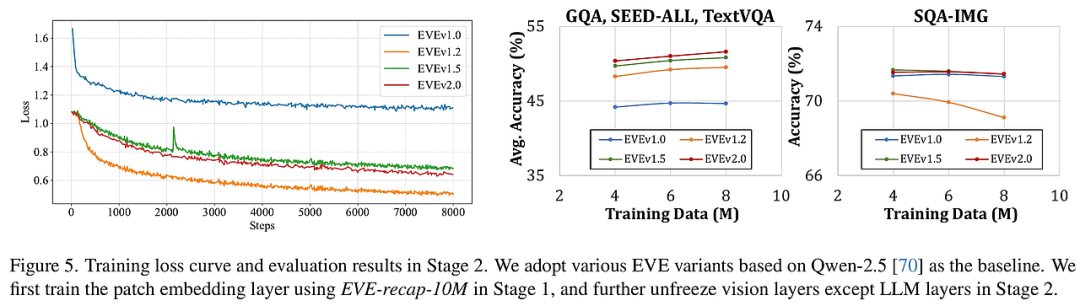

- 高效的训练策略:通过逐步引入视觉层和语言层的训练,EVEv2.0能够在保持预训练知识的同时,优化视觉感知能力。

- 无编码器架构:相较于传统方法,EVEv2.0不依赖于预训练的视觉编码器,而是从头开始构建视觉表示,提升了模型在多模态任务中的表现。

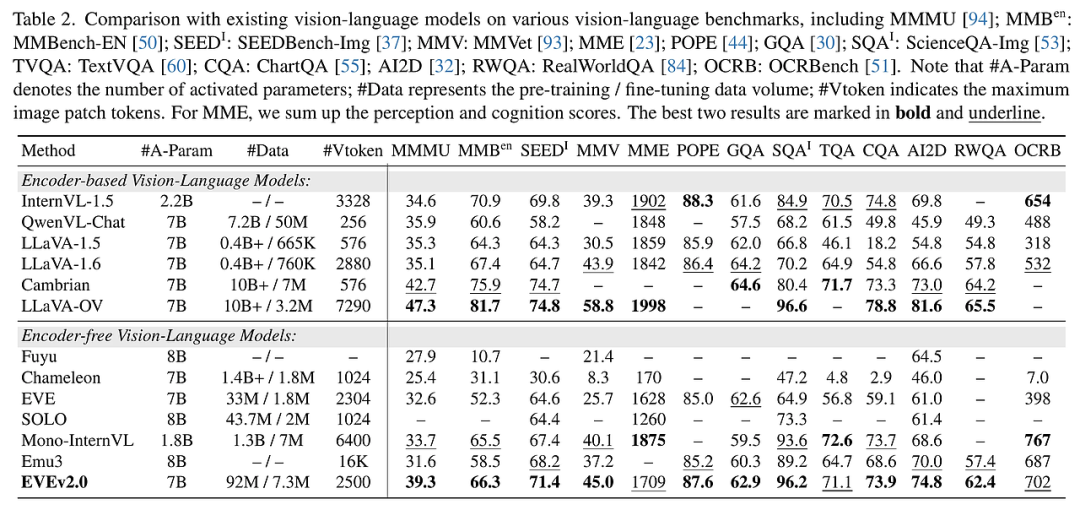

这些方法使得EVEv2.0在多个视觉语言基准测试中表现出色,尤其是在数据扩展和模型可伸缩性方面,展现了其强大的潜力。

实验设计与结果分析

EVEv2.0的实验设计包括多个阶段,逐步优化模型的视觉和语言理解能力。通过对比不同的训练数据集和模型架构,研究发现:

- 数据规模效应:随着训练数据规模的增加,模型性能显著提升,尤其是在复杂的视觉理解任务中。

- 视觉感知学习:模型在视觉层的训练过程中,通过引入高质量的图像-文本对,极大地增强了视觉感知能力。

- 多模态对齐:EVEv2.0在多模态对齐任务中表现优异,显示出其在处理复杂视觉和语言信息时的优势。

这些结果表明,EVEv2.0不仅在理论上提供了新的思路,也在实践中展现了其强大的应用潜力。

结论与展望

EVEv2.0的提出,标志着无编码器VLMs研究的一个重要进展。通过系统地分析和优化模型架构,EVEv2.0在多模态理解和推理中展现了卓越的性能。未来的研究可以进一步探索模型的扩展性,尤其是在音频和视频等其他模态的整合上。EVEv2.0为无编码器VLMs的研究提供了新的方向,期待其在实际应用中的广泛应用与发展。

The Hidden Life of Tokens: Reducing Hallucination of Large Vision-Language Models via Visual Information Steering

2025-02-05|Rutgers U, Stanford, Google DeepMind|🔺9

http://arxiv.org/abs/2502.03628v1

https://huggingface.co/papers/2502.03628

https://github.com/LzVv123456/VISTA

研究背景与意义

在多模态人工智能领域,大型视觉语言模型(LVLMs)如LLAVA和MiniGPT-4的崛起,标志着文本与视觉信息的无缝融合。然而,这些模型在实际应用中常常出现“幻觉”现象,即生成的内容在语法上是合理的,但与视觉输入不相符。这种现象不仅降低了模型的可靠性,也限制了其在关键应用场景中的有效性。

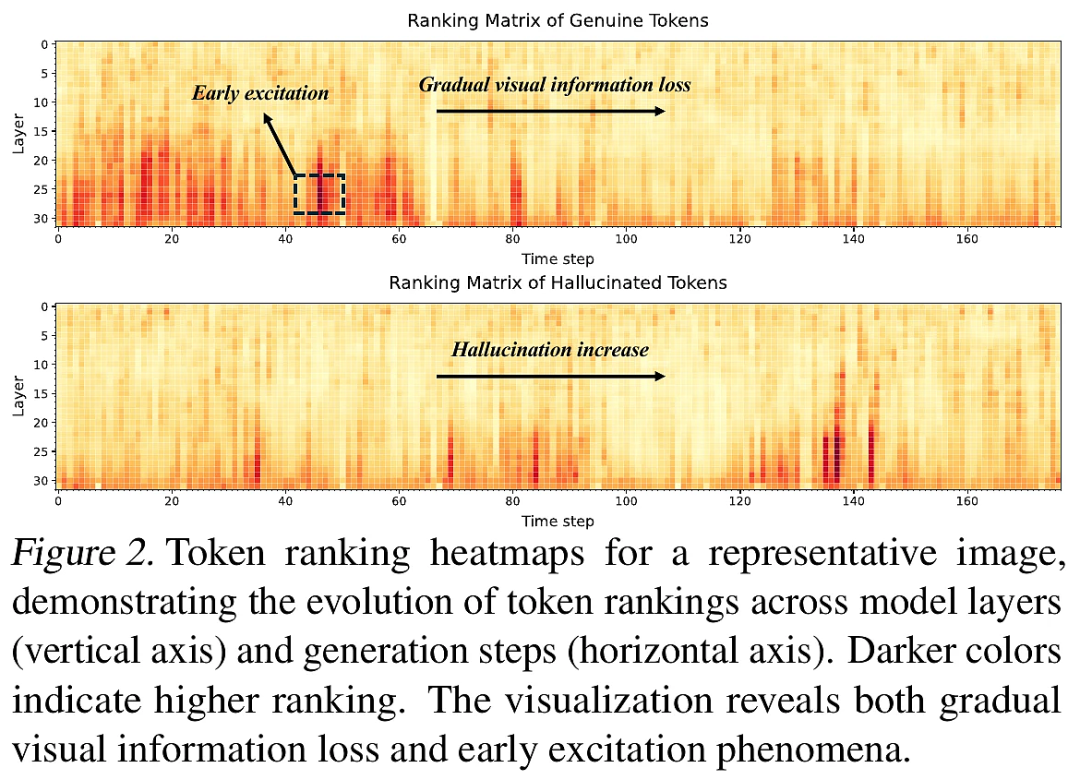

本研究通过分析LVLMs的内部动态,揭示了幻觉产生的根本原因。研究者们发现,幻觉的形成与以下几个因素密切相关:视觉信息在生成过程中的逐渐丧失、语义有效词汇的早期激活,以及隐藏的真实信息。这些发现为理解和解决LVLMs中的幻觉问题奠定了基础,并为未来的研究指明了方向。

研究方法与创新

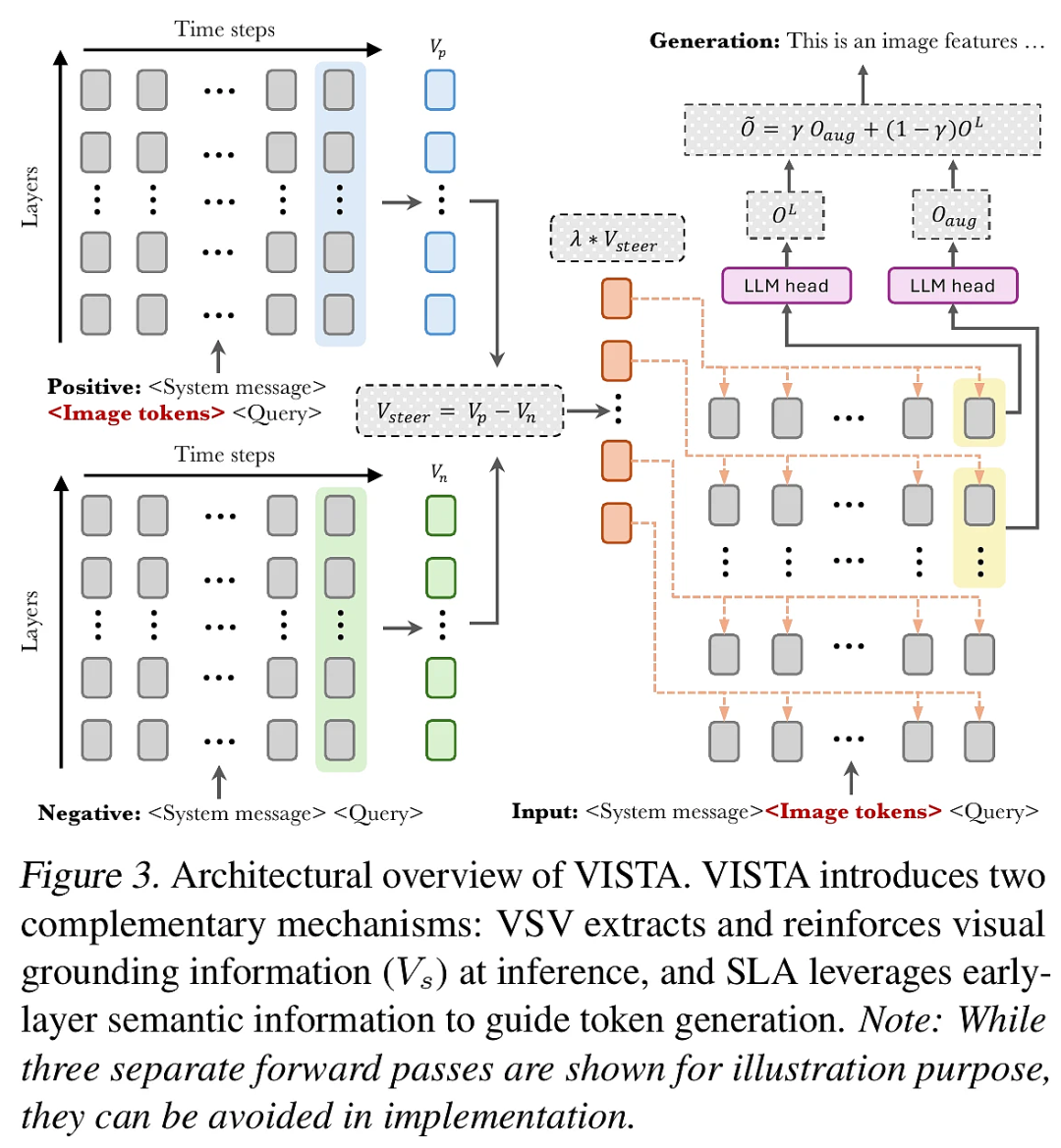

本研究提出了一种新的干预框架——视觉信息引导与标记逻辑增强(VISTA),旨在减少LVLMs的幻觉现象并促进真实信息的生成。VISTA的创新之处在于其无需额外训练,能够有效整合到现有的解码策略中。其核心机制包括两个互补模块:

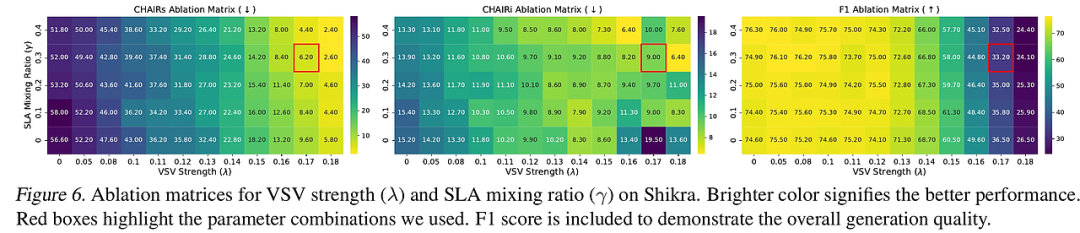

- 视觉引导向量(VSV):通过提取和强化视觉线索,抵消生成过程中的视觉信息丧失。

- 自标记增强(SLA):利用早期激活现象,优先考虑语义有效的标记,从而提升生成质量。

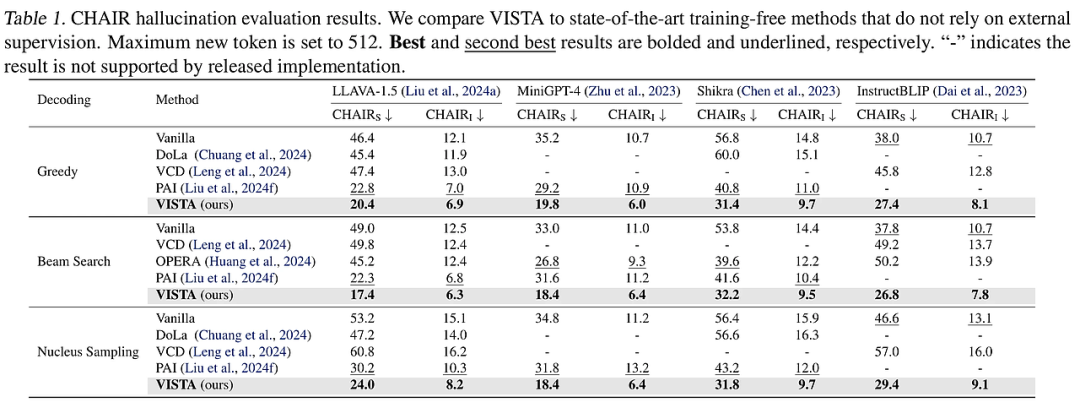

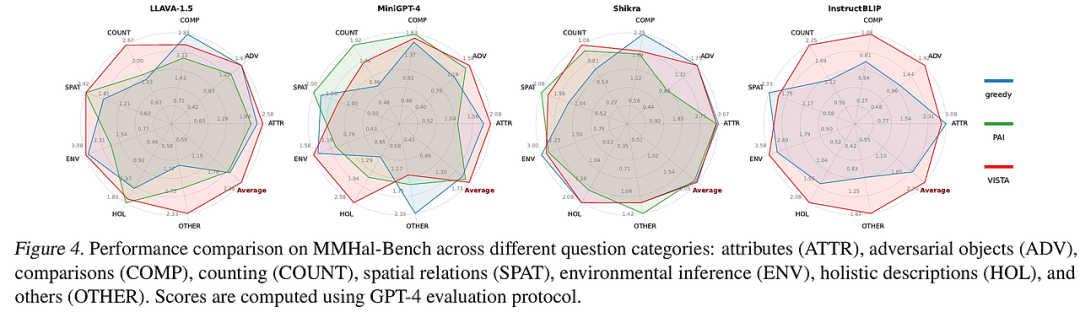

通过对比现有方法,VISTA在多个基准测试中表现出显著的优势,减少了约40%的幻觉现象,并在四个不同架构下的多个解码策略中均表现出色。

实验设计与结果分析

本研究通过综合实验设计评估VISTA的有效性,涉及四种架构和三种解码策略。实验结果显示,VISTA在减少幻觉方面的表现显著优于传统方法,尤其在开放式生成任务中,其表现提升尤为明显。

- 逐步视觉信息丧失:随着生成过程的进行,真实标记的排名逐渐下降,而幻觉标记的排名则逐渐上升。这一现象表明,语言优先的影响在生成的后期阶段显著增强。

- 早期激活:语义有效标记在倒数第二层的激活达到峰值,表明模型在最终决策阶段过于强调语法结构而非视觉信息。

- 隐藏真实信息:尽管某些真实标记未被最终解码,但在生成过程中仍保持较高的排名,表明模型可能感知到更多的视觉线索。

结论与展望

本研究的贡献在于提出了一种新颖的框架(VISTA),有效解决了LVLMs中的幻觉问题,促进了真实信息的生成。尽管取得了显著成效,但仍存在一些局限性,如对特定任务的适应性和模型复杂性等。未来的研究可以进一步探索VISTA在其他多模态任务中的应用潜力,并优化其在不同场景下的表现,以实现更高的生成质量和更强的模型鲁棒性。

通过本研究,期待为多模态人工智能的进一步发展提供新的视角与思路。