ICLR 2025 | One Prompt One Story!基于单个prompt实现免训练身份一致图像生成

文章链接:https://arxiv.org/abs/2501.13554

GitHub代码:https://github.com/byliutao/1Prompt1Story

项目主页:https://byliutao.github.io/1Prompt1Story.github.io/

亮点直击

- 首次分析了语言模型维持固有上下文一致性的能力,能够在一个提示中让多个帧的描述天然指代同一主体身份。

- 基于上下文一致性特性,提出了一种新颖的免训练方法——One Prompt One Story,用于实现一致的文本到图像生成。更具体地,进一步提出了提示加权(SVR)和交叉注意一致性(IPCA)技术,以改善文本与图像之间的对齐和主体一致性,使得每个帧提示能够在单个提示内独立表达,同时保持与身份提示一致的身份。

- 方法在生成图像时能够在长篇叙述中有效维护身份一致性,并在扩展基准测试中表现优异。

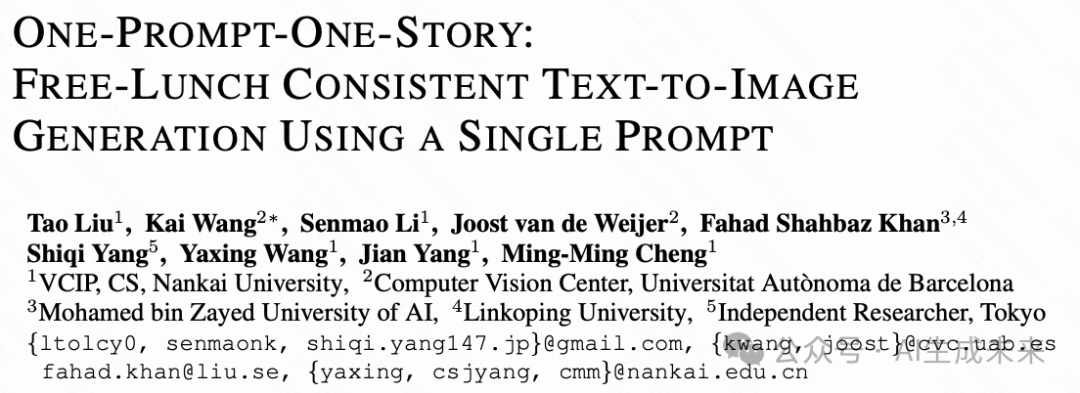

效果先睹为快

下图为One Prompt One Story的故事生成效果,在无需任何训练下就可以实现具有ID一致的多帧图片生成。

总结速览

解决的问题

- 文本到图像生成模型在支持故事叙述时难以保持身份一致性。

- 现有解决方案通常需要大量训练或对模型架构进行修改,限制了其适用性。

提出的方案

- 提出“单提示单故事”(1Prompt1Story)作为一种无需训练的方法,通过单一提示实现一致的文本到图像生成。

应用的技术

- 奇异值重加权(Singular-Value Reweighting)

- 身份保持的交叉注意力(Identity-Preserving Cross-Attention)

达到的效果

- 改善了文本-图像对齐和主体一致性。

- 在与现有方法的比较中,通过定量指标和定性评估展示了其在长篇叙述中保持身份一致性的有效性,并在扩展的ConsiStory+基准上进行了验证。

研究背景

基于文本的图像生成(T2I)旨在从文本提示中生成高质量的图像,以展示不同场景中的各种主题。在动画、故事叙述、视频生成模型及其他叙事驱动的视觉应用中,T2I扩散模型在多种场景中保持主体一致性的能力至关重要。然而,现有模型在生成一致性主体方面仍然面临挑战。最近基于训练的方法比如IP-Adapter, PhotoMaker通过训练一个Image encoder来注入身份信息,但这通常需要耗费大量时间,依赖于大型数据集进行训练或微调,并容易破坏基础模型本身的生成能力和文体图像一致性。

最近出现的无训练方法比如Consistory, StoryDiffusion通过在推理阶段的self-attention模块中共享不同图像之间的图像特征来生成具有强一致性的图像,取得了显著成果,但这类方法往往需要大量的显存资源或复杂的模块设计,并未充分考虑长提示中身份信息自然保持的固有特性。在这样的背景下,我们提出了一种名为“单提示单故事”(One-Prompt-One-Story)的新方法,通过将所有所需提示整合为一个更长的句子,实现了在无需额外调优或复杂设计情况下的图像生成一致性。通过进一步引入的技巧以改善文本和图像之间的对齐和主题一致性,1Prompt1Story在生成图像时能够有效维护长叙述中的身份一致性。

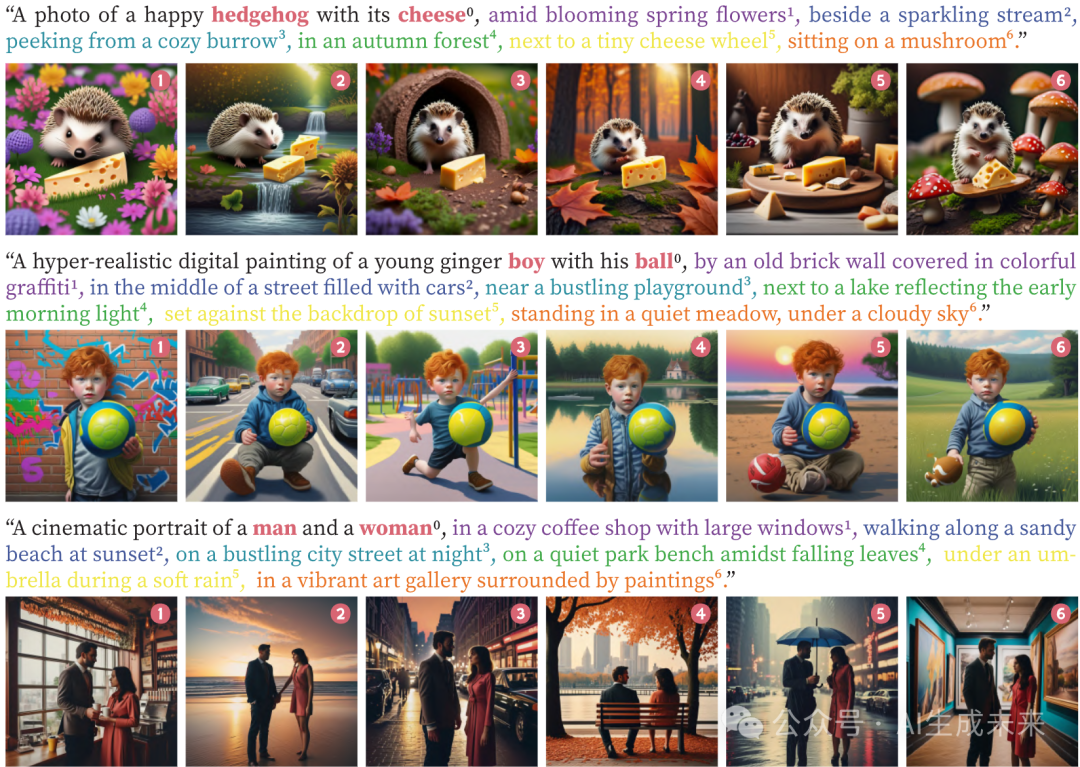

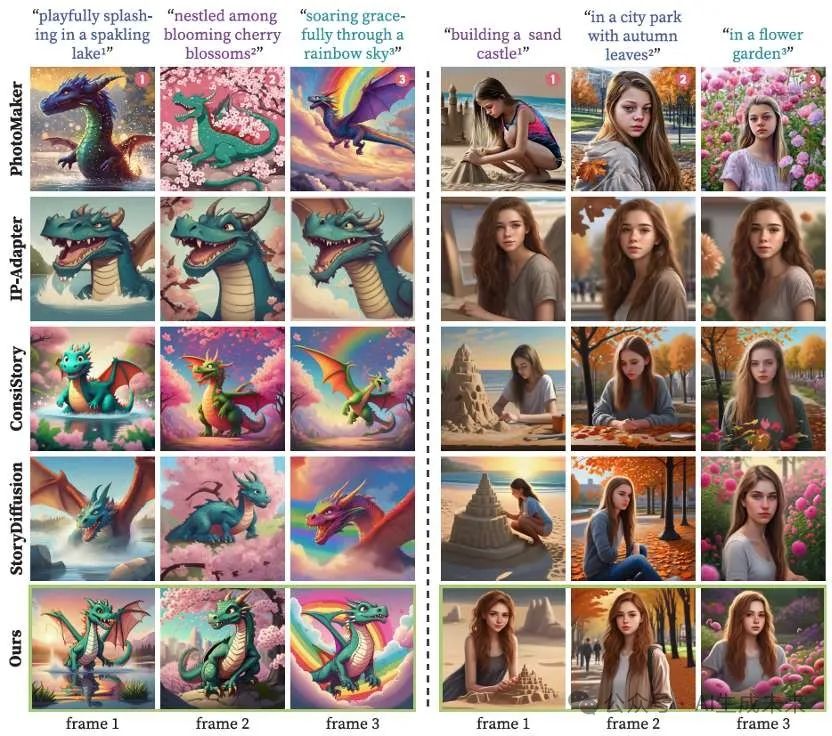

如下图所示,现有方法在一致的文本到图像生成方面面临挑战。像SDXL(Podell等,2023)和Juggernaut-X-v10(RunDiffusion,2024)这样的T2I模型在生成的图像中常常表现出明显的身份不一致。尽管包括IP-Adapter和ConsiStory在内的最新方法已改善了身份一致性,但它们在生成图像与相应输入提示之间的对齐性上有所缺失。我们的方法1Prompt1Story(倒数第一列)所示的额外结果证明了在不影响文本与图像之间对齐的情况下,能够实现更优越的身份一致性生成。

单个prompt中的身份一致性分析

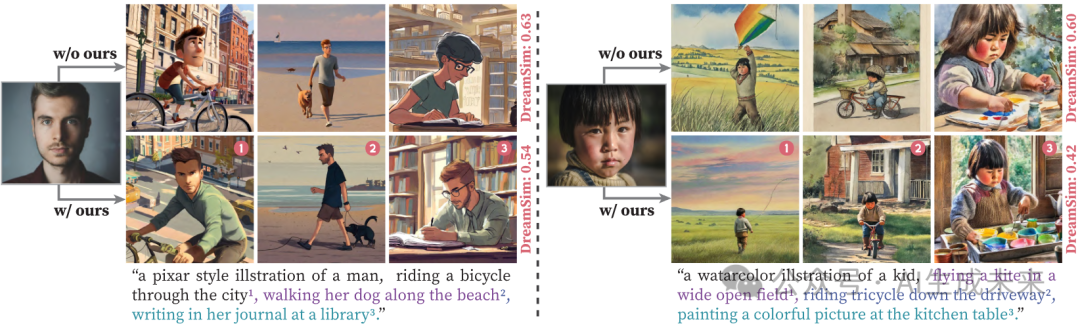

在文本嵌入一致性的分析中,本文比较了single prompt生成与multi prompt生成在语义距离上的差异,并通过t-SNE进行二维可视化。研究结果显示,single prompt生成中的各帧提示的文本嵌入更加紧密,平均L2距离为46.42,而multi prompt生成的散布更广,距离为71.25。这表明single prompt生成在语义信息和身份一致性方面更具优势。

在图像生成方面,采用multi prompt生成的SDXL模型往往会生成缺乏身份一致性的角色。相较之下,通过“Naive Prompt Reweighting(NPR)”方法,利用串联的single prompt生成可以在图像帧中保持主体身份的一致性。这种方法在身份一致性和文本-图像对齐上比multi prompt生成表现更佳。此外,1Prompt1Story方法在保持身份特征一致性方面更加出色,通过DINO-v2提取的视觉特征并使用t-SNE进行可视化证实了这一点。这些发现也在ConsiStory+基准中得到验证,表明single prompt生成在身份一致性上明显优于multi prompt生成。这说明在生成内容时,通过采用合适的方法整合提示,可以显著增强语义和身份的一致性。

上面左图显示了SDXL通过multi-prompt生成方法生成的图像帧,而Naive Prompt Reweighting(NPR)和我们的方法则采用了single-prompt设置。中图展示了通过DINO-v2提取的图像特征,并通过t-SNE可视化。Naive Prompt Reweighting和1Prompt1Story相比SDXL模型表现出更一致的身份生成。右图展示了我们扩展的ConsiStory+基准中生成图像特征的平均距离统计,进一步确认了1Prompt1Story在身份一致性方面表现更加出色。

方法

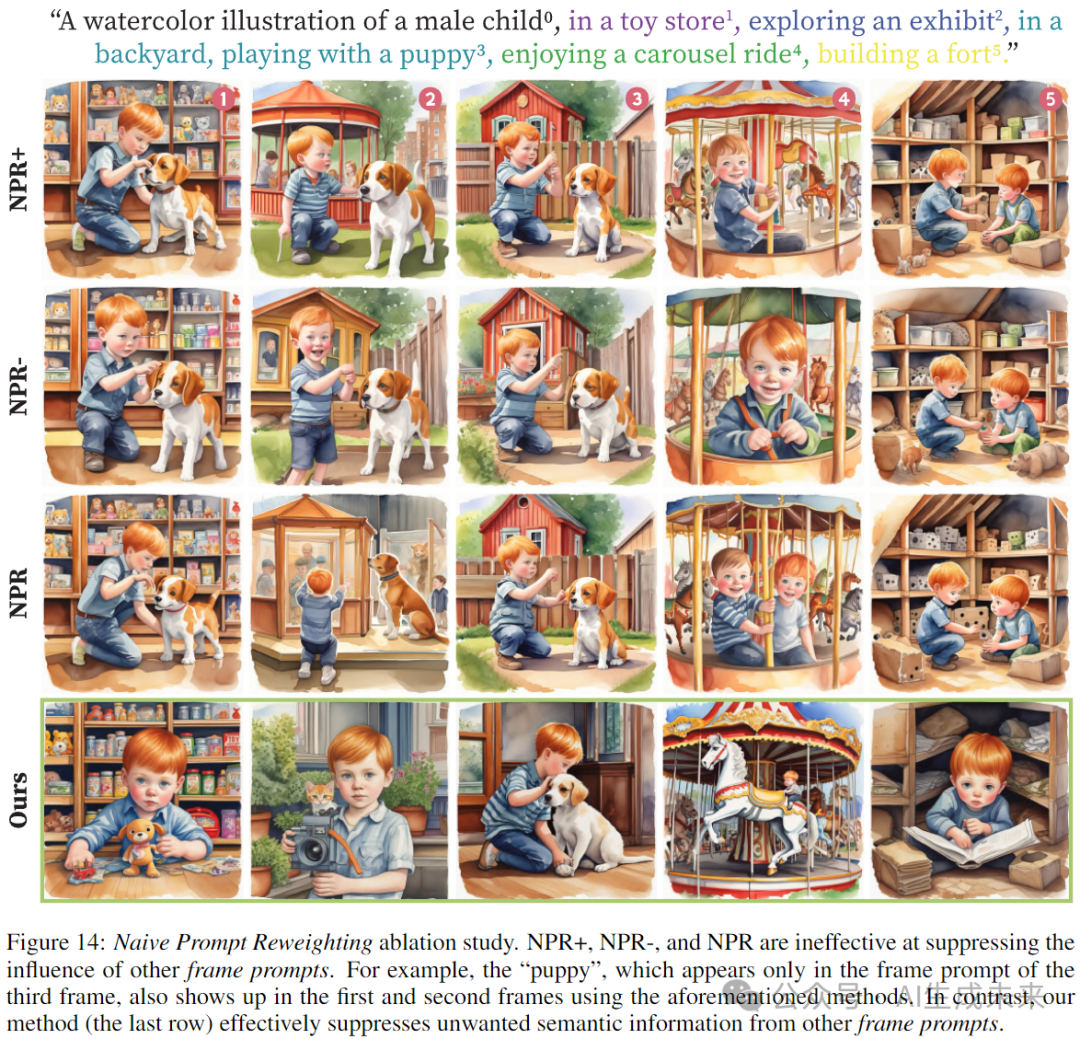

Naive Prompt Reweighting

我们可以轻松实现一种基础方法,称为Naive Prompt Reweighting(NPR),以提高文本到图像(T2I)生成的性能。通过放大需要表达的帧对应的prompt embedding的权重,缩小需要抑制的帧对应的prompt embedding的权重,生成的图像即可具备一定的身份一致性。然而,这种方法存在两个明显的问题:一是生成的图片之间背景较为相似,二是身份的一致性还不够。这是因为在text encoder的因果掩码机制下,每个单词对应的embedding都会包含前面所有单词的信息,而EOT则包含整个句子的信息。因此,NPR无法完全消除其它帧prompt的影响,并且简单的权重调整也会对embedding中的身份信息产生干扰。为了解决这些问题,我们提出了SVR和IPCA方法,可以更有效地剔除无关帧的prompt信息影响,并提高身份一致性。

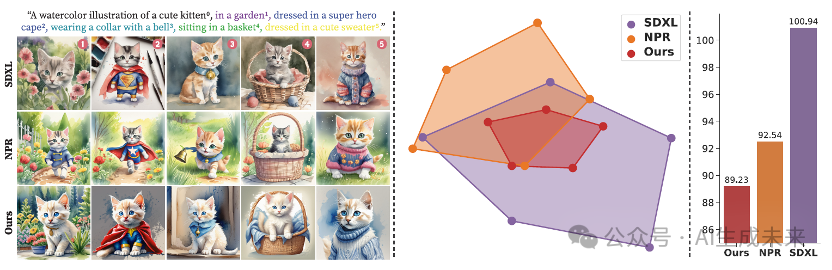

1Prompt1Story

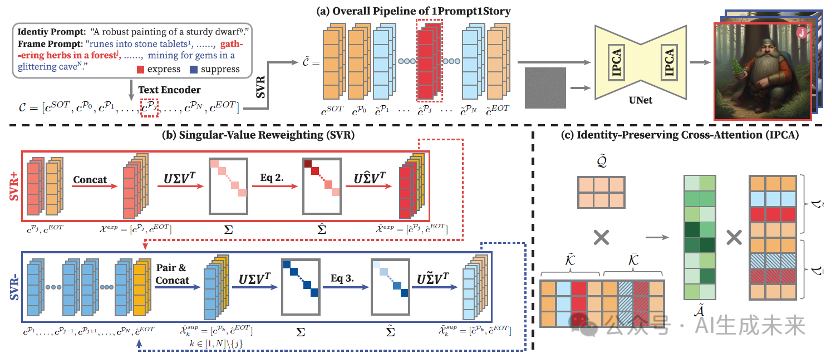

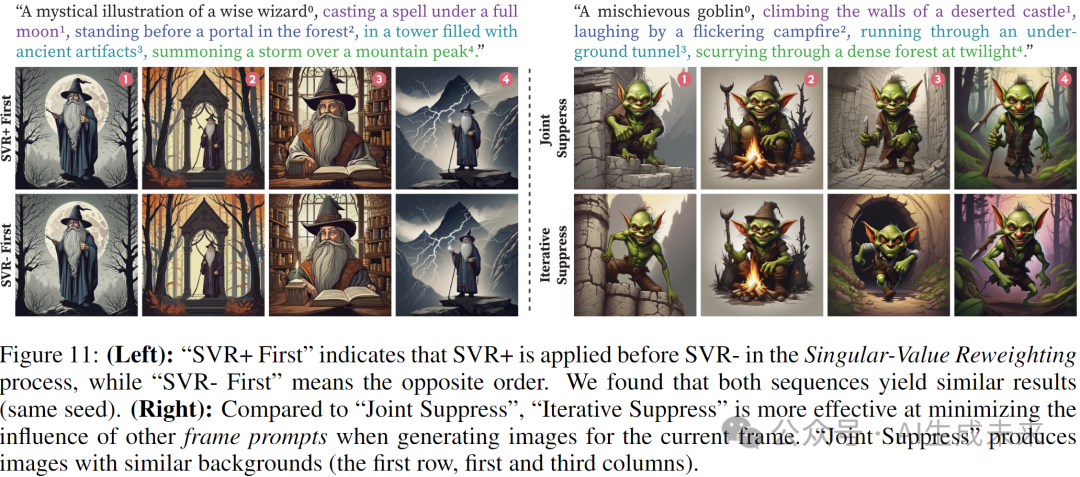

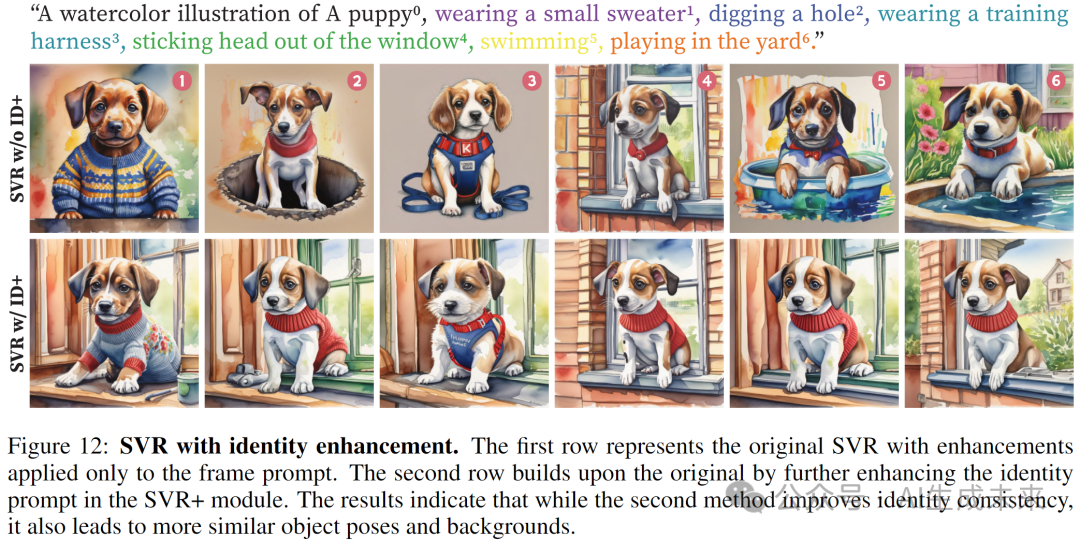

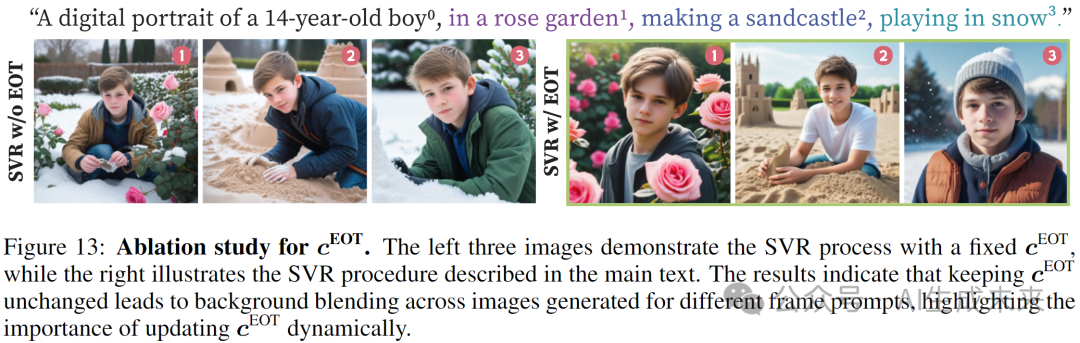

如上图所示,a区域展示了1Prompt1Story的整体流程。我们将身份提示和帧提示结合为一个single prompt,随后应用奇异值重新加权(SVR)和身份保持交叉注意(IPCA)以生成身份一致的图像。b区域描述了SVR的过程,我们首先增强需要表达的frame prompt的语义信息(红色箭头所示),然后迭代地弱化抑制需要抑制的frame prompt的语义信息(蓝色箭头所示)。c区域则展示了IPCA的过程,我们通过在cross attention中引入原始single prompt的embedding中的ID信息,与当前生成的帧的embedding feature进行融合(也就是对KV进行concat),从而提升身份一致性。

实验

在上图中,我们展示了定性比较结果。我们的1Prompt1Story方法在多个关键方面表现出色,包括身份保留、精确的帧描述以及物体姿态的多样性。相比之下,其他方法在这些方面存有不足。具体来说,PhotoMaker、ConsiStory和StoryDiffusion在左侧示例中生成的“龙”这一主体显示出身份不一致的问题。此外,IP-Adapter倾向于生成姿态重复、背景相似的图像,常常忽略帧提示的细节描述。ConsiStory在一致的文本到图像生成过程中也表现出背景重复的现象。此外,我们还与其他方法进行了定量比较。我们的方法1Prompt1Story在CLIP-T(文本-图像对齐)得分上接近于原始SDXL模型。在身份一致性方面(通过DreamSim指标衡量),我们的效果仅次于IP-Adapter。然而,IP-Adapter的高身份相似性主要是因为它倾向于生成姿态和布局相似的角色图像。如下图所示,我们的方法1Prompt1Story位于图的右上角,显示出在文本-图像对齐和身份一致性方面都有良好的表现。

应用

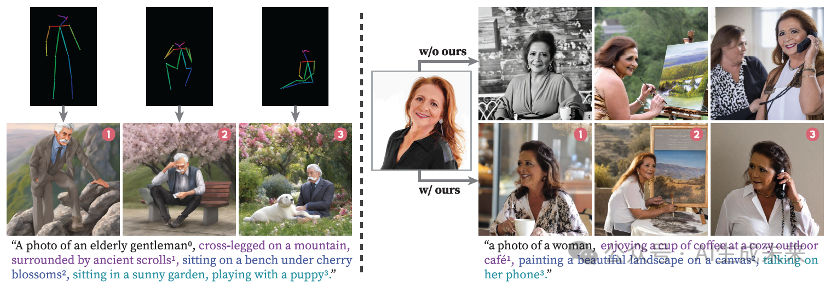

1Prompt1Story不仅能够身份一致性生成,还能与现有的基于控制的生成方法(如ControlNet (Zhang & Agrawala, 2023))进行结合。如上图(左)所示,我们的方法通过ControlNet有效通过控制生成角色的姿态。此外,我们的方法可以与其他基于训练的方法(如PhotoMaker (Li et al., 2023b))相结合,以提高图像与真实参考图像的身份一致性。通过采用我们的方法,所生成的图像更贴近于真实身份,如上图(右)所示。

结论与展望

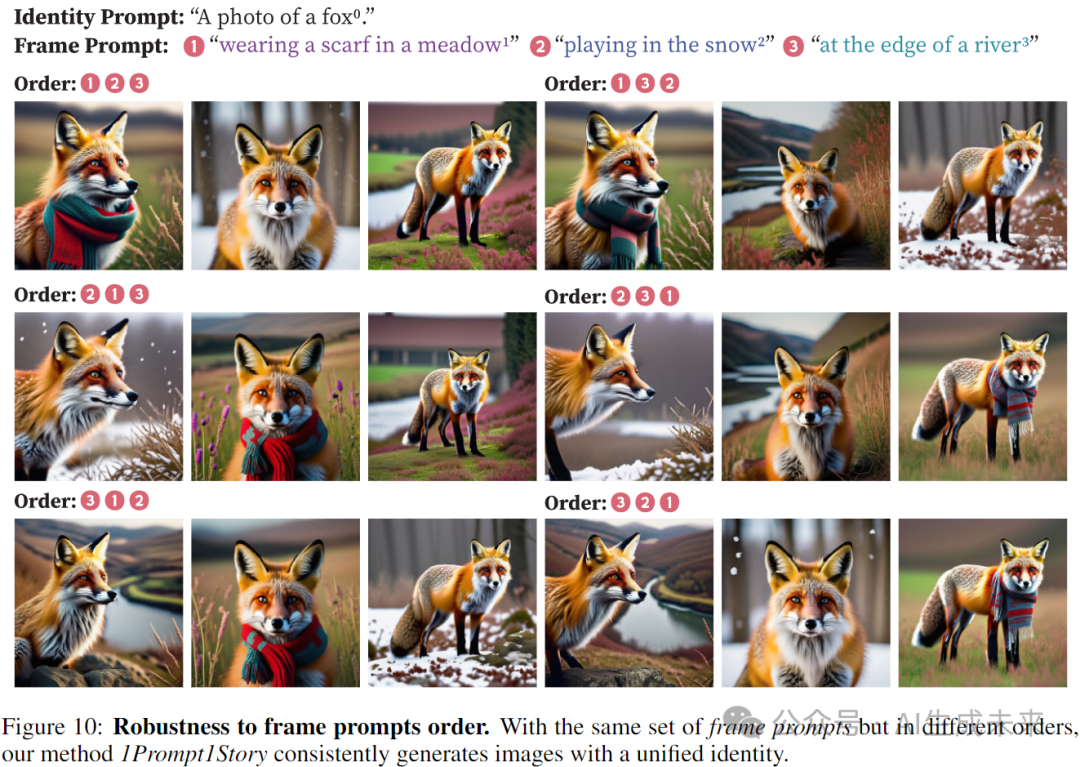

在这篇论文中,我们通过利用自然语言中固有的上下文一致性特性,解决了文本到图像(T2I)生成中保持主体一致性的关键挑战。我们提出的“One-Prompt-One-Story(1Prompt1Story)”方法,采用单一扩展提示,确保在多样化的场景中实现身份的一致性。通过整合奇异值重加权和身份保持交叉注意力等技术,该方法不仅优化了帧描述,还在注意力层面增强了一致性。实验结果在ConsiStory+基准测试中显示出1Prompt1Story优于当前最先进技术,展现了其在动画、互动叙事和视频生成中的应用潜力。我们的研究强调了在T2I扩散模型中理解上下文的重要性,为实现更连贯和叙述一致的视觉输出开辟了新路径。

附加消融实验

本文转自AI生成未来 ,作者:AI生成未来