回复

FineMedLM-o1: 基于监督微调与测试时训练的医学推理增强型大语言模型 精华

一、研究背景与意义

近年来,大语言模型(LLMs)在医疗领域的应用展现出巨大潜力,特别是在疾病诊断和治疗规划等方面。然而,现有的医学大语言模型在处理复杂临床场景时,往往难以进行深度推理,尤其是在差异化诊断和个性化治疗建议等方面存在明显短板。本研究提出的FineMedLM-o1模型,通过创新性地结合高质量合成医学数据和长格式推理数据,采用监督微调(SFT)和直接偏好优化(DPO)技术,显著提升了模型的医学推理能力。

二、技术创新与方法

2.1 整体架构

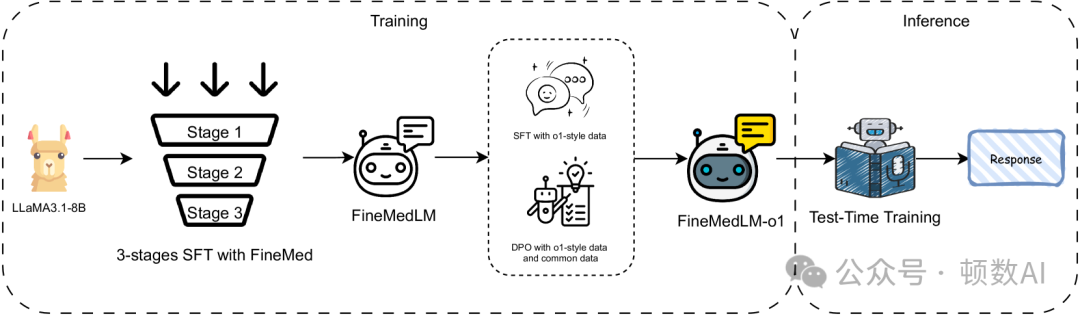

FineMedLM-o1的训练流程包含三个主要阶段:

- 基于合成医学对话数据的细粒度三阶段SFT

- 基于复杂指令和o1风格响应的进一步微调

- 使用普通响应和o1风格响应进行DPO训练

2.2 数据合成与处理

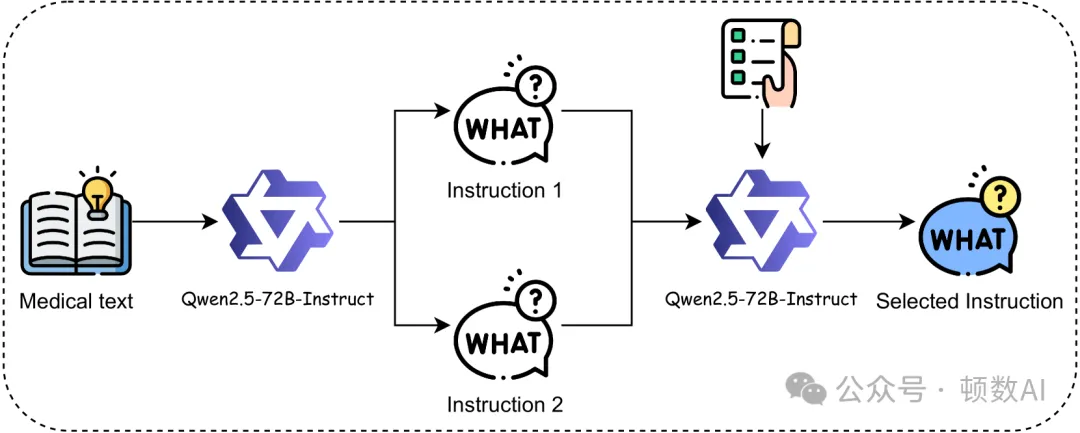

研究团队开发了一套创新的数据合成方法,主要包括四个步骤:

- 指令生成:使用Qwen模型为每个医学文本生成两个不同的指令

- 指令评分:基于预定义标准对指令进行1-10分的质量和复杂度评分

- 指令过滤:通过多步骤过滤确保指令质量

- 响应生成:针对不同复杂度的指令采用不同的响应生成策略

2.3 创新点

- 测试时训练(TTT)技术

- 首次在医学领域引入TTT技术

- 通过动态适应领域知识提升推理可靠性

- 实验证明可带来额外14%的性能提升

- 三阶段SFT策略

- 第一阶段:使用20万个全医学领域样本进行训练

- 第二阶段:从内科子集选取3.6万个样本进行训练

- 第三阶段:从内分泌科选取1.1万个样本进行精细训练

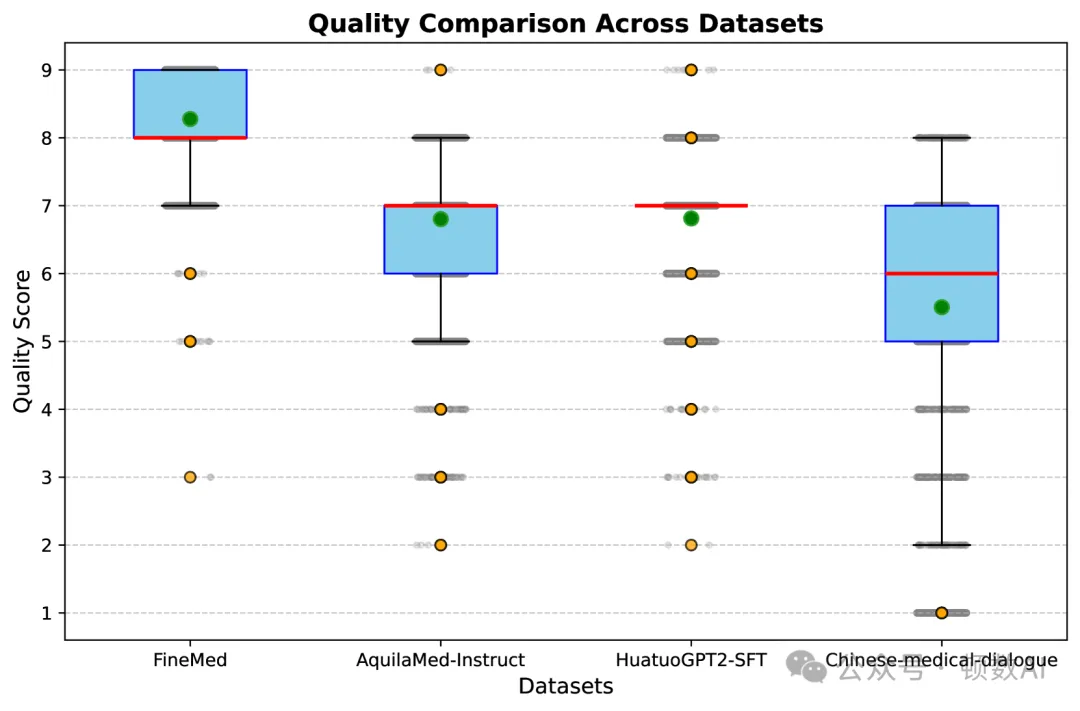

- 高质量数据集构建

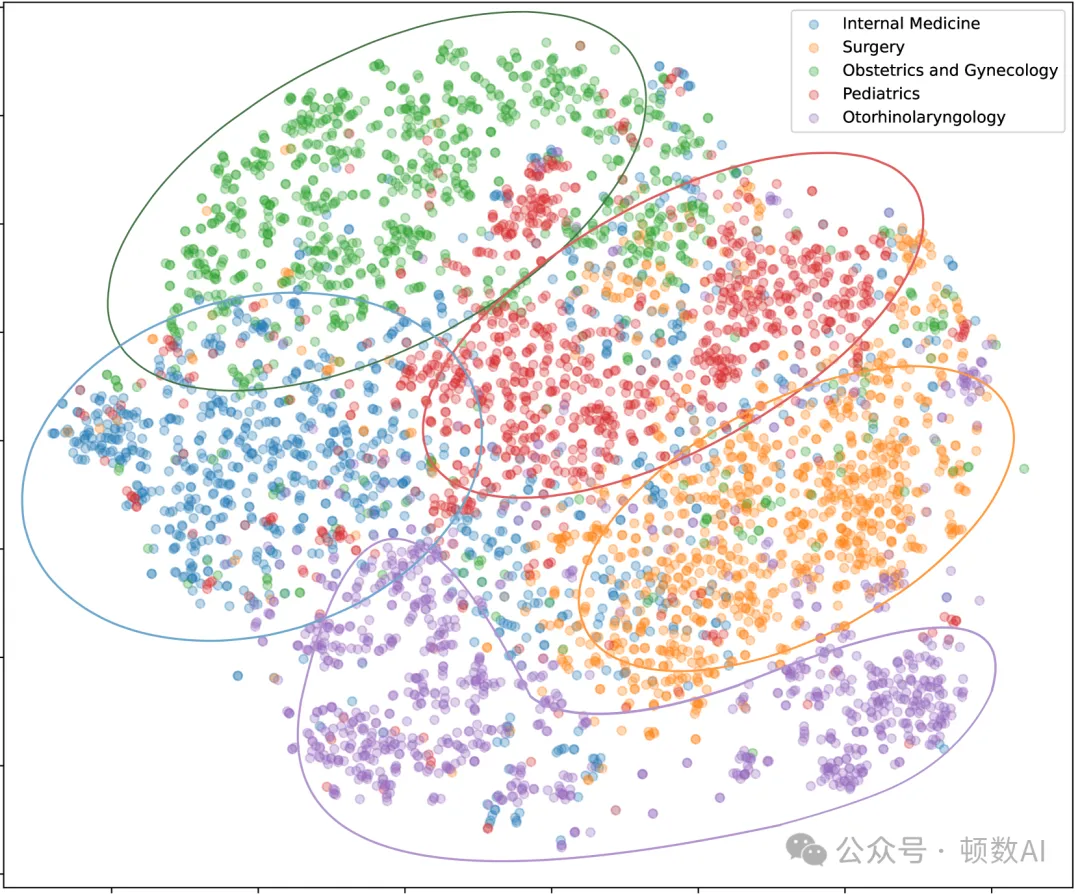

- 开发了FineMed数据集,包含5个主要医学类别和29个二级类别

- 通过严格的质量控制确保数据的专业性和复杂性

- 在质量和复杂度评估中优于现有开源医学数据集

三、实验结果与分析

3.1 基准测试性能

在标准医学基准测试中:

- 相比基础模型LLaMA3.1-8B平均提升12%

- 在MMLU-Pro医学子集上比FineMedLM提升27个百分点

- 引入TTT后,性能可与GPT-4o-mini相媲美

3.2 三阶段SFT效果验证

通过对比实验证明三阶段SFT的优势:

- 相比直接训练方法最高提升15%

- 证实了从通用到专科的渐进式训练策略的有效性

四、应用价值与局限性

4.1 应用价值

- 临床决策支持

- 提供更准确的鉴别诊断建议

- 支持个性化治疗方案制定

- 提升复杂医疗场景的处理能力

- 医学教育培训

- 可用于医学生培训

- 提供标准化的临床推理训练

- 支持医学知识的深度学习

- 研究与开发

- 开源数据集促进医学AI研究

- 提供医学LLM评估基准

- 推动医学AI技术创新

4.2 局限性

- 数据限制

- 原始医学文本选择未经质量预评估

- 样本数量相对有限

- 需要更大规模高质量数据支持

- 技术瓶颈

- 计算资源限制影响模型规模

- DPO阶段仍有优化空间

- 需要开发更适合医学域的强化学习算法

五、未来展望

- 数据质量提升

- 扩大高质量医学数据规模

- 优化数据筛选和评估机制

- 增强数据的多样性和代表性

- 算法优化

- 开发专门的医学域强化学习算法

- 改进TTT技术的效率

- 探索新的模型架构

- 应用拓展

- 深化临床实践集成

- 扩展多语言支持

- 开发专科化模型

六、总结

FineMedLM-o1通过创新的数据合成方法、三阶段SFT策略和首创的医学域TTT技术,显著提升了医学大语言模型的推理能力。该研究不仅推动了医学AI技术的发展,也为后续研究提供了宝贵的经验和资源。尽管仍存在一些限制,但其展现的潜力和创新性使其成为医学AI领域的重要里程碑。

论文地址:https://arxiv.org/abs/2501.09213

项目地址:https://github.com/hongzhouyu/FineMed

赞

收藏

回复

相关推荐