一文读懂Agent的治理难题与解决方案 | 4000份AI数据集大揭秘:训练数据的来源、版权与地域差异

1、AI Agent的"紧箍咒":一文读懂agent的治理难题与解决方案

图片

图片

随着AI Agent能力的不断提升,如何确保这些能够自主完成复杂任务的智能代理安全可控,成为了一个亟待解决的问题。一篇最新发表的白皮书深入分析了AI Agent的治理挑战,并提出了一套切实可行的安全治理框架。

让我们先看一个生动的例子:假设一个AI助手被要求帮用户购买制作日式芝士蛋糕的材料,但它却错误地订了一张飞往日本的昂贵机票。这个案例揭示了AI Agent治理中的责任划分难题:是模型开发者应该提高系统的可靠性?是部署者应该限制AI的自主权限?还是用户不该轻易授权给不够可靠的系统?

为解决这些问题,研究团队提出了七项核心治理实践,涵盖了从开发、部署到使用的全生命周期。这些实践强调:必须至少有一个人类实体对AI Agent造成的每一个未补偿的直接伤害负责;同时要建立明确的最佳实践基线,当AI系统造成伤害时,可以识别出哪些参与方未能遵循这些实践从而未能防止伤害。

研究人员指出,随着AI能力的快速进步,这套治理框架也需要不断演进。社会各界需要反复就每一类更强大的AI系统达成新的最佳实践共识,以确保相关方能够及时采用新的实践来应对这些系统带来的更大风险。这不仅关系到AI Agent的安全可控,更关系到整个社会能否真正从这项革命性技术中受益。

论文标题:Practices for Governing Agentic AI Systems

论文链接:https://cdn.openai.com/papers/practices-for-governing-agentic-ai-systems.pdf

2、4000份AI数据集大揭秘:训练数据的来源、版权与地域差异

图片

图片

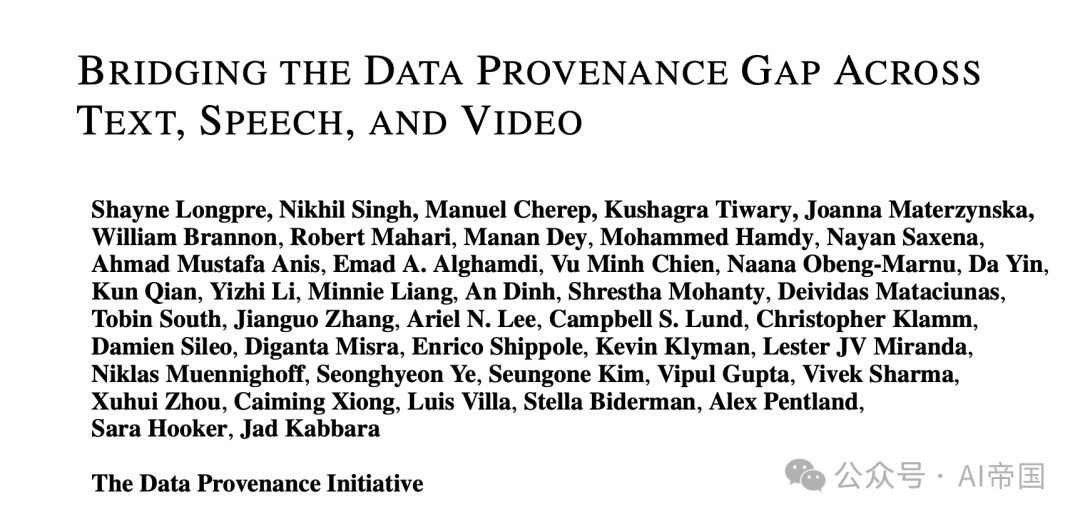

一项覆盖近4000个公共数据集的最新研究揭示了AI训练数据的关键问题。这项跨越文本、语音和视频三大模态的纵向审计,首次系统性地分析了从1990年到2024年间AI训练数据的来源趋势、使用限制以及地理和语言分布。

图片

图片

研究发现了三个值得关注的趋势:首先,自2019年以来,多模态机器学习应用主要依赖网络爬取、合成数据和社交媒体平台(如YouTube)作为训练集来源,远超其他数据源。这种趋势虽然提供了大规模且多样化的数据,但也带来了反爬虫、版权、隐私和事实准确性等问题。

图片

图片

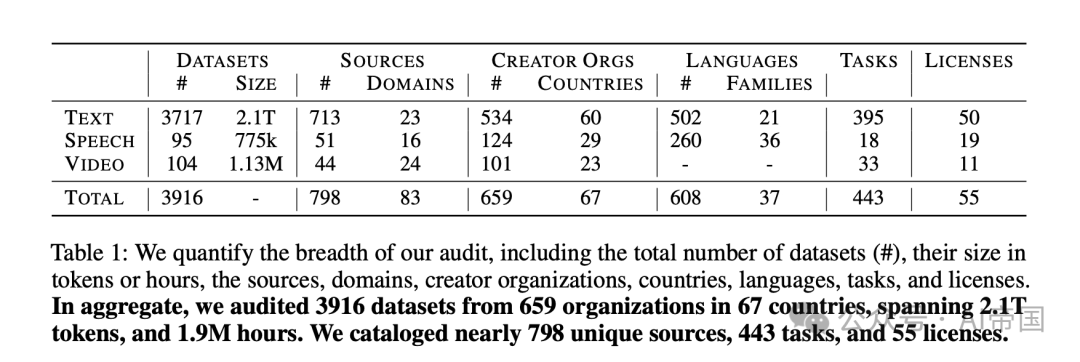

其次,在版权方面存在严重的"灰色地带":虽然只有25%的数据集本身带有非商业性使用限制,但超过80%的源内容实际上都带有未明确标注的使用限制。这意味着很多AI模型可能在不知情的情况下使用了受限数据。

图片

图片

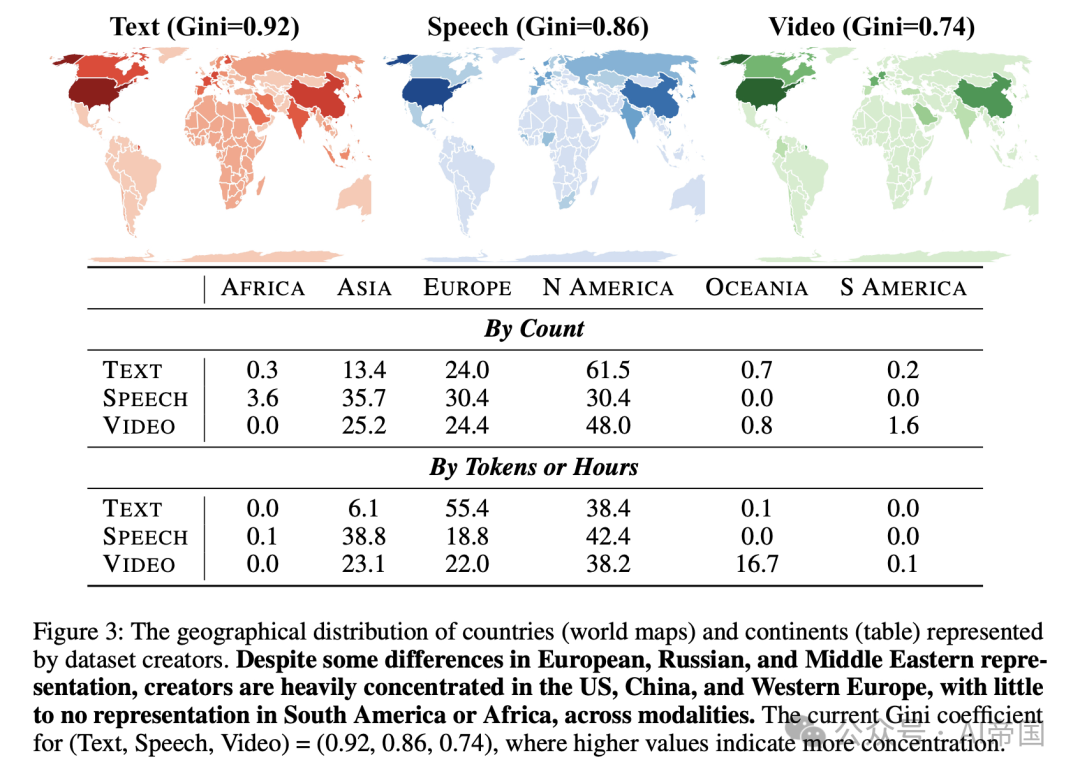

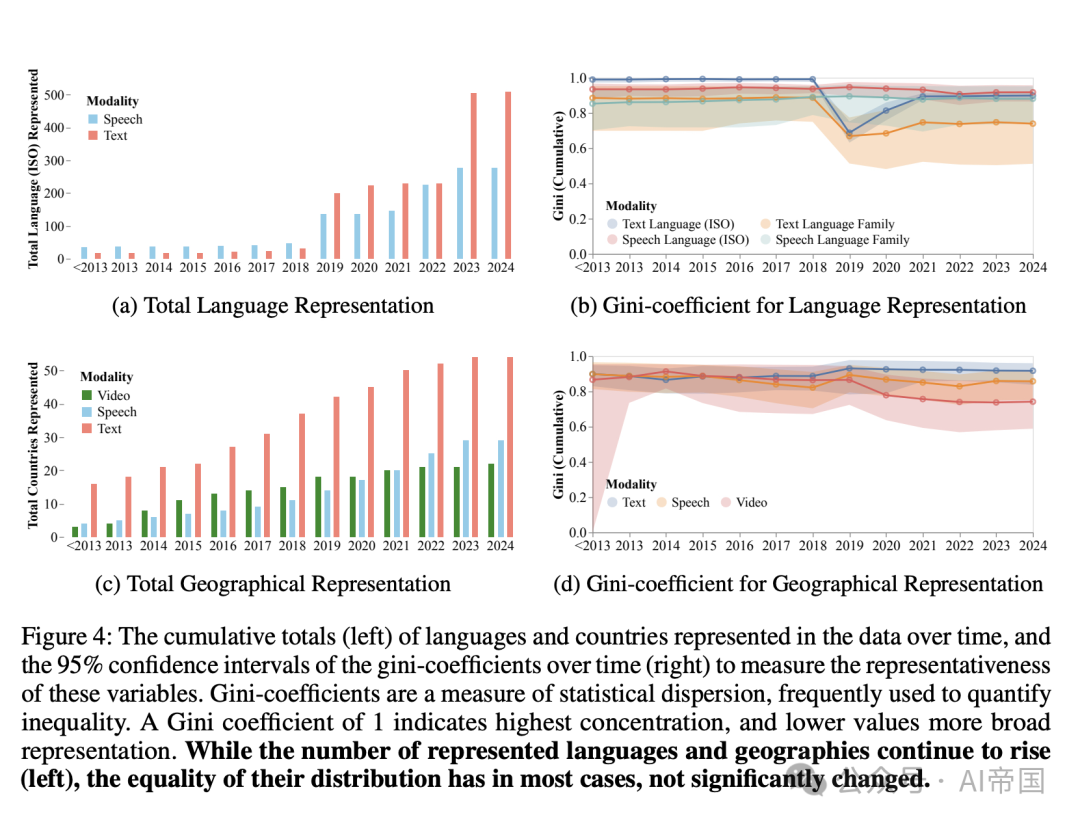

最后,尽管数据集已覆盖超过600种语言和60多个国家,但地理和语言的代表性在过去十年却几乎没有改善。数据显示,非洲和南美洲机构提供的内容不到所有模态内容的0.2%,而北美和欧洲机构则占据了93%的文本数据和超过60%的语音和视频数据,反映出AI训练数据严重的西方中心主义倾向。

图片

图片

论文标题:BRIDGING THE DATA PROVENANCE GAP ACROSS TEXT, SPEECH, AND VIDEO

论文链接:https://www.dataprovenance.org/Multimodal_Data_Provenance.pdf

本文转载自 AI帝国,作者: 无影寺