RAG检索增强生成和大模型微调的抉择 原创

“ RAG和微调即相似,又不完全相同,它们在能力上是互补的。”

很多人会奇怪RAG和微调有什么关系,而对RAG和微调了解的人应该都明白为什么会把RAG和微调放在一块讨论。

有些人说有了RAG就不需要微调,而另一些人说有了微调就不需要RAG,这到底是怎么回事?RAG和微调之间到底存在什么样的恩恩怨怨?

RAG与微调

作者在第一次看到RAG和微调的标题时,也是一脸懵逼;RAG和微调有什么关系,它们完全是两种不同的技术,为什么会被放在一块讨论?

而随着对大模型了解的加深,慢慢就发现RAG和微调却是有很大的关联,只不过两者的关系并不是很多人所认为的一山不容二虎,而是可以相互依存的关系。

看过前面介绍RAG文章的人应该都知道,RAG技术的出现是为了解决大模型存在的几个问题;而微调的出现是为了解决大模型在某些方面的不足。

从这一点来说,两者还是有很大共同点的;老话说条条大路通罗马,虽然两者的目的是一样的,但道路却是不一样的;这也是为什么会有RAG与微调技术的争论。

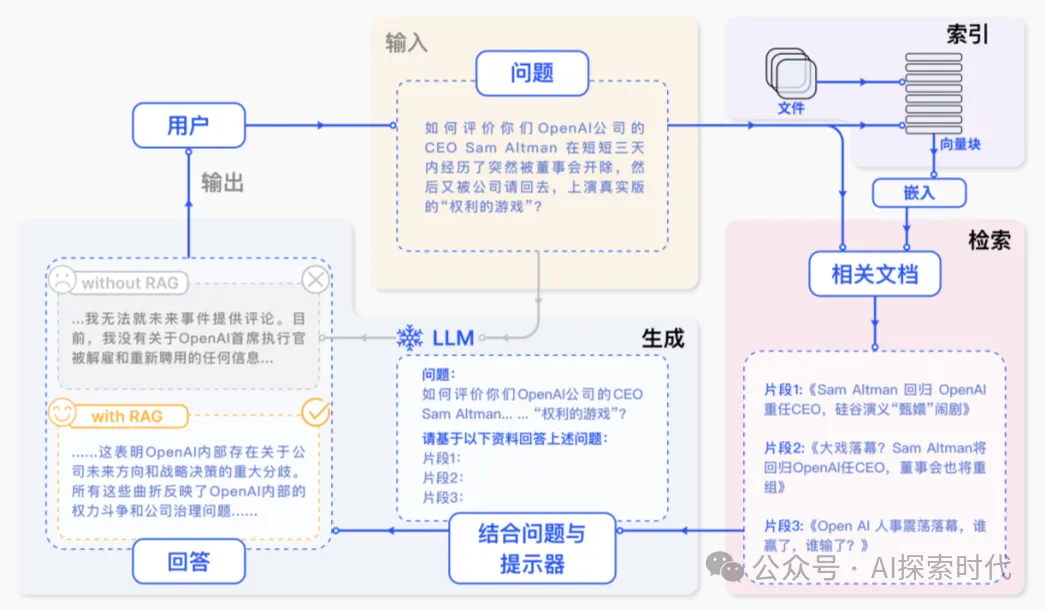

RAG的本质是通过检索外部资料库获取数据,并通过prompt提示词的方式输入到大模型中;其更像是一种外部工具,就类似于我们所使用的一些工具书,遇到不懂的东西就查一下,但也没必要刻意去记忆和理解。

而微调的本质是通过训练数据对大模型在某一方面进行强化;比如一个识图的大模型,可以强化一下让它在宠物方面有更好的效果;微调就类似于技能培训,其影响并不是一时的,而是终身的。

比如说一个文本模型,它在历史方面比较欠缺,这时就有两种解决办法;第一种就是使用RAG技术,遇到历史问题的时候先通过RAG检索一些资料;第二种就是微调技术,找到一堆历史数据,然后通过微调的方式让大模型去学习这些数据。

这两种方式不论使用哪一种都可以达到目的,但两者还有有所区别;比如说RAG技术的优点是成本低,耦合度低;一个文本模型使用RAG检索历史数据,那么它就是一个精通历史的大模型。而如果使用RAG检索科学数据,那么它就是一个科学家。

而微调模型,使用什么样的微调数据,大模型就会成为什么样的模型;同样的例子,如果使用历史数据进行微调,那么这个模型就只擅长历史方面的内容;你问它其它方面的知识,它就只能胡说八道了;或者就是再收集一批数据重新对模型进行微调;因此,微调的方式耦合度高,成本也高。

所以说,RAG就类似于一个掌握了学习方法论的学霸,不论什么内容,什么领域,因为他掌握了好的学习方法,所以他学什么都很快;而微调就类似于一个靠勤奋死记硬背的学霸,虽然他在某一方面很擅长,但因为没有掌握具体的学习方法;一旦换个领域,它就只能从头再来了。

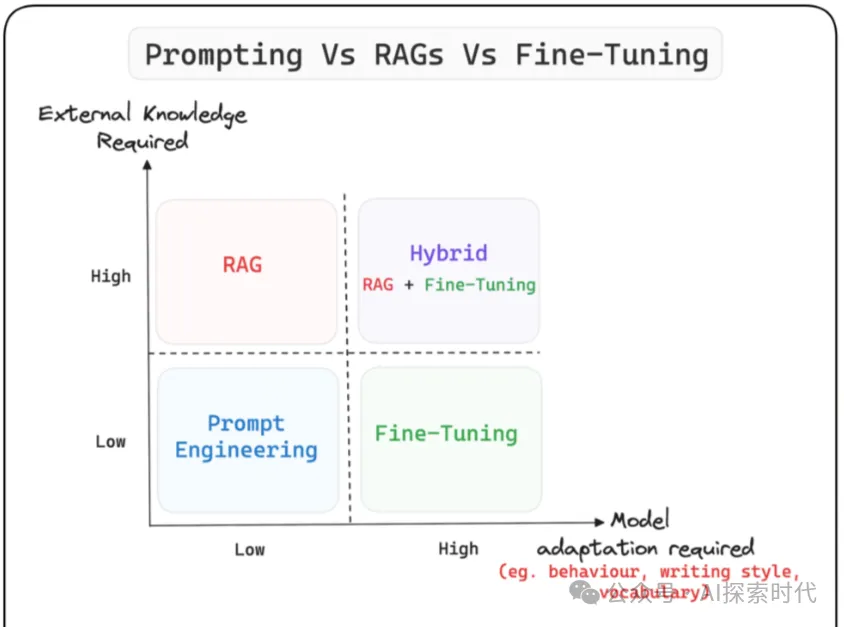

然而,从应用的角度来说RAG和微调并不是水火不容的关系,很多时候往往需要两者配合使用。

比如说由于微调的成本比较高,因此我不可能因为一点新知识就对模型微调或训练一次;这时RAG就成为了一个很好用的工具。

同样,我不能因为我的工具比较多,就代表我的能力也比较强,然后就不想再学习了;虽然利用RAG可以让大模型解决很多问题,但这并不代表着大模型就拥有了强大的思维能力。

比如说你想搞一个用来搞科研的大模型,你不可能让一个只会查资料(RAG)的大模型去搞科研,因为你需要它能具备思考,实验和推理的能力,而不只是查资料的能力;这时,微调的作用就出现了,因为微调可以让大模型具备更好的知识和逻辑思维能力。

所以说,从某些方面来说RAG和微调解决的是同一个问题;但在其它方面,RAG能做到的事情,微调做不到;而微调能做到的事情RAG做不到。

因此,RAG和微调最好的协作方式就是互补;而不是针尖对麦芒。

本文转载自公众号AI探索时代 作者:DFires