大模型长文本所面临的主要问题 原创

“ 大模型上下文窗口的根本问题,是大模型的记忆问题”

在上一篇文章中主要介绍了大模型的上下文窗口,以及其与RAG技术的关系与区别;而事实上,大模型上下文窗口面临着更加复杂的问题,因此今天就来详细讨论一下这个问题。

大模型长文本

大模型(如 GPT-4、GPT-3.5、BERT 等)处理长文本时面临一些特殊的挑战和技术细节。对于 长文本 的处理,常见的问题包括模型的输入长度限制、生成质量控制、计算资源消耗等。以下是一些关于大模型处理长文本的要点:

1. 输入长度限制

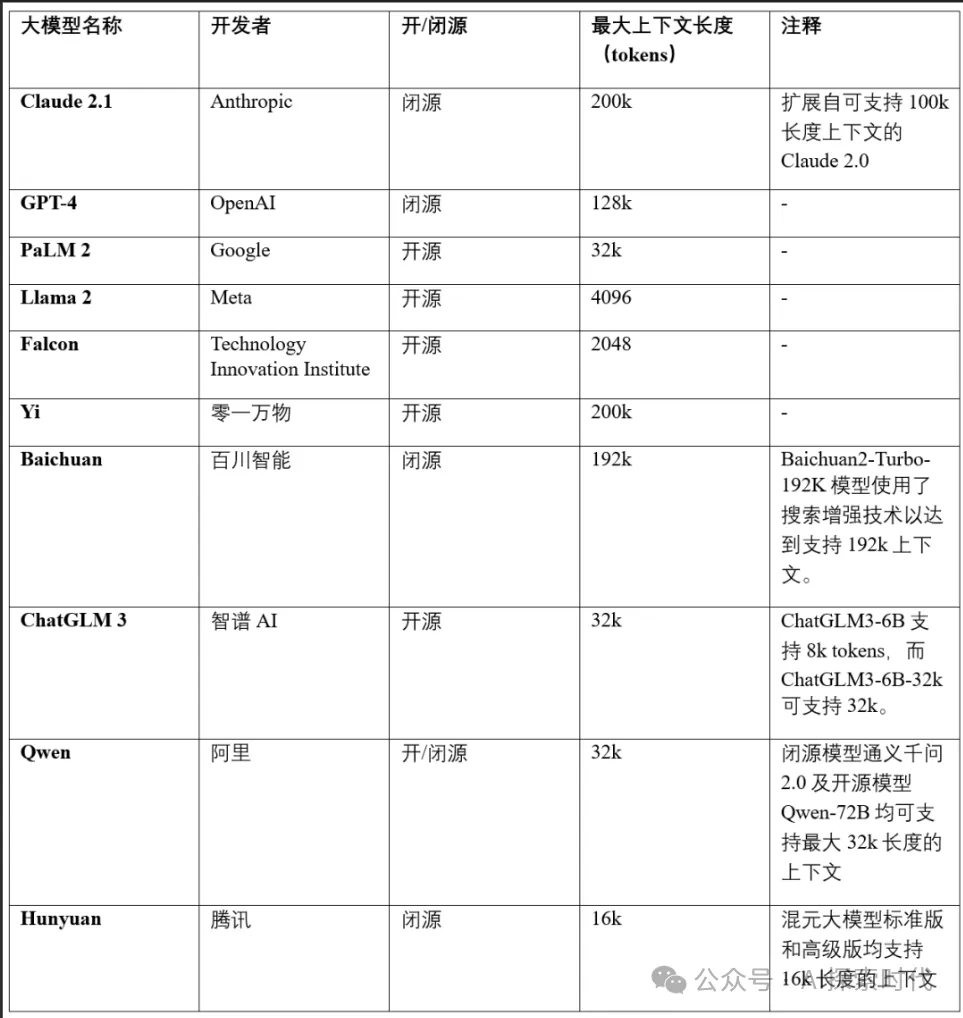

大多数大语言模型(如 GPT、BERT 等)对输入的长度有一定的限制。以 GPT 系列为例,GPT-3 的最大输入长度通常为 2048 tokens(tokens 是模型处理的最小单位,可以是一个词、一部分词或者符号等)。而 GPT-4 等一些更先进的模型可能支持更长的输入长度,通常可达到 4096 tokens 或更多。

超过这个长度的文本需要被裁剪或分段处理。

- 解决方案:

截断:如果文本超出模型支持的最大长度,通常会截断到最大长度,丢失一部分信息。

分段处理:将长文本拆分成多个子段,每个段落单独输入模型,然后通过后处理将结果组合。

窗口化:使用一个滑动窗口,将长文本分为多个重叠的部分,每次处理一个窗口并获得相关信息。

2. 长文本生成与推理的挑战

在生成长文本时,大模型可能会丧失上下文的连贯性,尤其是当输入文本较长且模型只关注局部上下文时。生成的文本可能缺乏一致性,或者前后内容有明显的脱节。

- 解决方案:

增量生成:可以逐步生成文本,即每次生成一段,然后将生成的内容作为上下文提供给模型,逐渐扩展文本的长度。

精心设计的提示词(Prompt Engineering):对于需要生成长文本的任务,可以设计更合理的提示词,引导模型生成连贯的内容。

模型微调:可以对模型进行微调,使其适应生成长文本的任务,尤其是在特定领域或者特定样式的文本生成中。

3. 计算资源消耗

处理长文本需要更高的计算资源,因为模型需要处理更多的 tokens,计算成本随之增加。特别是当模型对每个 token 进行自注意力计算时,计算复杂度通常是 O(n²),其中 n 是 tokens 的数量。

- 解决方案:

分布式计算:利用分布式训练和推理框架,分担计算压力。

稀疏化技术:一些新型模型,如 稀疏自注意力机制,旨在减少计算量,可以处理更长文本。

4. 长文本的摘要与信息抽取

对于长文本的处理,有时并不是希望生成完整的长文本,而是对长文本进行摘要、关键词提取、情感分析等任务。大模型在这种任务中同样面临文本长度的挑战。

- 解决方案:

抽取式摘要:通过模型提取长文本中的关键信息并生成简短的摘要。

生成式摘要:使用生成模型对长文本进行总结和重写,生成一个简洁的摘要。

5. 上下文的丧失和记忆问题

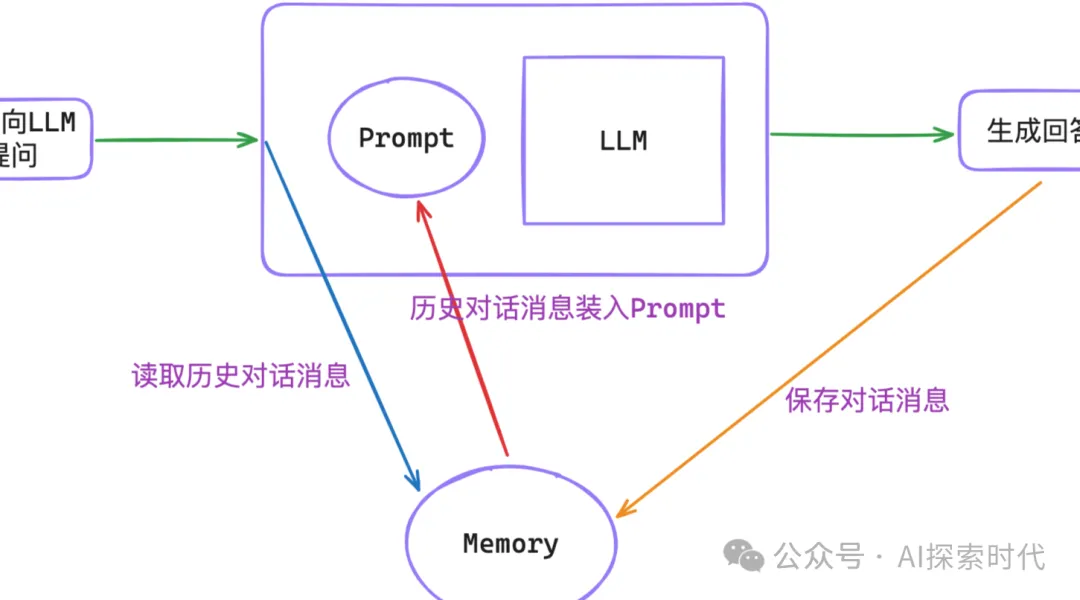

对于长文本,尤其是跨段落、跨章节的文本,模型可能在处理时丧失上下文信息。即使是 GPT-4 等较为强大的模型,依然会面临“记忆衰减”的问题,即前面生成的内容对后面生成的内容影响较小,尤其是在长段文本的生成中。

- 解决方案:

结构化输入:将长文本分成结构化的部分,例如段落、章节等,在每个部分内保留上下文信息。

外部记忆机制:结合外部存储(如数据库或缓存机制)来“记住”之前的上下文,提高模型在处理长文本时的表现。

6. 具体应用场景中的长文本处理

根据不同的应用场景,长文本的处理方式和技术细节也会有所不同。以下是几种常见的场景和相关技术:

长文本问答(Long-Form Question Answering)

- 问题:如何从一个长篇文章中提取出问题的答案?

- 解决方案:采用分段式处理或基于上下文的增强型问答模型。可以将文章分为若干段,每次处理一个段落,并结合推理能力生成正确答案。

长文本生成(Long-Form Text Generation)

- 问题:如何生成一篇长篇文章,确保内容连贯?

- 解决方案:使用增量生成或分段式生成方法。每次生成一段内容,然后根据生成的内容继续生成后续内容。

长文本摘要(Long-Form Text Summarization)

- 问题:如何从长篇文章中提取出关键信息?

- 解决方案:采用抽取式摘要或生成式摘要方法,确保对关键信息的提取和整合。

总结

处理大模型的长文本任务时,最大的挑战通常是 输入长度限制、计算资源消耗、以及 上下文保持。可以通过分段处理、滑动窗口、外部记忆机制等方法来解决这些问题,并且结合不同的应用需求选择适当的技术手段来确保模型能够有效地处理和生成长文本。

本文转载自公众号AI探索时代 作者:DFires