一文搞懂AI大模型的四个核心技术

在日新月异的生成式AI领域,几个核心的专业术语不仅频繁出现在讨论、报告和会议中,更是技术发展的关键驱动力。它们分别是:“Prompt Engineering(提示工程)”、“Function Calling(函数调用)”、“RAG(检索增强生成)”和“Fine-tuning(微调)。

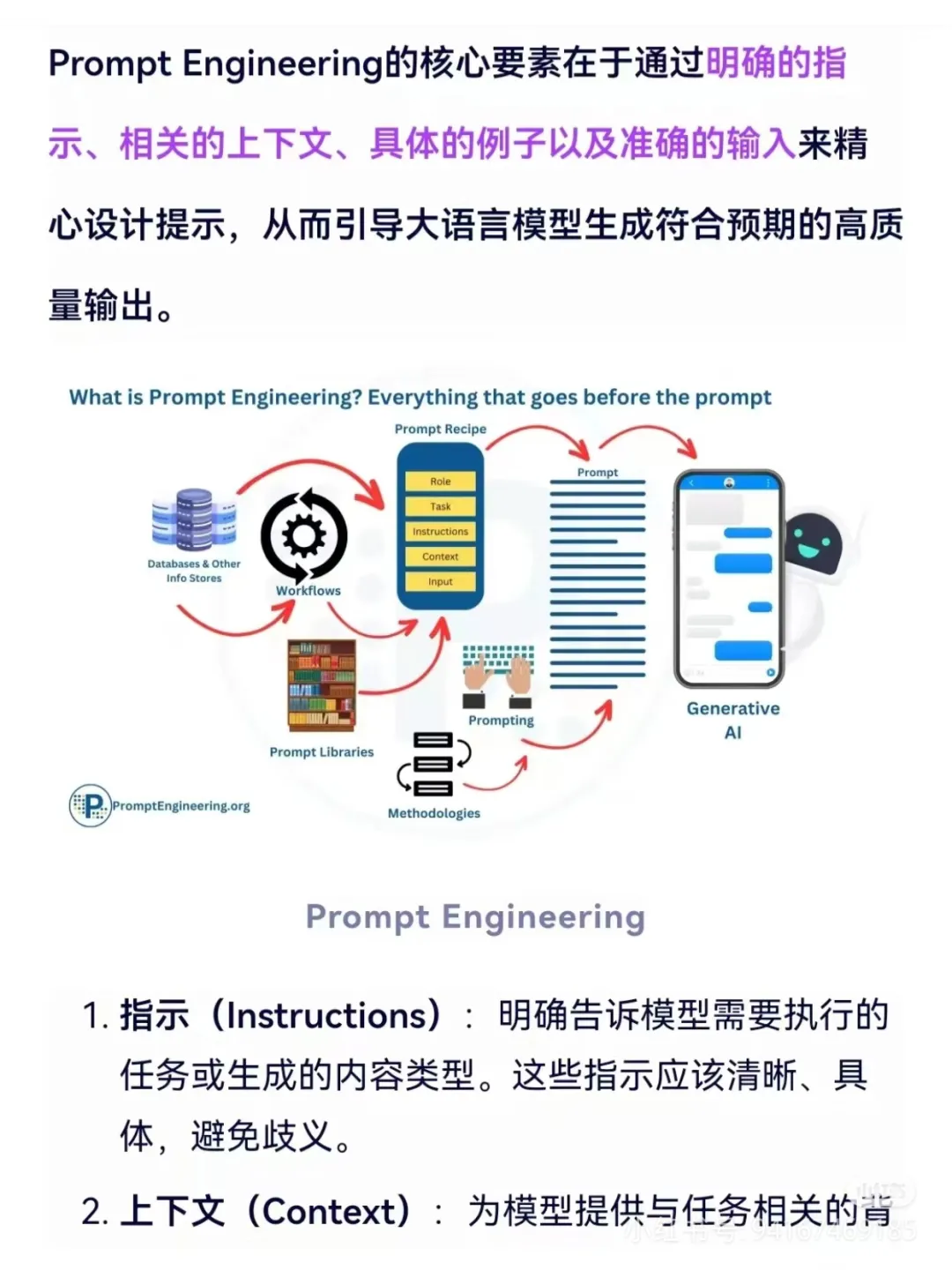

• Prompt Engineering(提示工程):

提示工程是一种技术,通过设计、实验和优化输入提示词(Prompt)来引导预训练语言模型生成所需响应或完成特定任务。它的核心在于通过精确的提示词,明确告诉模型需要执行的任务、提供的背景信息、期望的输出格式等,从而引导模型生成高质量、准确的输出。

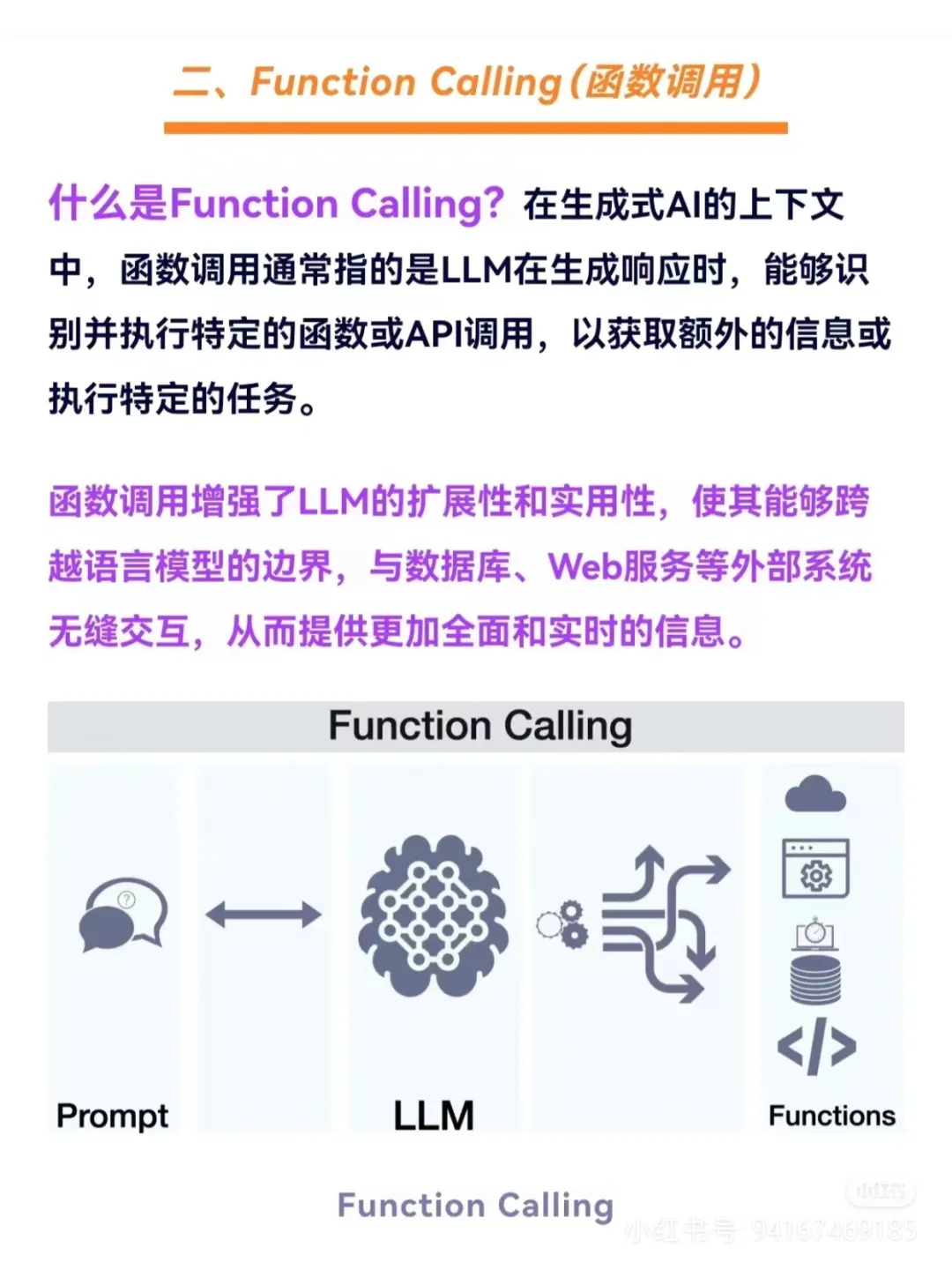

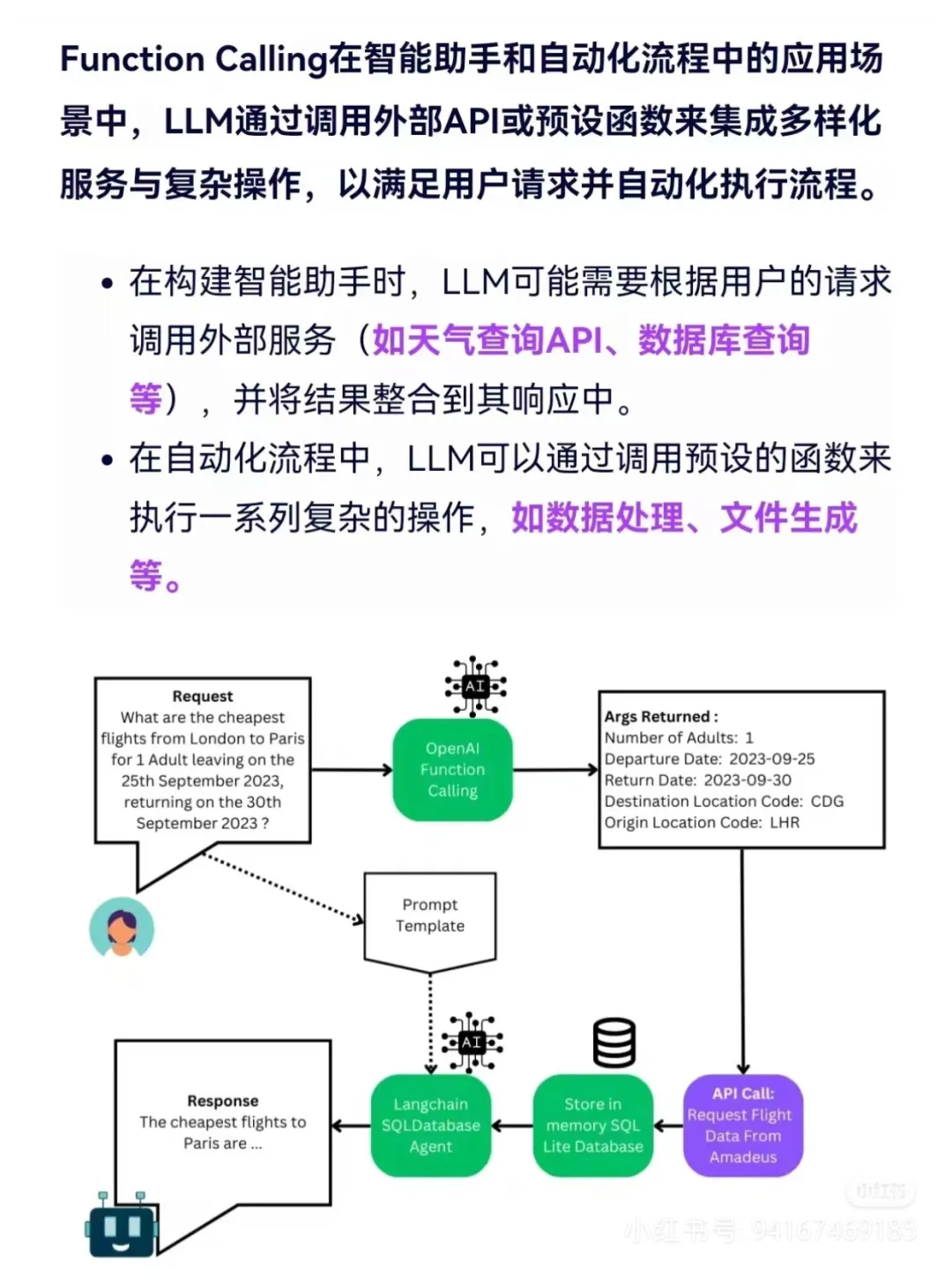

• Function Calling(函数调用):

函数调用是一种能力,允许大型语言模型在生成文本的过程中调用外部函数或服务。它涉及将用户的自然语言请求转换为可执行的函数调用,并生成符合预定义函数签名的结构化输出,如JSON对象。函数调用使您能够更可靠地从模型中获取结构化数据。

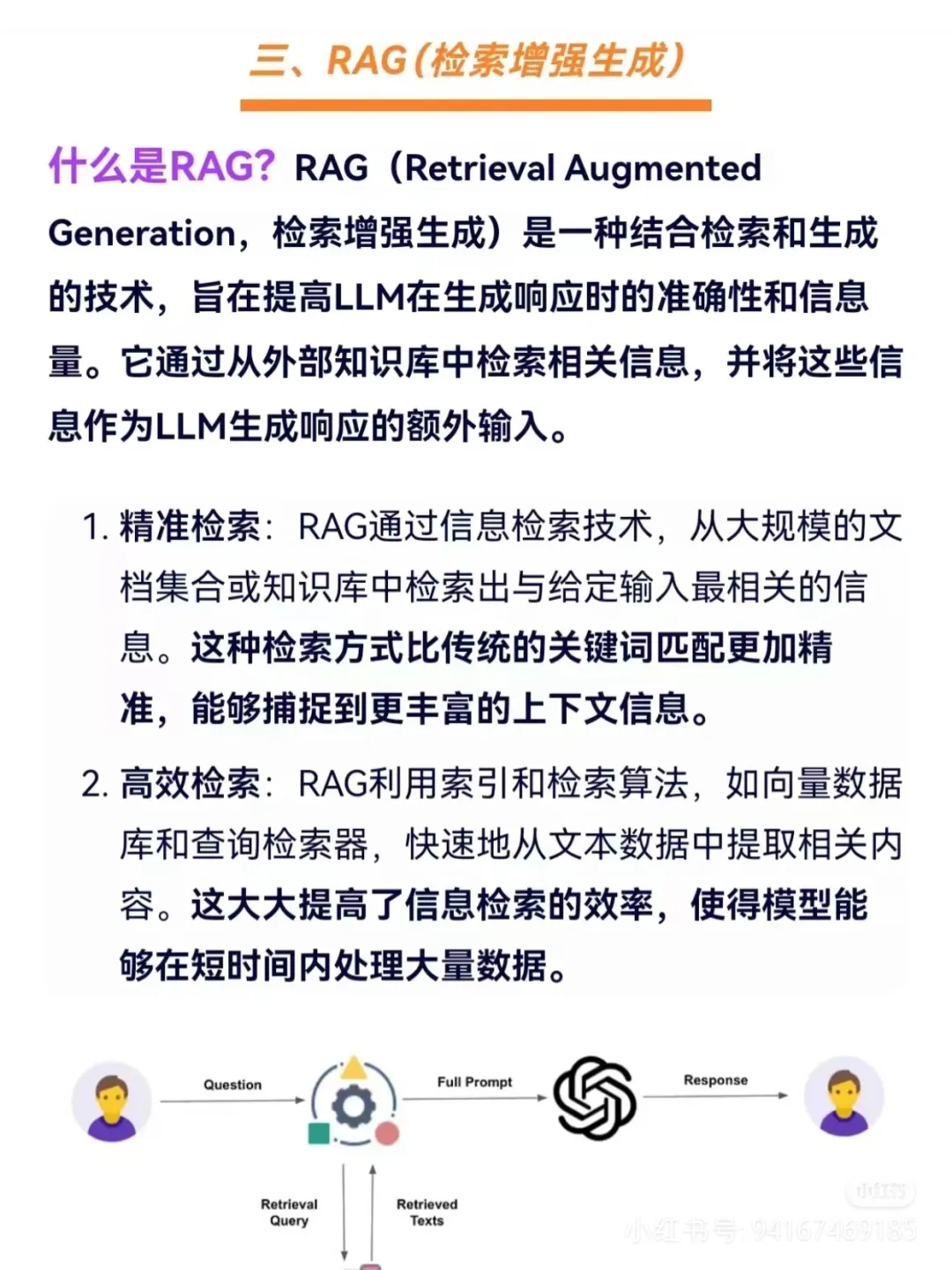

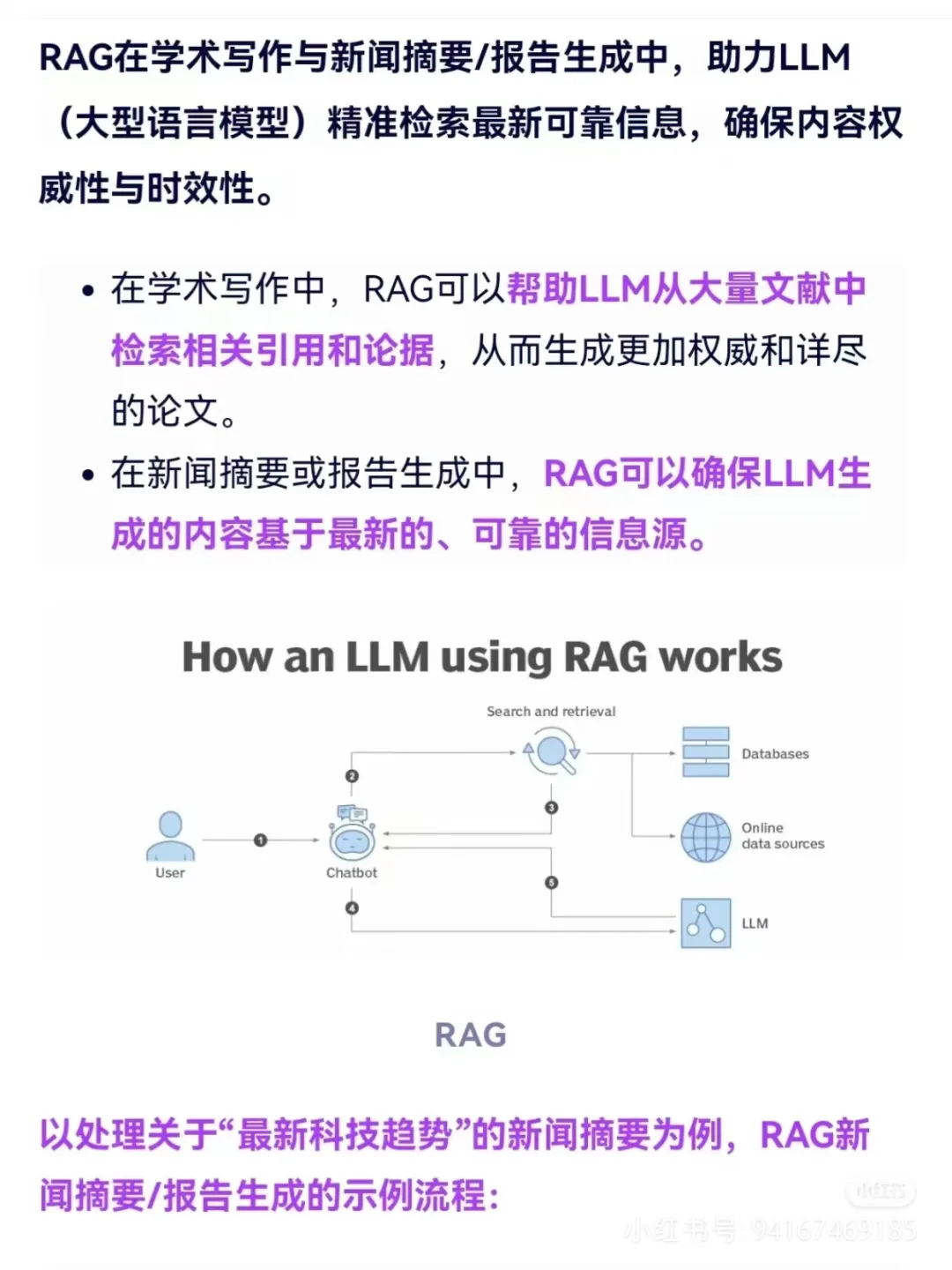

• RAG(检索增强生成):

检索增强生成(Retrieval Augmented Generation)为大语言模型提供了从数据源检索信息的能力,并以此为基础生成回答。RAG 结合了信息检索技术和大语言模型的提示功能,即模型根据搜索算法找到的信息作为上下文来查询回答问题。它主要包含数据准备阶段和检索生成阶段,涉及数据提取、分块、向量化、数据入库等环节。

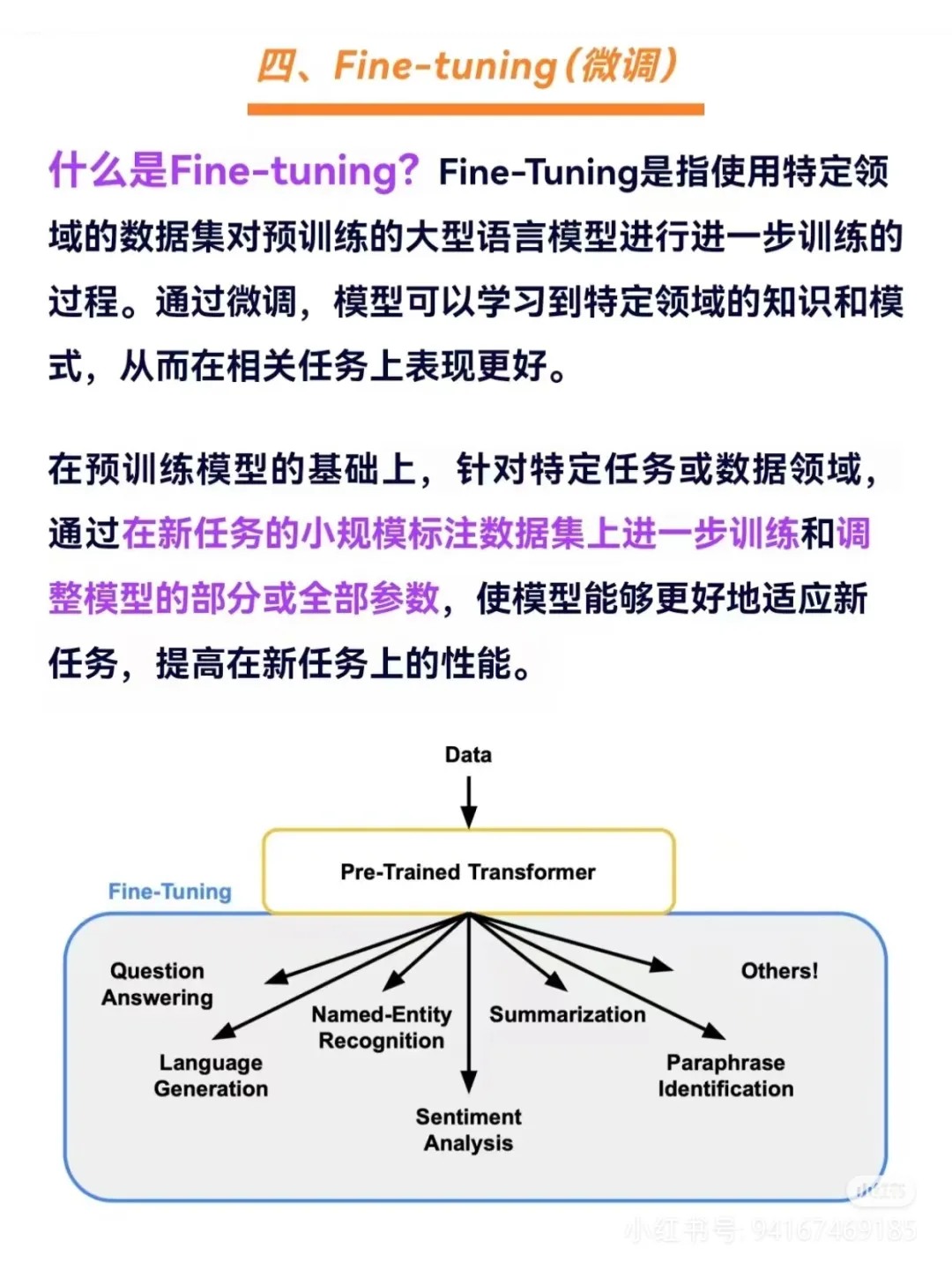

• Fine-tuning(微调):

微调是模型适应特定任务的关键步骤,它可以通过不同的方式进行,如Prefix Tuning、Prompt Tuning、P-Tuning、P-Tuning v2、Adapter Tuning和LoRA等。微调通过在预训练模型的基础上,进一步调整模型参数以适应特定的任务或数据集,提高模型在特定任务上的表现。

这些技术都是大模型开发中的重要概念,各自有不同的应用场景和优势。下面分享一个图文笔记整理的材料,便于大家学习和理解。

本文转载自公众号数字化助推器 作者:天涯咫尺TGH