艺术家泄露OpenAI Sora视频生成神器,附地址

Sora于 2024 年 2 月首次亮相,它用简单的文字提示制作出高质量的 60 秒视频片段,让所有人大吃一惊。它掀起了亚马逊、YouTube、阿里巴巴和电影制片厂 Lionsgate 的视频生成器浪潮,但目前尚未向公众开放。

泄露地址是 https://huggingface.co/spaces/PR-Puppets/PR-Puppet-Sora

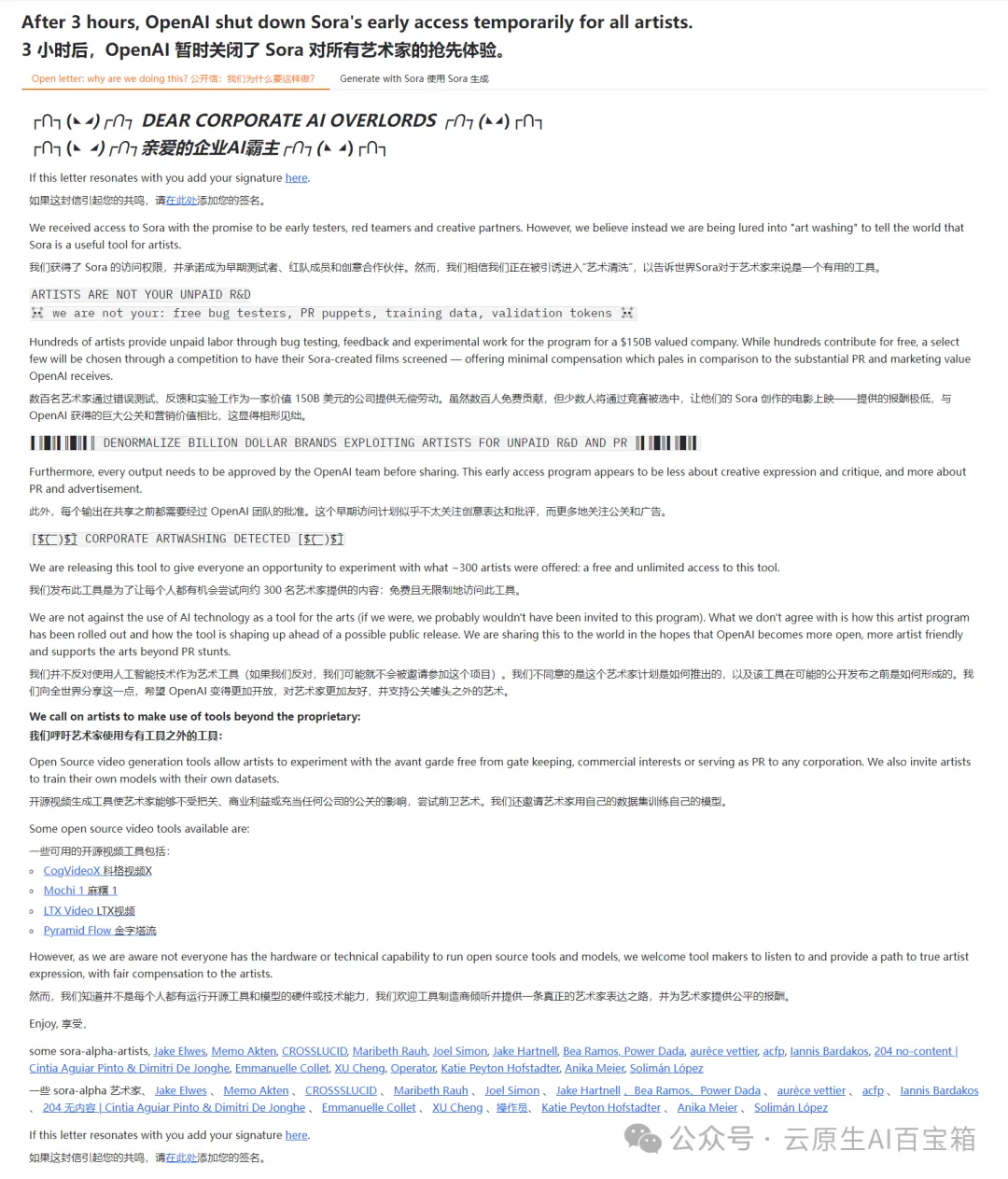

事件发生在11月27日,一个自称为“Sora PR Puppets”的组织在人工智能开发平台Hugging Face上发布了与Sora API相关的项目(PR-Puppets)。这个项目允许用户使用Sora生成视频,只需输入简短的文字描述,就能生成分辨率高达1080p、时长为10秒的视频。这个前端界面在发布后大约1小时就无法正常工作了,外界猜测OpenAI或Hugging Face可能已经撤销了访问权限

什么是 Sora?

Sora代表了生成式人工智能能力的重大飞跃,它充当扩散模型,将文本提示转换为长达一分钟的视频。利用来自各种模型的技术,Sora 提供精确的文本到视觉对齐和增强的时间连贯性。OpenAI 对 Sora 的愿景是雄心勃勃的,将其定位为实现通用人工智能的基础一步。尽管有这些愿望,但这项技术并非没有局限性;复制复杂物理和确保内容安全方面的挑战仍有待改进。

正如 Hugging Face 讨论平台所描述的那样,Sora 是“令人着迷的技术实力展示”。该模型以视频形式制作“视觉连贯的叙述”的能力被誉为生成式人工智能的里程碑式成就。

泄密事件及其涉嫌动机

Sora泄密缘由

Sora 模型的泄露似乎源于测试人员和贡献者的不满,尤其是创意产业的不满。批评者指控 OpenAI(目前估值超过 1500 亿美元)利用他们的劳动,依靠无偿或报酬过低的贡献来完善模型。这些测试人员,包括视觉艺术家和电影制作人,提供了宝贵的反馈和创意意见,但据称却发现自己被排除在公平认可或补偿之外。

这次反抗行为是对人工智能开发中创造性专业知识更广泛商品化的抗议。此次泄密是经过精心策划的,旨在凸显 OpenAI 涉嫌无视艺术劳动的经济价值,呼应了人工智能伦理话语中已经普遍存在的不满情绪。

该组织表示,三个小时后,“OpenAI 暂时关闭了所有艺术家对 Sora 的早期访问权限。”

伦理和法律问题

Sora 争议也重新引发了有关版权和知识产权的争论。OpenAI 此前曾因将受版权保护的材料用于培训目的而受到审查,并声称这是合理使用。尽管 OpenAI 表示 Sora 的训练数据包括授权和公开数据集,但该公司对具体细节保持沉默,这让人怀疑不已。这种不透明性,加上创作者和出版商正在进行的诉讼,凸显了技术进步与知识产权之间的紧张关系。

对 Sora 等生成式 AI 模型的安全担忧促使 OpenAI 实施了保护措施,包括检测分类器和内容策略执行机制。然而,这些措施可能不足以解决泄露模型的潜在滥用问题。Hugging Face 评论者指出,“如此大规模的泄露破坏了 OpenAI 执行道德保障的努力。它将不受制约的权力交到了任何有访问权限的人手中。”

对人工智能和创意产业的更广泛影响

Sora 泄密事件是人工智能时代一场更大权力斗争的象征。一方面,OpenAI 将自己定位为创新与实用性交汇处的先驱,而 Sora 则代表着一种使视频创作民主化的工具。另一方面,泄密事件凸显了系统性问题,例如创造性劳动被低估以及围绕人工智能对人类创造力的依赖而产生的道德困境。

正如 Hugging Face 的另一位贡献者所说,“人工智能并非凭空而来。它建立在创意人员的肩膀上,而这些创意人员往往没有得到认可。Sora 泄密事件敲响了警钟:没有道德的创新就是剥削。”

对于创意专业人士来说,此次泄密事件是一把双刃剑。它不仅揭露了现行制度的不公平,也有可能破坏艺术家和技术开发者之间合作的信任。展望未来,此次事件呼吁企业重新思考如何与创意社区互动,强调透明度、公平报酬和尊重知识产权。

归根结底,Sora 争议是人工智能行业面临的更广泛挑战的一个缩影:如何在追求进步与尊重和保护支撑人工智能的人类劳动之间取得平衡。正如一位观察家在 Hugging Face 上评论的那样,“这不仅仅是一次泄密,更是一次清算。”

本文转载自微信公众号「云原生AI百宝箱」,可以通过以下二维码关注。转载本文请联系云原生AI百宝箱公众号。

本文转载自 云原生AI百宝箱,作者: OpenAI