解读 Marco - o1:迈向开放式推理模型的探索与实践

研究背景

• 研究问题:这篇文章要解决的问题是如何在大规模推理模型(LRM)中实现开放式推理,特别是在没有明确标准和难以量化的奖励的情况下。具体来说,研究了如何使o1模型能够有效地泛化到没有明确标准的更广泛领域。

• 研究难点:该问题的研究难点包括:在没有明确标准的情况下进行推理,奖励的量化挑战,以及如何在复杂现实世界问题解决任务中优化模型的性能。

• 相关工作:该问题的研究相关工作包括OpenAI的o1模型,它在AIME和CodeForces等平台上的出色表现。本文受到OpenAI o1的启发,旨在进一步推动大型语言模型(LLM)在推理能力方面的边界。

OpenAI推出的o1模型具有卓越的推理能力,在AIME和CodeForces等平台上表现出色,超越了其他领先模型。受其启发,Marco - o1旨在进一步突破界限,增强推理能力以应对复杂的现实挑战。Marco - o1借助思维链(CoT)微调、蒙特卡洛树搜索(MCTS)、反思机制和创新推理策略,提升模型在复杂现实问题中的解决能力。

研究方法

这篇论文提出了Marco-o1模型,用于解决大规模推理模型中的开放式推理问题。具体来说,

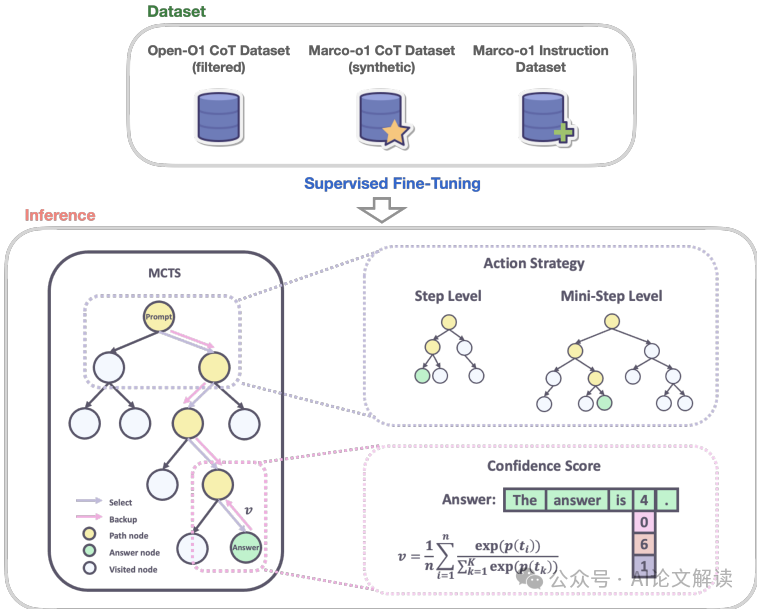

1. Chain-of-Thought (CoT) Fine-Tuning:首先,使用过滤后的Open-O1 CoT数据集、Marco-o1 CoT数据集和Marco-o1指令数据集对Qwen2-7B-Instruct模型进行全参数微调。这些数据集帮助模型采用结构化的推理模式。

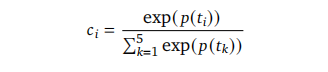

2. Monte Carlo Tree Search (MCTS):其次,将LLMs与MCTS集成,使用模型的输出置信度来指导搜索并扩展解决方案空间。每个节点代表问题解决过程中的一个推理状态,可能的动作是LLM生成的输出。通过计算每个token的置信度分数来评估推理路径的质量。

3. Reasoning Action Strategy:此外,实现了新的推理动作策略和反思机制。包括在MCTS框架内探索不同动作粒度(step和mini-step),并提示模型自我反思,从而显著提高模型解决复杂问题的能力。

4. 翻译任务应用:首次探讨了LRM在机器翻译任务中的应用,研究了多语言和翻译领域的推理时间扩展规律。

Marco推理数据集

为增强Marco - o1模型的推理能力,采用监督微调(SFT)策略,使用多种数据集,包括Open - O1 CoT数据集(经过启发式和质量过滤)、Marco - o1 CoT数据集(通过MCTS生成)和Marco指令数据集,以提升模型的结构化推理、复杂推理和指令执行能力,总样本数达60,266个。

数据集 | 样本数量 |

Open - O1 CoT数据集(过滤后) | 45,125 |

Marco - o1 CoT数据集(合成) | 10,000 |

Marco指令数据集 | 5,141 |

总计 | 60,266 |

实验设置与结果

4.1 实验设置

基于Qwen2 - 7B - Instruct模型,使用训练数据进行监督微调创建Marco - o1 - CoT,在MCTS树搜索框架内进行实验,包括“Marco - o1 - MCTS(step)”“Marco - o1 - MCTS(mini-step of 64 tokens)”“Marco - o1 - MCTS(mini-step of 32 tokens)”三种配置,并在MGSM数据集的英文和中文子集上进行测试,每个模型使用CoT提示以确保推理过程一致。

4.2 主要结果

在MGSM - en数据集中,Marco - o1 - CoT相比Qwen2 - 7B - Instruct有优势,但在MGSM - zh数据集中,由于微调数据为英文,性能有所下降。三种MCTS增强模型均比Marco - o1 - CoT有改进,但树搜索结果有随机性,目前无法确定最佳行动策略,不过MCTS在较低猜测次数下(Test@1)已显示出优势。

模型 | MGSM - En(Acc.) | MGSM - Zh(Acc.) |

Qwen2 - 7B - Instruct | 84.00% | 76.80% |

Marco - o1 - CoT | 85.60% | 71.20% |

Marco - o1 - MCTS(step) | 90.40% | 80.00% |

Marco - o1 - MCTS(mini-step of 64 tokens) | 88.40% | 80.40% |

Marco - o1 - MCTS(mini-step of 32 tokens) | 87.60% | 82.40% |

模型 | MGSM - En | MGSM - Zh |

Test@1 Acc. | Test@8 Acc. | |

Qwen2 - 7B - Instruct | 84.00% | 89.60% |

Marco - o1 - CoT | 85.60% | 97.60% |

Marco - o1 - MCTS(step) | 90.40% | 99.20% |

Marco - o1 - MCTS(mini-step of 64 tokens) | 88.40% | 98.40% |

Marco - o1 - MCTS(mini-step of 32 tokens) | 87.60% | 98.80% |

翻译任务案例研究

在翻译任务中,Marco - o1在处理口语和俚语表达时表现出色,能够准确理解上下文和细微差别,提供比谷歌翻译更准确、自然的翻译,展示了其在复杂翻译任务中的高级理解和推理能力。

翻译任务案例对比(中文到英文)

案例一

•原文:这个鞋拥有踩屎感,很舒服,推荐购买

•Marco - o1翻译:This shoe has a comfortable sole. It is very comfortable and recommended for purchase.

•谷歌翻译:This shoe has a feeling of stepping on poop, very comfortable, recommended to buy.

案例二

•原文:美到我心巴上了,上身真的很韩,穿上软乎乎毛茸茸的厚度也刚好,里面搭配了打底衫,小特别且日常的穿搭

•Marco - o1翻译:It's so beautiful that it's captivating, the upper part has a distinctly Korean style, the soft and fluffy material is perfectly thick, and it's complemented by a base layer, creating a unique and everyday - wear outfit.

•谷歌翻译:It's so beautiful that I'm attracted to it. The upper body is really Korean. It's soft and fluffy and the thickness is just right. It's paired with a base shirt. It's a little special and daily outfit.

案例三

•原文:太太太太好看了!而且价格这么便宜,超级板正不卷边,都买它,买它

•Marco - o1翻译:It's so beautiful! And it's so cheap, super straight and doesn't curl. Buy it, buy it!

•谷歌翻译:Madam, madam, you are so beautiful! And the price is so cheap, the super board is not curled, everyone buys it, buys it.

通过这些案例可以看出,Marco - o1在处理口语化、具有文化特色的表达时,能够更好地理解语义并给出更符合语境的翻译。

本文转载自 AI论文解读,作者:柏企