你知道大模型聊天补全和文本生成的区别吗? 原创

“ 文本生成是生成新的内容,而聊天补全是对上下文的理解能力 ”

这两天在对接微软的openAI模型时,看到了一个名词叫聊天补全;刚开始还不知道聊天补全是什么意思,以为是类似于输入法的联想功能;但看了文档才发现,原来聊天补全就是大模型的对话功能。

这时突然想到一个问题,聊天补全是大模型的对话,那之前一直说的文本生成是什么?

聊天补全与文本生成的区别

在今天之前,个人一直认为大模型对话就是文本生成,文本生成就是与大模型对话;但今天看到一个聊天补全的名词,才知道原来聊天补全是聊天补全,文本生成是文本生成。

聊天补全的定义

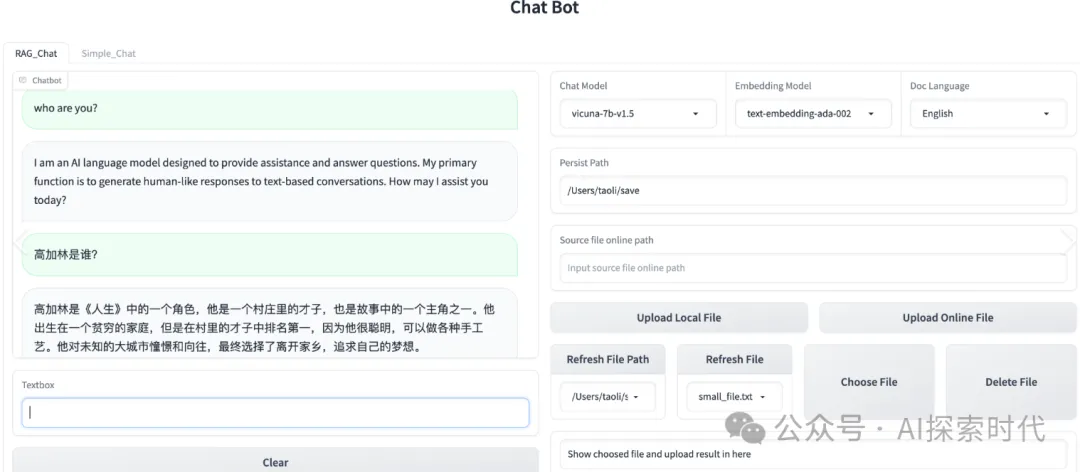

**聊天补全(Chat Completion)**是指通过自然语言处理(NLP)技术,根据用户输入的上下文生成合理且连贯的回复。这种技术是聊天系统(如聊天机器人或虚拟助手)的核心,用于让对话更自然、更智能。常见的聊天补全技术基于大语言模型(如 OpenAI 的 GPT 系列、ChatGPT),可以理解上下文并生成符合逻辑的文本回复。

下面就来详细介绍一下聊天补全和文本生成的区别:

聊天补全和文本生成虽然都涉及生成自然语言内容,但它们的目标、使用场景和技术细节有显著区别。以下是它们的对比:

1. 定义和目标

特性 | 聊天补全 | 文本生成 |

定义 | 根据对话上下文生成合理的回复,以实现人机互动。 | 根据输入(Prompt)生成特定格式或风格的文本内容。 |

目标 | 模拟人类对话,提供连贯的、语境相关的回答。 | 生成独立的、高质量的文本内容,如文章、摘要等。 |

2. 上下文处理

特性 | 聊天补全 | 文本生成 |

依赖上下文 | 强依赖对话历史,以便生成与上下文一致的连续性回复。 | 通常基于单一输入,没有多轮上下文依赖(除非明确要求)。 |

对话状态 | 持续维护用户对话的状态,包括前几轮的提问和回答。 | 通常不需要跟踪上下文,生成的文本是一次性的。 |

3. 输出特性

特性 | 聊天补全 | 文本生成 |

输出类型 | 句子级回复,短而直接,旨在推进对话。 | 长文本、段落或完整内容,可能是一篇文章或长故事。 |

风格 | 更互动性和实时性,模拟自然对话语气。 | 通常根据任务生成内容,如正式文档或创意写作风格。 |

4. 使用场景

特性 | 聊天补全 | 文本生成 |

典型应用 | - 智能客服 | - 内容创作(如文章、博客) |

- 虚拟助手(如 Siri、Alexa) | - 文本摘要(如提取文档要点) | |

- 社交机器人 | - 翻译或标题生成 | |

- 多轮问答 | - 科技文档、代码生成 |

5. 模型的调整与优化

特性 | 聊天补全 | 文本生成 |

模型训练 | 通常使用对话数据集,重点是对话的流畅性和上下文理解能力。 | 使用多领域语料库,关注文本的连贯性和生成质量。 |

优化重点 | - 语言互动性和准确性 | - 文本结构和主题连贯性 |

- 语境感知和多轮对话能力 | - 长文生成和格式要求 |

6. 生成方式的技术实现

特性 | 聊天补全 | 文本生成 |

输入的复杂性 | 包括用户输入和历史对话的上下文。 | 仅需要输入的提示(Prompt),通常较简单。 |

输出控制 | 回复内容较短,通常一到两句话,实时性强。 | 可以生成从短到长的内容,内容风格可定制。 |

7. 技术与模型的使用

特性 | 聊天补全 | 文本生成 |

常用模型 | ChatGPT, Bard, DialogGPT | GPT-4、GPT-3、T5、BERT |

模型任务 | - 对话生成 | - 文本续写 |

- 问答系统 | - 信息提取与总结 |

8. 用户体验

特性 | 聊天补全 | 文本生成 |

互动性 | 高:需要实时响应,体现对话的交互性和逻辑连贯性。 | 较低:通常是一次性的内容输出,没有实时互动需求。 |

输出灵活性 | 更注重即时性和语境相关性,输出较短但精准。 | 灵活生成任意长度的文本,关注整体内容质量。 |

总结

特性 | 聊天补全 | 文本生成 |

核心关注点 | 模拟对话逻辑,提升交互体验。 | 高质量文本生成,满足特定任务需求。 |

适用场景 | 用于聊天机器人、虚拟助手、智能客服等。 | 用于内容创作、文档总结、写作辅助等。 |

技术难点 | 需要处理多轮对话,保持上下文一致性。 | 注重内容完整性、逻辑性和多样性。 |

两者的核心区别在于:聊天补全更注重多轮对话和上下文连续性,而文本生成更关注输出的内容质量和格式化需求。

文本生成属于AIGC的能力,而聊天补全属于多轮对话的能力。

聊天补全技术的不断发展正在重塑人机交互体验,让对话更加智能和个性化。

本文转载自公众号AI探索时代 作者:DFires