回复

测试时训练(TTT)太强了!

论文笔记分享,标题:The Surprising Effectiveness of Test-Time Training for Abstract Reasoning

测试时训练(TTT)是个新概念:在推理过程中使用从输入数据派生的损失暂时更新模型参数

文章的结论:

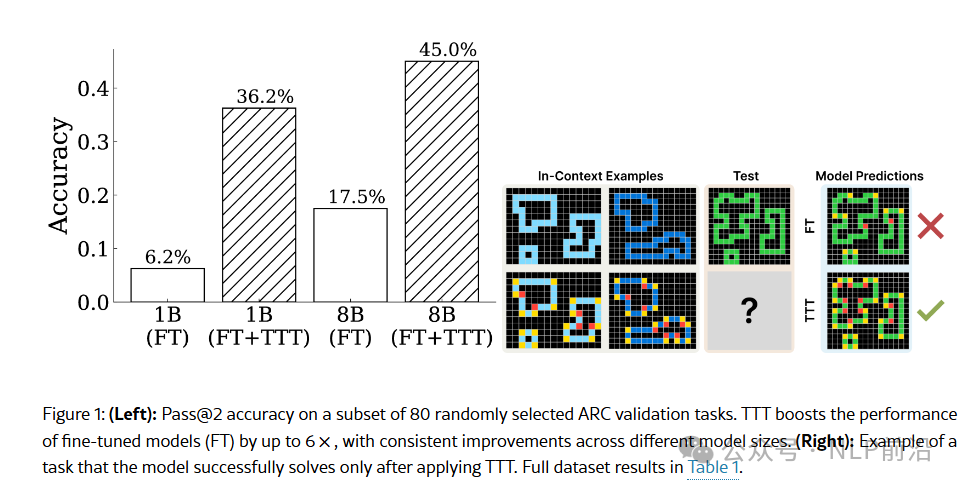

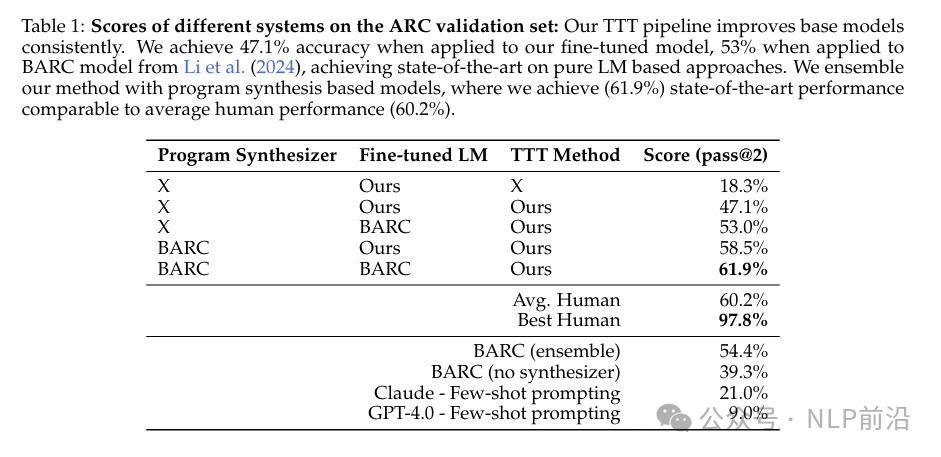

TTT 显著提高了 ARC 任务上的性能,与基线微调模型相比,准确率提高了高达 6 倍;将 TTT 应用于一个 8B 参数的语言模型,在 ARC 的公共验证集上达到了 53%的准确率,将公共和纯神经网络方法的最新水平提高了近 25%。通过将我们的方法与最近的程序生成方法相结合,获得了 61.9%的 SoTA 公共验证准确率,与人类评分接近。

ARC 任务:一个评估语言模型抽象推理能力的基准测试。通过一系列视觉谜题任务来考验模型解决新问题的能力。 每个任务由2D网格(大小可达30×30)组成,网格中包含由多达10种不同颜色的形状或模式。输出是通过将一个直观且共同的变换规则或函数应用于输入网格来获得的。

算法步骤:

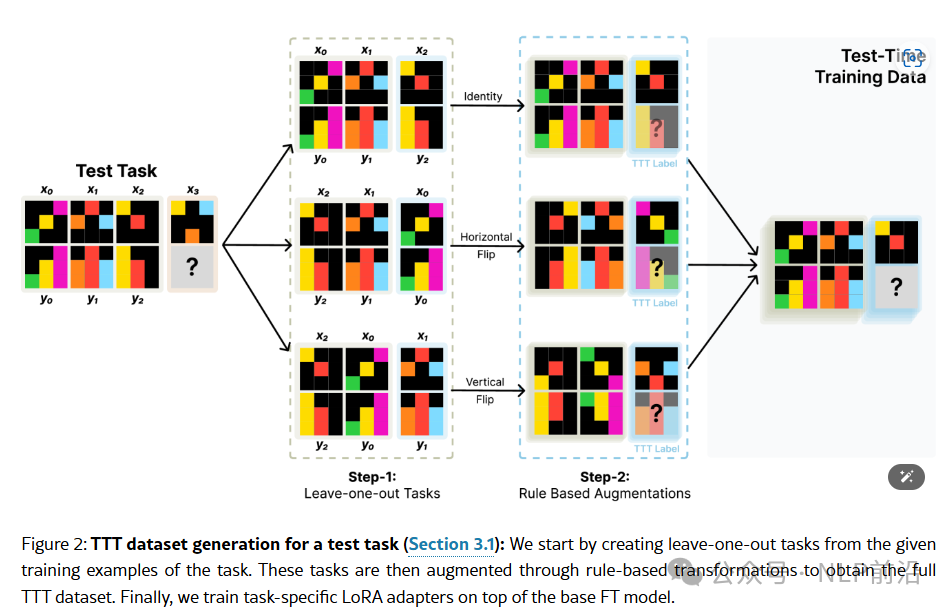

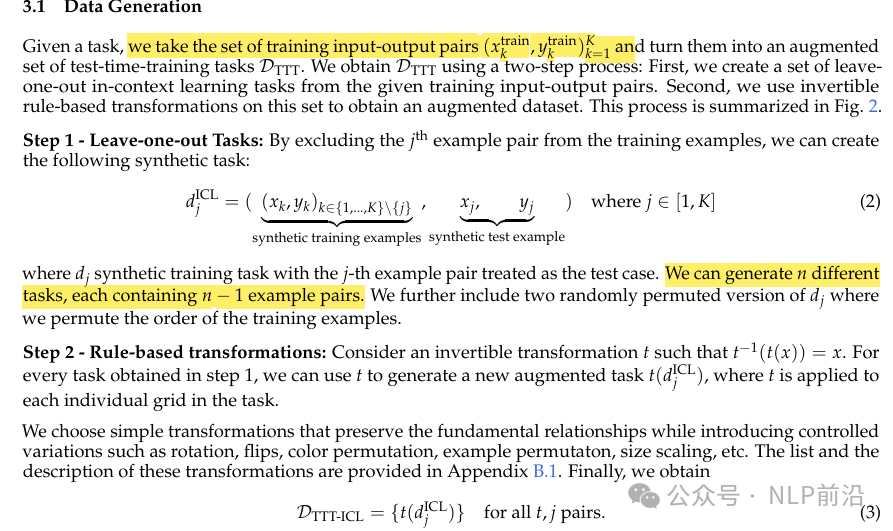

- 从训练输入-输出对中创建留一法任务,然后通过基于规则的变换来增强数据集。

- 在测试时训练期间,使用LoRA来优化。为每个任务学习一个特定的LoRA适配器,而不是为所有任务学习一个单一的适配器。

- 使用几何变换生成多个预测候选,然后通过贪婪解码方案进行预测。采用分层投票策略,首先在每个变换内进行投票,然后对每个变换的候选进行全局投票,以确定最终预测。

本文转载自NLP前沿

赞

收藏

回复

相关推荐