微软、Anthropic正在拉满大模型的情绪价值 原创

编辑 | 星璇

出品 | 51CTO技术栈(微信号:blog51cto)

再过3天,ChatGPT 就要迎来它的第二个生日了,GPT 推出也已经6年了。

到目前为止,大型语言模型 (LLM) 一直在有效发展。它们真实、敏捷且足智多谋。甚至可以说它们在检索信息方面接近完美。但是作为“信息传递工具”,又如何呢?

在最近接受 Reid Hoffman 采访时,Microsoft AI 首席执行官 Mustafa Suleyman 表示:“AI 研究人员通常倾向于忽视信息传递工具的重要性。

考虑到理解和响应人类情感的能力如何成为一个关键的差异化因素,Mustafa 预测 AI 公司现在将根据其前沿模型的情商相互“角力”。

图片

图片

1.C端AI,情商很关键

Mustafa 强调,消费者通常更看重这些模型的语气和情商,以及它们设法反映用户独特语言风格的方式,而不仅仅是提供客观的、百科全书式的维基百科反刍。

在 GPT 4o 中推出高级语音功能后,OpenAI 今年的重点领域之一是集成类似人类的语音对话工具。同样,当 Google 的 NotebookLM 推出一款精致的文本转播客工具“Deep Dive”时,AI 社区很快就接受了这个没有噱头的工具。

计算机科学家 Andrej Karpathy 表达了他对该工具的赞赏,甚至使用 NotebookLM 发布了一个 10 集的整个播客系列。“NotebookLM 播客剧集生成可能触及了一个极具吸引力的 LLM 产品格式的全新领域。感觉让人想起 ChatGPT。也许我反应过度了,“他说。

2.新方向:摸索大模型的“情商规律”

不仅仅是 AI 领域的行业巨头。今年三个月后,被称为“情商人工智能”的 Hume AI 在由 EQT 风险投资领投的 B 轮融资中获得了 5000 万美元的资金。9 月,他们发布了最新的 EVI 2 模型,该模型通过专门的情商训练适应用户偏好。

今年早些时候,研究人员探索了 LLM 的情商。EmoBench 是一个流行的基准,它评估了这种能力。结果表明,OpenAI 的 GPT 4 在“情感理解和情感应用”方面最接近人类。然而,所评估的模型在今天已成为过去。

最近,一项研究使用 Python 库测量了 LLM 的“表现力”。研究人员还进行了一项实验,涉及以诗歌风格根据情绪生成诗歌,包括遗憾、喜悦和懊悔的感觉。虽然 LLM 的表现令人满意,但结果表明,在表达具有相似含义的情绪时存在混淆。

“所有 GPT 模型在被提示表示不赞成时通常会表示赞同。这是一个重要的例子,两种含义相互冲突的情绪经常被误解,“他们说。

当这些 LLM 的任务是生成 34 位不同诗人风格的诗歌时,GPT 4o 显示出最高的表现力。然而,这些模型在负责识别女性诗人时表现出困惑,这可能在一定程度上表明了性别偏见。

在常规对话中,表现力逐渐下降。也就是说,尽管有局限性,但 Llama 3 的表现最好。应该注意的是,当提供有关主题、专业或角色的额外背景时,这些 LLM 的表现会更好。

“对于专业信号,LLM 表现出一致且不断增长的表达水平。相反,对于情绪信号,LLM 的表达性变化更大,随着模型根据不断变化的情绪背景调整和改变其反应,准确性会波动,“研究人员补充道。

3.Anthropic目前的目标:提高模型情商

Anthropic 认为情商是提高 Claude 的重要因素。哲学家兼 Anthropic 技术人员 Amanda Askell 在接受 Lex Fridman 采访时说:“我的主要想法一直是试图让 Claude 的行为方式,如果他们处于 Claude 的位置,你希望任何人都能理想地表现。

“所以想象一下,我带一个人去,他们知道他们将与可能有数百万人交谈,这样他们所说的话就会产生巨大的影响,你希望他们在这种真正丰富的意义上表现良好,”Askell 说。

对于更新的模型,Anthropic 正在努力帮助 Claude 以细致入微的情绪和表情做出回应。这涉及塑造模型以了解何时关心、何时表现得幽默、何时尊重意见以及何时确定自主程度。

她还解决了 LLM 中的阿谀奉承问题,即使他们是正确的,他们也倾向于纠正他们的输出,只是为了服从人类输入所说的。“如果 Claude 真的确信这不是真的,Claude 应该说,'我不这么认为。也许你有更多最新的信息',“Askell 补充道。

Askell 还提到,她想提高 Claude 在对话中提出相关后续问题的能力。总的来说,Anthropic 目前的目标是在 Claude 内心灌输真实的个性,而不是推迟或霸道地对待人类。虽然关于 LLM 碰壁并达到其可扩展性极限的讨论和争论不断涌现,但调整这些模型以提高情商是一种选择。

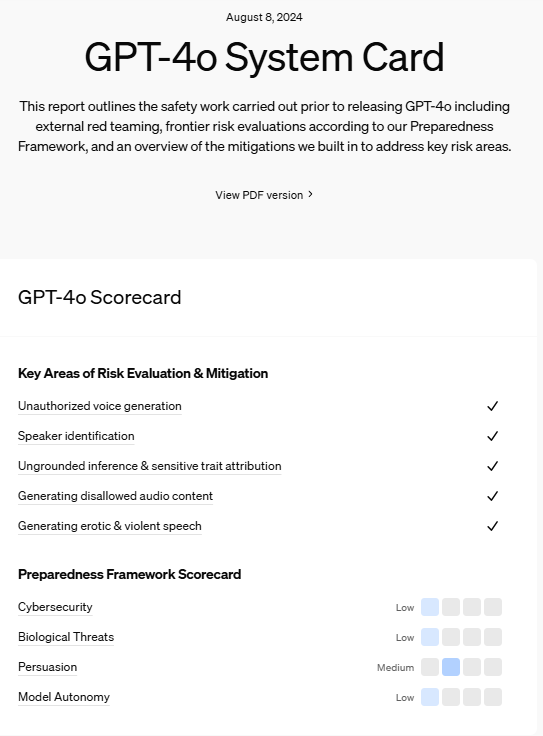

但是,需要注意的是。今年早些时候,OpenAI 发布了一张“系统卡”,警告人们可能会过度依恋情商高的 AI。

“使用 AI 模型进行类人社交可能会产生影响人与人互动的外部性。例如,用户可能会与 AI 建立社交关系,减少他们对人际互动的需求,可能会使孤独的人受益,但可能会影响健康的人际关系,“OpenAI 在报告中指出。

图片

图片

不幸的是,据之前的一个报道,一位14岁的少年由于对 CharacterAI 中的某个角色产生了深深的情感依恋,最终导致其自杀身亡。

由此可见,提高 AI 模型中的情商还有很多工作需要做,也有许多问题需要解决。开发面向消费者层面上 AI 互动技术无疑是一个明确的趋势,但在让大模型在同理心和责任感之间取得平衡,更加至关重要。

本文转载自51CTO技术栈,作者:星璇