腾讯Hunyuan超越Llama 3,成为NLP领域新霸主 原创

腾讯最近发布了一款名为Hunyuan的先进Moe(Mixture of Experts)模型,该模型在多个基准测试中表现出色,超越了Llama 3,成为自然语言处理(NLP)领域的新领导者。地址如下:

- github: https://github.com/Tencent/Tencent-Hunyuan-Large/blob/main/README_CN.md

- hf: https://huggingface.co/tencent/Tencent-Hunyuan-Large

以下是Hunyuan模型的一些关键优势:

- 合成数据增强:Hunyuan-Large通过合成数据增强训练,能够学习到更丰富的表示,处理长上下文输入,并更好地泛化到未见数据。

- KV缓存压缩:采用分组查询注意力(GQA)和跨层注意力(CLA)策略,显著减少了KV缓存的内存占用和计算开销,提高了推理吞吐。

- 专家特定学习率缩放:为不同专家设置不同的学习率,确保每个子模型都能有效地从数据中学习,并为整体性能做出贡献。

- 长上下文处理能力:预训练模型支持高达256K的文本序列,Instruct模型支持128K的文本序列,显著提升了长上下文任务的处理能力。

- 广泛的基准测试:在多种语言和任务上进行广泛实验,验证了Hunyuan-Large的实际应用效果和安全性。

推理框架:

腾讯为Hunyuan-Large模型提供了vLLM-backend推理框架。该框架在vLLM开源框架的基础上进行了适配,新增的CLA结构可以节省显存,保障超长文本场景。通过FP8量化优化,相比FP16/BF16常规量化,在最大限度保障精度的条件下,节省50%显存,吞吐提升70%。

训练框架:

Hunyuan-Large模型已经支持huggingface格式,用户可以采用hf-deepspeed框架进行模型精调。同时,腾讯也支持利用flash-attn进行训练加速,并开放了相关的训练脚本和模型实现,方便研发者进行后续的模型训练和精调。

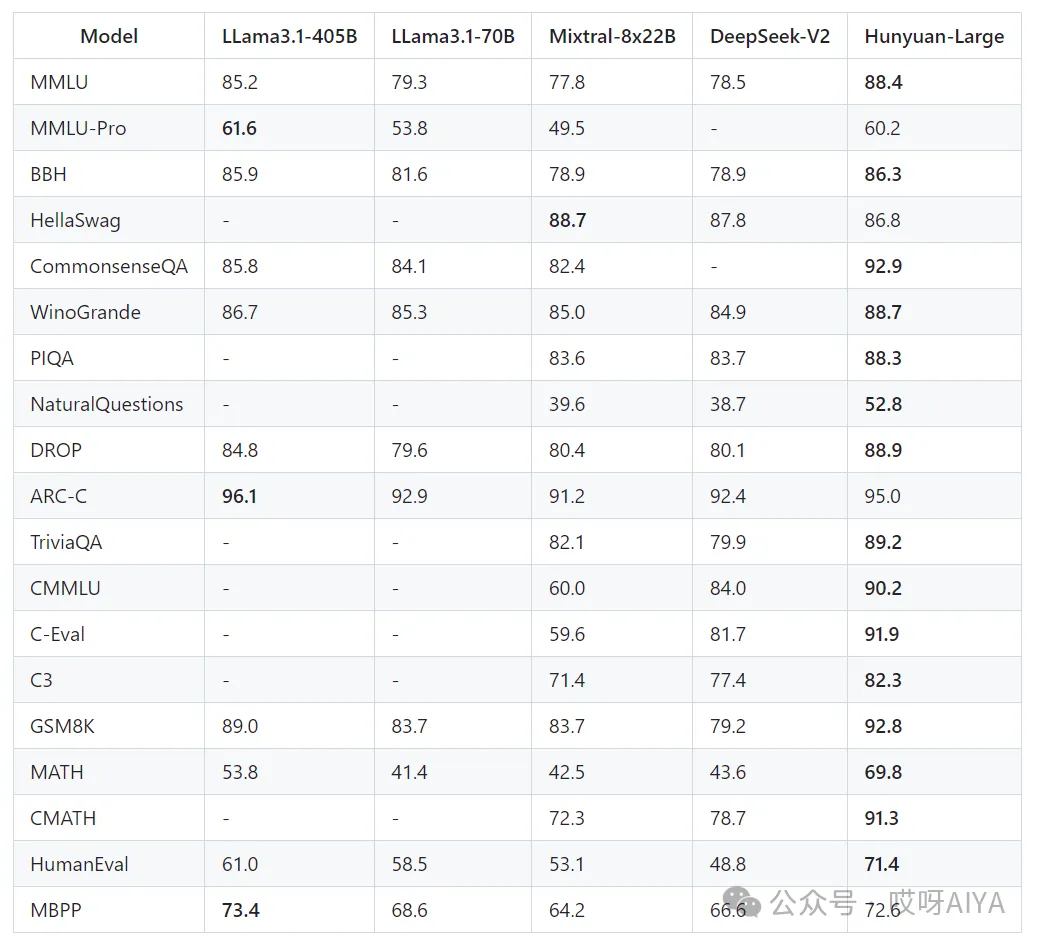

Benchmark评估榜单:

在多个基准测试中,Hunyuan-Large预训练模型与具有相似激活参数大小的Dense和MoE竞争对手相比,实现了最佳的整体性能。在常识理解和推理以及经典的NLP任务,如QA和阅读理解任务方面表现出色。在数学能力方面,Hunyuan-Large在GSM8K和Math数学数据集上优于所有基线,在CMATH中文数据集上也取得了最好的成绩。同时,Hunyuan-Large在所有中文任务中实现了整体最佳的性能。

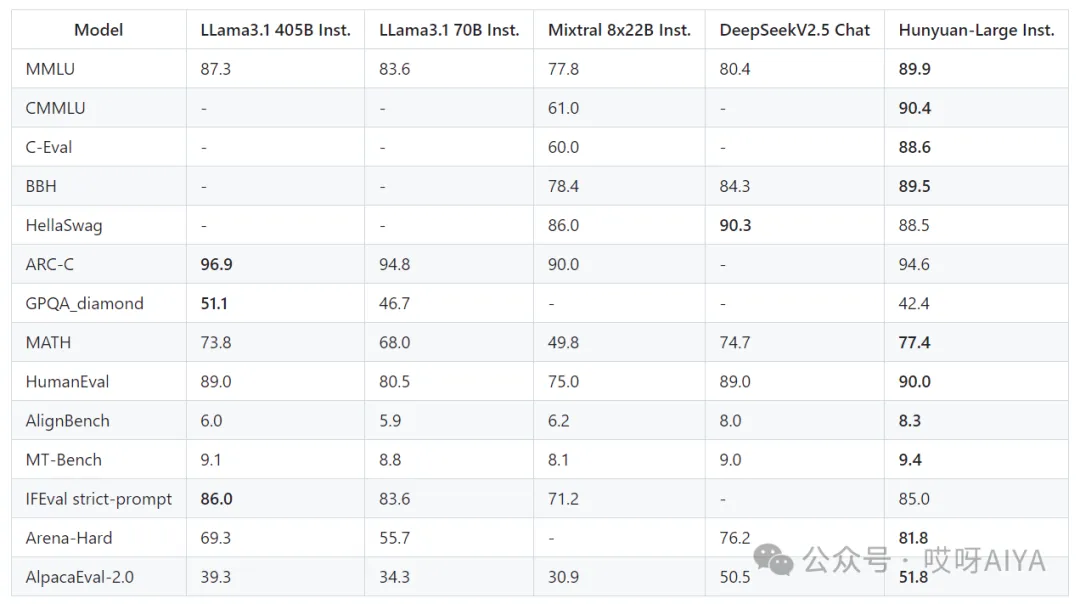

Hunyuan-Large-Instruct与具有相似激活参数的llm相比在大多数的任务上实现了一致的性能提升。在不同类别的基准测试中,Instruct模型在MMLU和MATH数据集上取得了最好的性能。值得注意的是,在MMLU数据集上,表现出了显著的提升, 相比与LLama3.1-405B模型高出2.6%。这种增强表明Hunyuan-Large-Instruct在广泛的语言理解任务中具有优越的理解和推理能力。该模型在MATH数据集上的表现进一步强调了它的实力,相比于LLama3.1-405B高出了3.6%的指标。值得注意的是,仅用520亿个激活参数就实现了精度的飞跃,证明了Hunyuan-Large-Instruct的卓越能力。

腾讯Hunyuan模型的开源,不仅展示了其在NLP领域的技术实力,也为全球的AI研究者和开发者提供了一个强大的工具,以推动NLP技术的发展。

本文转载自公众号哎呀AIYA