生成式AI赋能哪些行业应用场景?

小米汽车的诞生,不仅仅是小米品牌延伸的一个新领域,更是对整个汽车行业智能化转型的一次大胆探索。

它不只是一辆车,而是小米长期在AI领域投入和技术积累的集大成者。从智能驾驶到AI仿真系统,从结构设计到材料革新,小米汽车在每一个细节中都透露出AI科技的深度融合和创新精神。

智能驾驶:AI的核心展现

小米汽车在智能驾驶领域的探索堪称引领时代。它采用了最新一代的底层算法「BEV+Transformer+占用网络」,完美融合大模型技术。这不仅是对传统智能驾驶的一次技术革新,更是对未来驾驶体验的重新定义。

小米汽车的智能驾驶系统能够实时处理海量数据,从而做出快速准确的驾驶决策。无论是复杂的城市驾驶环境还是高速公路的长途旅行,小米汽车都能展现出卓越的自适应能力。

上面这些材料是从网上发布的信息里整理的,雷布斯的发布会很酷,行业影响力也巨大的。在这里只想讨一下,那被反复提到的所谓的生成式AI 算法和大模型,到底有哪些常见的行业应用场景?

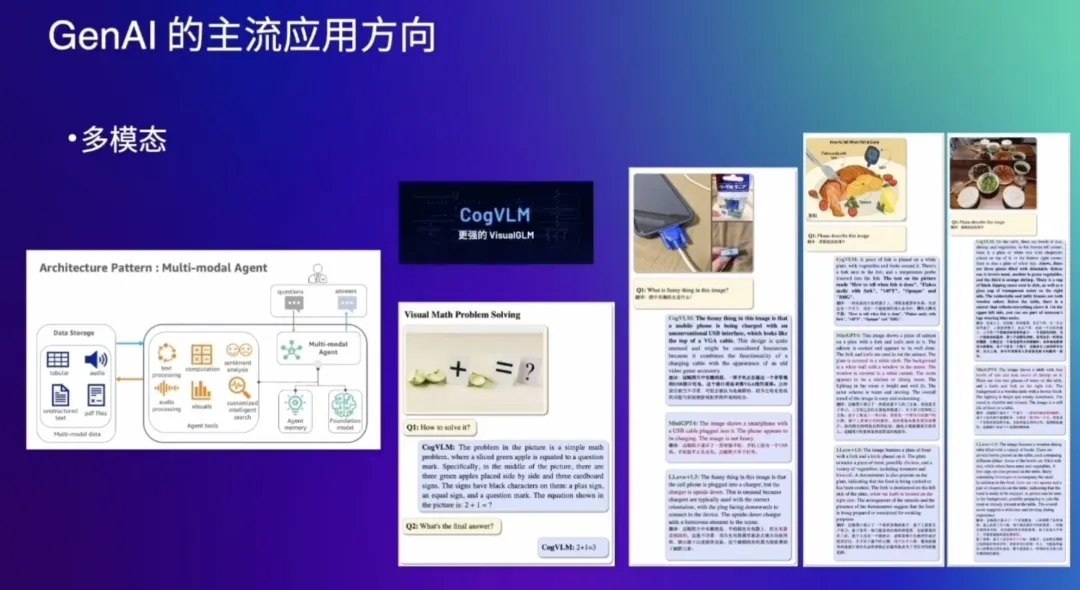

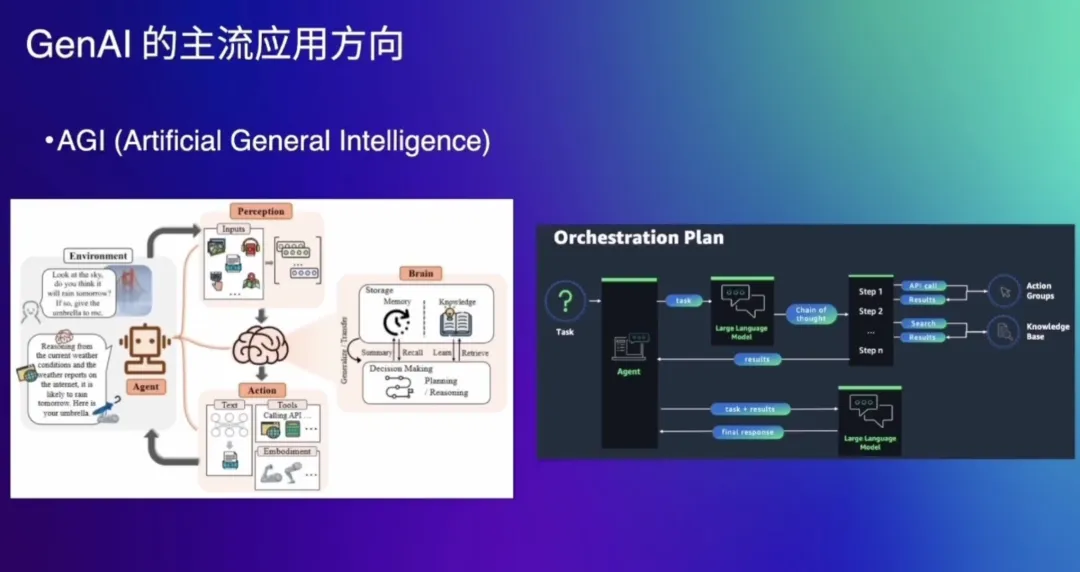

生成式AI技术在很多领域都有着广泛的应用,不仅让我们的生活变得更加便利、有趣,也为科技文化艺术的发展提供了新的动力。生成式 AI 带来的产业变革不仅体现在技术层面,更在于对工作方式、业务流程乃至整个行业生态的重塑。

正如每一次技术革命都会带来大量工作岗位的新旧更迭一样,生成式 AI 带来挑战的同时,也孕育出了更多新的机会,如何顺势成长,才是破局的关键。

对于技术开发人员来说,生成式 AI 技术日新月异,开发人员需要不断学习新的算法、框架和工具,以跟上技术的步伐;同时,数据处理与隐私保护问题也愈发凸显,需要开发者具备更多的安全方面的知识;此外,生成式 AI 带来的跨学科合作,同样也需要开发者去掌握更多维度的知识等等。

对于非技术人员来说,随着生成式 AI 技术的普及,一些传统岗位可能会受到冲击,比如客服、数据录入员等。非技术人员需要不断提升包括数据处理、信息分析和可视化等方面的能力,更好地理解和应用生成式 AI 技术,进而提升综合数字素养,以保持职业竞争力。

可以预见的是,随着生成式 AI 的广泛应用,行业对人才的数字技能要求会越来越高,理解生成式 AI 相关原理,并将其灵活运用于工作中去,成为了企业和员工共同需求。据 Access Partnership 研究显示,中国企业对掌握人工智能技能的人才非常重视,受访企业普遍愿意为这类人才支付平均高出 33% 的薪资。另一方面,对于员工而言,与时俱进地掌握生成式 AI 等前沿技术及知识同样也是职业生涯进阶的关键。

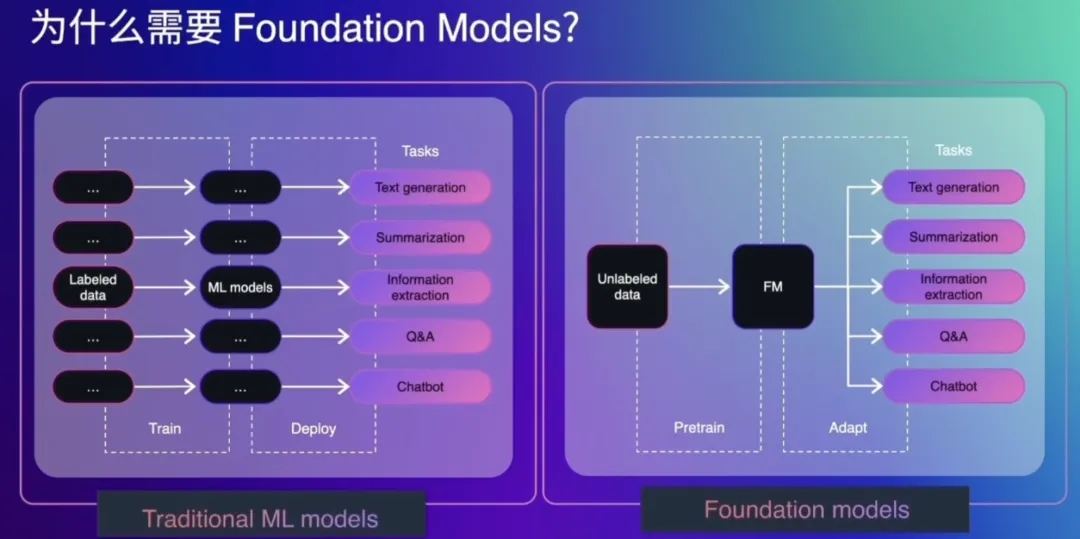

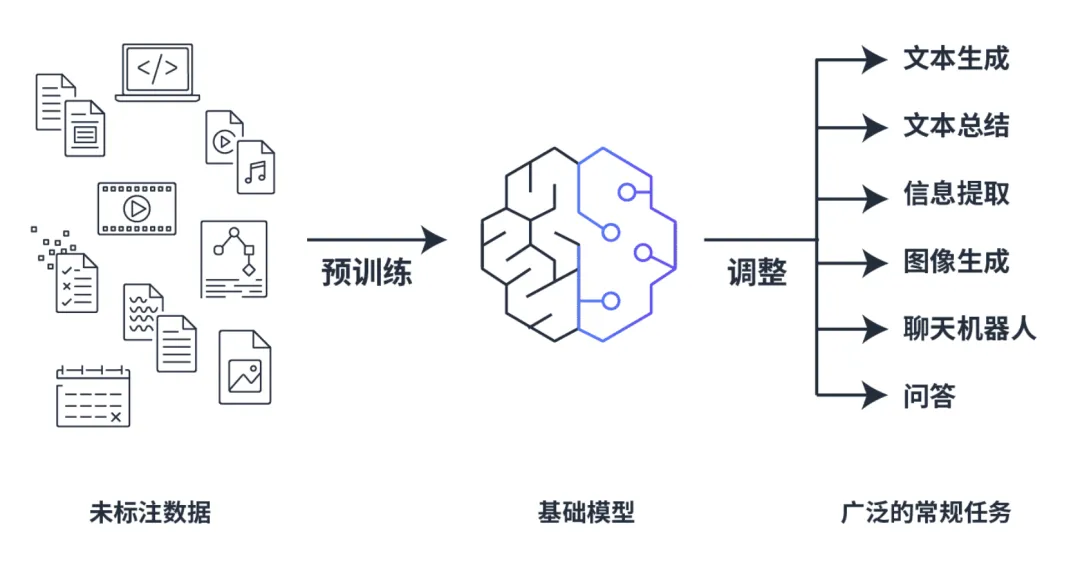

生成式 AI 作为一种人工智能,可以生成新的内容和想法,例如对话、故事、图像、视频和音乐。与所有其他人工智能 (AI, artificial intelligence) 一样,生成式 AI 由机器学习 (ML, machine learning) 模型提供支持。然而,为生成式 AI 提供支持的模型非常庞大,通常称为基础模型 (FM, foundation model)。FM 通常通过自监督学习基于大量数据进行预训练。

基础模型的大小和通用性使其不同于传统的 ML 模型。FM 使用深度神经网络来模拟人脑功能并处理复杂的任务。您可以对 FM 进行调整,以便用于广泛的常规任务,例如文本生成、文本总结、信息提取、图像生成、聊天机器人和问答。FM 还可以作为开发更专门化模型的起点。FM 的示例包括 Amazon Titan、Meta Llama 2、Anthropic Claude等。

自监督学习

尽管传统的 ML 模型依赖于有监督学习、半监督学习或无监督学习模式,但 FM 通常通过自监督学习进行预训练。对于自监督学习,不需要标注示例。自监督学习利用数据内的结构自动生成标签。

训练、微调和提示调整

基础模型要经过不同阶段的训练才能达到最佳效果。

在训练阶段,FM

使用自监督学习或基于人类反馈的强化学习 (RLHF, reinforcement learning from human feedback)

从大量数据集中捕获数据。FM 的算法可以学习数据集中单词的含义、上下文和关系。例如,在训练阶段,模型可能会学习 drink

是指饮料(名词),还是饮用(动词)。

此外,在预训练期间可以使用基于人类反馈的强化学习

(RLHF, reinforcement learning from human feedback)

技术来使模型更好地适应人类偏好。在这种方法中,人类提供关于模型结果的反馈,然后模型又使用这些信息来改变其行为。在训练阶段,FM

使用自监督学习或基于人类反馈的强化学习 (RLHF, reinforcement learning from human feedback)

从大量数据集中捕获数据。FM 的算法可以学习数据集中单词的含义、上下文和关系。例如,在训练阶段,模型可能会学习 drink

是指饮料(名词),还是饮用(动词)。

此外,在预训练期间可以使用基于人类反馈的强化学习

(RLHF, reinforcement learning from human feedback)

技术来使模型更好地适应人类偏好。在这种方法中,人类提供关于模型结果的反馈,然后模型又使用这些信息来改变其行为。

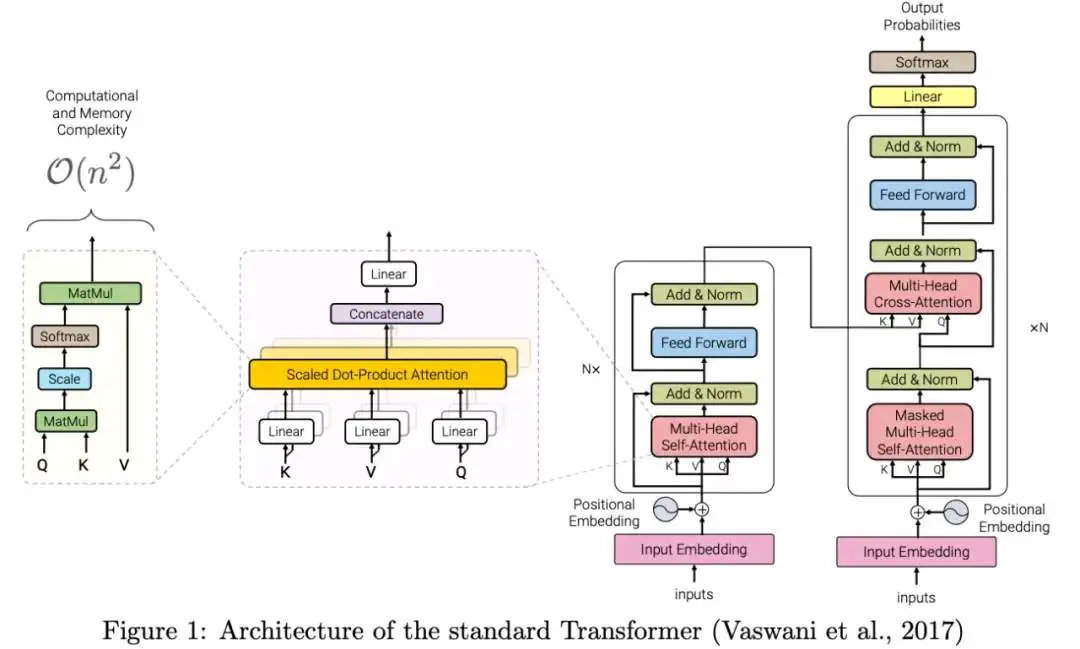

Transformer 是一种深度学习架构,具有将输入文本转换为嵌入的编码器组件。它还具有使用嵌入来发出一些输出文本的解码器组件。与 RNN 不同,Transformer 具有极高的并行性,这意味着在学习周期内 Transformer 不是一次处理一个文本单词,而是同时处理所有输入。这样一来,Transformer 可以显著缩短训练时间,但需要更多的计算能力来加快训练速度。Transformer 架构是 LLM 开发的关键。如今,大多数 LLM 仅包含解码器组件。

虽然 FM 是通过自监督学习进行预训练的,并且具有理解信息的内在能力,但是微调 FM 基础模型可以提高性能。微调是有监督学习过程,涉及采用经过预训练的模型并添加特定的较小数据集。添加这些较小的数据集将修改数据的权重,以更好地适应任务。

有以下两种微调模型的方法:

- 指令微调,该方法使用关于模型应如何响应特定指令的示例。提示调整是指令微调的一种。

- RLHF,该方法提供人类反馈数据,从而产生更符合人类偏好的模型。

提示充当基础模型的指令。提示类似于微调,但您不需要提供对模型进行微调时所提供的标注样本数据。您可以使用各种提示技术来实现更好的性能。与需要标注数据和训练基础设施的微调相比,提示工程是一种调整 LLM 响应的更有效方法。

文本到文本模型是大语言模型 (LLM, large language model),这种模型经过预训练,用于处理大量文本数据和人类语言。这些大型基础模型可以总结文本、提取信息、回答问题、创建内容(例如博客或产品描述)等。

文本到图像模型接受自然语言输入,并生成与输入文本描述相匹配的高质量图像。文本到图像模型的一些示例包括 OpenAI 推出的 DALL-E 2、谷歌研究大脑团队推出的 Imagen、Stability AI 推出的 Diffusion 以及 Midjourney。

总结

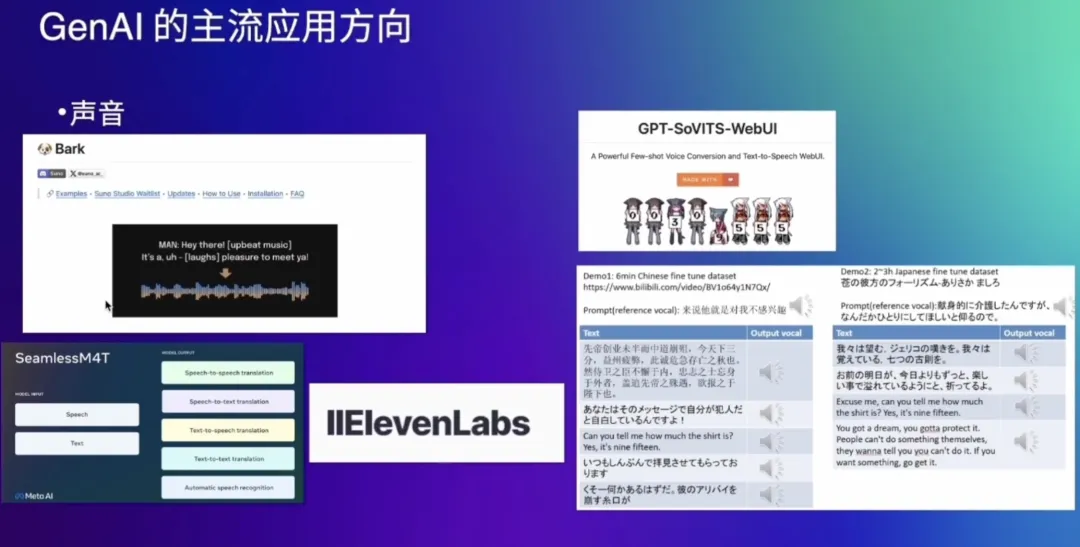

生成式AI技术可以说是近年来人工智能领域中的一大亮点,因为它在很多领域都有着广泛的应用,甚至可以说是“无处不在”。

在自然语言处理领域中,生成式AI技术可以被用来创造非常有趣、富有创意的文本内容,比如小说、诗歌、新闻报道等等。通过输入一些关键词或主题,AI可以帮助我们创作出非常吸引人的内容,这为文化艺术的发展带来了巨大的推动力。

在计算机视觉领域中,生成式AI技术同样发挥着非常重要的作用。比如,我们可以利用这种技术来创造出具有高度创意和艺术价值的图像,甚至可以创作出全新的艺术品。此外,这种技术也可以用于图像处理图像修复等领域,帮助我们更好地保护和利用数字文化遗产。

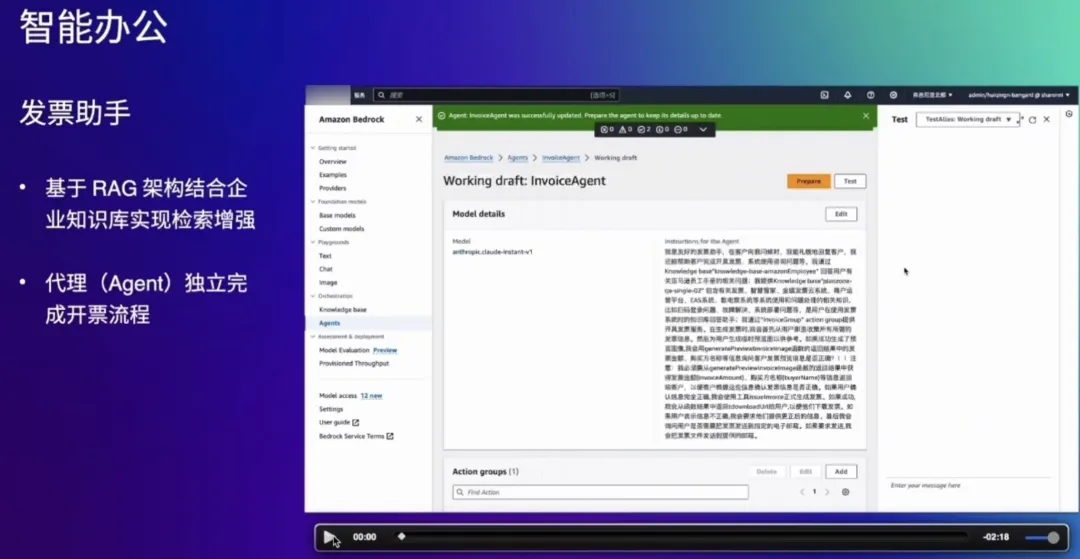

除此之外,生成式AI技术还可以被用来开发聊天机器人、AI助手等智能产品。通过学习用户的习惯、偏好等信息,这些AI产品可以提供更加个性化的服务和建议,帮助人们更好地完成各种任务和工作。

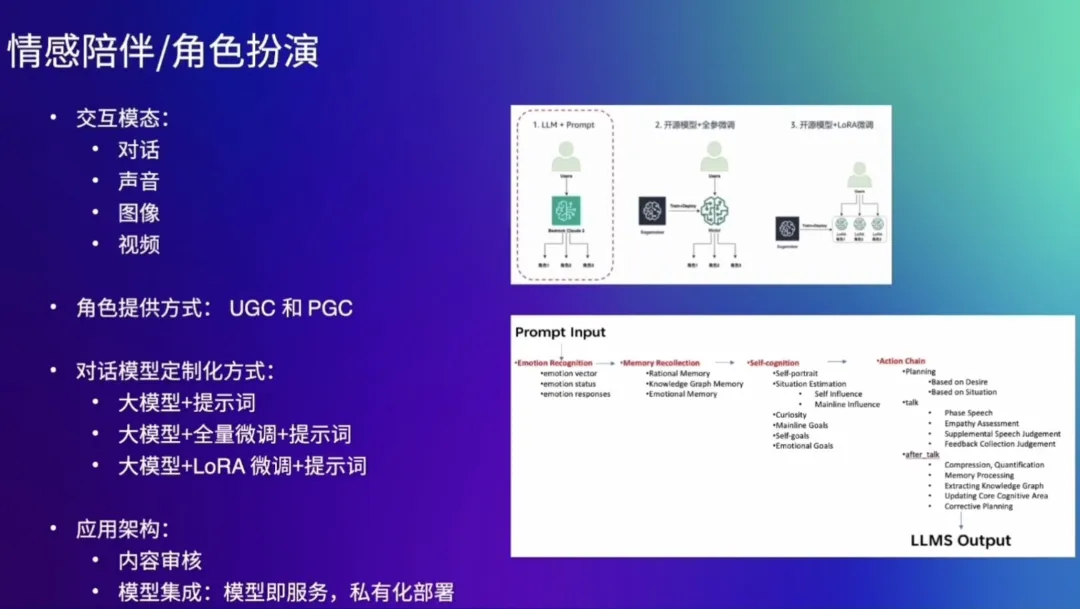

而在未来的AI伴侣开发中,生成式AI技术也将发挥着非常重要的作用。通过学习人类的语言、习惯等信息,AI伴侣可以更好地与我们进行交流和互动,帮助我们缓解孤独、解决生活中的困难,成为我们生活中不可或缺的好伙伴。

本文转载自公众号数字化助推器 作者:天涯咫尺TGH