Scaling laws在视觉自回归模型上失效了?谷歌联合MIT发布Fluid:文生图质量刷新纪录! 精华

文章链接:https://arxiv.org/pdf/2410.13863

缩放法则(Scaling laws)是大语言模型(LLMs)前所未有成功的基础。实证研究表明,在自回归模型中增加参数数量通常会显著提升性能,并在自然语言处理(NLP)任务中产生新的能力。这一实证关系激励了众多扩展语言模型的努力,导致许多高性能模型的发展。受到这一成功的鼓舞,许多尝试将自回归模型应用并扩展到计算机视觉领域,特别是在文本到图像生成等生成任务中。然而,这些模型生成的内容在性能和视觉质量上往往不及其他生成模型,如扩散模型,使得在视觉领域是否适用类似的缩放法则仍不清楚。

本文提出了几个关于性能差距的假设。

- 首先,大多数视觉自回归模型所需的矢量量化(VQ)步骤可能会引入显著的信息损失,最终限制模型的性能。

- 其次,与语言的固有顺序性质不同,生成视觉内容可能更需要不同的自回归预测顺序。

- 第三,在评估视觉模型的缩放法则时,通常会在两个层次的泛化能力之间产生混淆:(a) 使用与训练损失相同的指标(通常称为验证损失)对新数据的泛化,和 (b) 对不同于训练目标的新指标或问题的泛化,例如FID、GenEval基准或视觉质量。我们假设,幂律缩放适用于自回归模型在视觉数据上的(a)情况,但不一定适用于(b)情况。

为了研究这些假设,对文本到图像生成背景下自回归模型的缩放行为进行了全面的实证研究。并基于研究提出了一个新的模型——Fluid,先来看看效果如何。

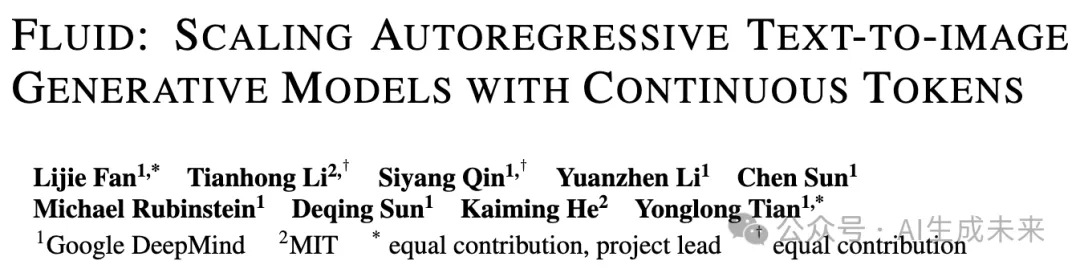

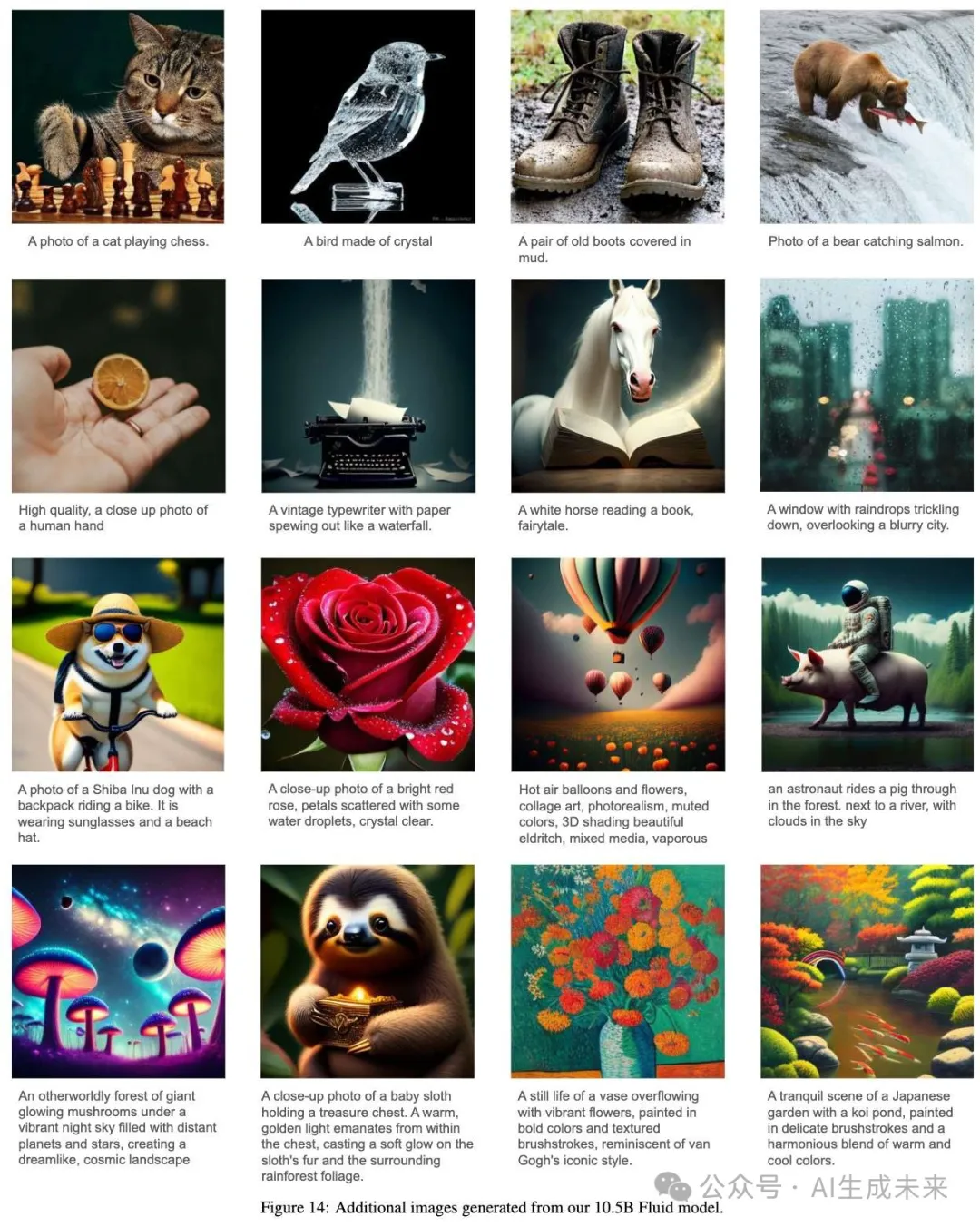

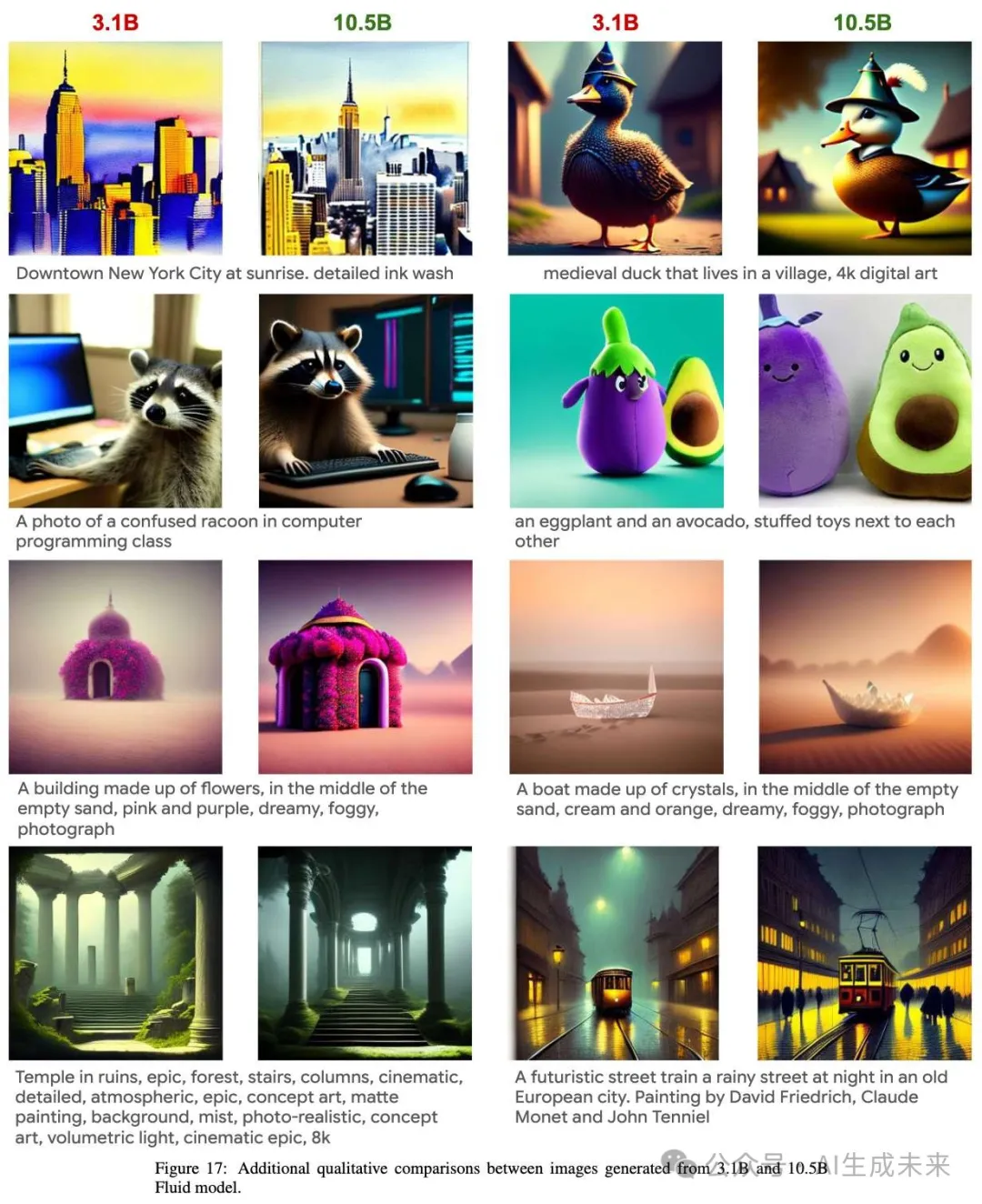

效果展示

总结速览

解决的问题:本文探讨了在视觉领域,特别是文本生成图像任务中,扩大自回归模型并不像在大语言模型中那样有益的现象。具体关注了以下两个关键问题:

- 模型使用离散还是连续的token。

- 模型在生成token时,使用随机顺序还是固定顺序(基于BERT或GPT的Transformer架构)。

提出的方案:

- 通过实验对比不同模型,研究模型在使用离散或连续token,以及在随机顺序或光栅顺序生成时的表现。

- 基于实验结果,提出了一种新的模型——Fluid,该模型使用随机顺序的自回归生成方式,并基于连续token进行训练。

应用的技术:

- 使用BERT和GPT类型的Transformer架构,结合离散和连续token的生成。

- 通过FID(Fréchet Inception Distance)、GenEval评分,以及视觉质量来评估模型性能。

- 在新提出的Fluid模型中采用随机顺序的自回归生成方式,并利用连续token进行训练。

达到的效果:

- 使用连续token的模型在视觉质量上显著优于使用离散token的模型。

- 随机顺序的模型在GenEval评分上优于光栅顺序的模型。

- Fluid 10.5B 模型在MS-COCO 30K数据集上实现了新的零样本生成的FID纪录,并在GenEval基准上获得了 0.69 的综合评分,达到当前最佳表现。

实现

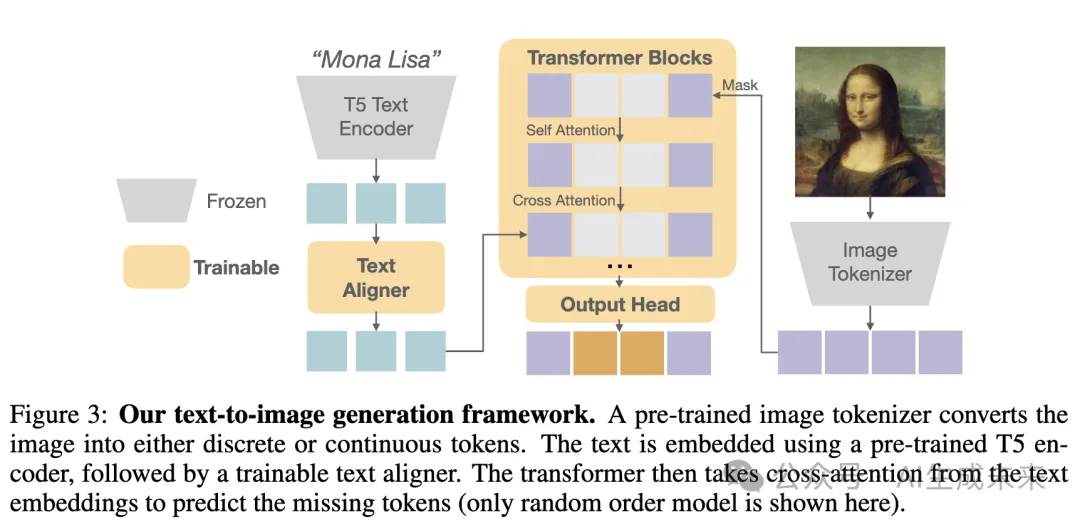

本文的文本生成图像模型训练的整体框架非常简单。首先,图像分词器将原始图像转换为tokens。然后,这些tokens被部分masked,接着训练一个Transformer模型,在文本的条件下重建被masked的tokens。下图3详细描述框架中的每个组件。

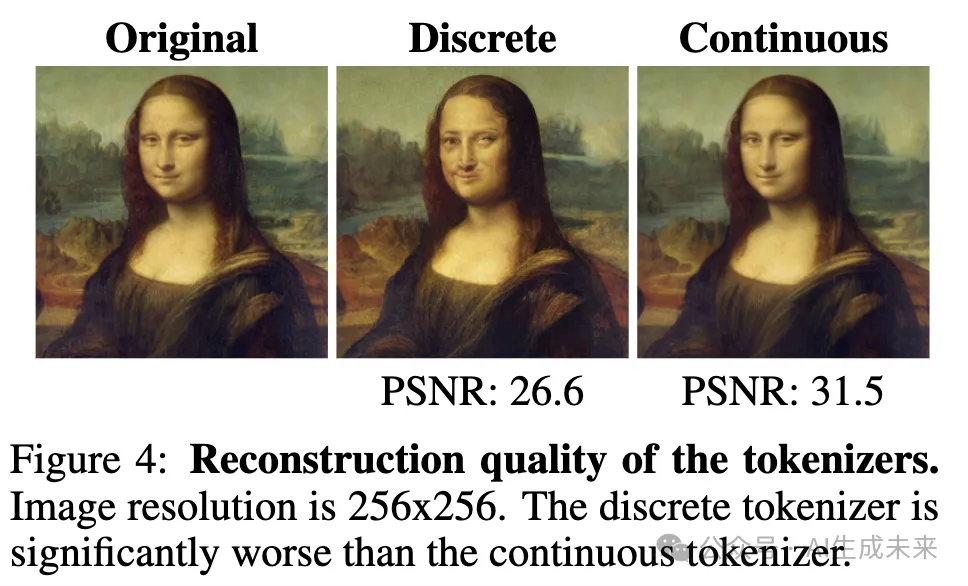

图像分词器:使用一个预训练的图像分词器将256×256的图像编码为token空间。该分词器可以是离散的或连续的,以便为自回归模型实现不同的训练目标。实验中,离散分词器是一个预训练于WebLI数据集的VQGAN模型。Muse的方法,将每张图像编码为16×16的离散tokens,词汇表大小为8192。对于连续分词器采用了Stable Diffusion模型,该模型将图像编码为32×32的连续tokens,每个token包含4个通道。为了与离散分词器在序列长度上一致,将每2×2块的连续tokens分组为一个token,最终序列长度为256,每个token包含16个通道。如下图4所示,连续分词器在重建质量上明显优于离散分词器。

文本编码器:原始文本(最大长度128)通过SentencePiece进行分词,并通过预训练的T5-XXL编码器进行嵌入,该编码器有47亿个参数并在训练期间被冻结。为了进一步对齐用于图像生成的文本embeddings,在T5嵌入的基础上添加了一个由六个可训练的Transformer模块组成的小型文本对齐器,来提取最终的文本表示。

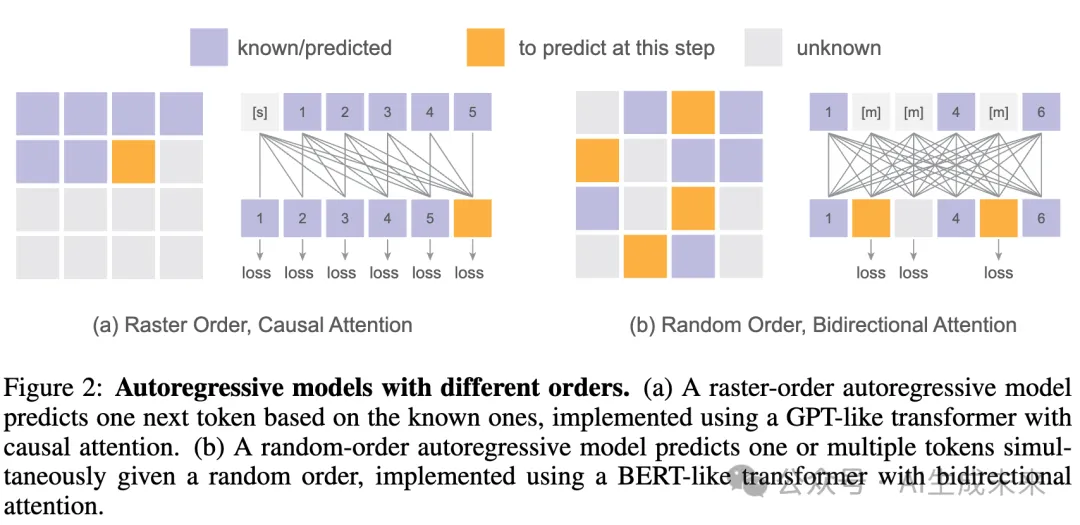

Transformer:在将原始图像编码为tokens序列后,使用一个标准的仅解码Transformer模型进行自回归生成。每个块由三个连续的层组成——自注意力、交叉注意力和MLP层。自注意力和MLP层仅应用于视觉tokens,而交叉注意力层则将视觉和文本tokens分别作为查询和键。如下图2所示,对于光栅顺序模型,Transformer使用自注意力块中的因果注意力基于先前的tokens预测下一个token,类似于GPT。在随机顺序模型中,未知的tokens由一个可学习的token masked,Transformer使用双向注意力来预测这些被masked的tokens,类似于BERT。

输出头:对于离散tokens,遵循自回归模型的常见做法。输出通过一个线性层后,使用softmax转换为类别分布,这个线性层的权重与输入embedding层的权重共享。对于连续tokens,应用一个六层轻量级的MLP作为扩散头来建模每个token的分布。该扩散头的嵌入维度与主干transformer相同。每个token的扩散过程遵循。噪声调度为余弦形状,训练时为1000步;在推理时,重新采样为100步。

实验

数据集:使用WebLI(Web Language Image)数据集的一个子集作为训练集,该数据集由网络上的图像-文本对组成,并且这些对在图像质量和alt文本相关性上都有高分。默认情况下,图像进行中心裁剪并调整大小为256×256。

推理:遵循Imagen、Muse和Parti的做法,根据文本提示生成图像,不进行拒绝采样。对于随机顺序模型,使用64步生成并按照余弦调度。为了进一步增强生成性能,应用了温度和无分类器引导,这是常见的做法。

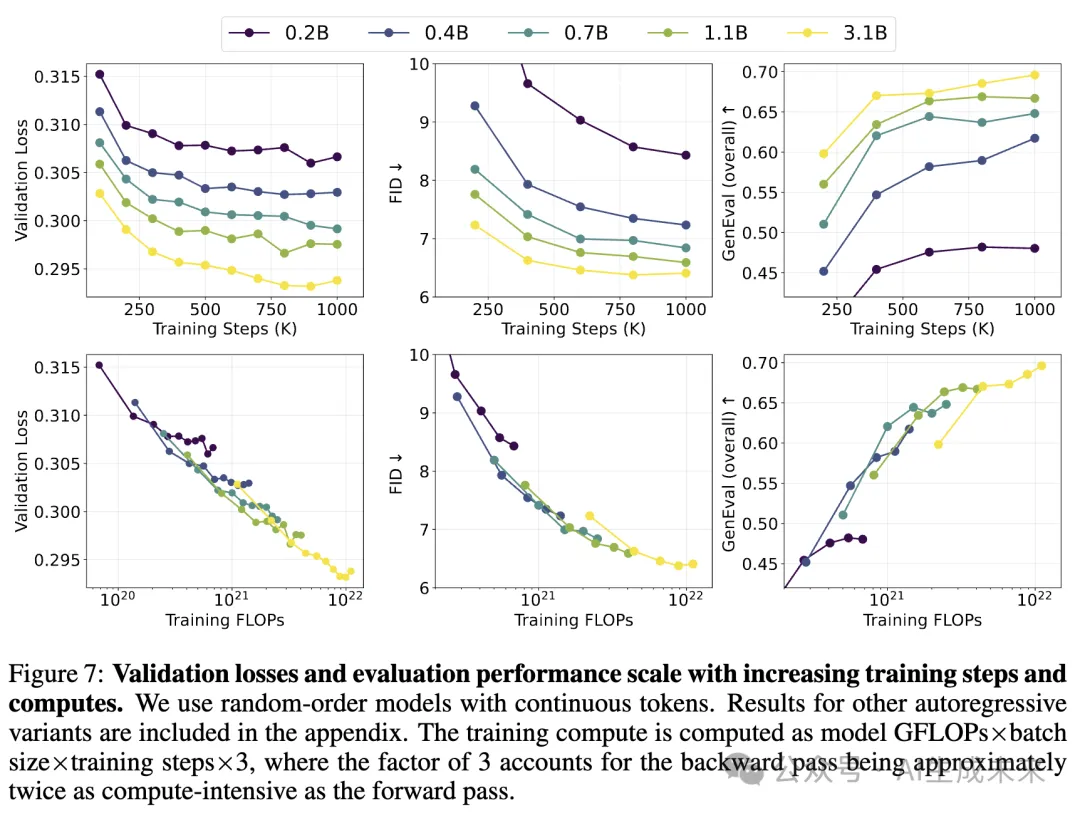

评估:对不同的自回归模型变体的扩展行为进行了定量和定性评估。定量评估包括在MS-COCO 2014训练集中的30K图像上计算验证损失,以及两个广泛采用的指标:MS-COCO上的零样本Frechet Inception Distance(FID)和GenEval分数。推理的超参数,如温度和无分类器引导,针对每个评估指标进行优化。FID是在MS-COCO 2014训练集中的30K随机选取的图像-文本对上计算的,用于评估生成图像的保真度和多样性。GenEval基准则衡量模型生成准确反映给定提示的图像的能力。对于定性评估,从几个提示中生成图像,并比较生成图像的视觉质量。

扩展行为

研究者们探索了自回归图像生成模型中的两个关键设计选择——token表示和生成顺序——如何影响性能和扩展行为。构建了具有这两种设计选择不同组合的模型,产生了四种不同的自回归图像生成模型变体。还探讨了这些模型在不同数据和评估指标上的泛化能力。本文的实验揭示了几个有趣的特性。

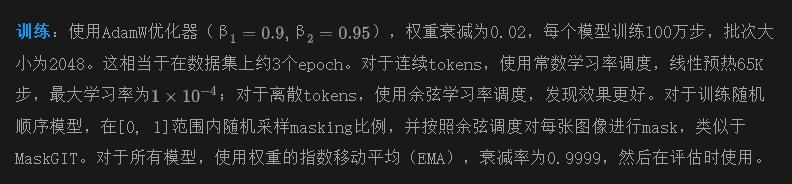

验证损失随模型规模线性扩展。在下图5中,研究者们考察了四种自回归变体在验证损失方面的扩展行为。验证损失和模型规模在对数空间中呈现线性关系,模型规模从1.5亿参数增加到30亿参数。这与Henighan等人发现的幂律规律相一致。这表明,增加模型规模所带来的训练损失改进能够很好地泛化到与训练数据不同的验证数据上。

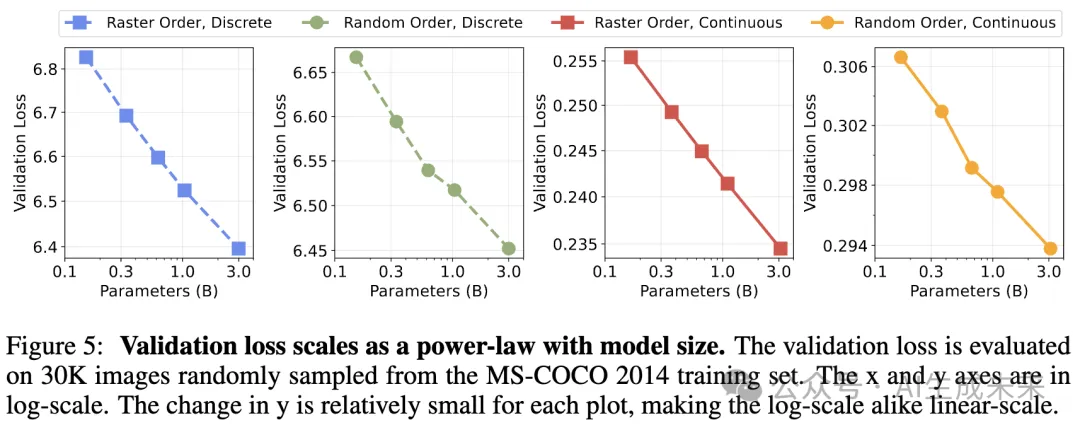

使用连续tokens的随机顺序模型在评估分数上的扩展表现最佳。下图6中分析了四种自回归变体在FID和GenEval总体分数方面的扩展行为。验证损失的改进并不总是线性地转化为更好的评估指标,这意味着这些指标与模型规模之间没有严格的幂律关系。例如,使用离散tokens的光栅顺序模型(蓝线)在约10亿参数时FID和GenEval分数趋于平稳。在四种变体中,使用连续tokens的随机顺序模型(即Fluid)在评估指标上显示出一致的改进,参数规模扩展至30亿,表现最佳。

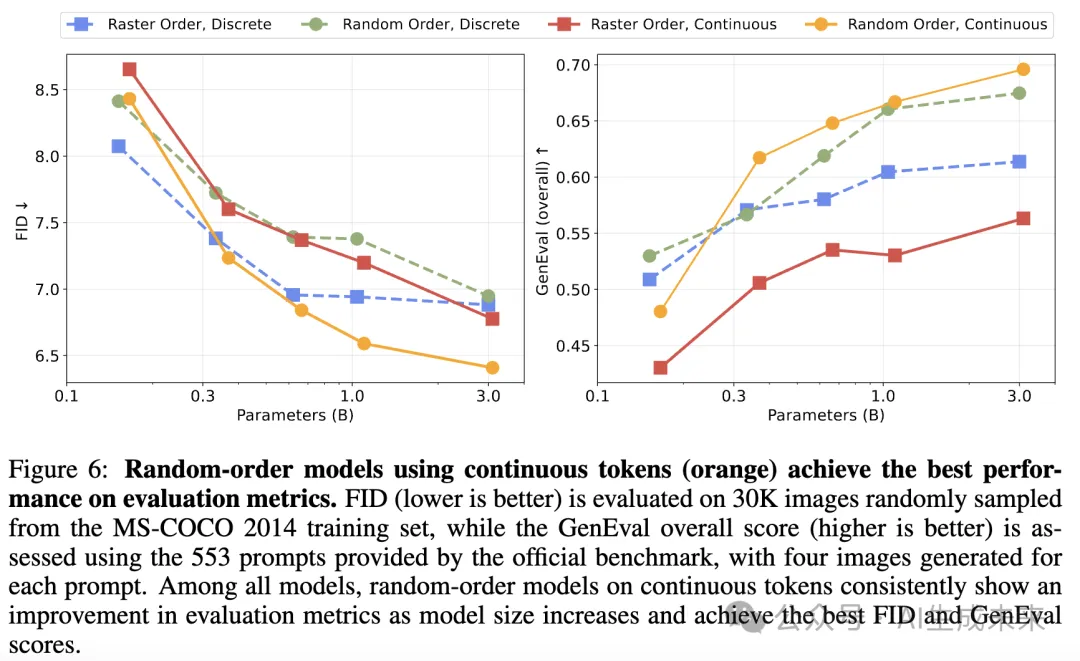

随机顺序模型的连续token随训练计算量扩展。下图7中绘制了不同大小的Fluid模型在总训练步数和计算量上的验证损失、FID和GenEval分数。随着训练步数和计算量的增加,验证损失和评估性能都表现出持续改进。然而,训练步数的收益在大约1M步时趋于饱和,这表明相比于训练较小模型更长时间,训练较大模型更少的步数在计算上更加高效。这一行为与语言模型中的观察结果一致,突显了在足够的训练条件下扩展模型大小的潜力。

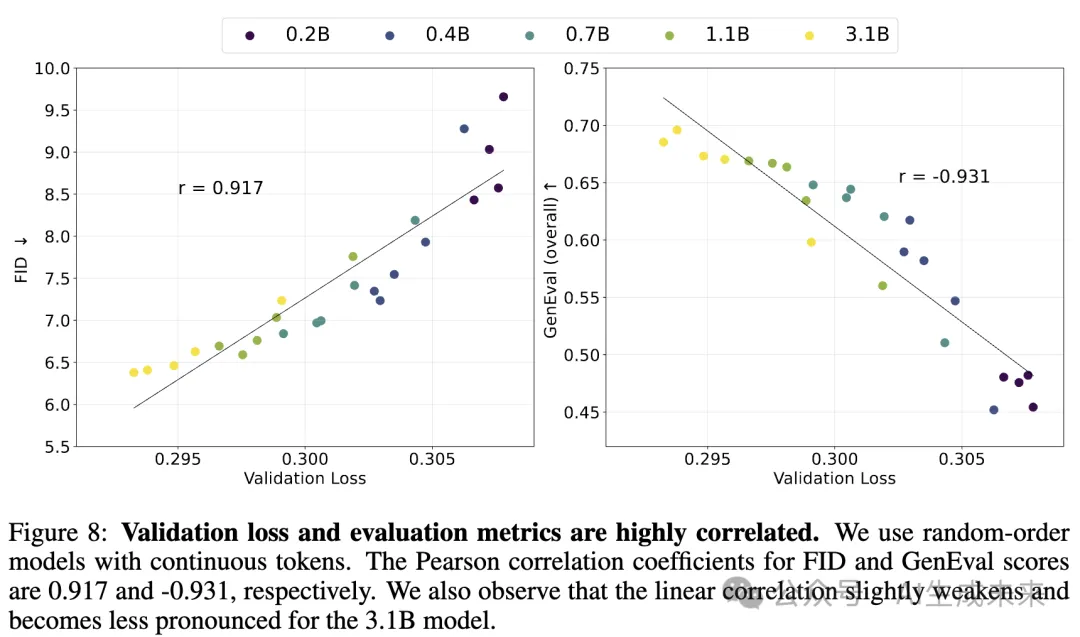

验证损失和评估指标之间的强相关性。下图8绘制了不同大小的Fluid模型的FID和GenEval分数与验证损失的关系,并观察到两者之间存在强相关性。为了量化这一关系,使用线性回归拟合了数据点。FID和GenEval分数的皮尔逊相关系数分别为0.917和-0.931,表明在150M到3B的模型规模范围内,验证损失与这些评估指标之间存在近乎线性的关系。训练了一个拥有10.5B参数、批次大小为4096的模型,并训练1M步,取得了最先进的文本生成图像性能。

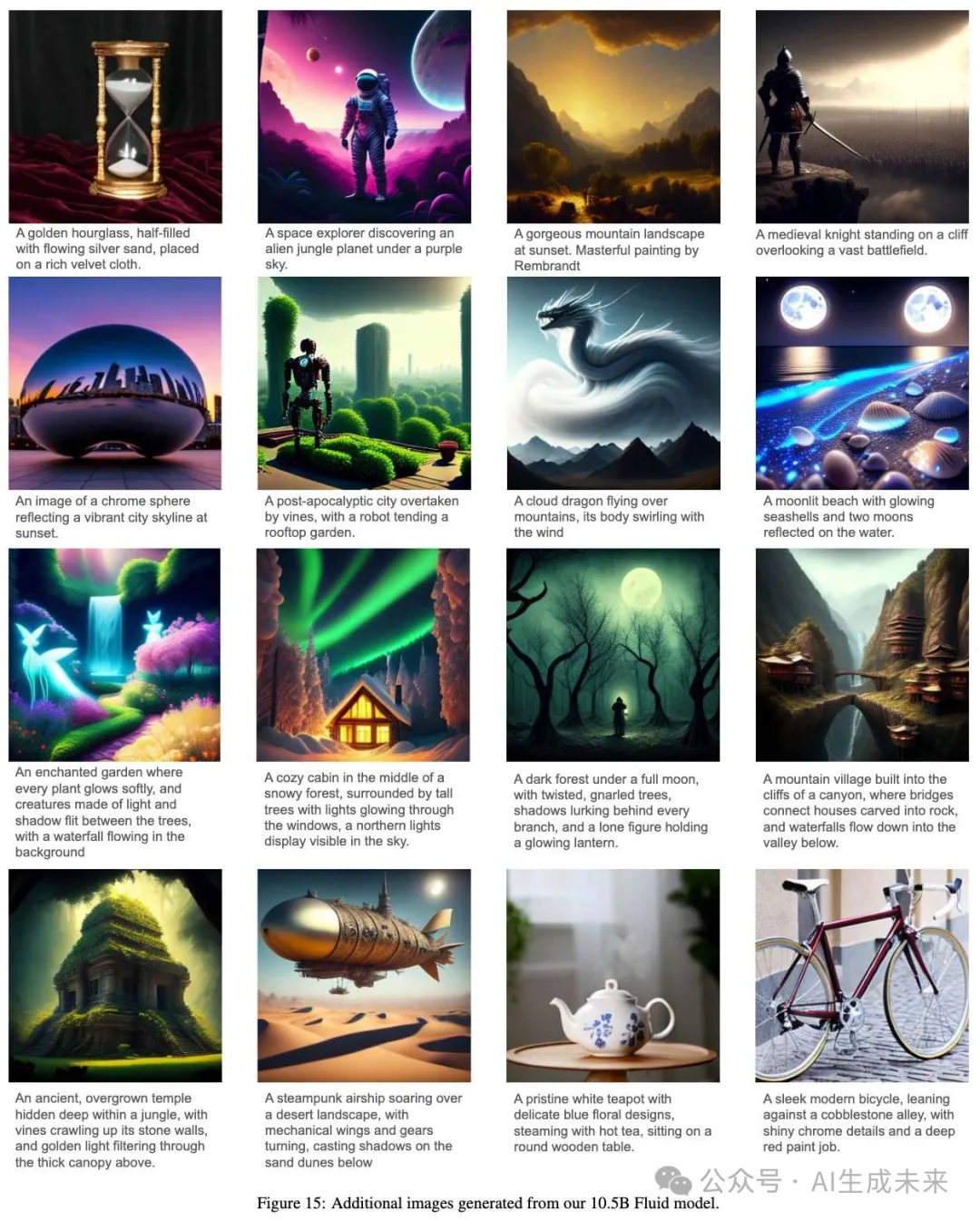

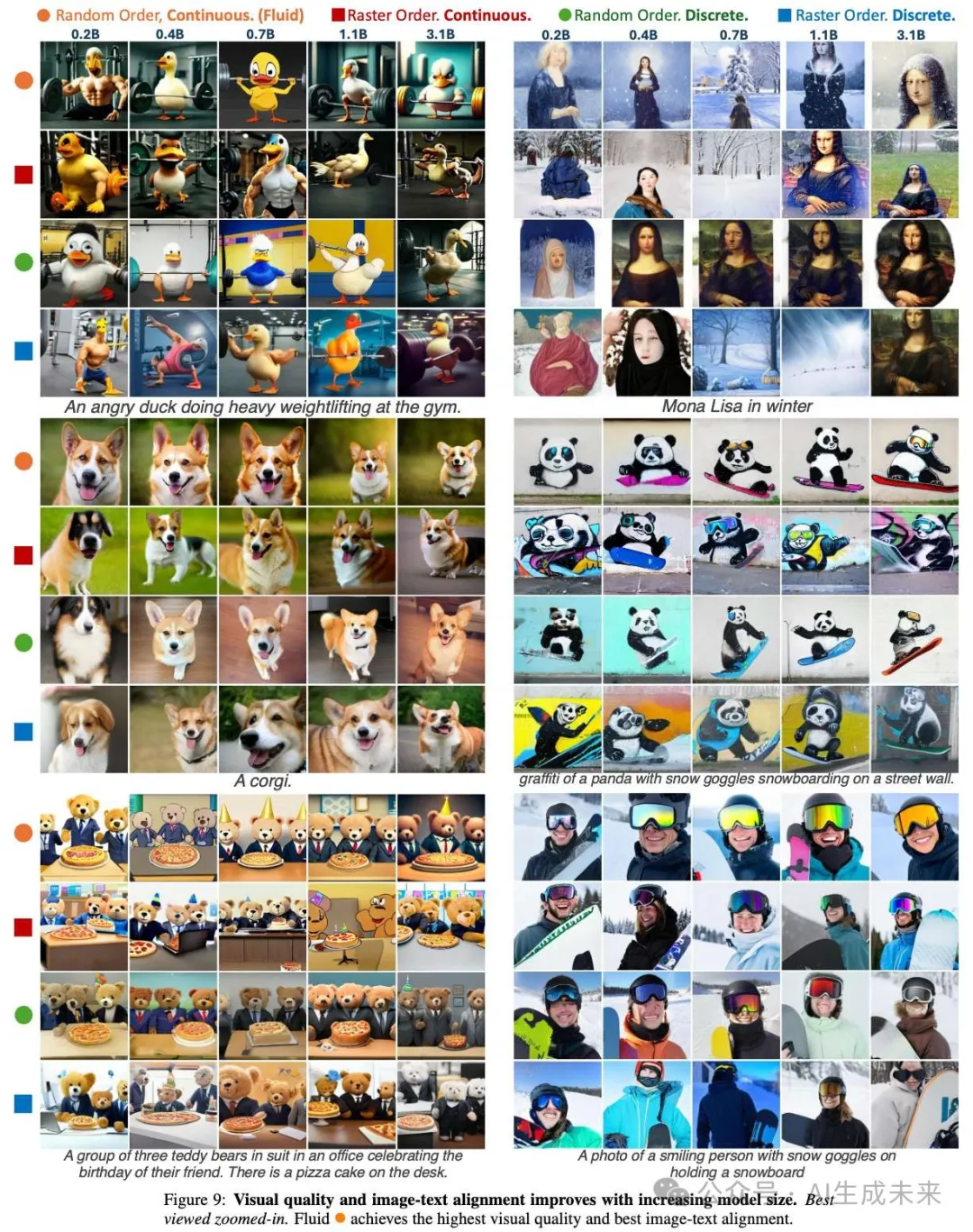

连续token和大模型对视觉质量至关重要。下图9比较了四种自回归变体生成的图像的视觉质量。使用离散token的模型生成的图像质量明显不如使用连续token的模型。例如,离散token模型生成的柯基犬的眼睛是不对称的,扩大模型规模无法解决这个问题。这个局限性主要是由于离散tokenizer引入了大量信息丢失。例如,即使拥有3B参数,使用离散token的模型也无法生成精确的《蒙娜丽莎》,这是因为tokenizer的重构质量较差(见前面图4)。相比之下,使用连续token的模型能够生成质量更高的图像。

此外,较大的模型在视觉质量和图像-文本对齐方面表现出持续改进。例如,一个拥有0.2B参数的随机顺序模型难以生成“一个愤怒的鸭子在健身房举重”,而拥有3B参数的相同模型则可以成功生成对应的图像。这表明,处理连续token并增加模型规模对于在自回归图像生成模型中实现高质量视觉效果至关重要。

与之前系统的对比

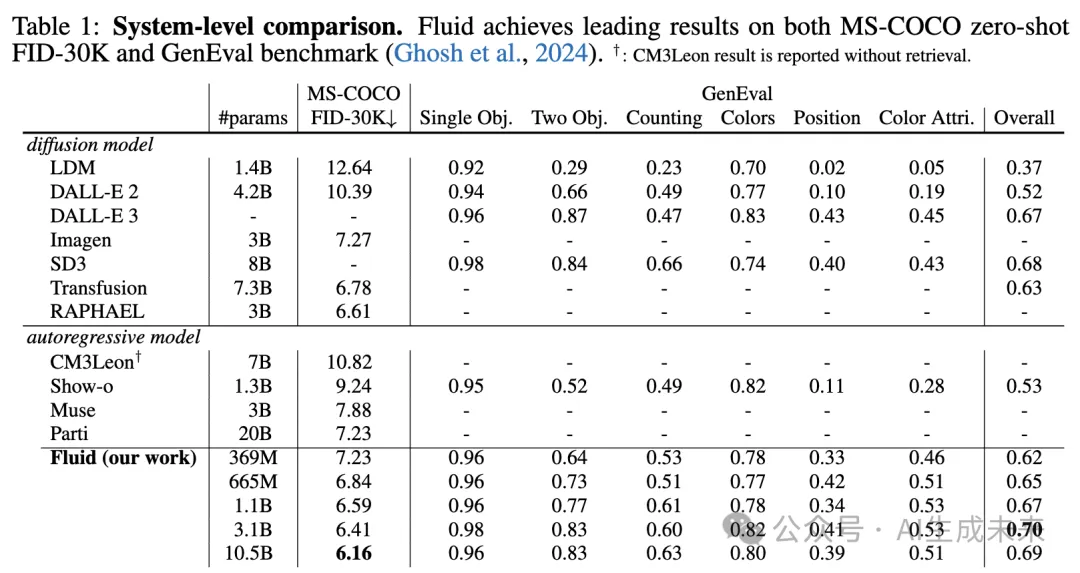

下表1为Fluid模型(即连续随机顺序自回归模型)与领先的文本生成图像系统进行比较。Fluid最小的模型,拥有369M参数,在MS-COCO数据集上实现了零样本FID 7.23和GenEval总分0.62,与许多拥有数十亿参数的最先进模型相匹敌(例如,Parti拥有20B参数仅实现了7.23)。Fluid最大的模型,拥有10.5B参数,进一步将MS-COCO数据集上的零样本FID提高到6.16,并将GenEval总分提升至0.692,在每个TPU上生成每张图像的速度为1.571秒(基于32 TPU v5,批次大小为2048)。

结论

本文对自回归模型在文本生成图像任务中的扩展行为进行了实证研究。探讨了两个关键设计因素:随机顺序与光栅顺序,以及离散token与连续token。结果表明,使用连续token的随机顺序模型在各种评估指标和视觉质量方面均表现出最佳的性能和扩展性。基于这些发现,将连续token的随机顺序模型(即Fluid)扩展至10.5B参数,取得了最先进的文本生成图像性能。希望这些发现和有前景的结果能为自回归模型在图像生成任务中的扩展性行为提供有价值的见解,并帮助缩小视觉模型与语言模型之间的性能差距。

本文转自AI生成未来,作者:AI生成未来