AI界的"小而美":Mistral AI的最新力作如何重新定义边缘计算 | 多智能体协作让大语言模型训练效率暴增

大模型领域的发展日新月异,每天都有许多有趣的论文值得深入品读。下面是本期觉得比较有意思的论文:

1、AI界的"小而美":Mistral AI的最新力作如何重新定义边缘计算

2、多智能体协作让大语言模型训练效率暴增

1、AI界的"小而美":Mistral AI的最新力作如何重新定义边缘计算

在人工智能飞速发展的今天,一个令人振奋的消息从Mistral AI传来。就在Mistral 7B模型发布一周年之际,这家创新公司再次为我们带来了惊喜:Ministral 3B和Ministral 8B——两款专为边缘计算和设备端应用而生的尖端模型。这两个被亲切地称为"les Ministraux"(小部长们)的模型,不仅在10B以下类别中树立了新的标杆,更是为AI的未来指明了方向。

想象一下,在没有网络的环境中,你的智能助手依然能够流畅地为你翻译文档、分析数据,甚至控制机器人。这正是Ministral模型的强项所在。它们不仅在知识储备、常识推理和功能调用等方面表现出色,更重要的是,它们将高性能与高效率完美结合。特别值得一提的是,Ministral 8B采用了创新的交错滑动窗口注意力模式,这意味着更快的推理速度和更低的内存占用。

但Mistral AI的野心不止于此。通过与更大型的语言模型(如Mistral Large)配合使用,Ministral系列可以在多步骤代理工作流中充当高效的中间人。它们能够以极低的延迟和成本处理输入解析、任务路由,并根据用户意图调用API。这种灵活性使得Ministral模型从独立爱好者到全球制造团队,都能找到其独特的应用场景。

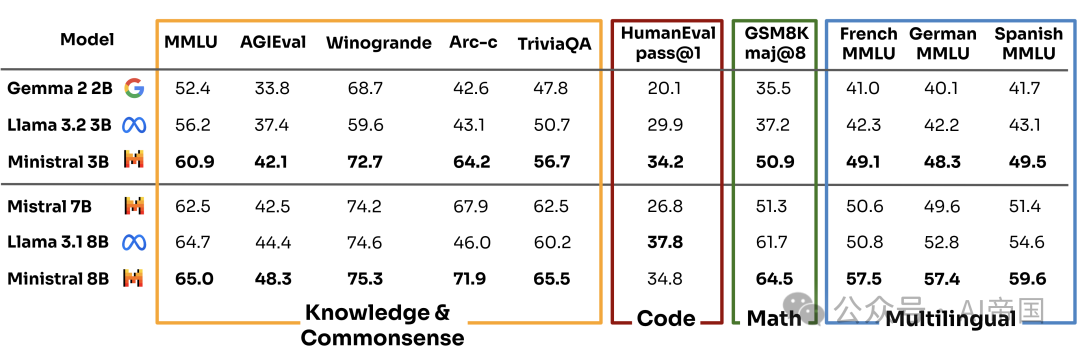

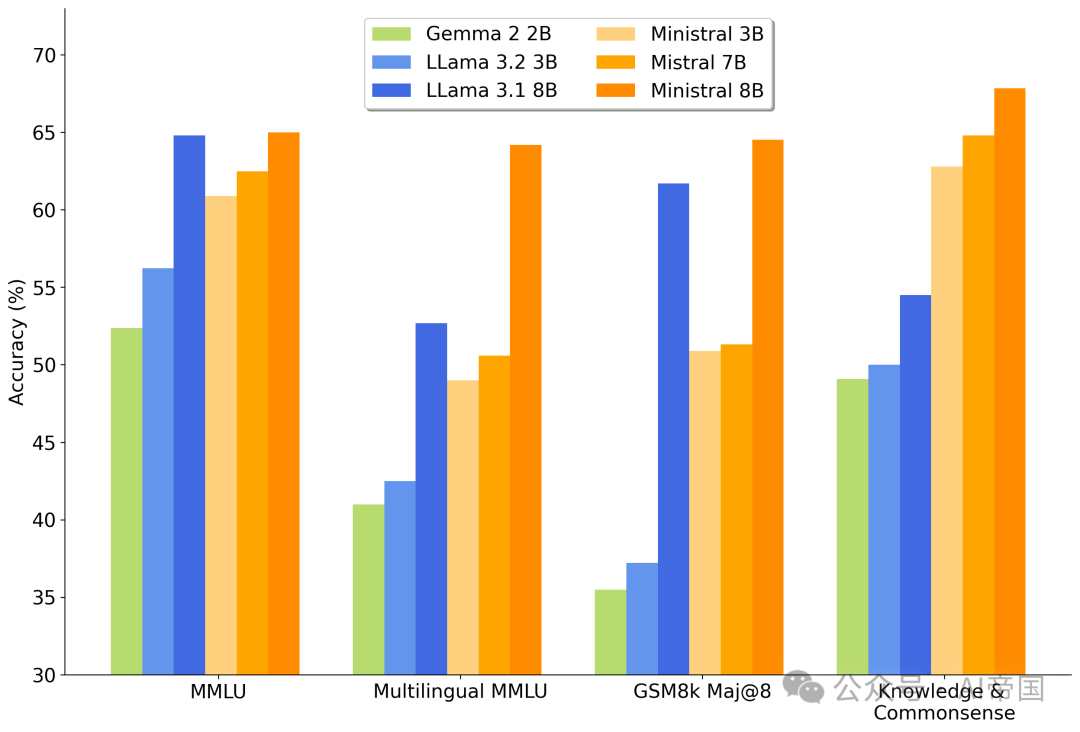

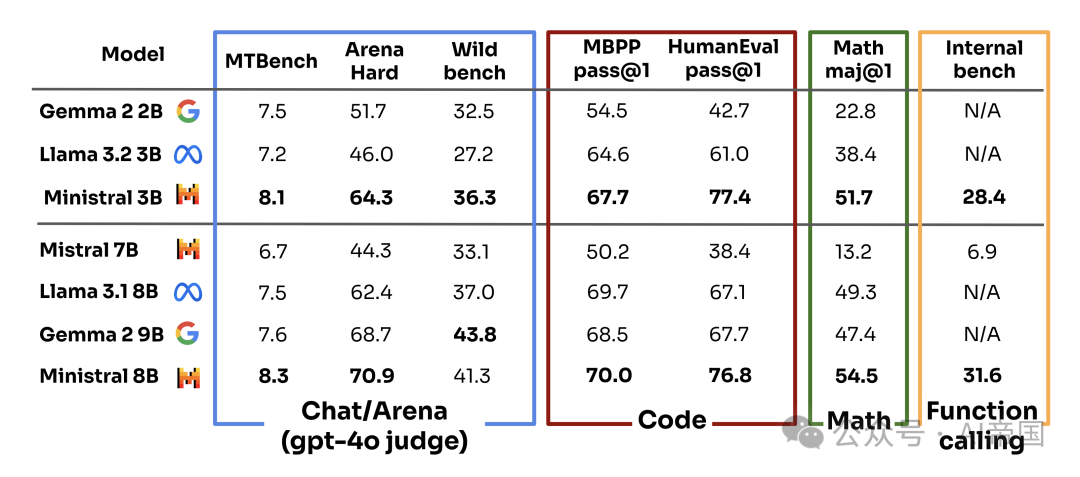

在各项基准测试中,Ministral系列的表现令人瞩目。无论是在预训练模型还是指令模型的评估中,它们都展现出了超越同类产品的实力。特别是Ministral 3B,尽管体积小巧,却在多数基准测试中超越了体积更大的Mistral 7B,这无疑是AI小型化和效率优化的一个重要里程碑。随着这些模型的商业化应用和进一步研究的展开,我们有理由相信,AI的"小而美"时代已经悄然来临。

链接:https://mistral.ai/news/ministraux/

2、多智能体协作让大语言模型训练效率暴增

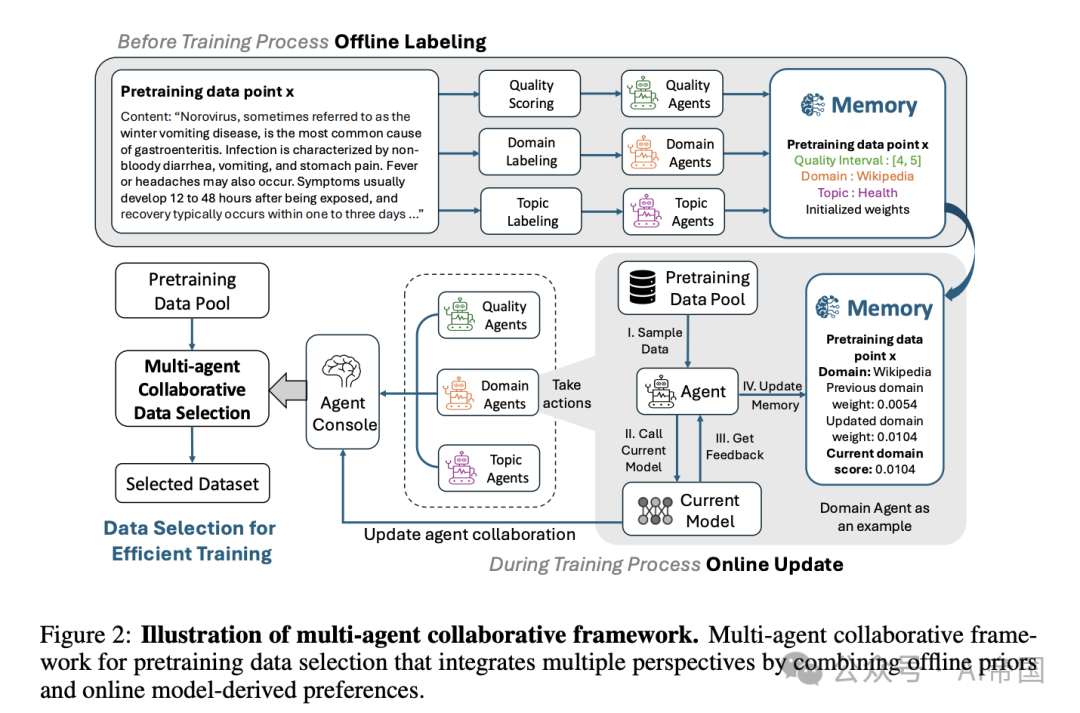

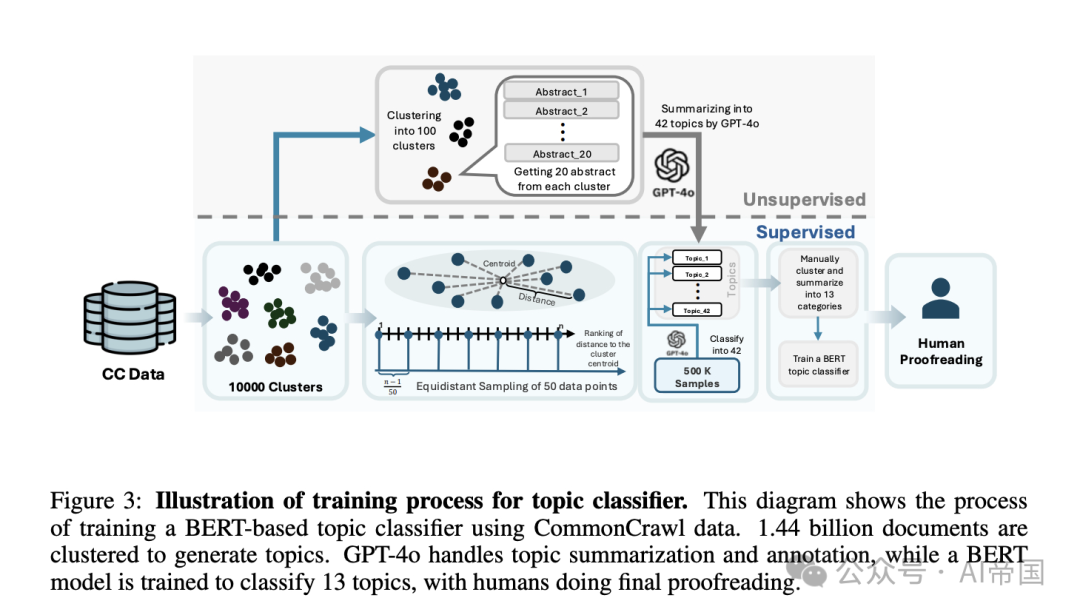

想象一下,如果能让多个"数据专家"共同为AI挑选最佳训练素材,会发生什么?一群研究者最近给出了令人振奋的答案!他们提出的多智能体协作数据选择机制,让大语言模型的训练效率突飞猛进,性能提升高达10.5%!

这项突破性研究巧妙地将不同的数据选择方法视为独立的"智能体"。每个智能体都有自己的专长,比如筛选高质量数据、平衡主题多样性等。更厉害的是,研究团队设计了一个"智能体控制台",能够在整个训练过程中动态整合所有智能体的信息,实现真正的协同作战。

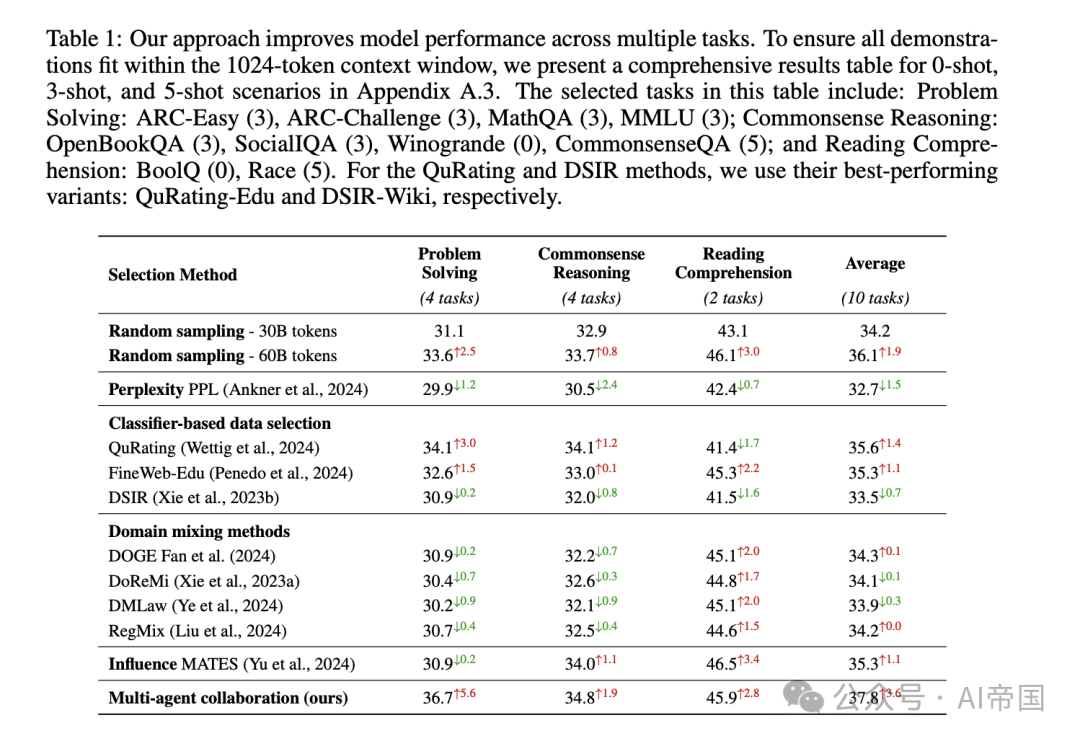

这种创新方法不仅大幅提升了数据效率,还加快了模型训练的收敛速度。在多项语言模型基准测试中,它的表现远超当前最先进的方法。这意味着我们可能很快就能看到更强大、训练更快的AI模型问世!

然而,这项研究的意义远不止于此。它为我们展示了一种全新的思路:通过智能协作,我们可以化解不同方法之间的冲突,让它们优势互补。这种方法不仅适用于AI训练,也可能启发其他领域的创新。未来,我们是否会看到更多领域出现类似的"最强大脑"协作模式呢?让我们拭目以待!

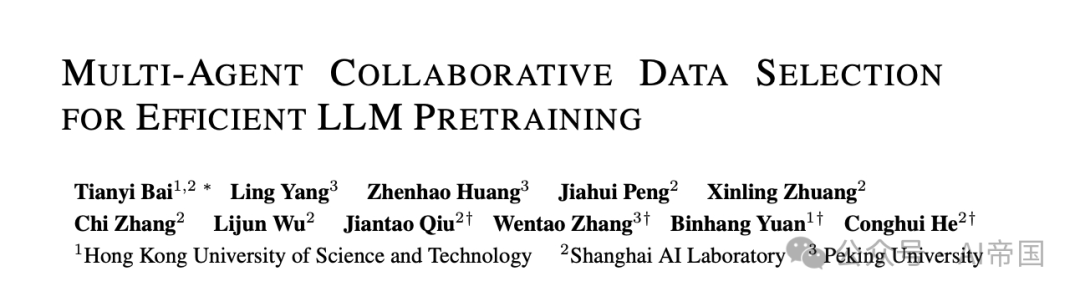

论文标题:Multi-Agent Collaborative Data Selection for Efficient LLM Pretraining

论文链接:https://arxiv.org/abs/2410.08102

本文转载自 AI帝国,作者: 无影寺