Llama 3.2:AI视觉革新,手机也能跑大模型

Meta最新发布的Llama 3.2不仅能"看",还能在你的手机上运行。这次更新带来了多模态支持的Llama Vision和专为设备端优化的"tiny"模型,共推出10个新模型,规模从1B纯文本到90B多模态(文本+图像)不等。

Llama 3.2的核心亮点:

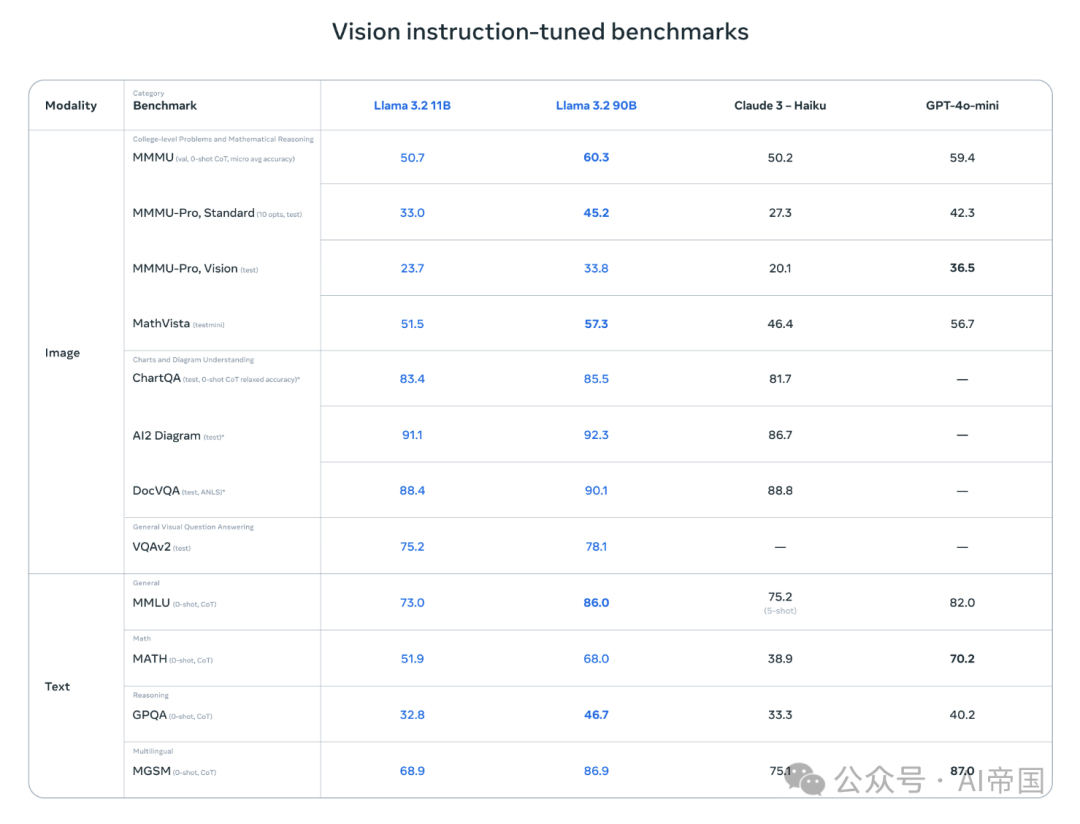

1.Llama 3.2 Vision:推出11B和90B两种规模的多模态模型,支持文本+图像输入并生成文本输出。这些模型基于Llama 3.1文本模型,通过6B图像-文本对训练而成。

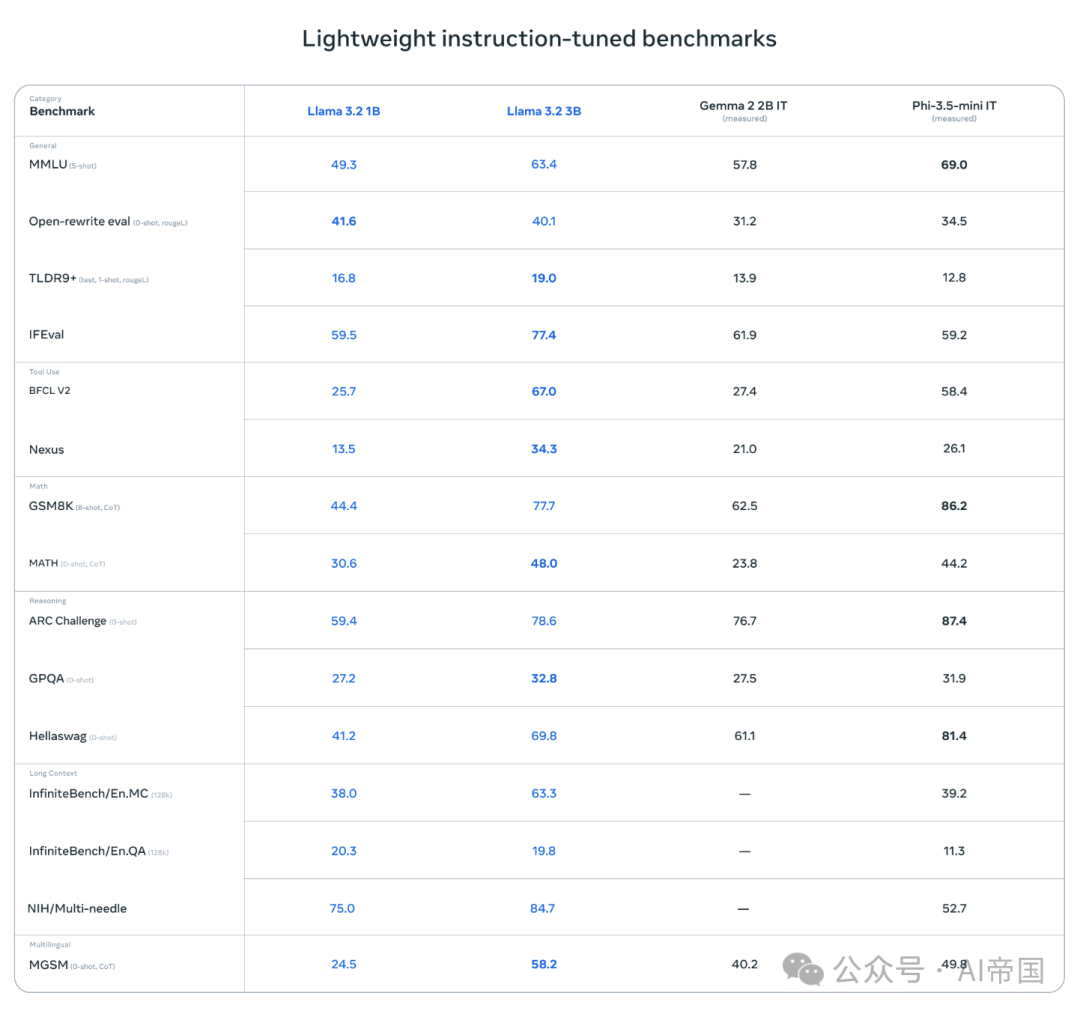

2.Llama 3.2 Edge:专为高效本地部署设计的1B和3B多语言纯文本模型。

3.所有Llama 3.2模型均支持128k token的超长上下文。

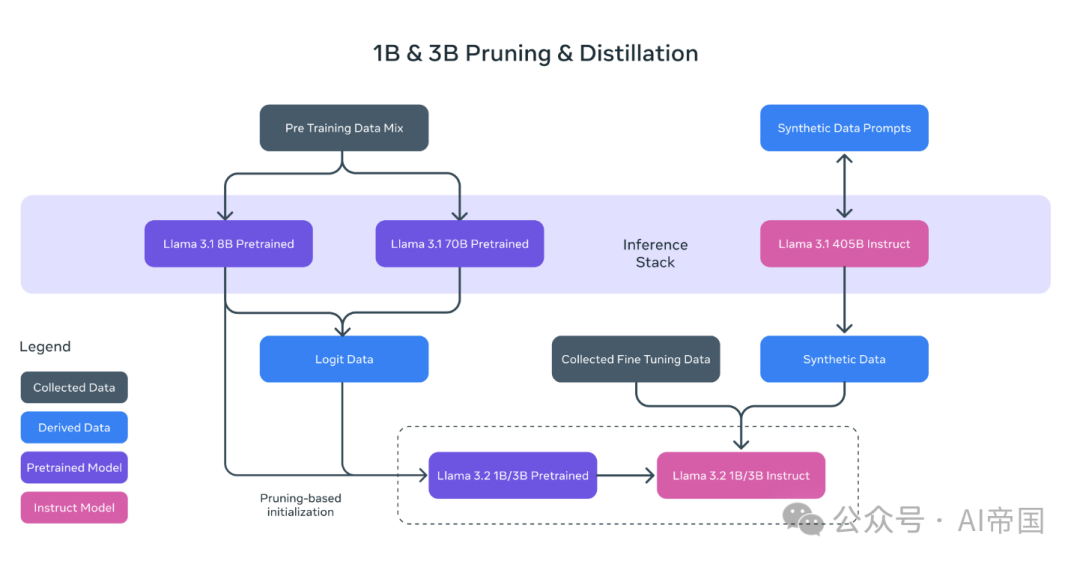

4.新训练方法:通过知识蒸馏和剪枝技术,从8B/70B模型中提炼出高效的1B/3B模型。

5.Llama Guard 3.2:两个增强版安全守护模型,新增视觉支持功能。

6.性能突破:Llama 3.2 3B模型在IFEval评测中达到了Llama 3.1 8B的水平,为设备端RAG或智能代理应用提供了强大支持。

Llama 3.2的发布标志着边缘AI和视觉技术的新纪元。此次更新引入了小型和中型视觉大语言模型(11B和90B),以及适用于移动设备的轻量级文本模型(1B和3B)。这些模型支持高达128K的上下文长度,旨在实现本地处理的即时性与隐私保护,满足用户在摘要、指令跟随和文本重写等任务中的需求。

在图像理解领域,Llama 3.2的视觉模型表现出色,能够处理文档级理解、图表解读及图像标注等任务。通过与大语言模型的无缝对接,用户可以直接用自然语言提问,模型将结合图像信息提供精确的答案。此外,这些模型通过在本地运行,保证了数据的私密性,使得应用程序在安全性和效率上都得到了极大的提升。

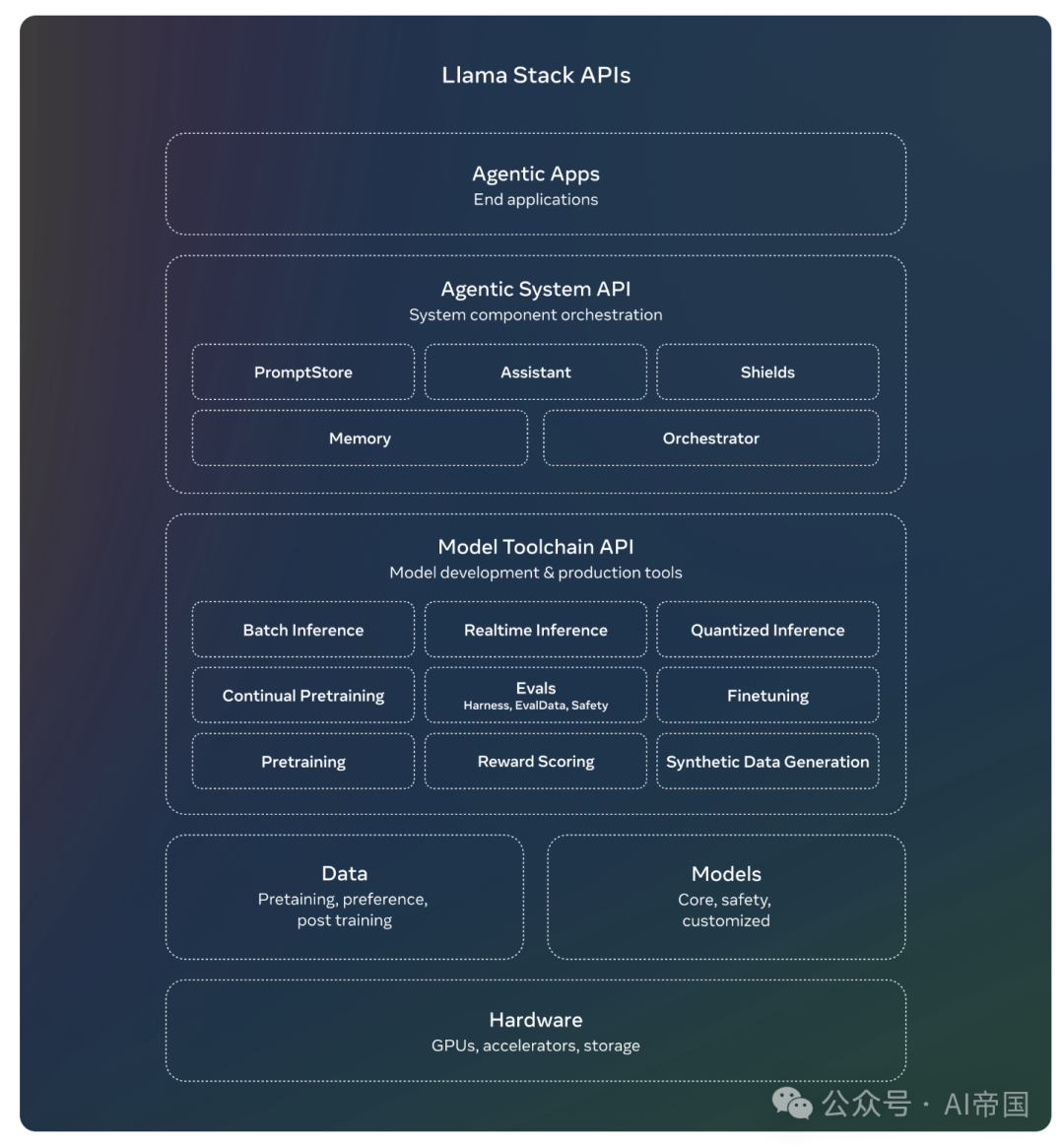

Llama 3.2的架构创新使其在处理图像与文本的结合时表现更为出色。通过引入适配器技术,模型不仅保持了文本处理的强大能力,还增添了对图像的深度理解与推理能力。Meta还与多家合作伙伴共同开发了Llama Stack分发版,简化了开发者在不同环境下的使用流程,推动了生成式AI的可用性与创新性。

总之,Llama 3.2不仅增强了边缘设备的AI能力,还为开发者提供了丰富的自定义选项。随着开放性与可修改性的持续推进,Llama 3.2将推动更多创造性和实用性的突破,改变我们与AI互动的方式。

链接:https://ai.meta.com/blog/llama-3-2-connect-2024-vision-edge-mobile-devices/