详解Latte:应用于文生视频的DiT模型

论文题目:

Latte: Latent Diffusion Transformer for Video Generation

论文链接:

https://arxiv.org/pdf/2401.03048v1.pdf

开源链接:

https://github.com/Vchitect/Latte

项目主页:

https://maxin-cn.github.io/latte_project/

先来看下Latte的视频生成效果。

一、 方法介绍

总体上,Latte 包含两个主要模块:预训练 VAE 和视频 DiT。预训练 VAE 编码器将视频逐帧从像素空间压缩到隐空间,视频 DiT 对隐式表征提取 token 并进行时空建模,最后 VAE 解码器将特征映射回像素空间生成视频。为了得到最优的视频质量,作者着重探究了 Latte 设计中两个重要内容,(1) 视频 DiT 模型整体结构设计以及 (2) 模型与训练细节的最优设计(The best practices)。

1.1 Latte 整体模型结构设计探究

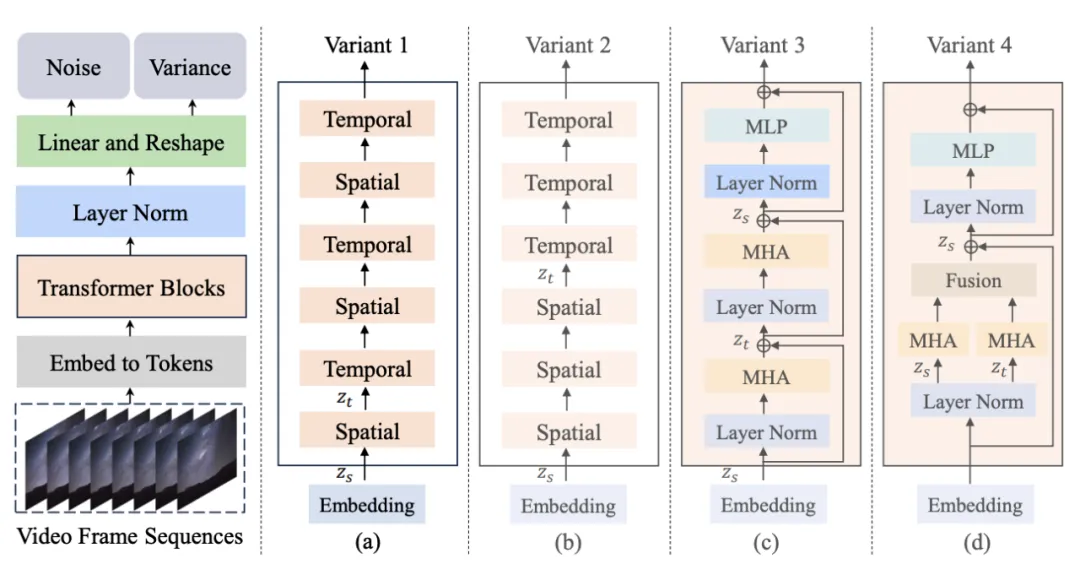

图 1. Latte 模型结构及其变体

作者提出了 4 种不同的 Latte 变体 (图 1),从时空注意力机制的角度设计了两种 Transformer 模块,同时在每种模块中分别研究了两种变体(Variant):

1.单注意力机制模块,每个模块中只包含时间或者空间注意力。

时空交错式建模 (Variant 1): 时间模块插入到各个空间模块之后。

时空顺序式建模 (Variant 2): 时间模块整体置于空间模块之后。

2. 多注意力机制模块,每个模块中同时包含时间与空间注意力机制 (Open-sora所参考变体)。

串联式时空注意力机制 (Variant 3): 时空注意力机制串行建模。

并联式时空注意力机制 (Variant 4): 时空注意力机制并行建模并特征融合。

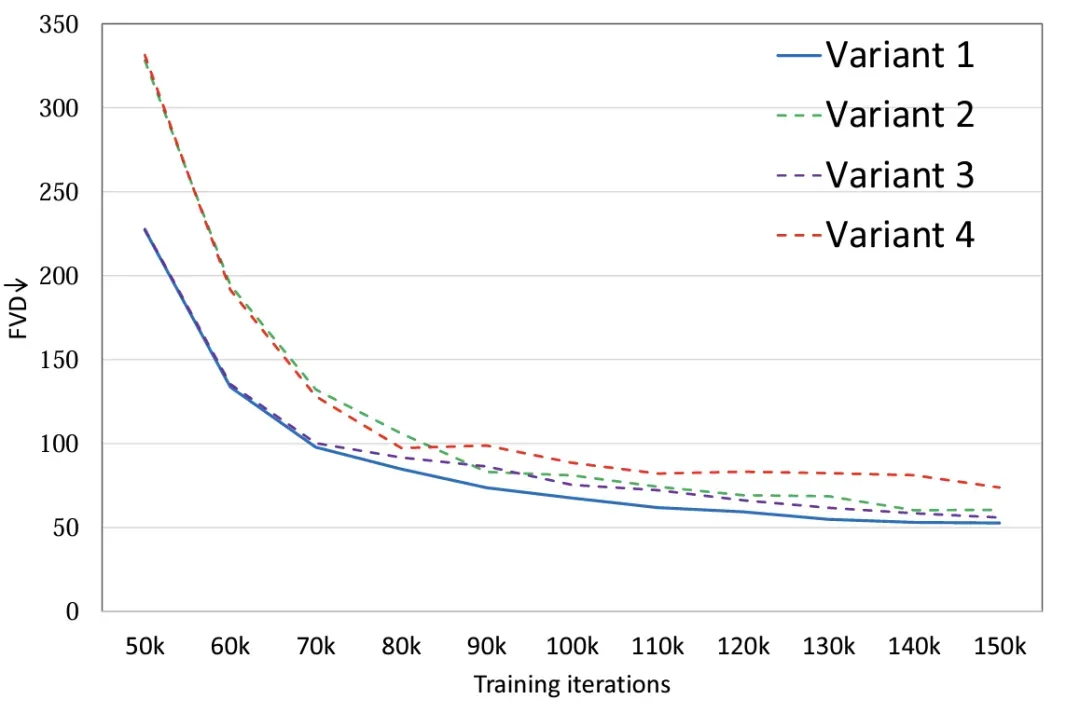

实验表明 (图 2),通过对 4 种模型变体设置相同的参数量,变体 4 相较于其他三种变体在 FLOPS 上有着明显的差异,因此 FVD 上也相对最高,其他 3 种变体总体性能类似,变体 1 取得了最优异的性能,作者计划未来在大规模的数据上做更加细致的讨论。

图 2. 模型结构 FVD

1.2 Latte 模型与训练细节的最优设计探究(The best practices)

除了模型总体结构设计,作者还探究了其他模型与训练中影响生成效果的因素。

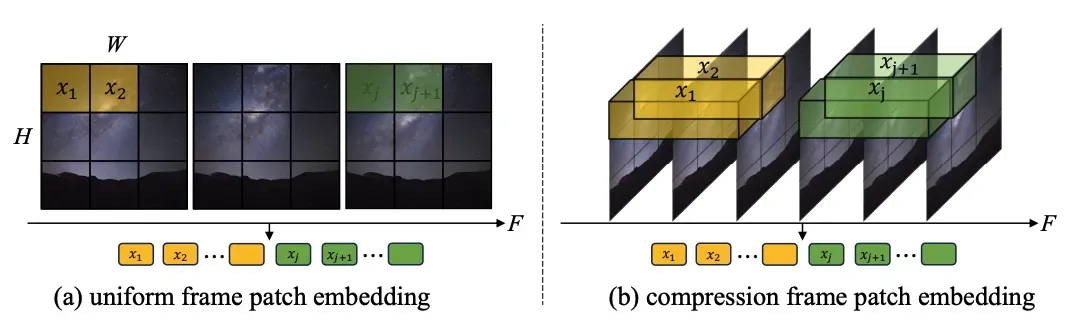

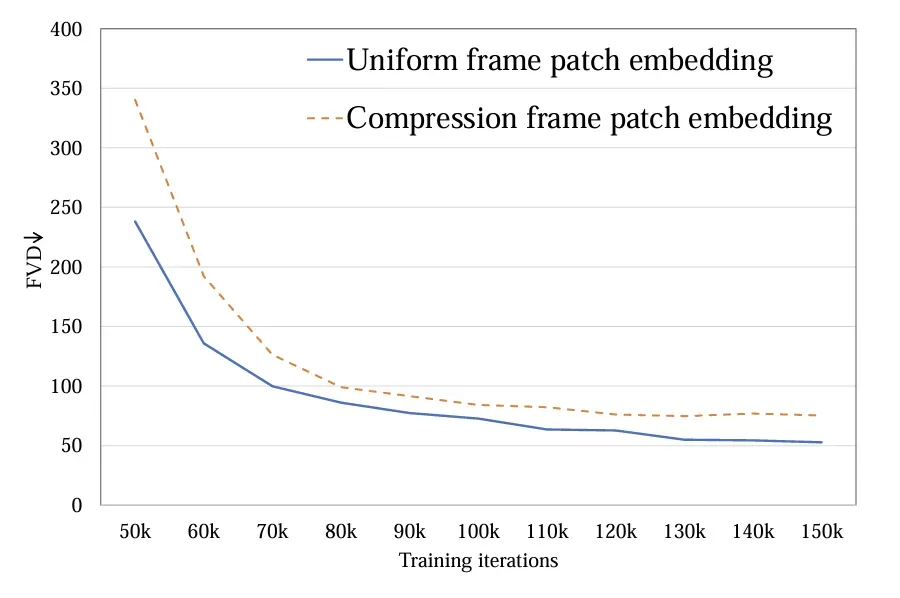

1.Token 提取:探究了单帧 token(a)和时空 token(b)两种方式,前者只在空间层面压缩 token,后者同时压缩时空信息。实验显示单帧 token 要优于时空 token(图 4)。与 Sora 进行比较,作者猜测 Sora 提出的时空 token 是通过视频 VAE 进行了时间维度的预压缩,而在隐空间上与 Latte 的设计类似都只进行了单帧 token 的处理。

图 3. Token 提取方式,(a) 单

帧 token 和 (b) 时空 token

图 4. Token 提取 FVD

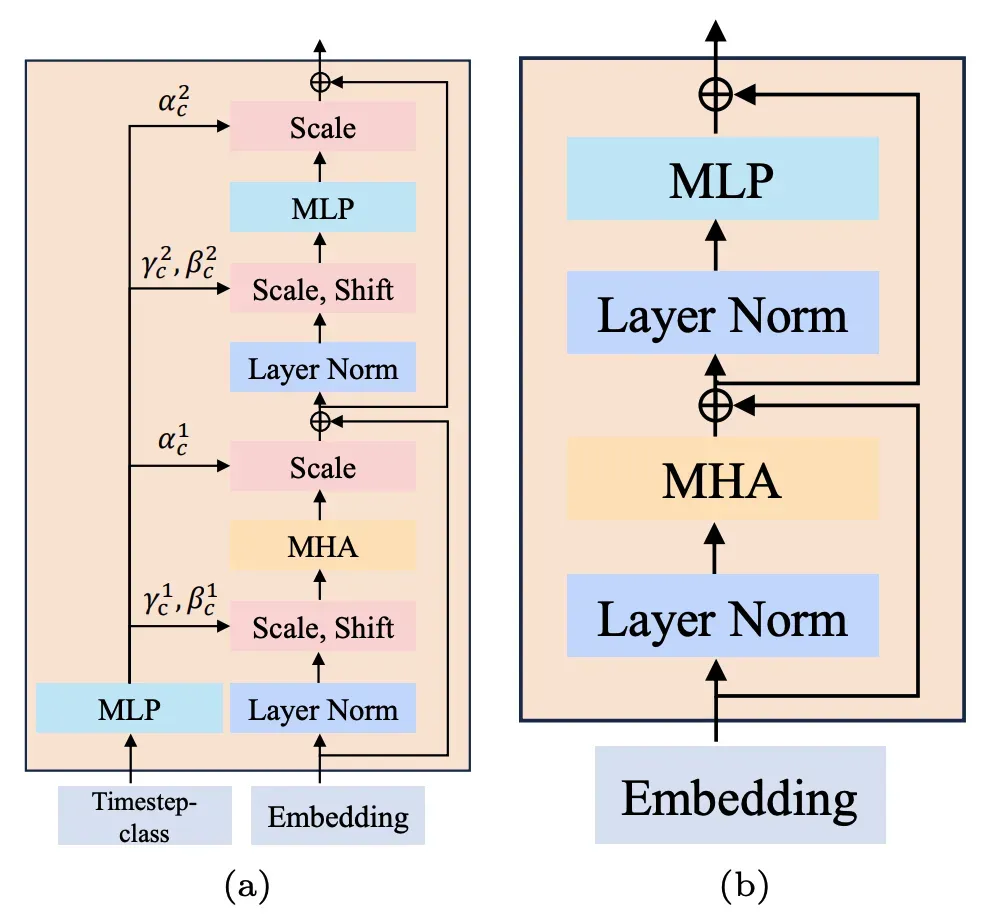

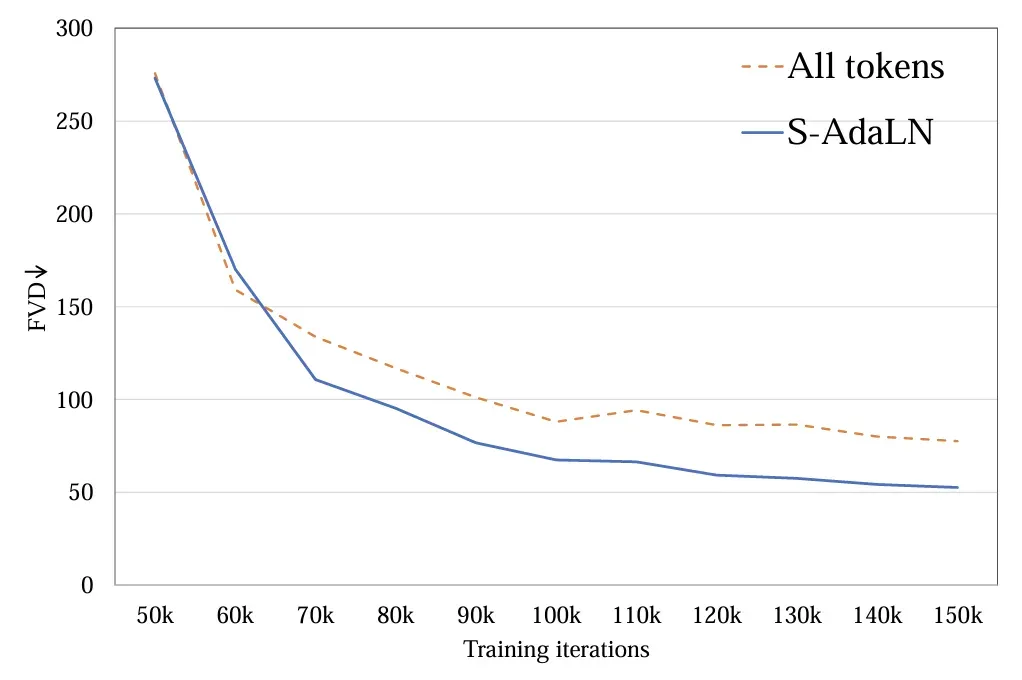

2.条件注入模式:探究了(a)S-AdaLN 和(b)all tokens 两种方式 (图 5)。S-AdaLN 通过 MLP 将条件信息转换为归一化中的变量注入到模型中。All token 形式将所有条件转化为统一的 token 作为模型的输入。实验证明,S-AdaLN 的方式相较于 all token 对于获得高质量的结果更加有效 (图 6)。原因是,S-AdaLN 可以使信息被直接注入到每一个模块。而 all token 需要将条件信息从输入逐层传递到最后,存在着信息流动过程中的损失。

图 5. (a) S-AdaLN 和 (b) all tokens。

图 6. 条件注入方式 FVD

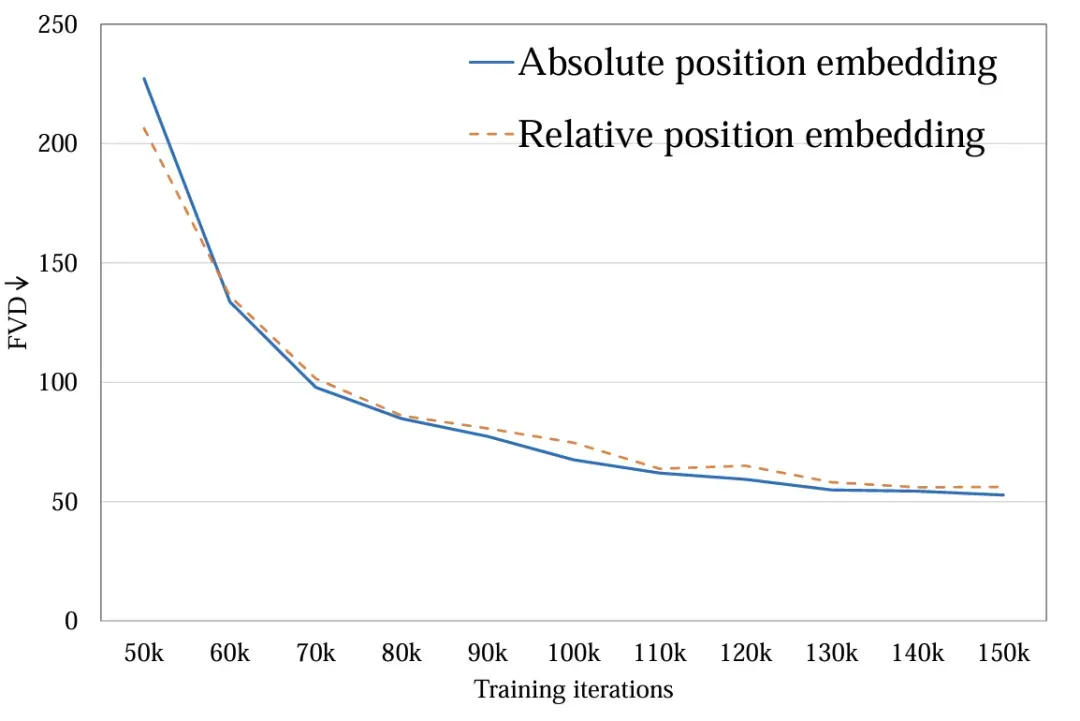

3.时空位置编码:探究了绝对位置编码与相对位置编码。不同的位置编码对最后视频质量影响很小 (图 7)。由于生成时长较短,位置编码的不同不足以影响视频质量,对于长视频生成,这一因素需要被重新考虑。

图 7. 位置编码方式 FVD

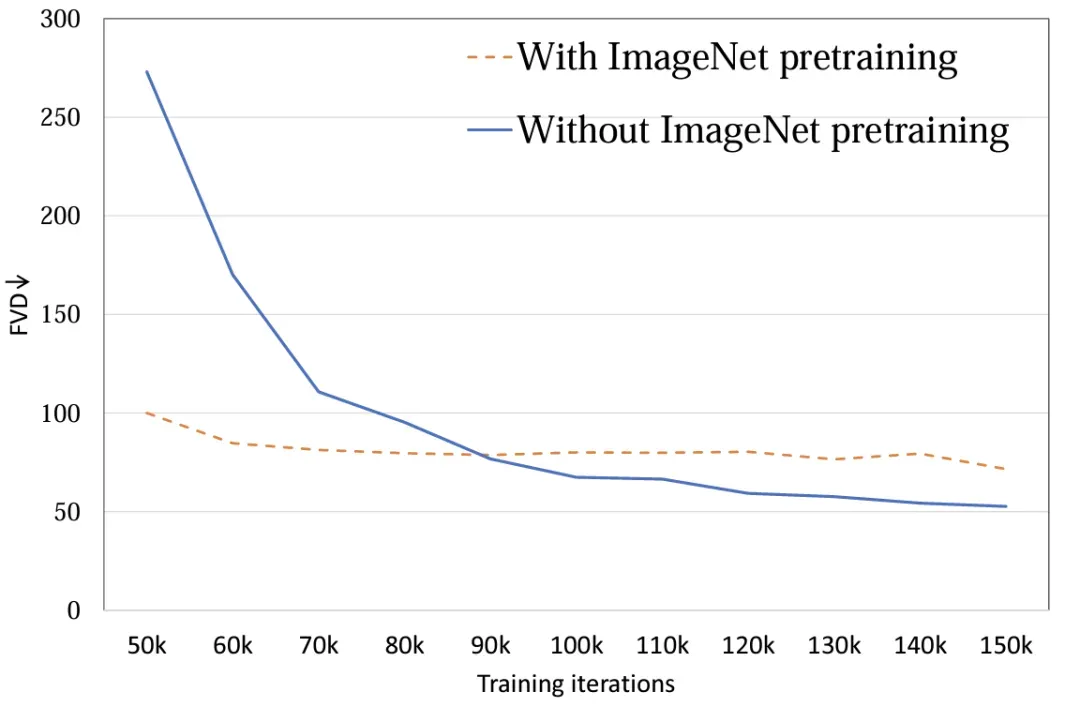

4.模型初始化:探究使用 ImageNet 预训练参数初始化对模型性能的影响。实验表明,使用 ImageNet 初始化的模型具有较快的收敛速度,然而,随着训练的进行,随机初始化的模型却取得了较好的结果 (图 8)。可能的原因在于 ImageNet 与训练集 FaceForensics 存在着比较大的分布差异,因此未能对模型的最终结果起到促进作用。而对于文生视频任务而言,该结论需要被重新考虑。在通用数据集的分布上,图像与视频的内容空间分布相似,使用预训练 T2I 模型对于 T2V 可以起到极大的促进作用。

图 8. 初始化参数 FVD

5.图像视频联合训练:将视频与图像压缩为统一 token 进行联合训练,视频 token 负责优化全部参数,图像 token 只负责优化空间参数。联合训练对于最终的结果有着显著的提升 (表 2 和表 3),无论是图片 FID,还是视频 FVD,通过联合训练都得到了降低,该结果与基于 UNet 的框架 [2][3] 是一致的。

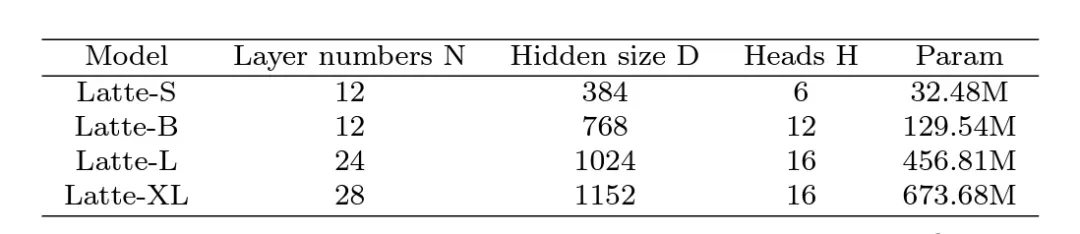

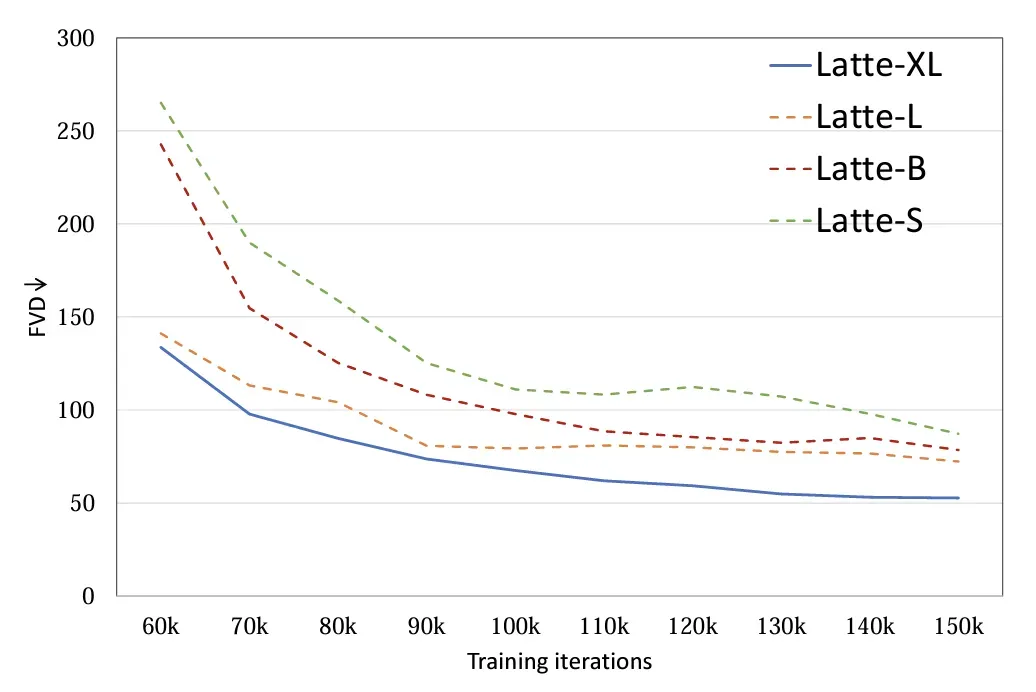

6.模型尺寸:探究了 4 种不同的模型尺寸,S,B,L 和 XL (表 1)。扩大视频 DiT 规模对于提高生成样本质量有着显著的帮助 (图 9)。该结论也证明了在视频扩散模型中使用 Transformer 结构对于后续 scaling up 的正确性。

表 1. Latte 不同尺寸模型规模

图 9. 模型尺寸 FVD

三、定性与定量分析

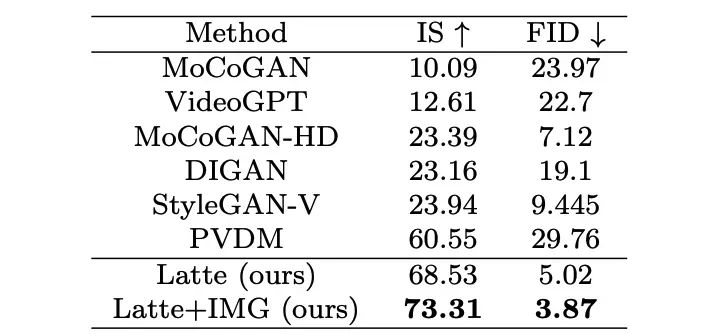

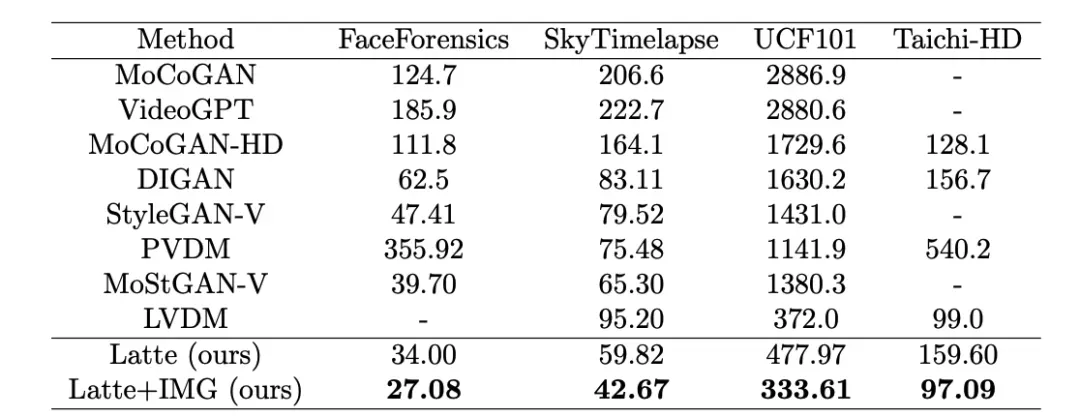

作者分别在 4 个学术数据集(FaceForensics,TaichiHD,SkyTimelapse 以及 UCF101)进行了训练。定性与定量(表 2 和表 3)结果显示 Latte 均取得了最好的性能,由此可以证明模型整体设计是具有优异性的。

表 2. UCF101 图片质量评估

表 3. Latte 与 SoTA 视频质量评估

三、文生视频扩展

为了进一步证明 Latte 的通用性能,作者将 Latte 扩展到了文生视频任务,利用预训练 PixArt-alpha [4] 模型作为空间参数初始化,按照最优设计的原则,在经过一段时间的训练之后,Latte 已经初步具备了文生视频的能力。后续计划通过扩大规模验证 Latte 生成能力的上限。

四、讨论与总结

Latte 作为全世界首个开源文生视频 DiT,已经取得了很有前景的结果,但由于计算资源的巨大差异,在生成清晰度,流畅度上以及时长上与 Sora 相比还具有不小的差距。团队欢迎并在积极寻求各种合作,希望通过开源的力量,打造出性能卓越的自主研发大规模通用视频生成模型。

参考文献

[1] Peebles, William, and Saining Xie. "Scalable diffusion models with transformers." Proceedings of the IEEE/CVF International Conference on Computer Vision. 2023.

[2] Ho, Jonathan, et al. Imagen video: High definition video generation with diffusion models. arXiv preprint arXiv:2210.02303 (2022)

[3] Wang, Yaohui, et al. "Lavie: High-quality video generation with cascaded latent diffusion models." arXiv preprint arXiv:2309.15103 (2023).

[4] Chen, Junsong, et al. "PixArt-: Fast Training of Diffusion Transformer for Photorealistic Text-to-Image Synthesis." arXiv preprint arXiv:2310.00426 (2023).

Illustration From IconScout By 22