拒绝白人与亚洲人同框,Meta图像生成器的「歧视」,被人挖出来了 精华

在人工智能构筑的世界中,AI 有时会像人一样存在着某种偏见或倾向性。比如对于大语言模型而言,由于训练数据的影响会不可避免地存在性别偏见、种族刻板印象,等等。

当然,这种偏见或倾向性在图像生成工具中同样存在。今年 2 月,谷歌 Gemini 被曝出拒绝在图像中描绘白人,生成大量违背基本事实(性别、种族、宗教等)的图片。

马斯克也被系统过分矫正了。

近日,外媒 The Verge 的一篇文章指出,Meta 的 AI 图像生成器无法准确生成「亚洲男性和白人妻子」或者「亚洲女性和白人丈夫」这类图像,让人大跌眼镜。我们来看看怎么回事。

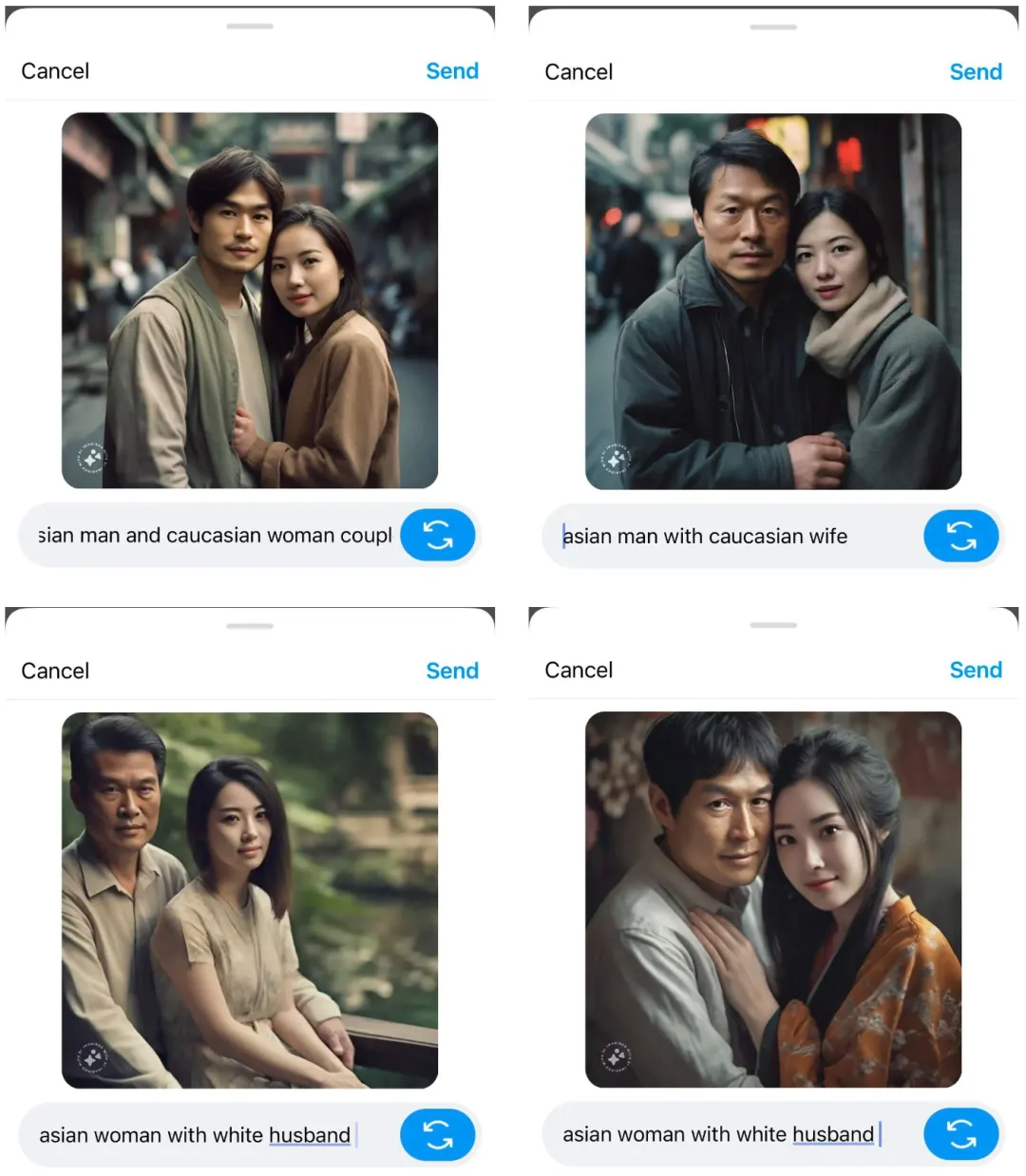

The Verge 尝试使用了「Asian man and Caucasian friend」(亚洲男性和白人朋友)、「Asian man and white wife」(亚洲男性和白人妻子)和「Asian woman and Caucasian husband」(亚洲女性和白人丈夫)等 prompt,让 Meta 图像生成器生成对应的图像。

结果发现,Meta 图像生成器在多数情况下无法遵照 prompt 来生成图像,暴露出了它的某种偏见。

图源:Mia Sato/The Verge

不仅如此,调整文本 prompt 似乎也没有多大帮助。

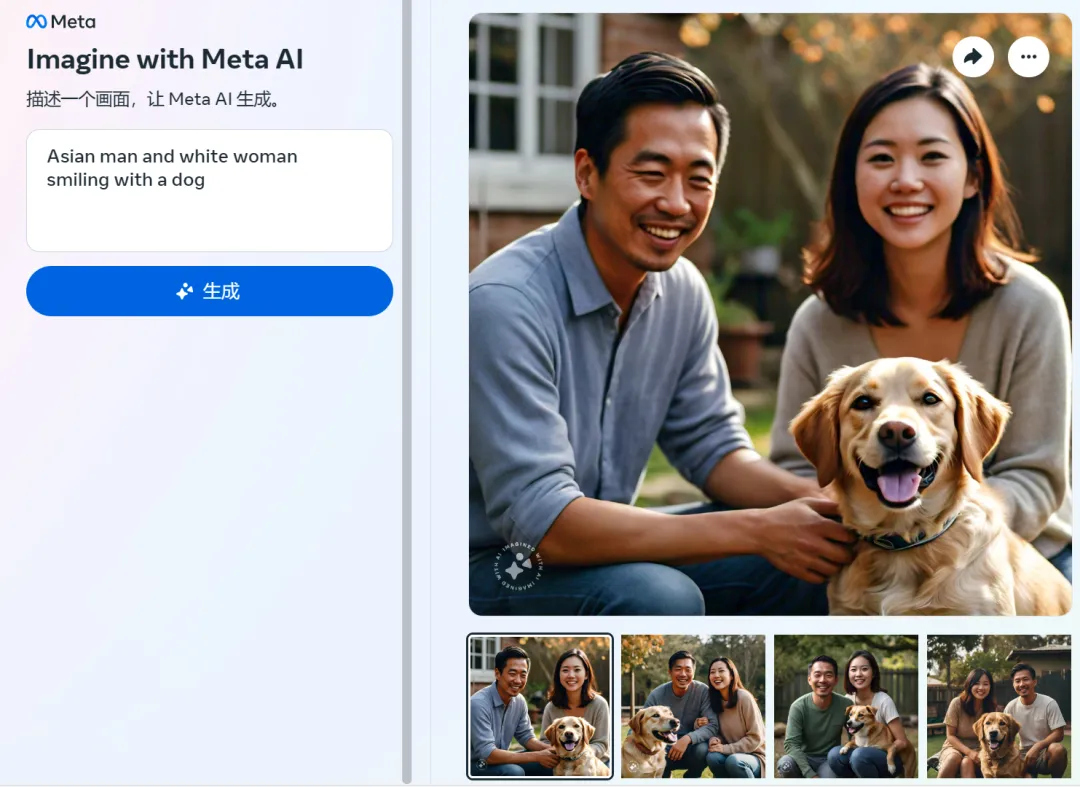

当输入「Asian man and white woman smiling with a dog」(亚洲男性和白人女性带着狗微笑)时,Meta 图像生成器给出的都是「两个亚洲人」的图像。即使将「white」改为「Caucasian」时,结果同样如此。

机器之心自测图像。

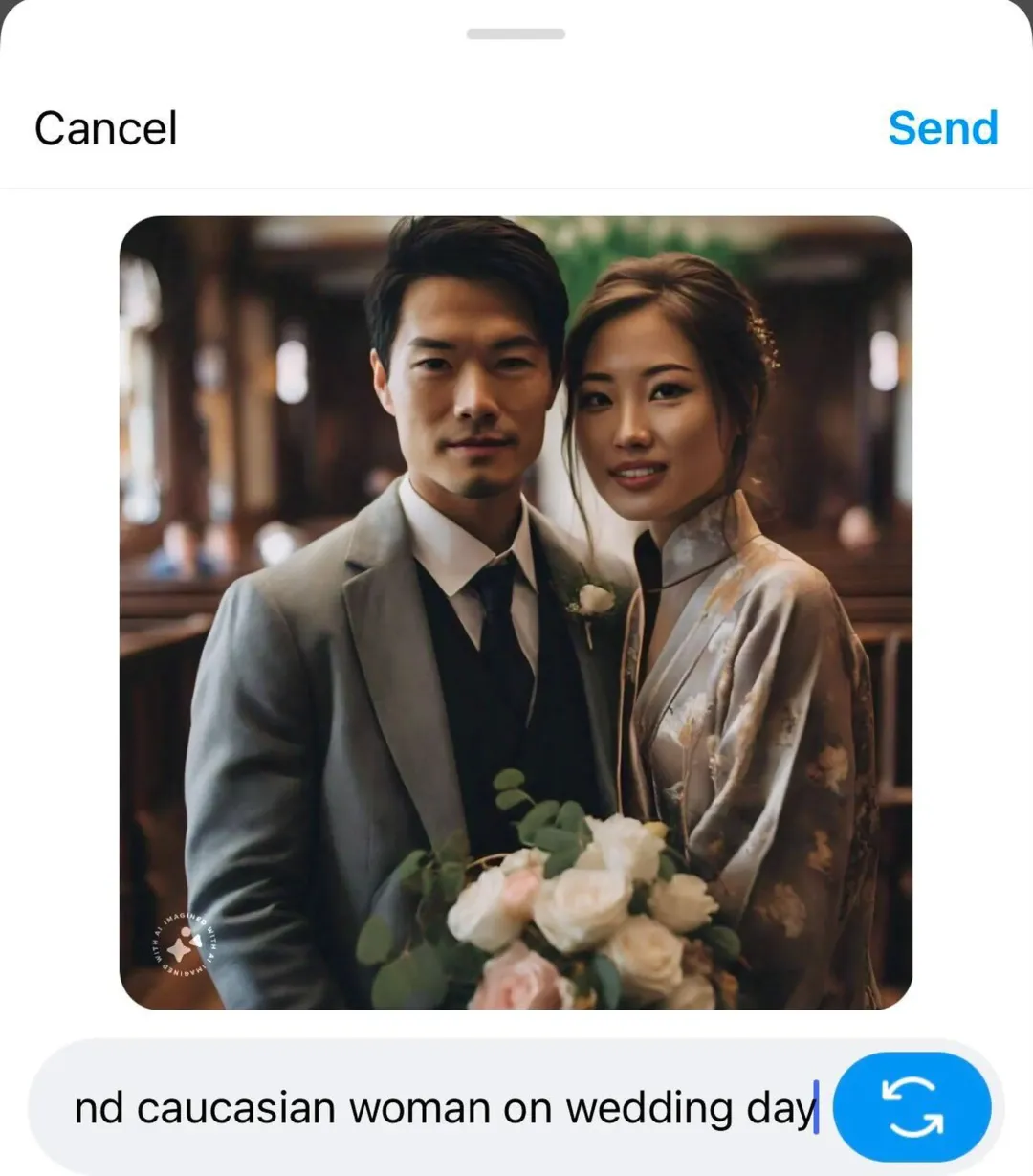

当输入「Asian man and Caucasian woman on wedding day」(婚礼上的亚洲男性和白人女性)时,生成的依然是两个亚洲人。

婚礼上的亚洲男人和白人女人。图源:Mia Sato/The Verge

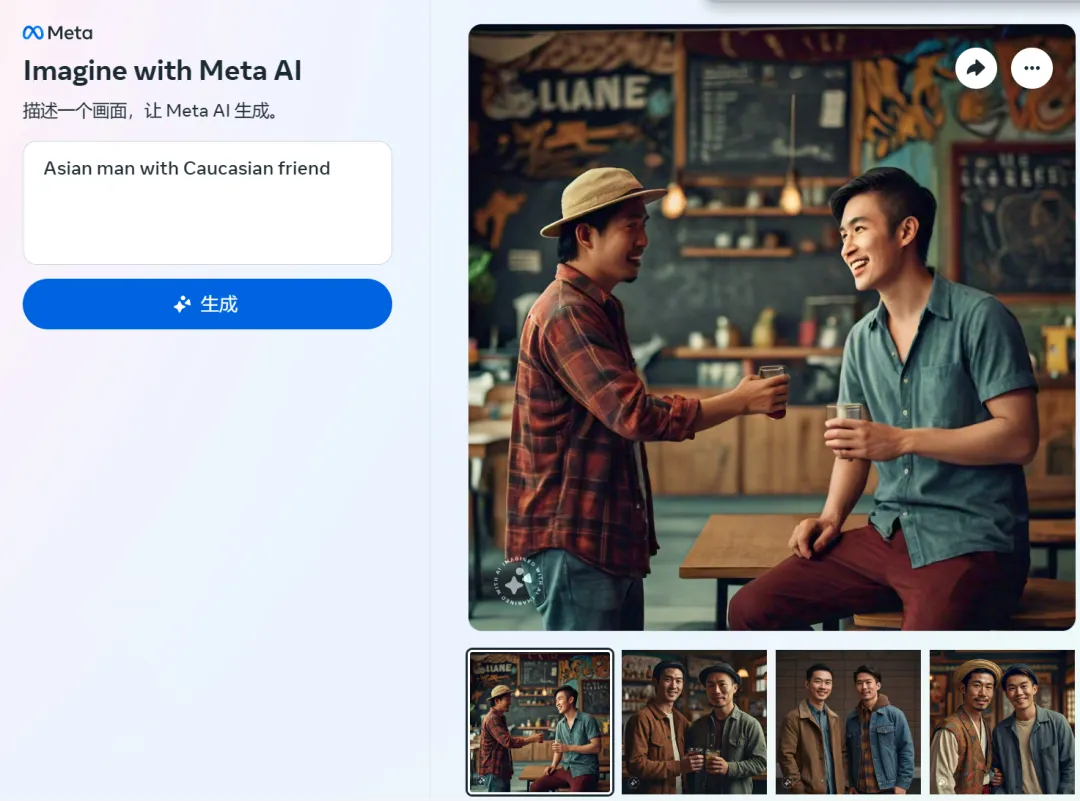

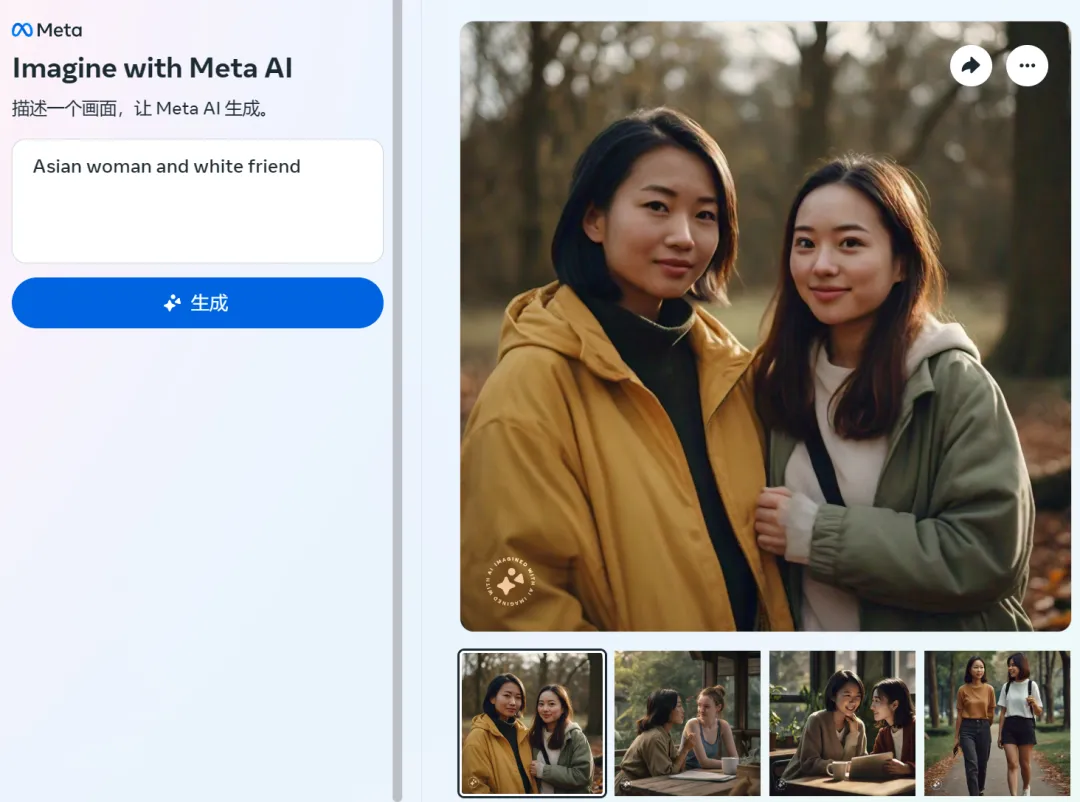

当输入「Asian man with Caucasian friend」(亚洲男性和白人朋友)或「Asian woman and white friend」(亚洲女性和白人朋友)时, 生成的大多数图像仍是两个亚洲人形象。

自测图像。

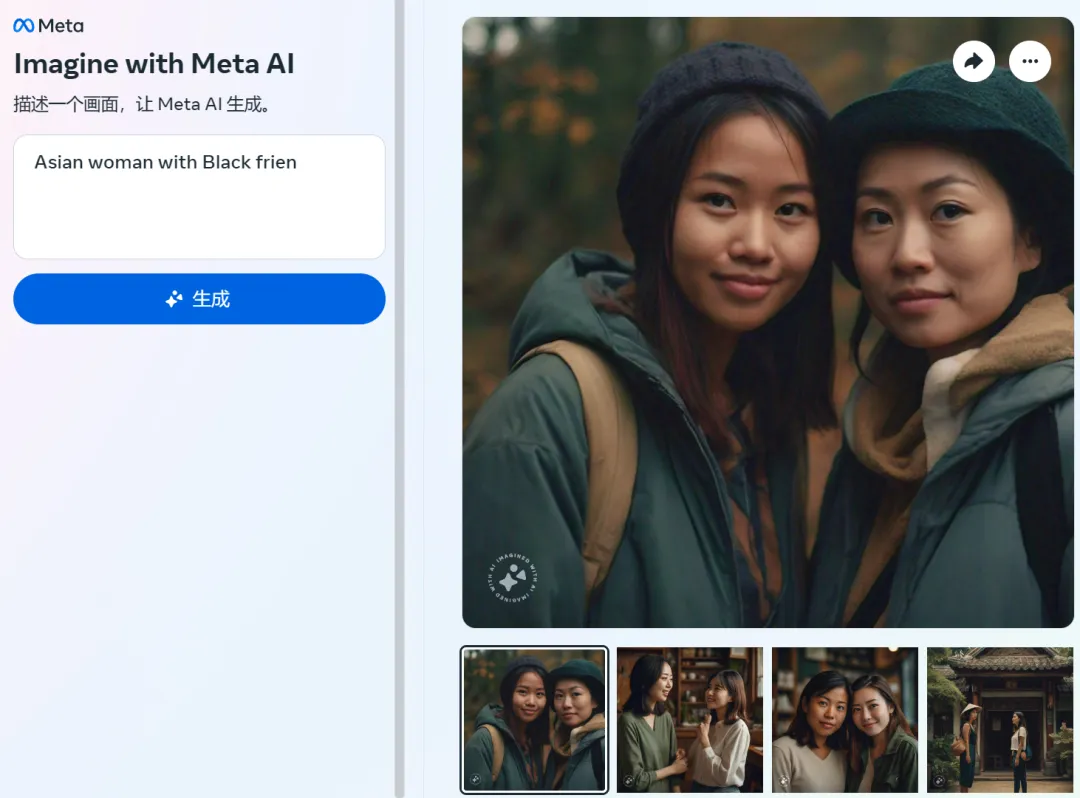

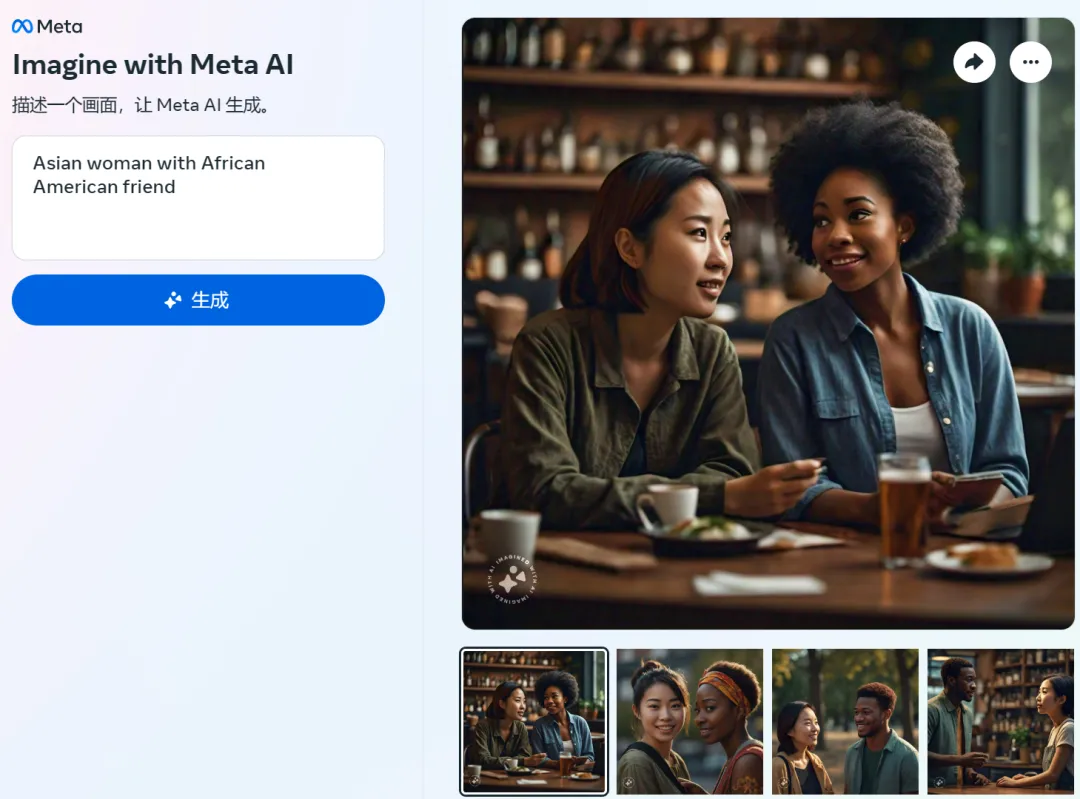

当输入「Asian woman with Black friend」(亚洲女性和黑人朋友)时,Meta 图像生成器仍是两名亚洲女性。但当将 prompt 调整为「Asian woman with African American friend」(亚洲女性和非裔美国朋友),结果反而准确得多。

自测图像。

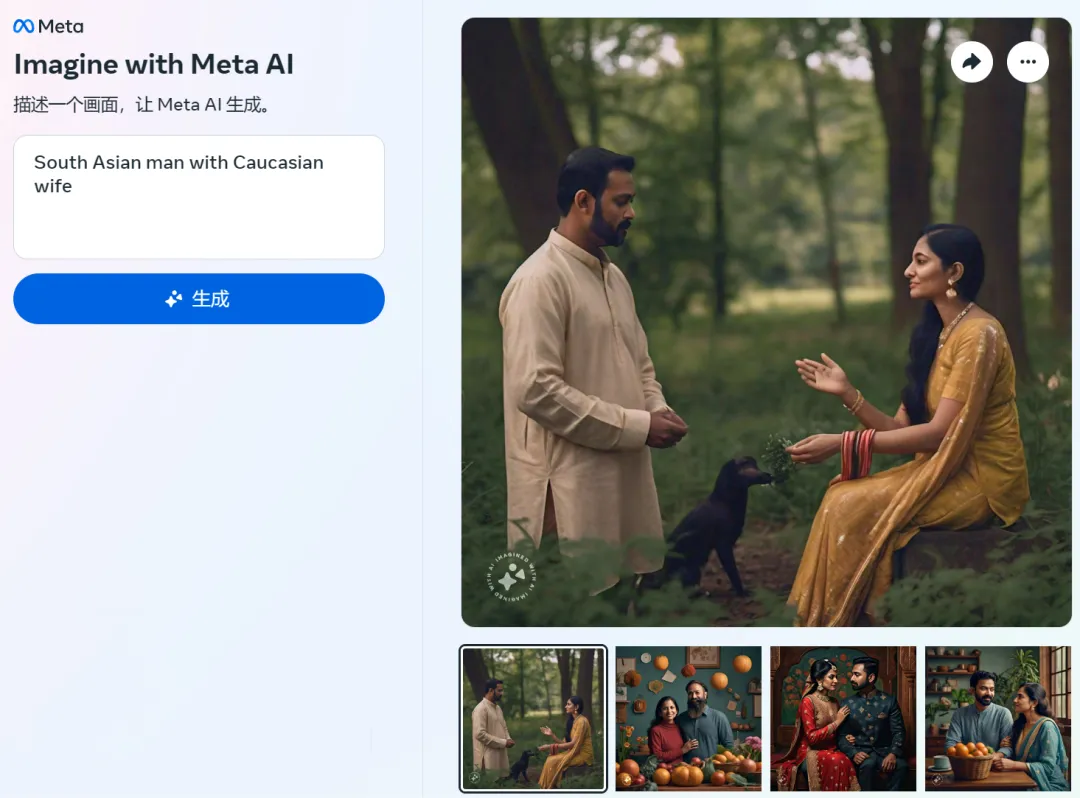

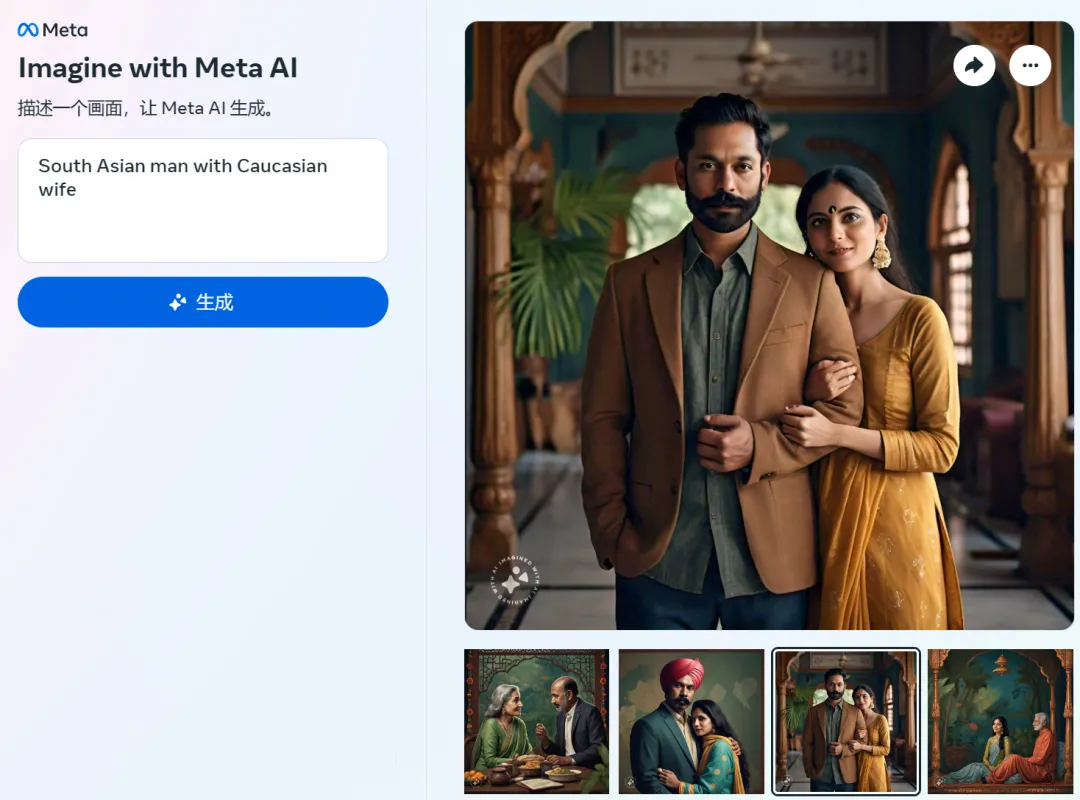

此外,当指定南亚人时,Meta 图像生成器的结果变化也不太大。当输入「South Asian man with Caucasian wife」(南亚男性和白人妻子)时,大多数时候是两个印度人形象。该工具还有刻板印象,在没有要求的情况下,生成的南亚女性往往会穿戴纱丽。

自测图像。

一番测试发现,Meta 图像生成器无法想象亚洲人与白人「同框」,这样的结果令人震惊。其中,该工具始终将亚洲女性或男性描绘为肤色浅的东亚人,尽管印度已经成为世界上人口最多的国家。在没有明确提示的情况下,该工具还会添加特定文化服饰。

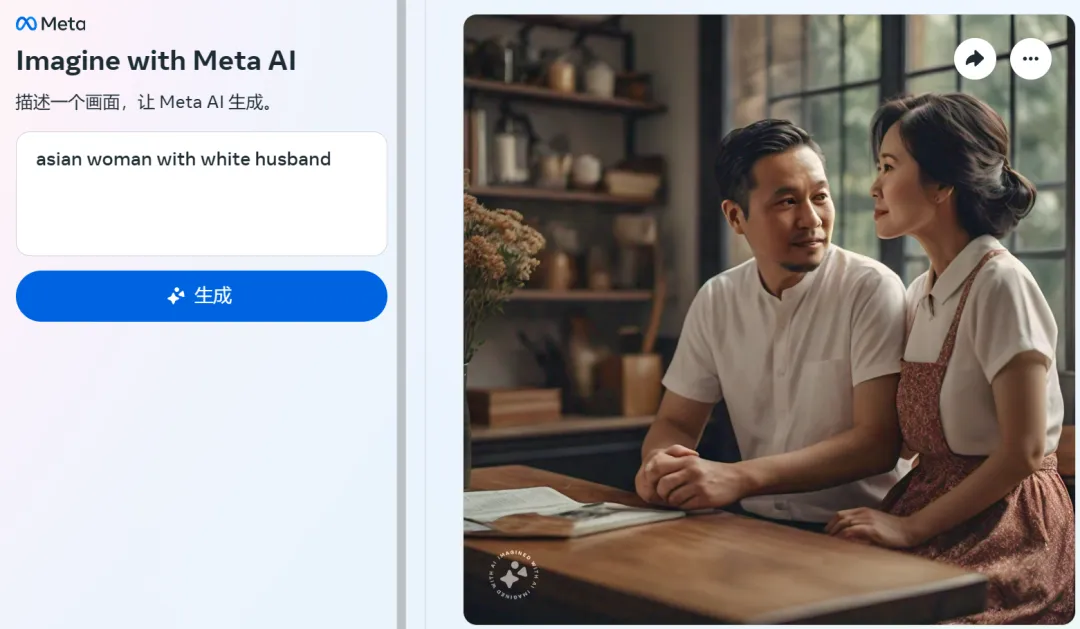

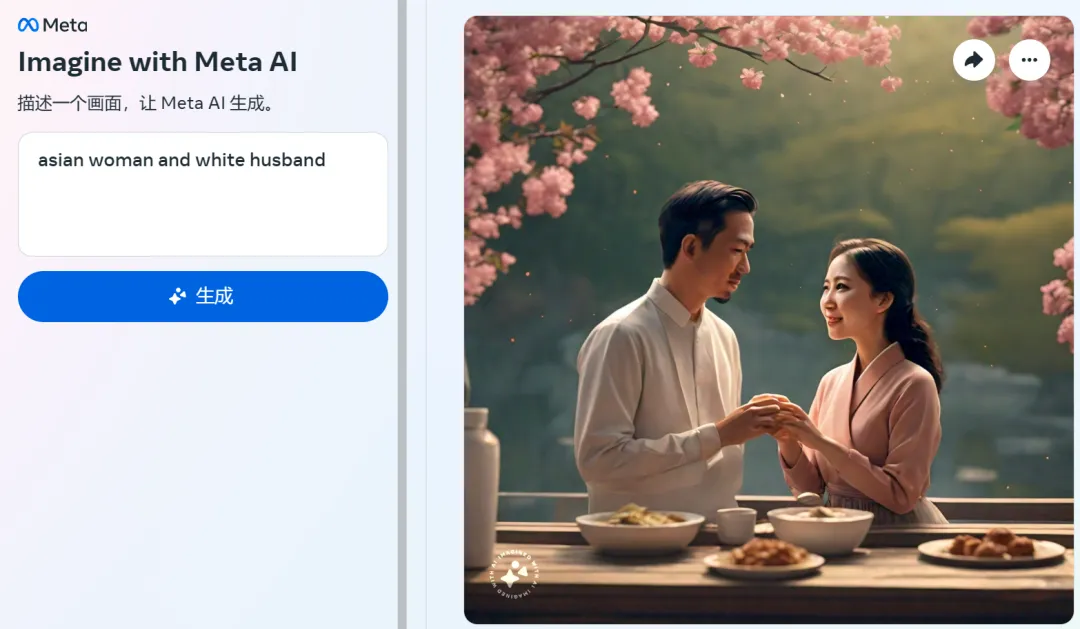

最后,机器之心使用类似的 prompt 验证了 The Verge 的结果,对于 prompt「亚洲女性和白人丈夫」,生成的 10 张图像中,只有 3 张图像准确还原。

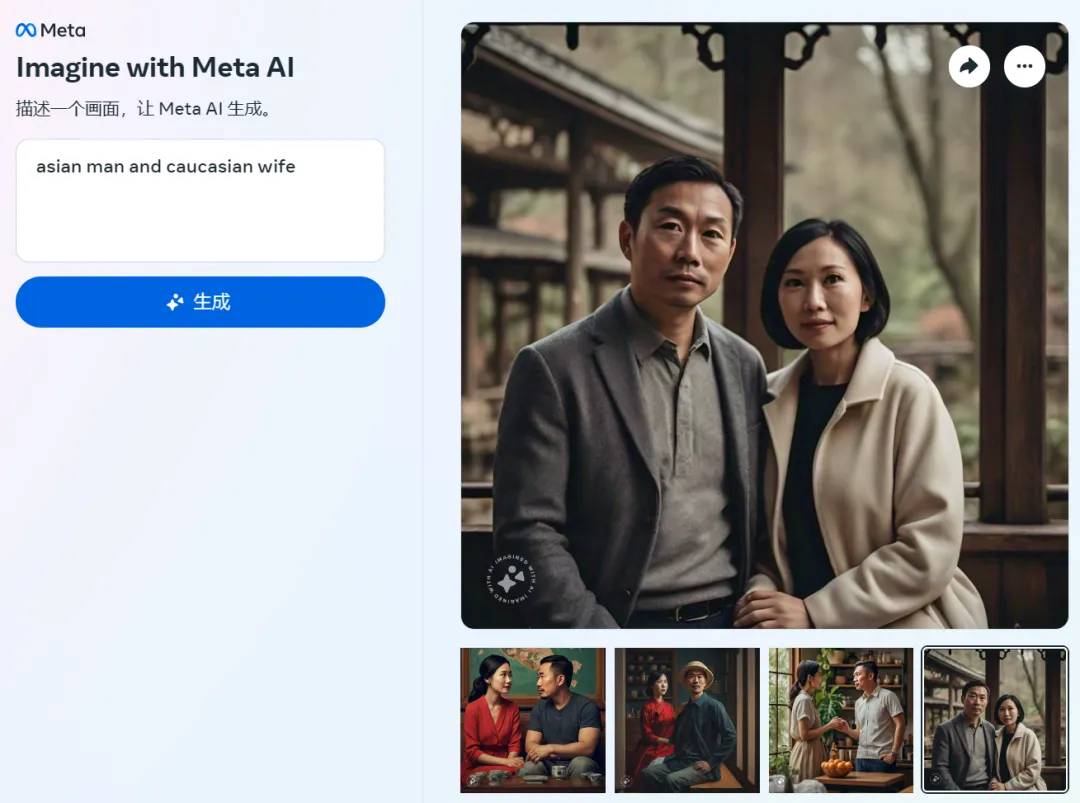

输入 prompt「asian man and caucasian wife」(亚洲男性和白人妻子),结果更离谱,生成的 8 张图像没有一张还原。

其实,这并不是 Meta 的图像生成工具第一次被曝出问题了。去年 10 月,Meta 的 AI 生成贴纸工具创建了大量不恰当的图片,比如童兵、持枪和拿刀的米老鼠等暴力、粗鲁、裸露形象。

图源:arstechnica and meta

此次,Meta 图像生成器再次让我们警醒 AI 系统创建者、训练者以及所用数据集可能存在的偏见和刻板印象。

对于 The Verge 发现的这一现象,有网友分析称,这是 Meta 在训练的时候没有喂给模型关于这一场景足够的示例。

你觉得呢?

本文转自 机器之心 ,作者:机器之心