噩耗!SD3、FLUX.1等开源文生图模型,可能将无法使用

比美国SB-1047更疯狂的法案来了——AB-3211。

AB-3211是美国加州在今年2月16日制定的一项专门针对文生图模型的法案,经过6次修订最近以62:0投票在州参议院通过。如果在立法会议结束前再次获得通过,9月30日之前将提交给州长Gavin Newsom签署最终执行令。

OpenAI、微软、Adobe等科技巨头和多数州议员都支持该法案,通过只是时间问题。但AB-3211会对SD3、FLUX.1等知名开源文生图模型在应用、技术迭代方面造成巨大影响。

例如,文生图模型没有嵌入非常详细、不可见且难以移除的元数据,这些元数据可以识别图像是否由AI生成,并提供有关图像生成方式、时间、生成服务的附加信息和水印。那么模型将是违法的,无法在HuggingFace、Github上进行分享。

这对于很多小公司、学术机构和个人开发者来说,无论是在资金还是技术层面都很难承担的起,会彻底扼杀开源技术方面的创新。

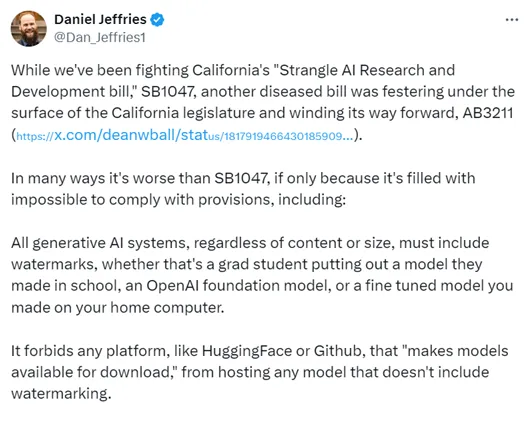

曾经反对过SB-1047法案的知名架构师Daniel Jeffries认为,AB-3211比SB-1047更疯狂,这是一个病态法案。

AB-3211法案的很多要求都不合理,在技术层面上是一个很大的难题。加州正在梳理一个糟糕的监管榜样。

AB-3211法案的通过,将是一场灾难。

根据美国官方公布的最新AB-3211修订内容显示,「AIGC开放社区」为大家解读一下有哪些条款对开源不利。

法律责任:如果开源的文生图模型被用于生成误导性或有害的内容,开发者需要承担法律责任。

例如,如果有人使用 SD3 模型生成了虚假的新闻图片并广泛传播,导致了不良影响,那么原开发者也会因为未能确保模型的合理使用,面临法律诉讼和最少2.5万美元,最高10万美元罚款。就这一条将会劝退很多开发者开源其产品。

来源数据和水印要求:“来源数据”是指嵌入到数字内容中的信息,该信息可以用来验证内容的来源、创作者以及生成或修改内容的工具。这种数据类似于传统的版权的元数据,但不可篡改且持续存在,以便于追踪和验证内容的真实性和完整性。

例如,SD3、FLUX.1 等开源文生图模型需要确保生成的图像能够,嵌入符合要求的来源数据,并且能够通过对抗性测试来验证模型的安全性和可靠性。对于开发者来说,需要投入更多的技术资源来实现这些要求,极大增加开发成本和安全管理难度。

提供来源检测工具和进行对抗性测试:法案要求模型平台提供来源检测工具,并进行广泛的对抗性测试,以防止模型被用于添加虚假来源数据。

开源模型需要开发和公开用于检测其模型生成的内容的工具,并公布详细的评估流程,保证生成内容的安全性和可靠性。无形之中又增加了开发和维护的难度。

透明度报告:模型平台每一年都要提交安全透明度报告,识别其平台上欺骗性合成内容的审核情况。例如,是否生成了色情、虐待、歧视等非法内容,进一步增加了开源模型的维护负担。

不合理的条例还有很多,但从上述不难看出这些条款都是增加了开发技术难度。对于那些有大把资金和技术团队的大型闭源模型来说,修改到符合标准只是时间问题。也是为什么该法案会获得了OpenAI、微软等巨头的支持,意在打压那些开源模型。

但对于那些没有资金、资源的开源开发者来说,已经无法像以前一样把项目直接扔在Github上就行了,需要一直改到符合技术标准为止,不然就无法分享你的项目。

本文转自 AIGC开放社区 ,作者:AIGC开放社区