回复

大模型微调终极指南

大家好,我是刘聪NLP。

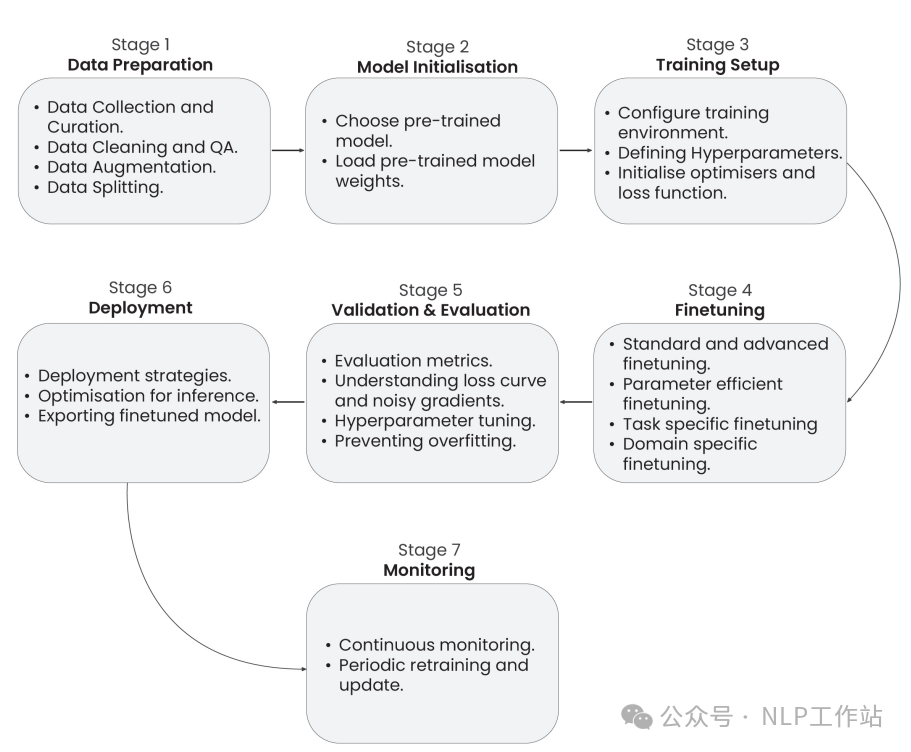

今天给大家带来一篇大模型微调相关的最新综述,主要大模型微调归纳为7个阶段分别为数据准备、模型初始化、训练环境配置、模型微调、模型评估与验证、模型部署以及模型监控与维护。

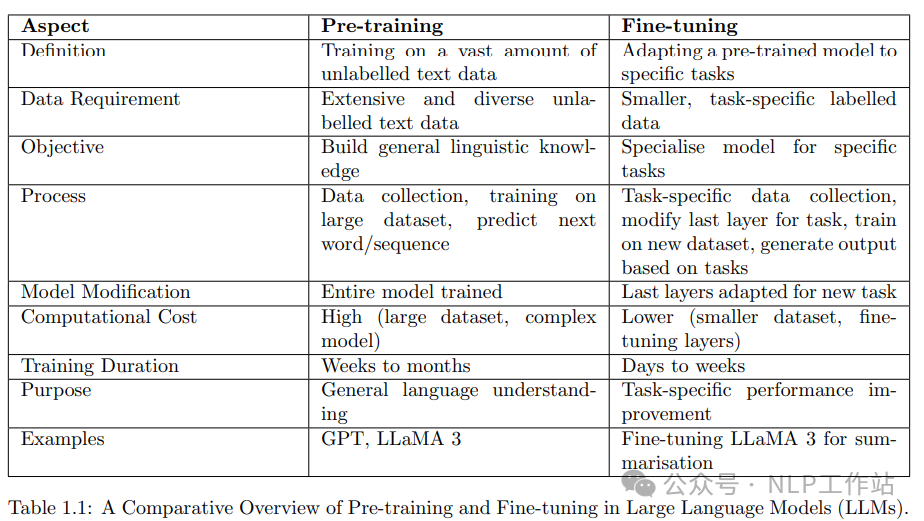

模型微调(Fine-Tuning)就是以预训练模型为基础,通过相对较少的特定数据集进行的进一步训练,主要是在模型预先存在的知识之上用过减少数据和计算成本来提高特定任务的效果。

模型预训练与微调之间差距

大模型微调的优势:

- 迁移学习:利用预训练过程中获得的知识,通过减少计算时间和资源,将其适应于特定任务

- 减少数据需求:需要较少的标注数据,专注于将预训练的特征调整到目标任务

- 改善泛化能力:增强了模型对特定任务或领域的泛化能力,捕捉通用语言特征并对其进行定制

- 高效的模型部署:微调后的模型更适合实际应用,计算效率高,适合特定任务

- 适应各种任务:能够适应广泛的任务,在各种应用中表现良好

- 特定领域的性能:允许模型通过调整目标领域的细微差别和词汇,从而在特定领域的任务中表现出色

- 更快收敛:从通用语言特征的权重开始训练,能够更快地收敛

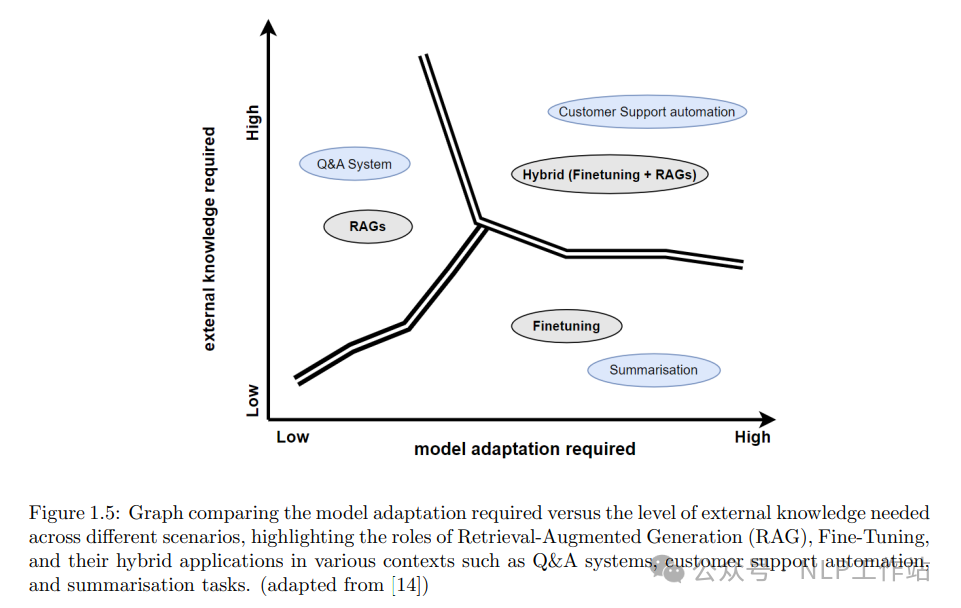

虽然,很多任务通过提示工程或RAG技术可能完美解决,但如果你需要模型调整其行为、写作风格或融入特定领域的知识,那么微调仍然是必不可少的。

下面从7个不同阶段来详细介绍大模型微调所要准备的工作。

数据准备

- 高质量数据收集:确保数据的高质量、多样化和代表性,确保数据在不同场景下的全面覆盖,以增强模型的鲁棒性;

- 有效的数据预处理:去除噪声、错误和不一致性的数据对于模型至关重要;

- 数据不平衡处理:过采样、欠采样和SMOTE等技术有助于平衡数据集;

- 数据增强和合成:采用数据增强手段对数据集扩充但需要确保数据标注的一致性;同时利用提示工程或多步生成的方式合成数据;

- 道德数据处理:审查数据中有害或有偏见的内容,以防止模型输出有害结果;

- 定期评估和迭代:持续评估和迭代数据准备流程,利用反馈循环和性能指标确保持续改进并适应新的数据需求。

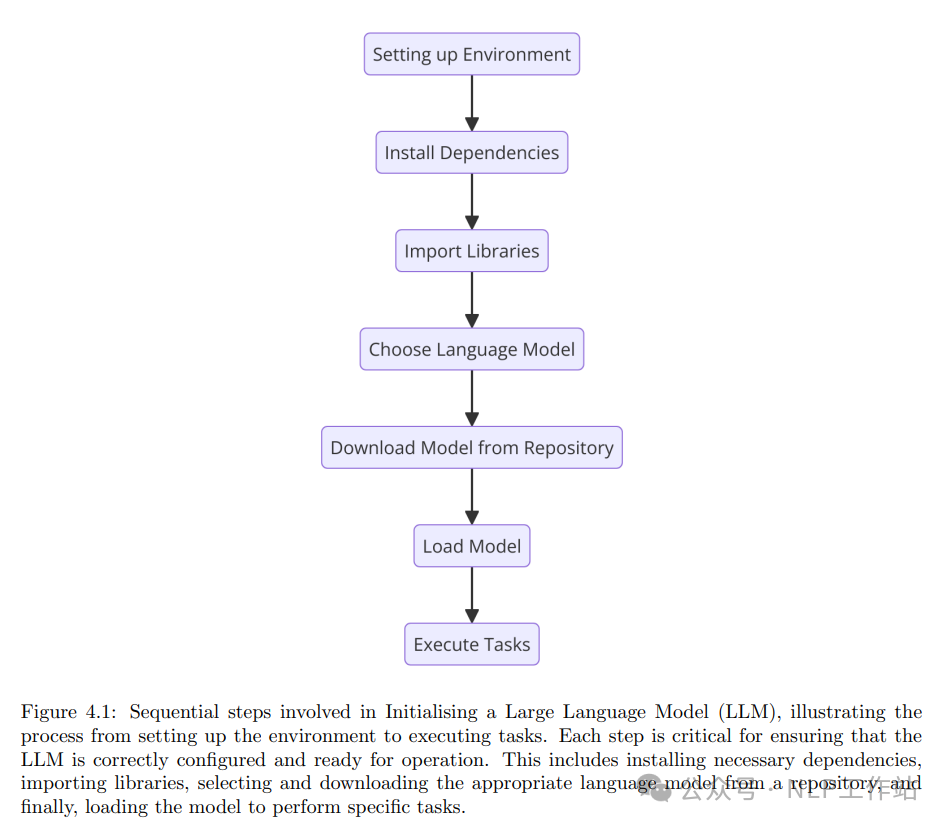

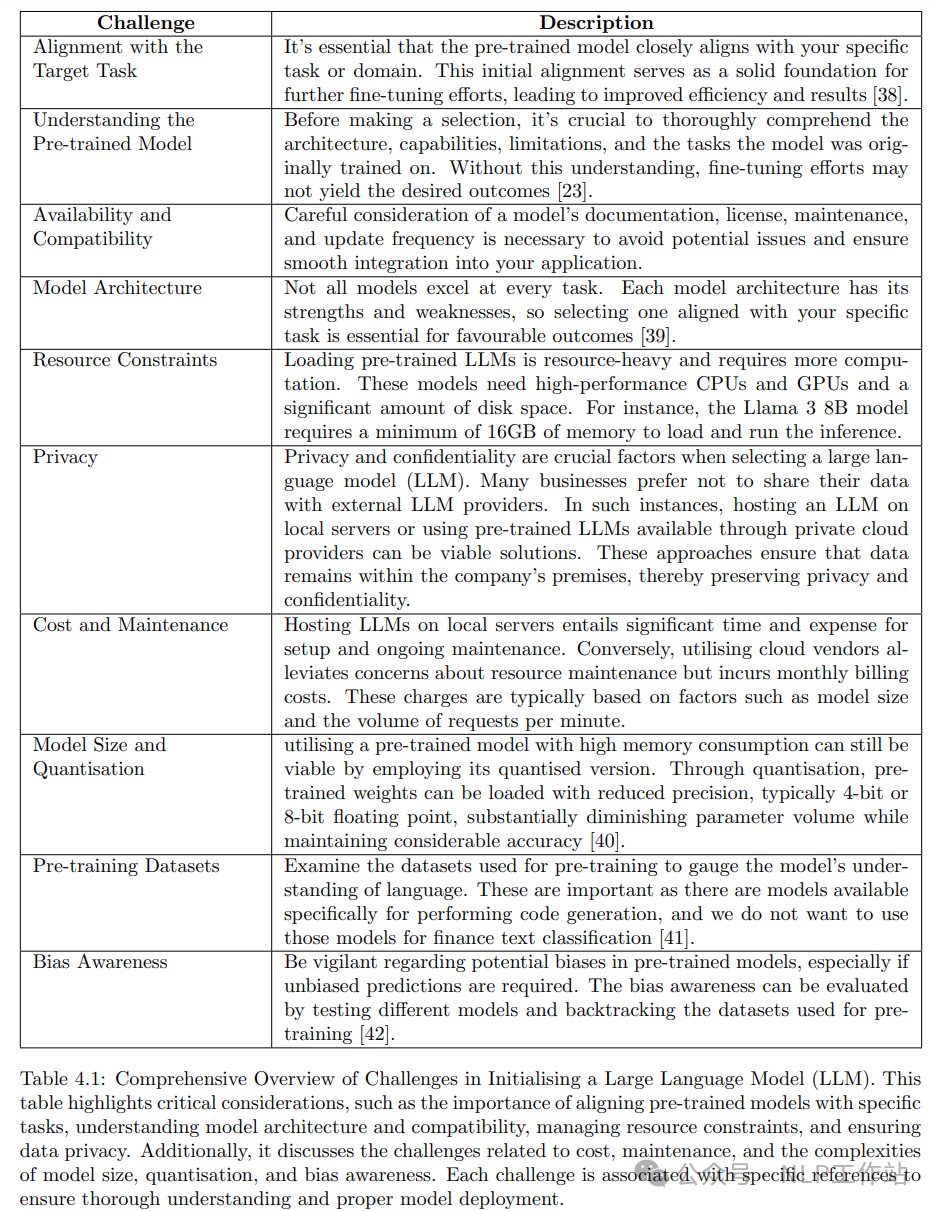

模型初始化

在该阶段主要配置环境、安装依赖项、选择合适的大模型、下载对应的模型、预先在特定任务执行模型。

在模型选择时,需要考虑选择的模型与目标任务的一致性如何、模型的可用性和兼容性、模型的架构、资源的限制等等。

训练设置

主要是在模型训练过程中设置优化器、损失函数、参数调节。

- 学习率调节:一般使用较低的学习率,采用学习率预热也会有益;

- Batch大小:一般更大的Batch可以获得更好的效果,但需要选择一个平衡显存限制和训练效率的Batch大小;

- 定期保存检查点:不同间隔定期保存模型权重,实施及早停止测略,防止模型过拟合;

- 数据并行和模型并行:考虑使用数据并行或模型并行技术,将训练工作负载分布在多个GPU或TPU上;

- 定期监控和记录:踪训练指标、资源使用和潜在瓶颈,可以用TensorBoard、Weights & Biases、MLflow等工具;

- 混合精度训练:以减少内存使用并提高计算效率,可以显著加快训练速度并减少所需的内存占用;

- 评估和迭代:使用单独的验证集不断评估模型性能,并根据结果对训练过程进行迭代;

- 模型可重复:通过设置随机种子并提供训练过程的详细记录来确保可重复性,有助于调试和进一步开发。

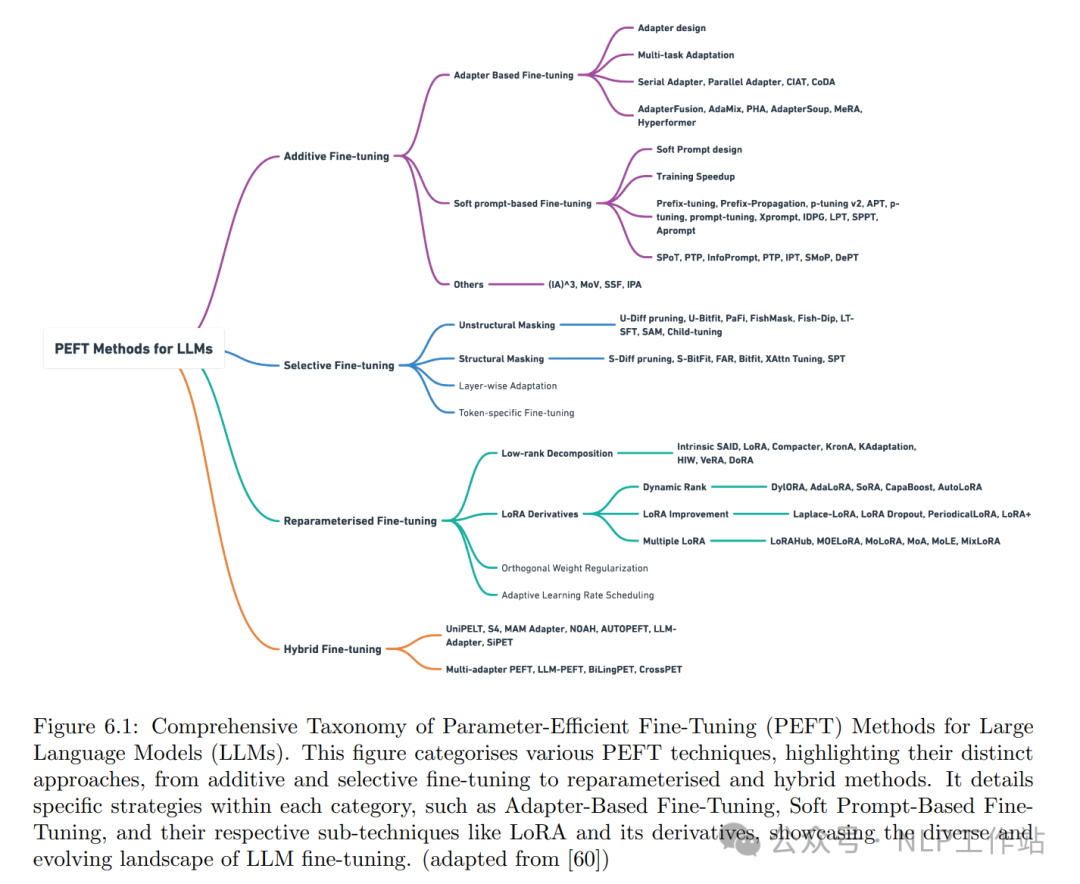

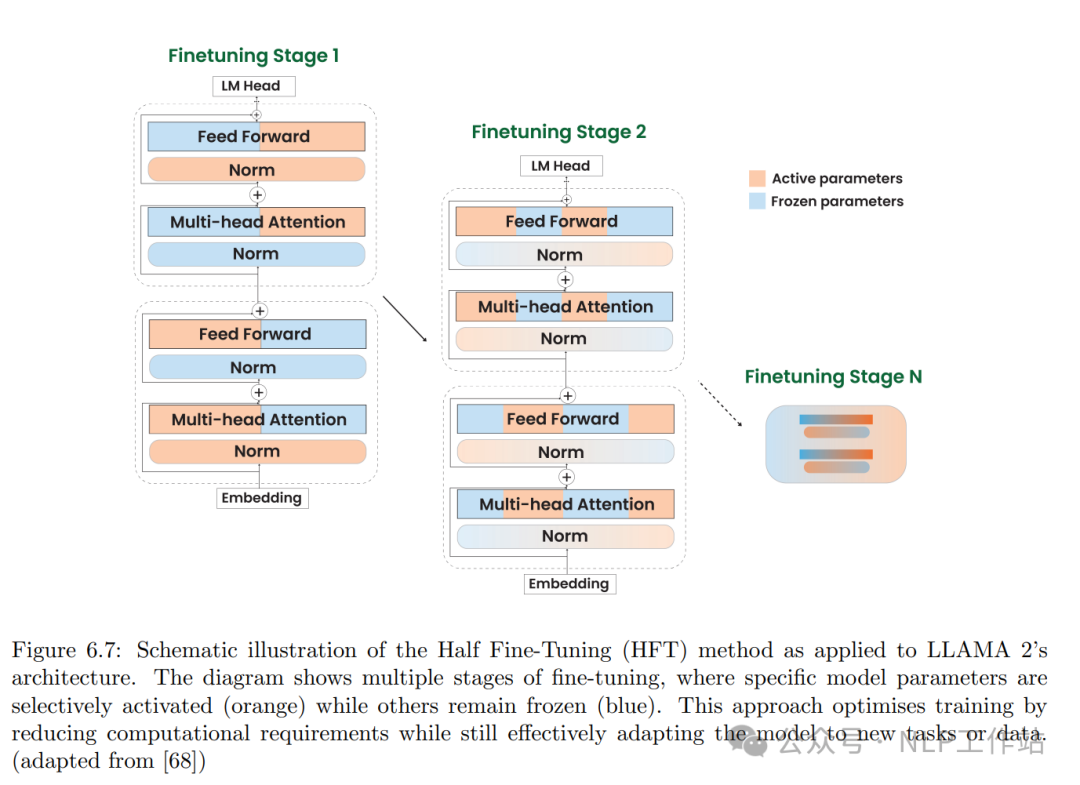

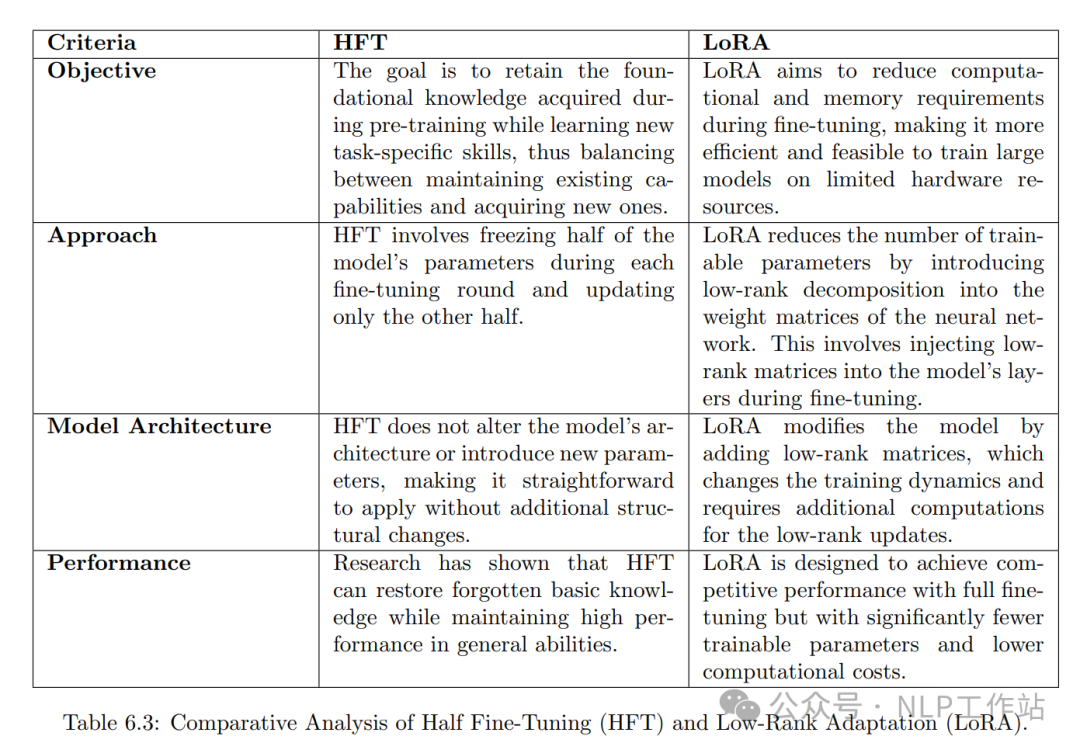

微调技术

主要有特定任务的微调、特定领域的微调、参数高效微调、半微调、偏好对齐、MoE、MOA等。

参数高效微调

评估和验证

有效评估LLMs需要根据模型性能的各个方面指定一些特殊的评价指标:

- 困惑度:衡量概率分布或模型预测样本的程度

- 事实性:评估LLM所提供信息的准确性

- LLM不确定性:利用每个生成令牌的对数概率,衡量模型输出文本的置信度

- 提示困惑度:评估模型对输入提示的理解程度

- 上下文相关性:衡量检索到的上下文与用户查询的相关性

- 完整性:评估模型的响应是否根据提供的上下文完全回答了查询

- Chuk归属和利用:评估检索到的信息块对最终响应的贡献效果如何

- 数据错误潜力:量化了模型在学习训练数据时面临的困难,数据质量越高,错误潜力越低

- 安全指标:确保LLM的输出适当且无害

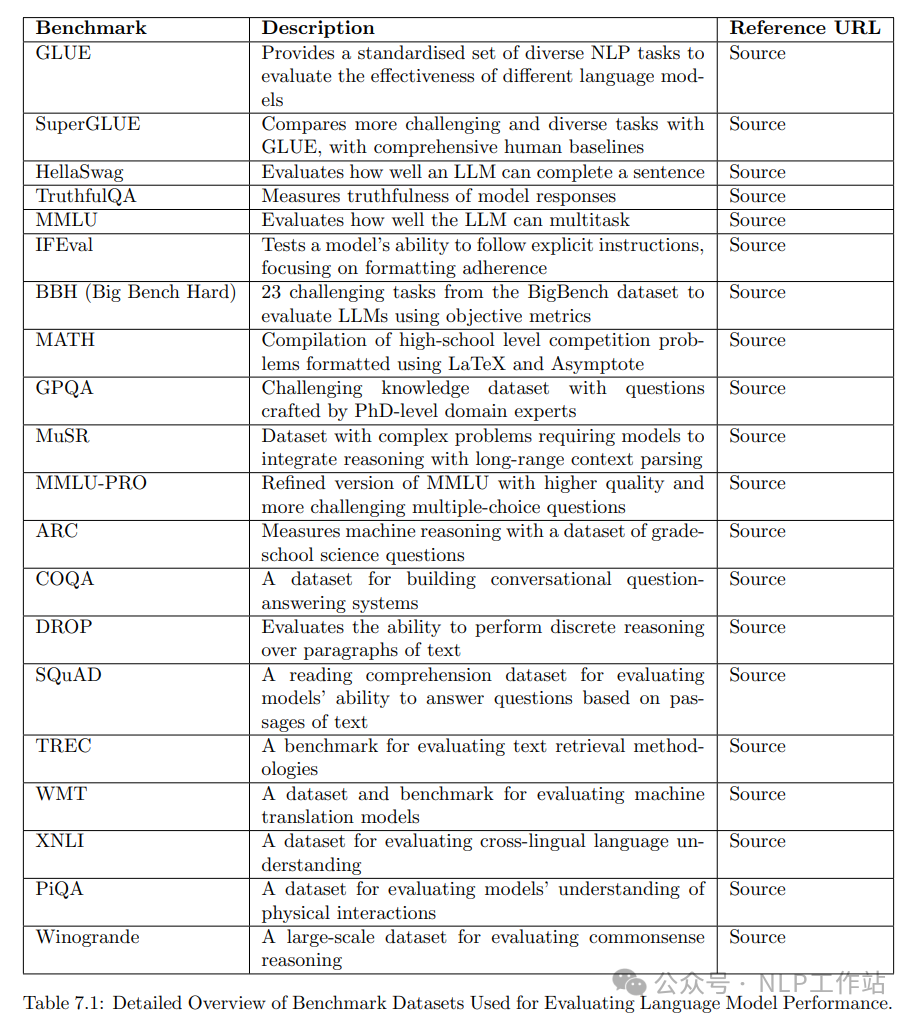

评测榜单

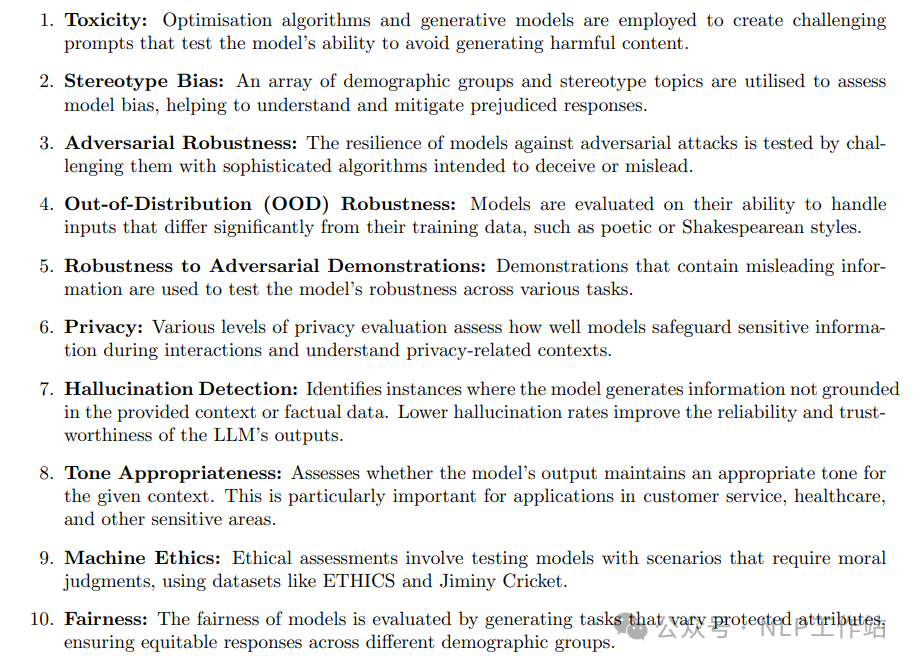

安全性评测指标

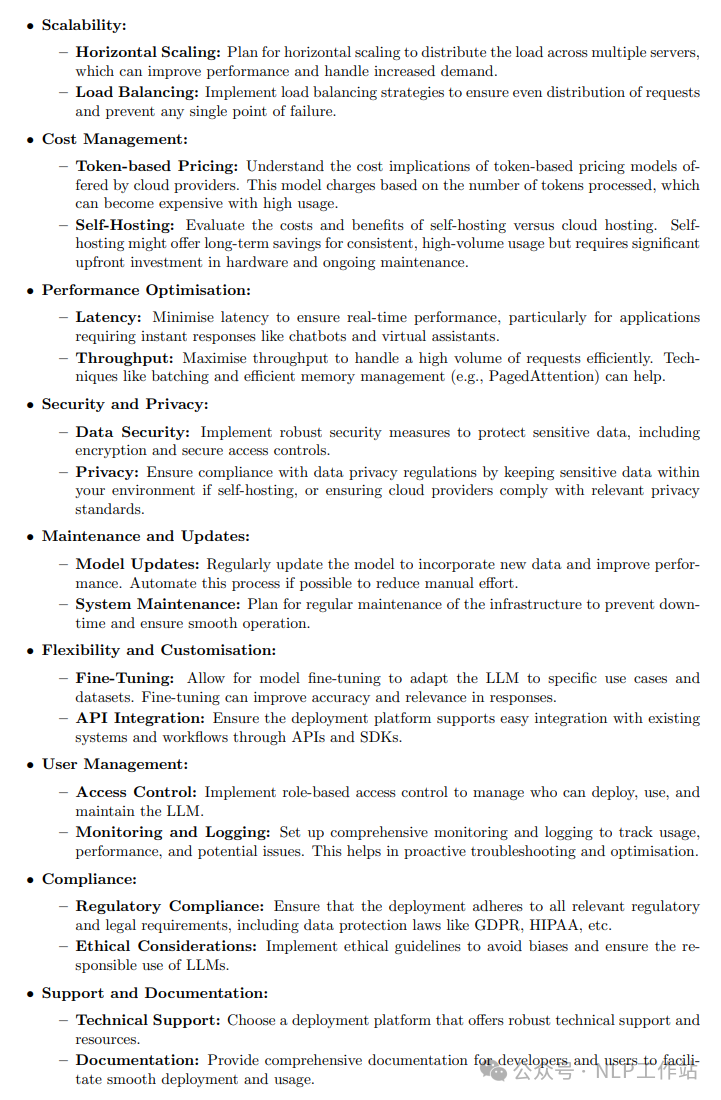

模型部署

本地部署、云平台部署、分布式部署、模型量化等。

模型监控

性能监控、准确性监控、错误监控、日志分析、警报机制、反馈循环、安全监控、模型版本控制、提示词监控、输出结果监控、LLM知识更新等。

本文转载自NLP工作站,作者:刘聪NLP

赞

收藏

回复

相关推荐