回复

视频生成类大模型实现原理以及应用和难点 原创

“ 视频生成属于计算机视觉领域,还包括图像处理等”

生成式大模型在文本,图像,视频等方面表现良好,而我们都知道文本生成大模型是基于自然语言处理技术,而视频生成的大模型又是怎么实现的呢?

今天我们就来学习一下视频生成类大模型的实现原理和应用以及面临的挑战和难点。

视频生成类大模型的原理和应用以及困难点

视频生成大模型是指利用先进的机器学习技术生成视频内容的模型。这一领域结合了深度学习、计算机视觉和自然语言处理等技术,涉及到从图像生成、视频预测到文本转视频等多个方面。以下是视频生成大模型的实现原理、技术细节和应用场景的详细介绍。

1. 基本原理

1.1 模型架构

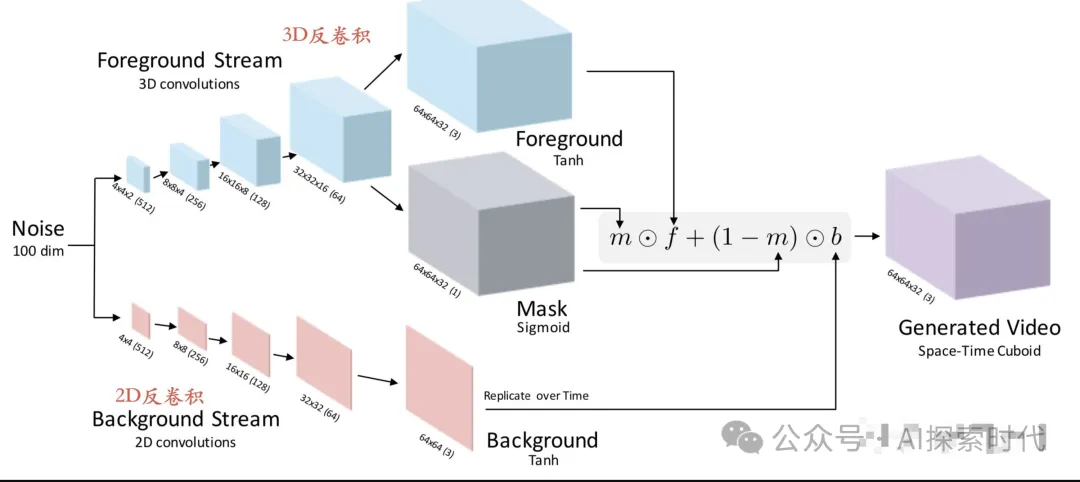

- 生成对抗网络(GANs):生成对抗网络由生成器和判别器组成,通过对抗训练生成视频。生成器尝试生成逼真的视频,而判别器则试图区分真实视频和生成视频。

- 变分自编码器(VAEs):VAEs通过编码器将输入视频编码为潜在空间的分布,然后通过解码器从潜在空间生成视频。这种方法可以学习到视频的潜在表示,用于生成新的视频。

- 扩散模型:这些模型逐步将噪声转化为清晰的视频,通过多步过程生成高质量的视频,通常在生成过程中使用深度学习来逐步去除噪声。

1.2 数据处理

- 数据预处理:视频生成模型需要大量视频数据进行训练。数据预处理包括视频剪切、帧提取、标准化等,确保数据一致性和质量。

- 数据增强:通过数据增强技术(如随机裁剪、旋转、颜色调整等)增加训练数据的多样性,提高模型的泛化能力。

2. 技术细节

2.1 特征提取

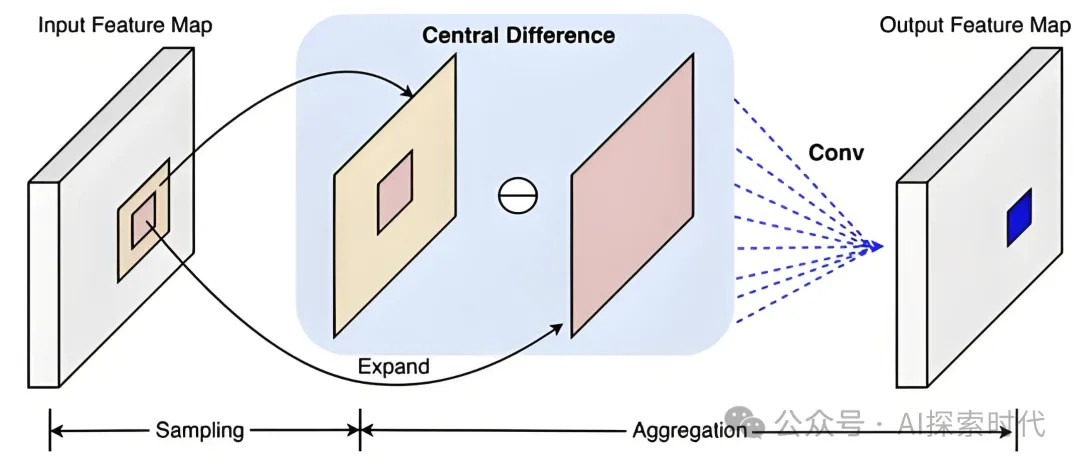

- 卷积神经网络(CNNs):用于从视频帧中提取特征,捕捉图像中的空间信息。

- 时序模型(如LSTMs、GRUs):用于捕捉视频中的时间信息,理解帧之间的动态变化。

2.2 视频生成

- 时空建模:将空间和时间信息结合起来,生成连贯的视频。常用的方法包括时序卷积、3D卷积等。

- 条件生成:在生成过程中加入条件信息,如文本描述或先前的帧,指导生成模型生成符合条件的视频内容。例如,从文本描述生成视频场景。

2.3 训练与优化

- 对抗训练:在使用GANs时,通过生成器和判别器的对抗训练,逐步提高生成视频的质量。

- 损失函数:设计适合视频生成的损失函数,如生成质量损失、内容一致性损失、时序一致性损失等。

- 优化算法:使用优化算法(如Adam优化器)来调整模型参数,提升生成视频的质量和稳定性。

3. 应用场景

3.1 内容创作

- 自动视频生成:从文本描述、图像或脚本生成视频内容,应用于影视制作、广告创作等。

- 虚拟现实与增强现实:创建逼真的虚拟环境和场景,提升用户的沉浸感和互动体验。

3.2 娱乐和媒体

- 视频编辑与特效:生成或修改视频中的特效和动画,应用于电影特效、游戏动画等领域。

- 个性化内容生成:根据用户的喜好和行为生成定制化的视频内容,提高用户的观看体验。

3.3 研究与教育

- 模拟与培训:在教育和培训中生成虚拟场景和模拟环境,帮助学习和实践。

- 医学影像分析:生成和分析医学视频数据,辅助医学研究和临床诊断。

4. 挑战与难点

4.1 数据要求

- 大规模数据需求:训练高质量的视频生成模型需要大量标注数据,这对于数据收集和处理提出了很高的要求。

- 数据多样性:数据集需要涵盖各种场景和条件,以提高模型的泛化能力和鲁棒性。

4.2 计算资源

- 计算成本:视频生成模型训练通常需要高性能的计算资源,如GPU或TPU,训练过程可能非常耗时和昂贵。

- 模型复杂性:复杂的模型架构需要大量的计算资源进行训练和推理。

4.3 生成质量

- 视频质量:生成的视频需要具有高分辨率和清晰度,同时保持连贯性和真实感,确保生成内容的质量。

- 时序一致性:确保生成视频的时间序列一致性,避免出现不连贯的运动和场景。

4.4 道德与法律

- 虚假信息:生成的视频可能被用于传播虚假信息或误导性内容,需要谨慎使用。

- 版权问题:使用和生成受版权保护的内容时需要遵守相关法律法规。

5. 未来发展

- 跨模态生成:结合文本、图像和视频生成技术,实现更复杂和高质量的生成任务。

- 自适应生成:发展自适应模型,根据用户输入和实时反馈调整生成内容,提高互动性和个性化。

- 高效训练:研究更高效的训练方法和优化算法,降低计算成本,提高生成效率。

视频生成大模型是一个高度复杂且前沿的领域,涉及到大量的技术和挑战。随着技术的不断进步,未来有望在多个领域带来更多创新和应用。

本文转载自公众号AI探索时代 作者:DFires

©著作权归作者所有,如需转载,请注明出处,否则将追究法律责任

赞

收藏

回复

相关推荐