ACM MM 2024 | 比SDXL和DALL-E·3更引人入胜!ReCorD:交互场景生成最新SOTA! 精华

文章链接:https://arxiv.org/pdf/2407.17911

git链接:https://alberthkyhky.github.io/ReCorD/

亮点直击:

- 引入了一种新颖的推理框架,将潜在扩散模型(LDM)与视觉语言模型(VLM)相结合,以克服生成逼真的人与物体互动(HOI)时面临的挑战,缓解了以往方法中的问题,例如大语言模型(LLM)对简单文本提示的过度分析以及LDM中的训练数据偏差。

- 为了提升人物形象描绘的准确性,在LDM中设计了一个校正机制,用于动态图像调整,使得对生成图像中人类互动的精确控制和精细化成为可能,从而显著提高了描绘的准确性。

- 大量实验表明,本文的免训练方法ReCorD在创建引人入胜且逼真的HOI场景方面表现出色,优于其它SOTA方法。

扩散模型通过利用自然语言引导多媒体内容的创作,彻底改变了图像生成技术。尽管在这些生成模型上取得了显著进展,但在描绘人类与物体的详细互动方面仍存在挑战,特别是在姿势和物体放置准确性方面。

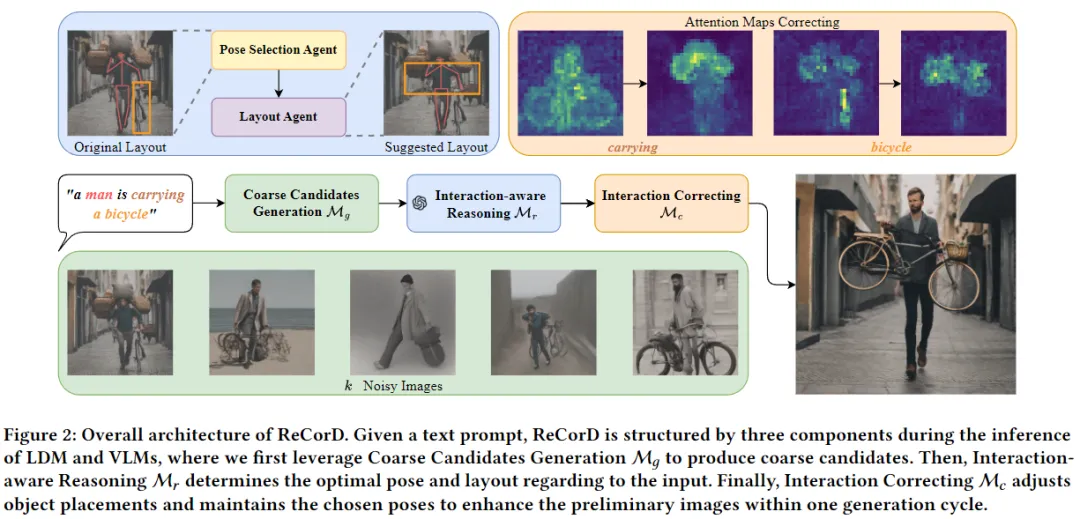

本文引入了一种名为推理和校正扩散(ReCorD)的免训练方法来解决这些挑战。该模型结合了潜在扩散模型和视觉语言模型,以优化生成过程,确保精确描绘人与物体的互动(HOI)。提出了一个互动感知推理模块来改进互动的解释,并引入一个互动校正模块,以精细化输出图像,达到更精确的HOI生成效果。通过精心的姿势选择和物体定位过程,ReCorD在生成图像的保真度方面表现出色,同时有效减少了计算需求。在三个基准上进行了全面的实验,展示了在解决文本到图像生成任务上的显著进展,ReCorD通过在HOI分类评分、FID和动词CLIP评分上的优越表现,展示了其精确渲染复杂互动的能力,优于现有方法。

方法

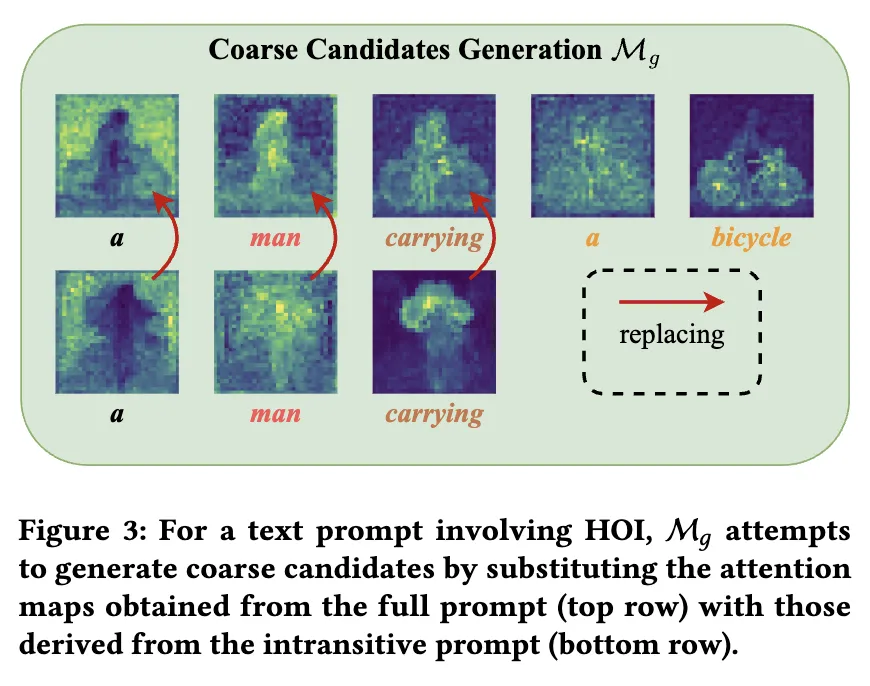

粗略候选生成模块

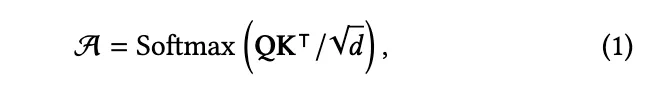

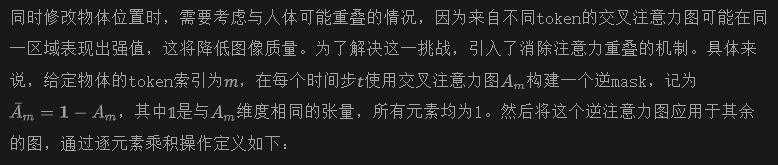

其中,𝑛表示文本标记的索引。理想情况下,如果文本tokens存在于不及物提示中,会接受这些注意力图。

自注意力图操控。与交叉注意力图不同,自注意力图缺乏直接的tokens关联,但仍然会影响生成图像的空间布局和外观。因此,在去噪步骤𝑡 >𝛾后,同样对潜在表示的自注意力图进行操控,以获得,其中𝛾是一个预定义参数,确保可以有效生成来自原始token 𝜓(𝑦)的场景和物体。

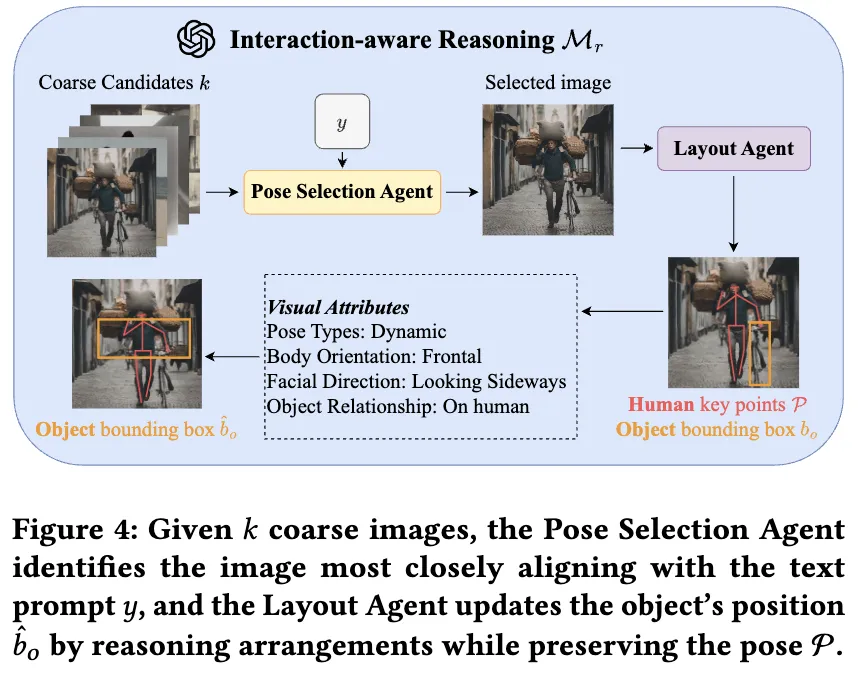

互动感知推理模块

姿势选择Agent。由于姿势在HOI生成中具有重要特征,首先结合一个agent来选择与提示条件一致的适当姿势。姿势选择agent将初始提示𝑦与先前生成的候选相结合,以创建姿势模板。利用VLM的视觉理解能力,该agent在识别与𝑦对应的精确姿势方面表现出色,增强了模型对视觉数据的解释能力,而不仅仅依赖于LLM中的文本认知。这一步骤确保了从LDMs初始获得的姿势信息在后续阶段得到精细化处理。

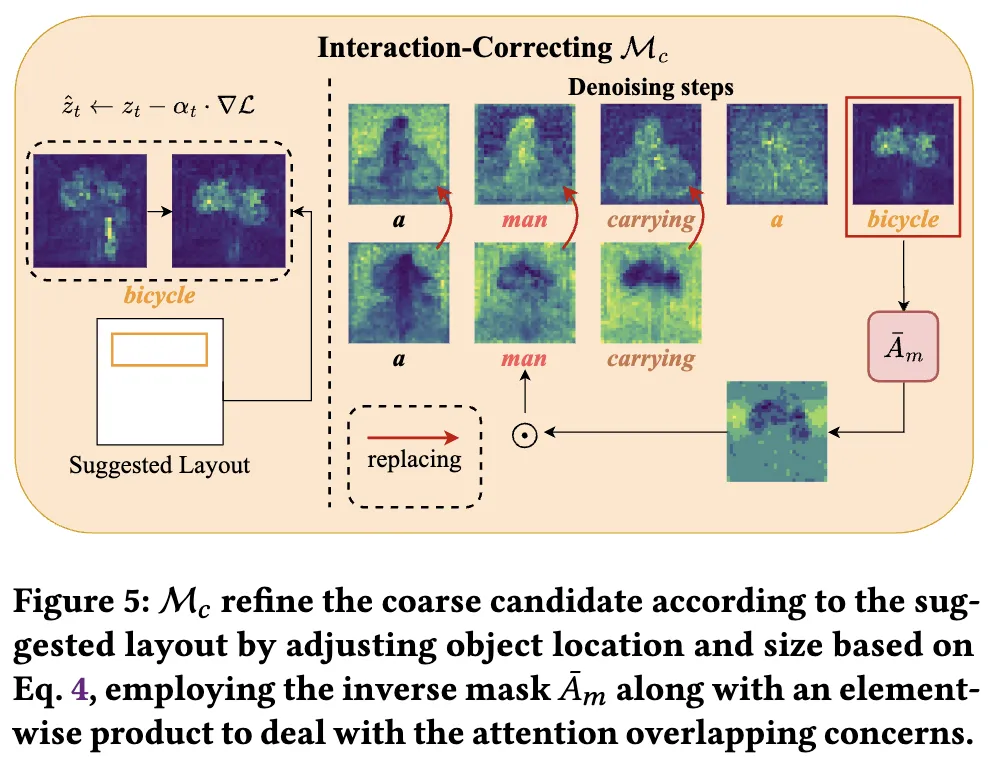

互动校正模块

通过公式(3),可以在更新物体位置时减轻人与物体之间的注意力重叠问题,确保成功生成更新后的物体。

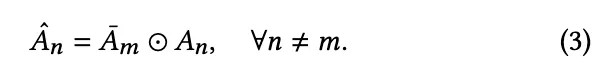

条件空间约束 由于ReCorD是免训练的,并且不涉及用于知识转移的额外可学习网络,采用框约束来规范去噪器,其公式如下:

实验

实验设置

数据集。鉴于缺乏专门为HOI生成设计的标准基准,通过从两个已建立的HOI检测数据集中提取HOI三元组来评估我们方法的有效性,即HICO-DET和VCOCO,以形成输入文本提示。HICO-DET包含600个三元组,涵盖80个物体类别和117个动词类别,而VCOCO包含228个三元组,跨越80个物体类别和29个动词类型。为了全面评估,结合了T2I-CompBench中的非空间关系类别,该类别包含875个互动术语。选择T2I-CompBench中仅涉及HOI的提示。为了增强多样性,对从数据集中提取的每个动词和物体对应用随机主体增强以形成输入提示。因此,实验在三个数据集上进行:HICO-DET,有7,650个HOI提示;VCOCO,提供2,550个提示;以及T2I-CompBench的非空间关系类别,增加465个提示。

Baselines。与九个表现强劲的模型的比较,

- T2I模型:Stable Diffusion (SD)、Attend-and-Excite (A&E)、SDXL和DALL-E 3。

- L2I模型:BoxDiff、MultiDiffusion和InteractDiffusion。

- LLM辅助的T2I模型:LayoutLLM-T2I和LMD。

使用了每个Baseline的官方实现和默认设置。对于L2I模型,除了文本提示外,还提供了来自HICO-DET和VCOCO数据集的实际边界框数据。对于LLM辅助的方法,输入布局完全由LLMs生成,而不是来自数据集。

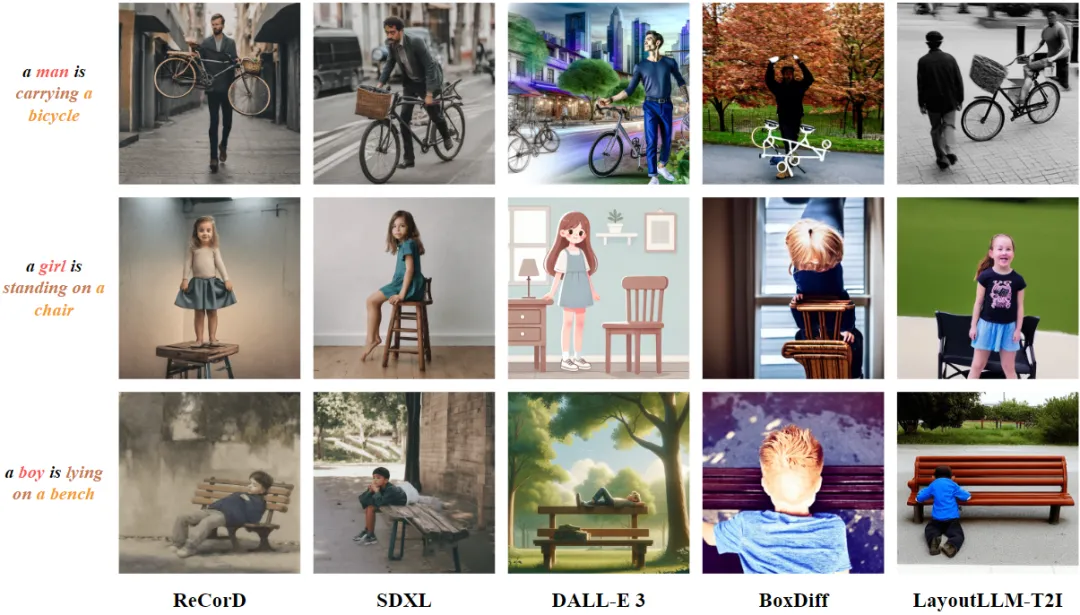

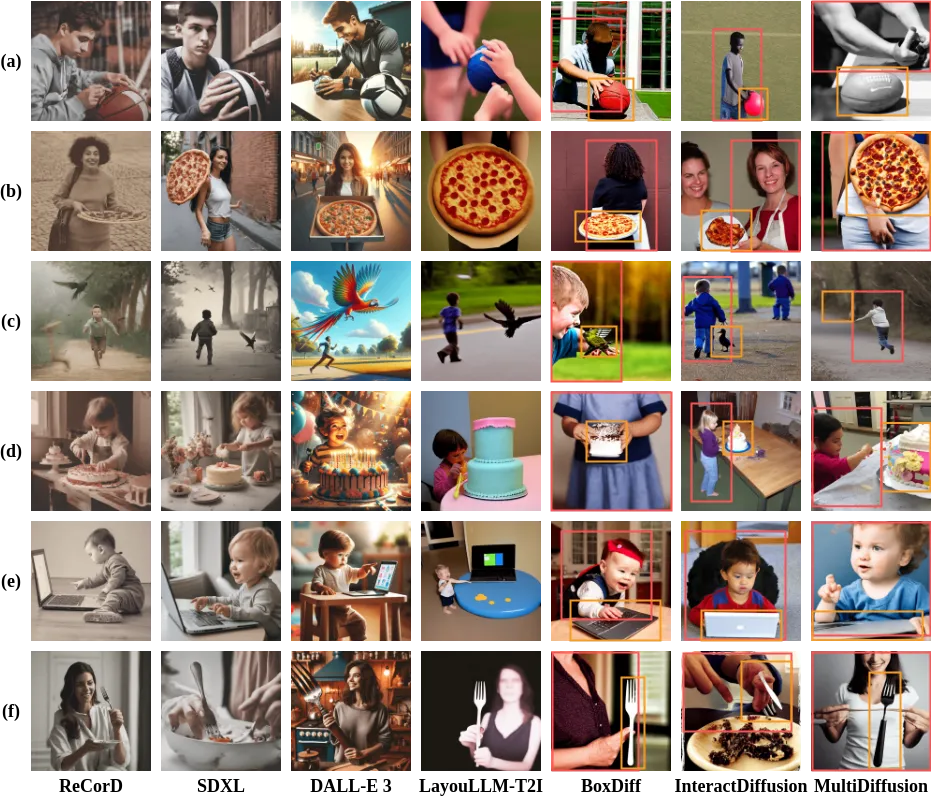

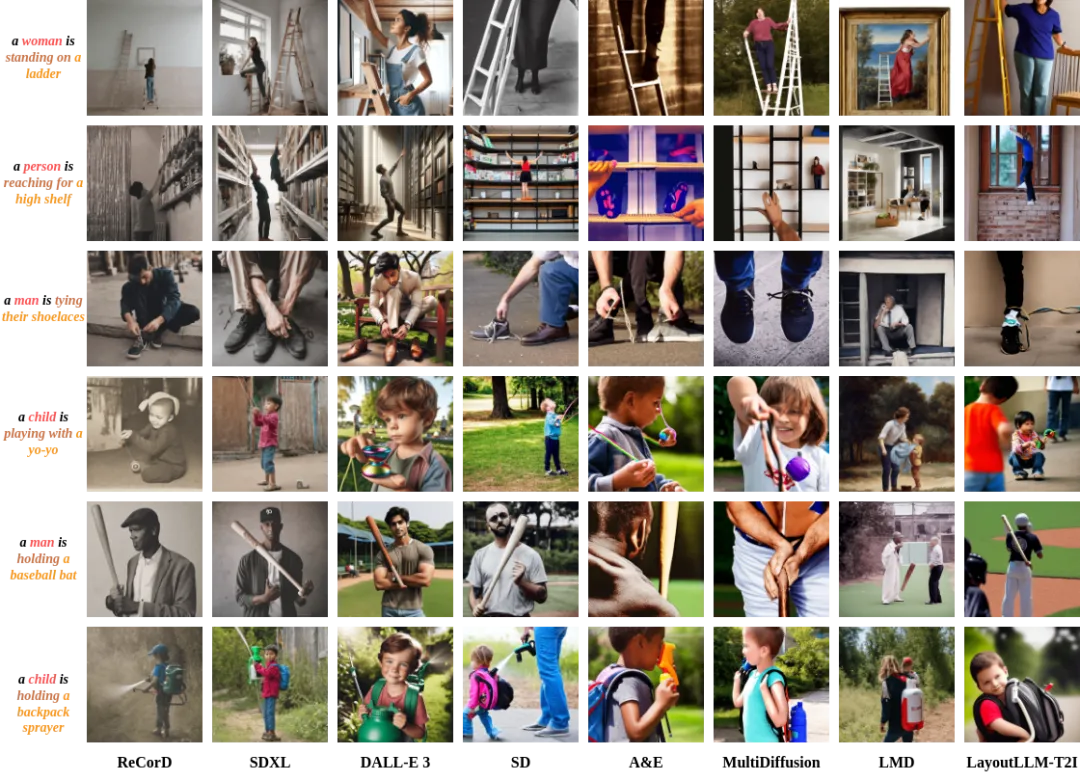

质量结果

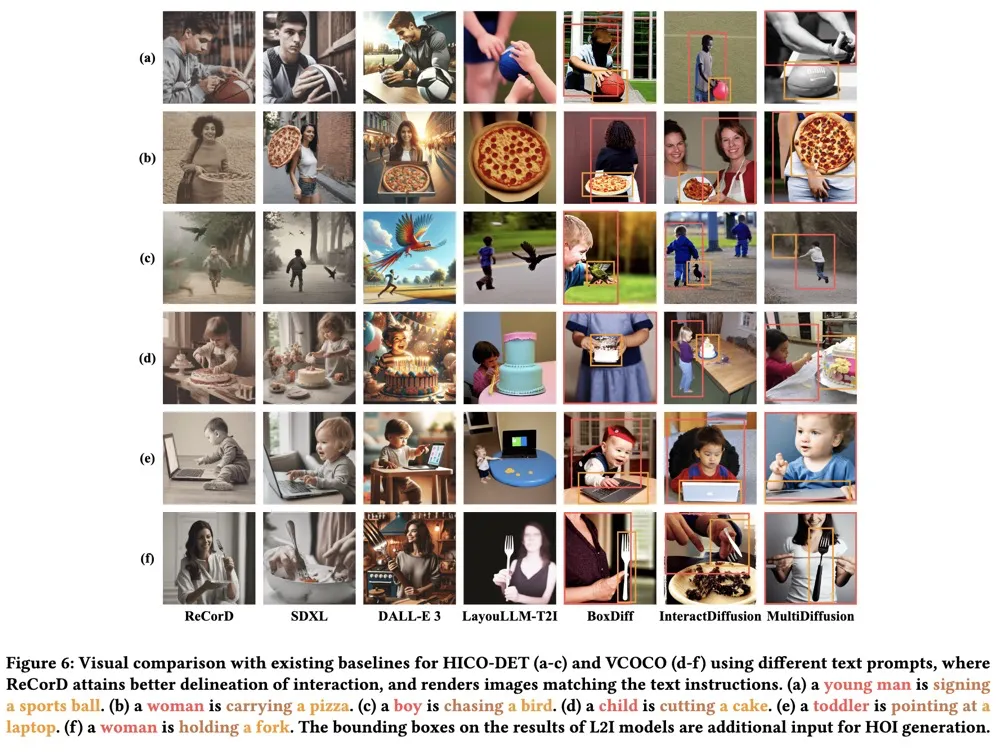

提供了一个定性比较来评估生成的HOI。如下图6所示,ReCorD在生成符合文本提示的真实人体姿势和物体位置方面优于其他最先进的方法,证明了其在高保真度描绘物体互动方面的能力。相比之下,Baseline方法往往会错误地放置物体或无法捕捉预期动作的细微差别。对于L2I模型,虽然BoxDiff在物体大小要求方面表现良好,但在准确描绘互动姿势方面存在困难;InteractDiffusion即使经过微调,仍无法准确呈现细微动作,如(a)、(d)、(e)和(f)所示;MultiDiffusion尽力实现精确的物体定位,但生成的图像大小各异。

另一方面,尽管LayoutLLM-T2I利用语言模型来改善布局生成,但通常会产生与人类不成比例的物体,这在(e)和(f)中尤为明显。此外,MultiDiffusion定义了一种新的生成优化过程,但它严重依赖于预训练模型的先验知识。特别是,SDXL在动作姿势(a)、(b)、(d)和(e)方面存在困难,而DALL-E 3在物体大小和位置(a)、(c)、(e)和(f)方面存在问题,显示了ReCorD在超越现有解决方案的局限性方面的关键进展。

定量结果

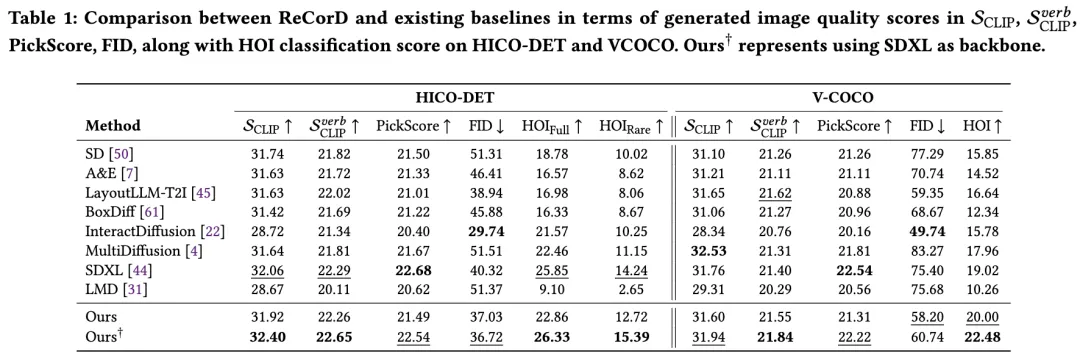

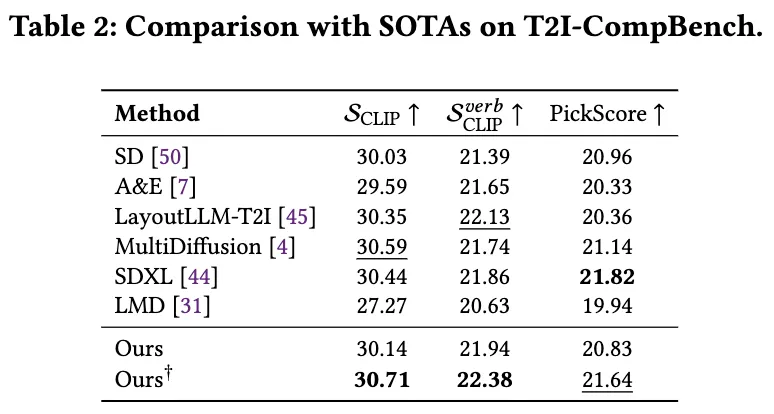

生成结果的定量比较,其中HICO-DET和VCOCO的数据提示见下表1,T2I-CompBench数据提示见表2。

图像质量评估。根据PickScore评估,ReCorD模型与SDXL模型相当,并且优于其他方法。这表明,在将设计的互动校正模块与SD模型结合后,ReCorD可以保持模型的图像生成质量,同时实现更真实的互动。此外,当使用FID分数比较HICO-DET和VCOCO数据集中的生成图像与真实图像时,ReCorD优于其他方法,除了InteractDiffusion。值得注意的是,考虑到InteractDiffusion使用HICO-DET和COCO数据集进行了微调,ReCorD在无需训练或额外HOI数据的情况下表现尤为突出。

互动准确性评估。上表1验证了ReCorD显著提高了HOI生成的准确性,显示了在合成更精确HOI方面的效果。

生成速度和内存使用

生成一张图像时,使用了Nvidia RTX 6000 GPU,当使用SD/SDXL作为骨干网时,内存消耗分别为14/42 GB,总推理时间为40.66/61.48秒。

比较布局建议的MLLM

评估了BLIP-2,通过随机调整HICO-DET中真实边界框的大小和位置。然而,BLIP-2常常误解现实世界的分布,提供无关的答案和无效的mIoU分数。相比之下,GPT-4V达到了49.72%的mIoU分数,展示了优越的布局建议准确性,使其非常适合ReCorD。

GPT-4V的评估

根据T2I-CompBench对非空间关系的评估,ReCorD取得了98.16的GPT分数,优于SOTA T2I方法如SDXL(97.87)、MultiDiffusion(97.43)和LayoutLLM-T2I(96.75)。这证明了ReCorD生成与基础模型知识对齐的准确HOI图像的能力。

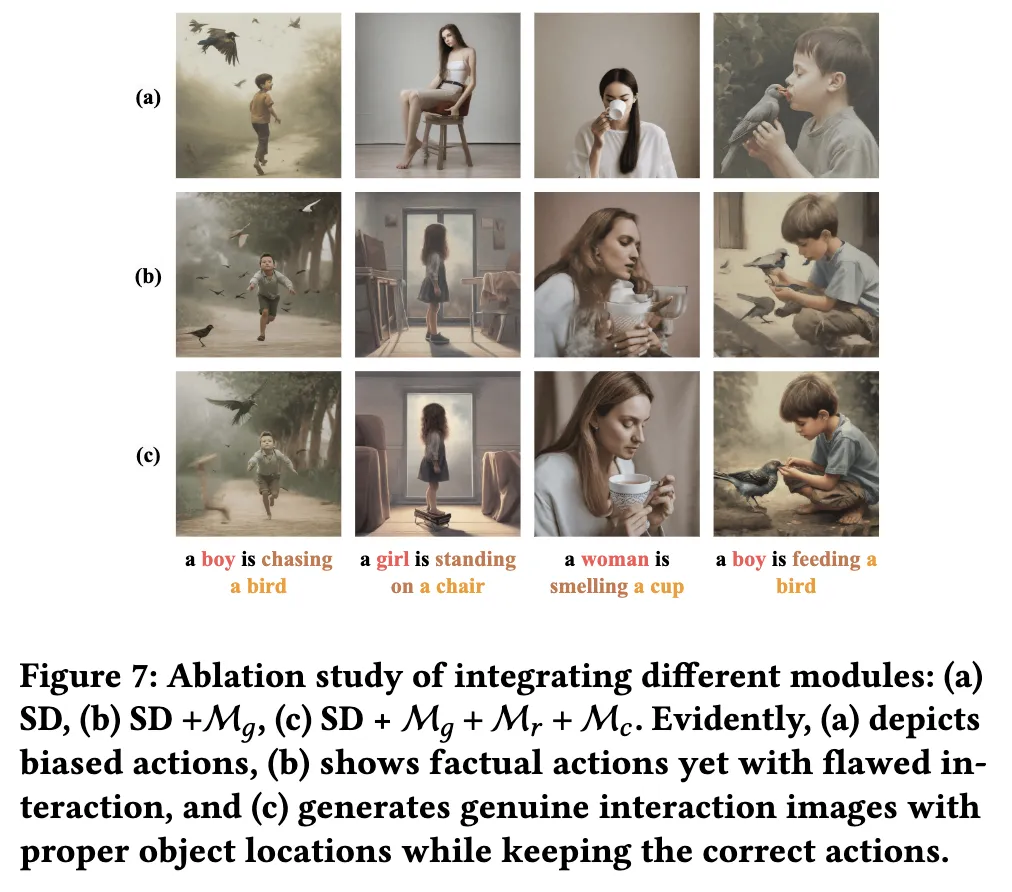

消融研究

结论

本文引入了专门为HOI(人-物体交互)图像生成量身定制的ReCorD框架。该方法包括三个特定于交互的模块,这些模块相互协作。核心思想围绕使用基于VLM(视觉语言模型)的agent和LDM(潜在扩散模型)来推理布局和修正注意力图,以解决这一挑战。大量实验证明了本文方法在提高图像准确性和语义忠实度方面的有效性,特别是在捕捉复杂交互概念方面,这是许多Baseline生成模型难以处理的。此外,通过各种协议和针对HOI生成的用户调查量化了我们的改进,提供了有价值的见解,并为该领域未来的探索铺平了道路。

本文转自AI生成未来 ,作者:Jian-Yu Jiang-Lin等