大模型到底需要消耗多少GPU显存?公式和工具全都有

如何计算大模型到底需要多少显存,是常常被问起的问题。

现从实用角度再介绍一个简单公式和一个工具方便大家工作中使用。

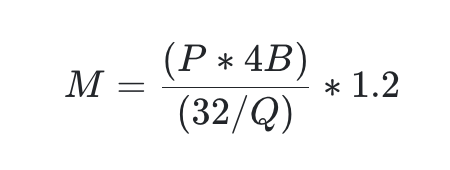

1)估算公式(该公式来自于Sam Stoelinga简化[1])

符号 | 描述 |

M | 用千兆字节 (GB) 表示的 GPU 内存 |

P | 模型中的参数数量。例如,一个 7B 模型有 7 亿参数。 |

4B | 4 字节,即每个参数使用的字节数 |

32 | 4 字节中有 32 位 |

Q | 加载模型时应使用的位数,例如 16 位、8 位或 4 位。 |

1.2 | 表示在 GPU 内存中加载额外内容的 20% 开销。 |

注意:该公式只是为了简化计算的估计,并未包含kvcache所需显存以及context大小的影响。

下面以运行16位精度的 Llama 70B 模型所需的 GPU 内存为例套用公式:

该模型有 700 亿参数。

M = (70 ∗ 4) / (32 / 16) ∗ 1.2 ≈ 168GB

由此可见,模型所需的 GPU 内存相当大。单个 80GB 的 A100 GPU 不足以满足需求,需要多个A100 GPU才能跑的起来。

如何进一步减少 Llama 2 70B 所需的 GPU 内存?

量化(Quantization)是一种减少内存占用的方法。通过将模型参数的精度从浮点数降低到低位表示(如 8 位整数),量化显著降低了内存和计算需求,使模型在资源有限的设备上更高效地部署。然而,这需要仔细管理以保持模型的性能,因为降低精度可能会影响输出的准确性。

通常认为 8 位量化能实现与 16 位精度相似的性能。而 4 位量化可能会显著影响模型的性能。

让我们再举一个 4 位量化的 Llama 2 70B 的例子:

M = (70 ∗ 4) / (32 / 4) ∗ 1.2 ≈ 42GB

这意味着你可以使用 2 个 24GB 的 L4 GPU 来运行这个模型。

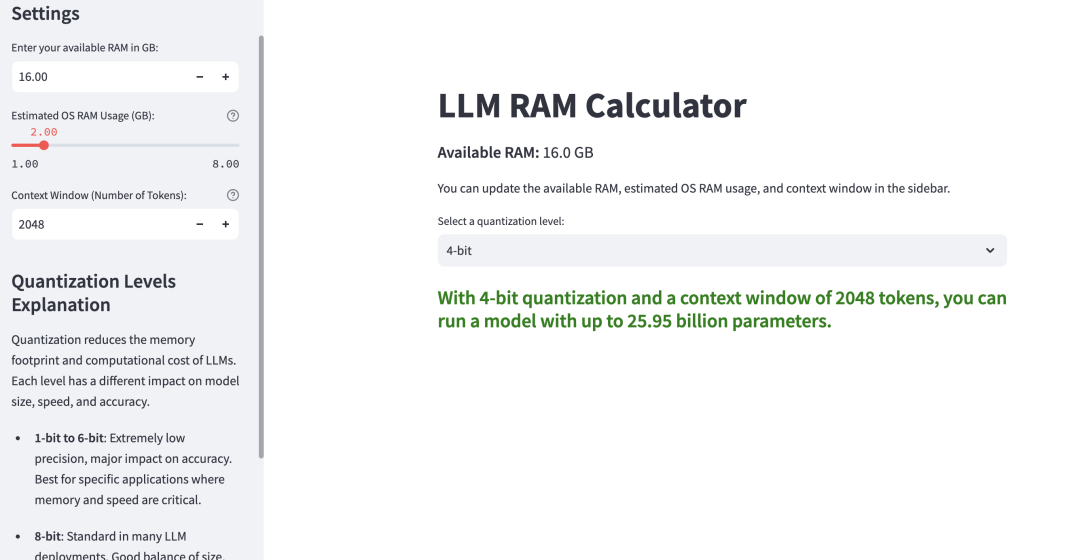

2)评估工具:

在此基础上,介绍一个能够自动计算显存能载入运行多大参数量模型的程序[2],它的输入如下:

- 可用的 RAM(以 GB 为单位)

- 估计操作系统 RAM 使用量(以 GB 为单位)

- 上下文窗口大小(Token 数量)

- 量化级别(Quantization level,每个参数的比特数)

计算过程:

- 将可用的 RAM 和操作系统的开销从 GB 转换为字节数。

- 通过将 Token 数量乘以 0.5 MB 并转换为字节数来计算上下文窗口所需的内存。

- 通过从总可用 RAM 中减去操作系统开销和上下文窗口内存,计算出可用的 RAM(以字节为单位)。

- 将量化级别从比特转换为每个参数的字节数。

- 通过将可用 RAM 除以每个参数的字节数来计算最大参数数量。

- 将结果从参数转换为以十亿为单位的参数数量进行显示。

确定上述输入后就能直接看到能够支持的最大参数量,如果计算出的最大参数量为负值,这表示上下文窗口大小对于可用的 RAM 来说太大了。在这种情况下,程序会显示一个错误信息,建议用户减少上下文窗口大小或增加可用的 RAM。

参考:

[1]https://www.substratus.ai/blog/calculating-gpu-memory-for-llm

[2]https://github.com/RayFernando1337/LLM-Calc

模型中的参数数量。例如,一个 7B 模型有 70 亿参数。