大模型学习方法之——大模型技术学习路线 原创

“ 技术学习无非涵盖三个方面,理论,实践和应用”

大模型技术爆火至今已经有两年的时间了,而且大模型技术的发展潜力也不言而喻。因此,很多人打算学习大模型,但又不知道该怎么入手,因此今天就来了解一下大模型的学习路线。

丁元英说:“透视社会有三个层面,技术,制度与文化”;同样的,技术学习同样有三个层面,理论,实践和应用,三者相辅相成,缺一不可。

技术的意义在于解决问题

大模型技术学习的理论,实践与应用

学习大模型技术需要系统性的理论基础,实践技能以及最新的研究进展和应用场景。以下是一个大模型学习进阶路线,涵盖了理论,技术和应用等方面。

理论基础

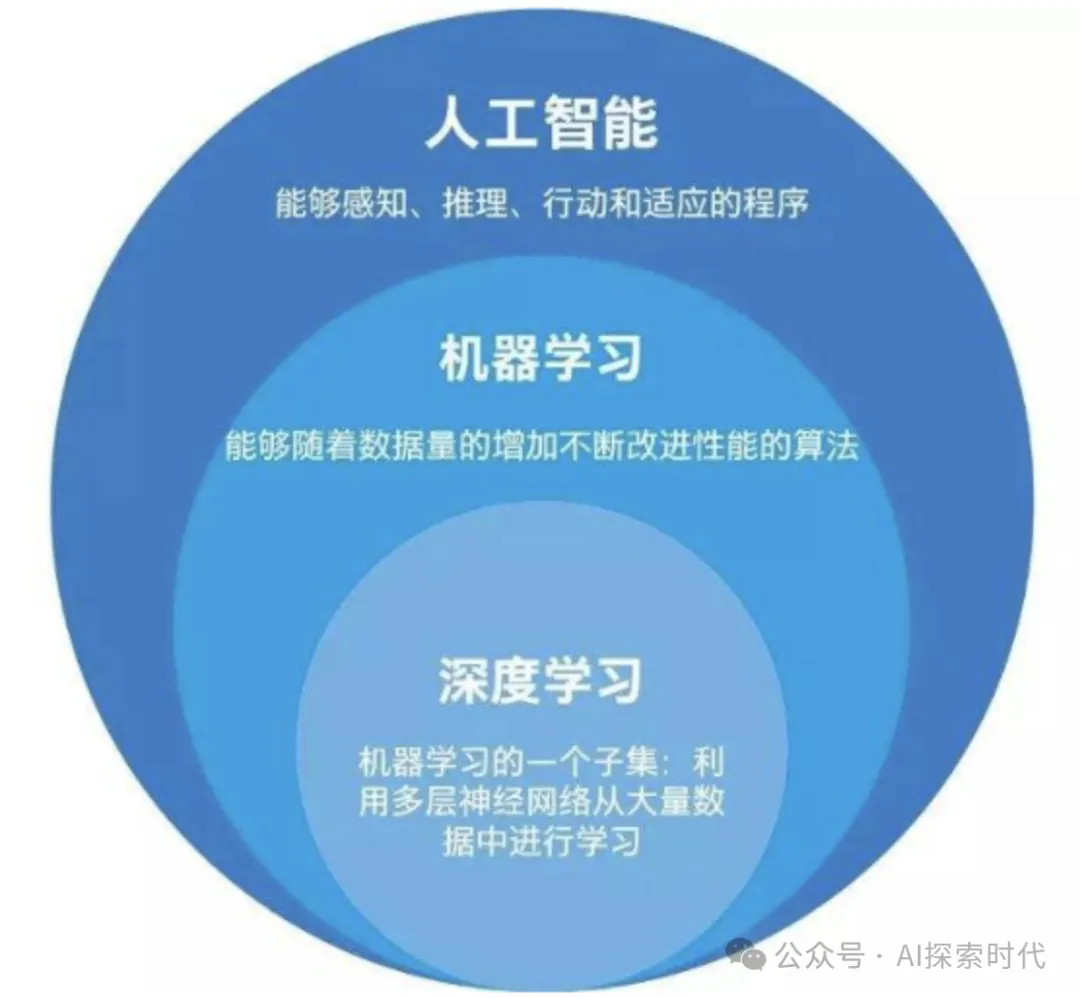

大模型学习需要有一定的理论基础,特别是数学,机器学习,自然语言处理等方面。

数学与统计学

- 线性代数:矩阵运算,特征值,奇异值分解等

- 概率论和统计学:随机变量,概率分布,贝叶斯定理等

- 微积分:偏导数,梯度下降,最优化等

机器学习基础

- 监督学习:回归,分类,支持向量机等

- 无监督学习:聚类,降维,主成分分析等

- 深度学习基础:神经网络,反向传播,激活函数等

自然语言处理

语言模型:n-gram,Word2Vec,BERT,GPT等

序列模型:RNN,LSTM,Transformer等

大模型的核心

- 预训练模型:理解什么是预训练及其在大模型中的应用

- 自监督学习:掌握自监督学习的概念及其在预训练中的应用

- 注意力机制:深入理解注意力机制及其在Transformer架构中的作用

- 多模态学习:了解如何处理文本,图像,音视频等多模态数据

实践技能

编程语言

Python:python作为目前大模型主要的开发语言,熟悉python基础,Numpy,Pandas数据处理工具

深度学习框架

TensorFlow/PyTorch: 学习如何使用这些框架构建和训练深度学习模型

模型实现

从头实现:动手实现简单的神经网络,Transformer模型,理解模型结构和训练流程

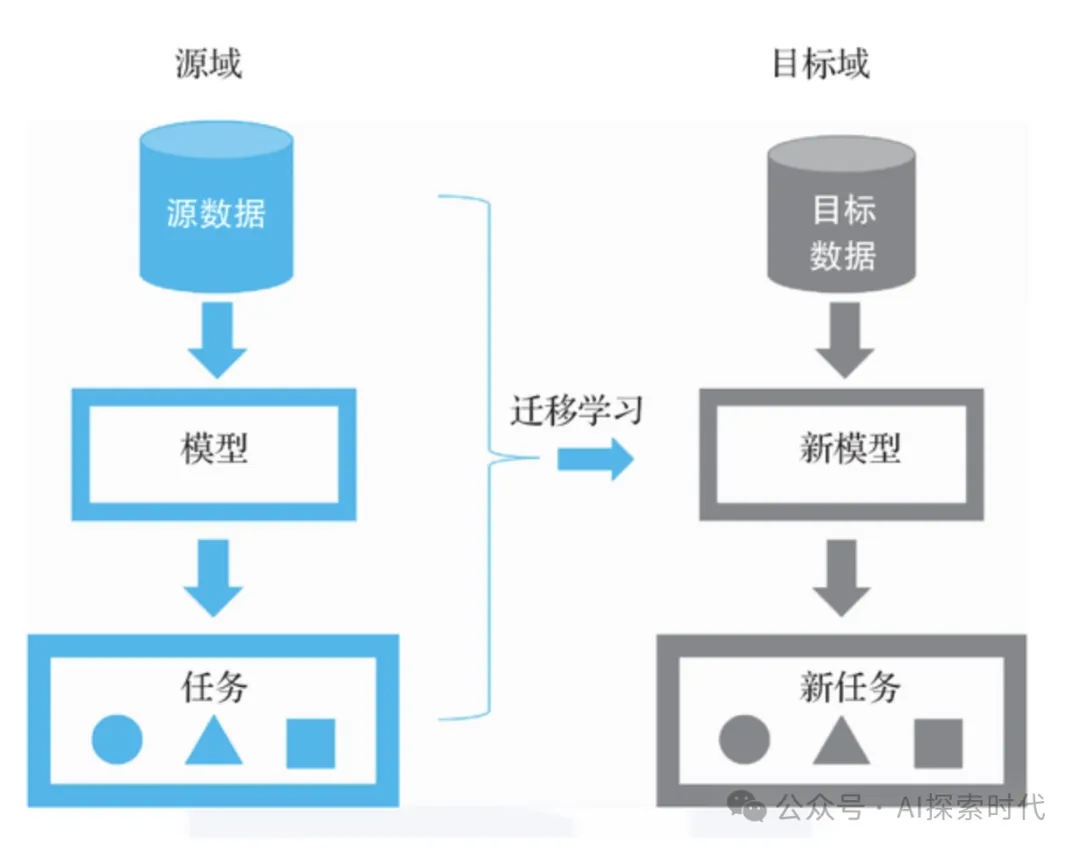

迁移学习:使用预训练模型并进行微调,适应特定任务

大规模训练

分布式训练:学习如何在多GPU或多节点环境下进行模型训练

优化技术:理解学习率调度,梯度剪裁,模型压缩等技术

项目与实战

- 构建项目:设计和实现一个完整的大模型项目,从数据准备到模型部署

- 开源贡献:参与开源深度学习框架或大模型相关项目的开发,积累实战经验

- 挑战赛:参加如Kaggle等平台的AI挑战赛,检验自己的技术水平

前沿技术

- 生成式模型:深度研究生成式模型如GPT,DALL-E,Stable-Diffusion等

- 多模态大模型:学习如果构建和训练多模态模型,处理图像,文本,音频等多种数据

- 自监督学习:研究自监督学习的最新进展及其在大模型中的应用

- 增强学习:了解增强学习在大模型中的应用,如RLHF(通过人类反馈进行强化学习)

实际应用

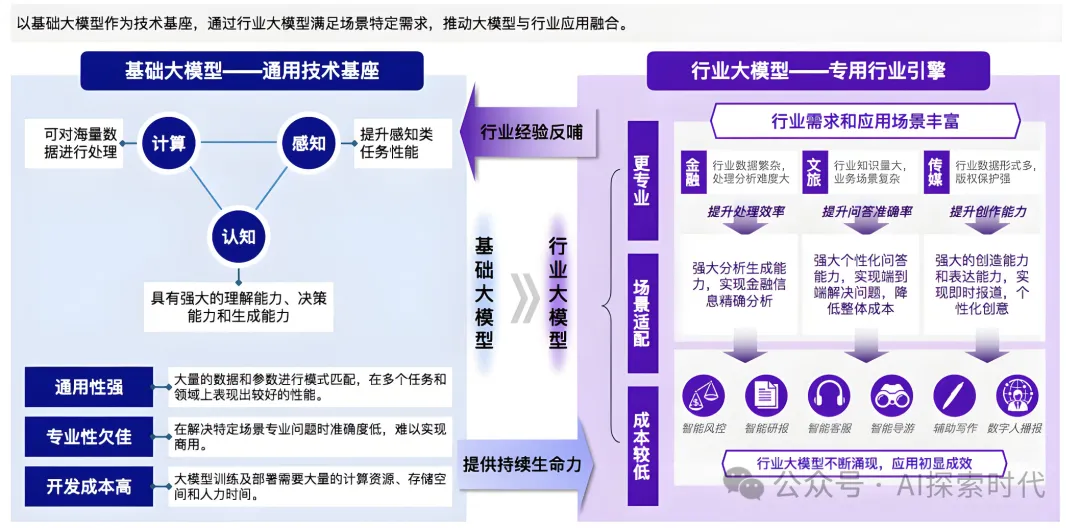

应用场景:探索大模型在自然语言处理,计算机视觉,语音识别等领域的应用

案例研究:分析ChatGPT,BERT,DALL-E等实际案例,理解大模型的应用细节

开源项目:参与开源项目或复现学术论文中的模型,提升实战能力

持续学习

大模型技术处于一个飞速发展的过程,今天合适的正确理论,或许明天就不是那么正确;今天的好方法或许明天就会有更合适的解决方案,因此持续学习是一个必不可少的技能。

学习资源

在线课程:如Coursera,edX上的深度学习课程

博客与文档:阅读如Distill,Medium等平台的技术博客

社区参与:加入AI技术社区,参与讨论,分享知识

总结与提升

经验总结:定期回顾学习过程,总结技术要点和实战经验

跨学科融合:探索大模型在其它领域(如金融,法律,医疗等)等应用,扩展知识广度

如果用一句话总结就是,学习——实践——再学习——再实践。

本文转载自公众号AI探索时代 作者:DFires

原文链接:https://mp.weixin.qq.com/s/zblj3ny1wq09f-UQjGpDqw