多模态大模型的实现原理,以及技术难点 原创

“ 多模态大模型的终点就是“人”,人就是最完美的多模态模型”

在上一篇文章中介绍了什么是多模态大模型,以及为什么需要多模态大模型;今天这里就来详细了解一下多模态大模型的实现原理以及技术难点。

多模态大模型是支持多种模态数据的深度学习模型,与之对应的是单模态模型;但因为单模态模型存在很多缺陷,因此多模态大模型应运而生。

人就是最完美的多模态模型,而大模型的发展方向也是让它越来越像“人”。

多模态大模型的思想与原理

多模态的思想是结合不同模态(文字,图片,声音等)的数据进行联合学习,从而提高模型的认知能力。

其主要表现在以下三个方面:

信息互补性:不同模态的数据携带不同的信息,联合学习能够补足单一模态的缺陷

关联性:多模态数据之间存在内在联系,学习这些联系有助于提升模型的表现

通用性:通过学习多模态数据的通用表示,可以提升模型在多个任务上的泛化能力

多模态模型的核心原理

表示学习

通过专门的编码器,将不同模态的数据转换成统一的特征表示

单模态的表示学习负责将信息表示为计算机可以处理的数值向量或者进一步抽象为更高层的特征向量,而多模态表示学习是指通过利用多种模态之间的互补性,剔除模态间的冗余性,从而学习到更好的特征表示。

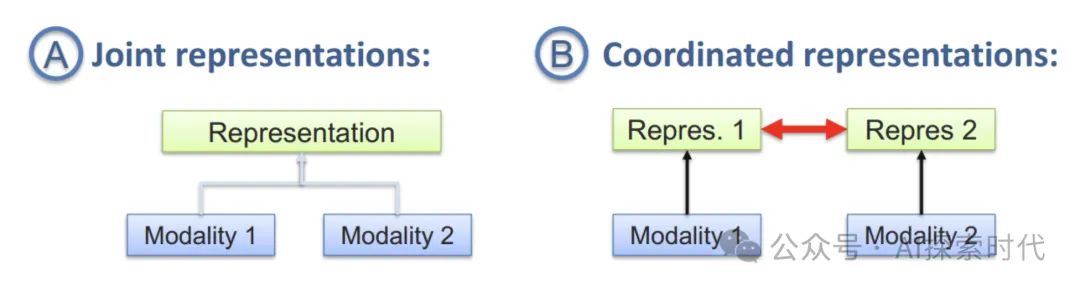

多模态表示学习有两大方向:联合表示和协同表示

联合表示是将多个模态的信息一起映射到一个统一的多模态向量空间

协同表示负责将多模态中的每个模态分别映射到各自的表示空间,但映射后的向量之间满足一定的相关性约束(如线性相关)

跨模态映射

跨模态映射是需要实现模态之间的映射,如图像到文本的生成或者文本到图像的生成;当然还有其它很多种情况,如语音合成,机器翻译等。

模态间的转换主要有两个难点,一个是open-ended,即未知结束位;例如在实时翻译中,话还未说完的情况下, 必须实时的对句子进行翻译;另一个是subjective,即主观评判性,是指很多模态转换问题的效果没有一个客观的评判标准。

对齐与融合

将不同模态的数据对齐,确保它们的语义一致性,并通过各种融合方法将数据整合在一起。

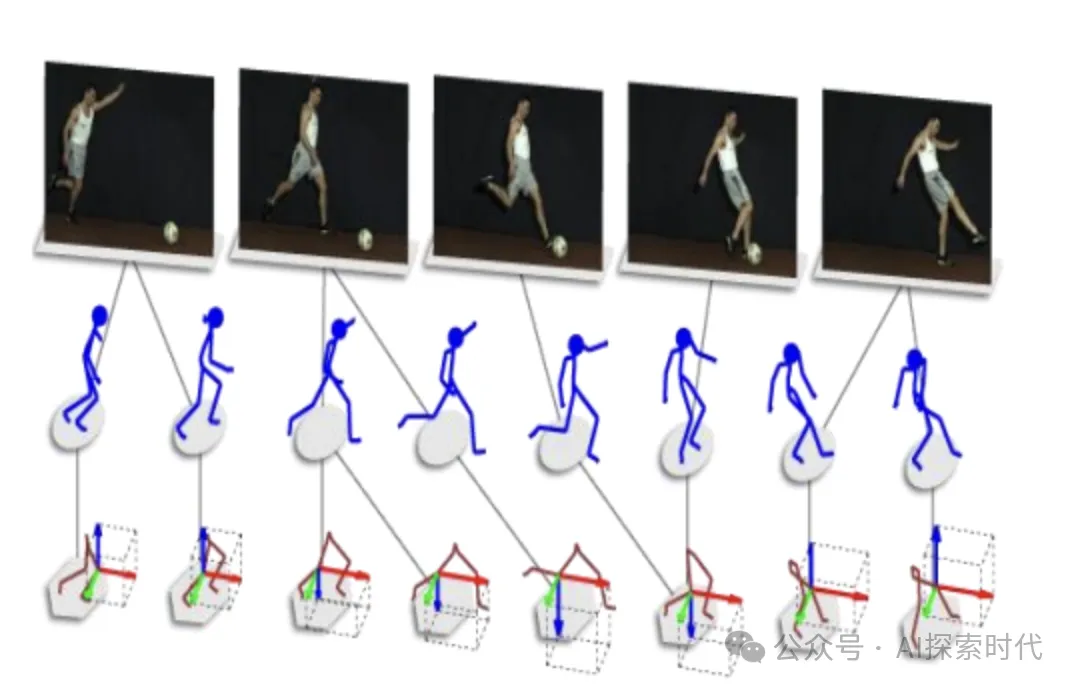

多模态的对齐负责对来自同一个实例的不同模态信息的子分支/元素寻找对应关系;对齐可以是时间维度的也可以是空间维度的,比如图片的语义分割。

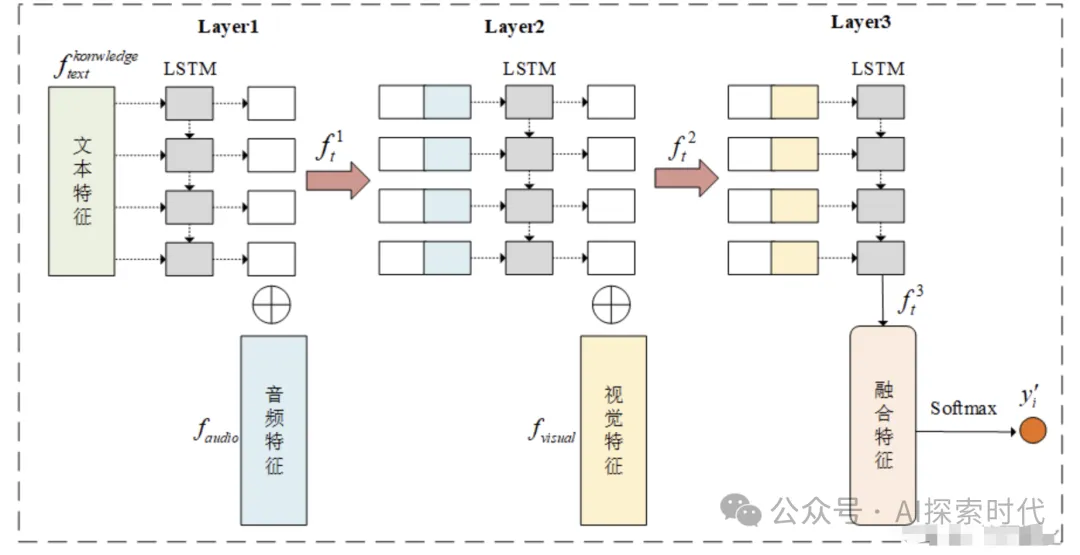

多模态的融合是将各模态的特征表示进行融合,常见的方法包括拼接,加权求和,注意力机制以及通过共享Transformer层进行联合编码

融合

多模态融合有四种不同的情况,分别是特征级融合,决策级融合,混合级融合和模型级融合。

特征级融合:也称为早起融合,是多模态识别系统最常用的策略。它表示在特征提取后把提取特征连接成单个高纬特征向量的方法,其主要用来剔除冗余信息。

决策级融合:也称为后期融合,是在获得基于每个模态的决策后,通过应用多个预测标签的代数组合规则,对这些决策执行集成步骤。

混合级融合:它是早起融合和后期融合两种方式的结合,通过早期融合和单个模态预测的输出相结合。混合级融合虽然解决了特征级与决策级融合的局限性,但本质上并没有解决问题。

模型级融合:该方法旨在获得三种模态的联合特征表示,它的实现主要取决于使用的融合模型。模型级融合是更深层次的融合方法,为分类和回归任务产生更优化的联合判别特征表示。

技术实现

多模态大模型的技术实现主要有以下步骤:

数据预处理:将不同模态(文本,图片,视频)的数据进行预处理,例如图像的像素归一化,文本的分词处理。

状态编码器:使用专门的神经网络模型处理不同模态的数据,例如使用CNN或Vision Transformer处理图像,用Transformer处理文本。类似于大模型知识库的文本解析模块,把文档解析成向量保存到向量数据中,也需要使用文档处理模型。

融合机制:将各模态的特征表示进行融合,原理就是上面的模型融,有多种方式。

训练过程:使用多模态数据进行联合训练,常见的损失函数包括分类损失,回归损失和对比学习损失等。

模型架构:比如openAI的CLIP模型通过同时处理图像和文本,学习它们之间的语义关系。

总结

多模态大模型是目前大模型厂商主要的研究方向,其实现过程困难且复杂;虽然具有很多优势,但同样也具有很多的问题。比如对计算资源的需求要远大于单模型的需求,其次多模态数据的对齐与标注同样是一个难题,最后就是跨模态的理解与生成,仍然是一个研究热点。

本文转载自公众号AI探索时代 作者:DFires

原文链接:https://mp.weixin.qq.com/s/i-paWY0Db6-sSDqaA0EWiA