回复

Llama3.1系列模型正式开源,最大405B,闭源模型的统治时代将迎来结束?

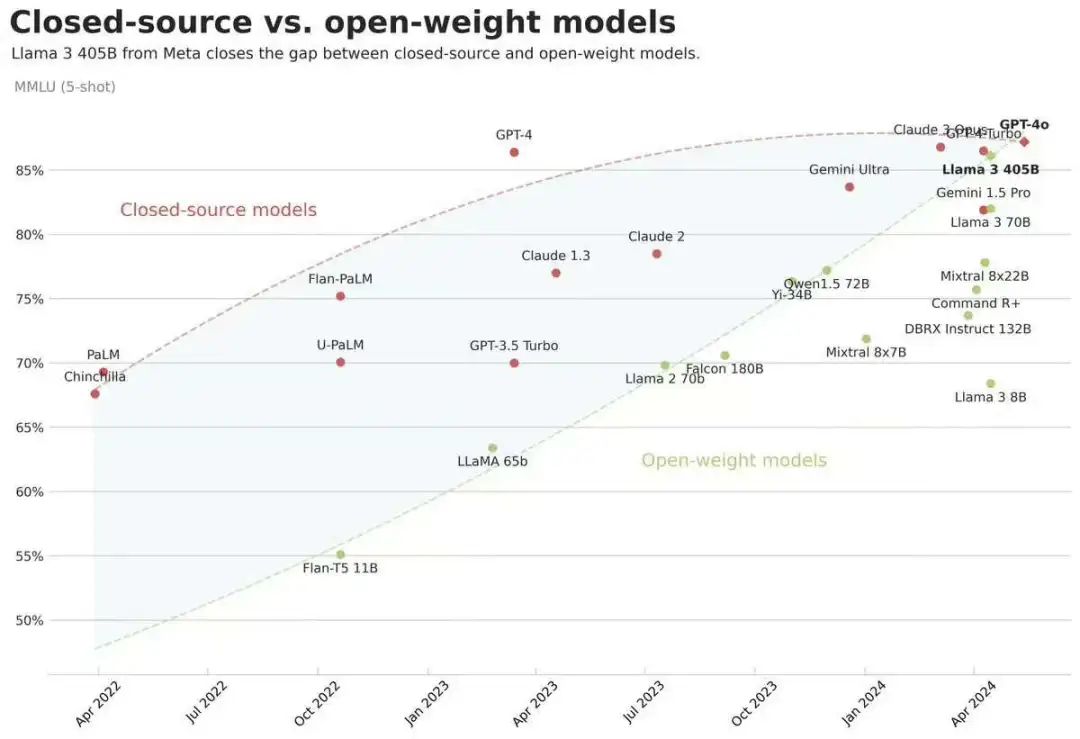

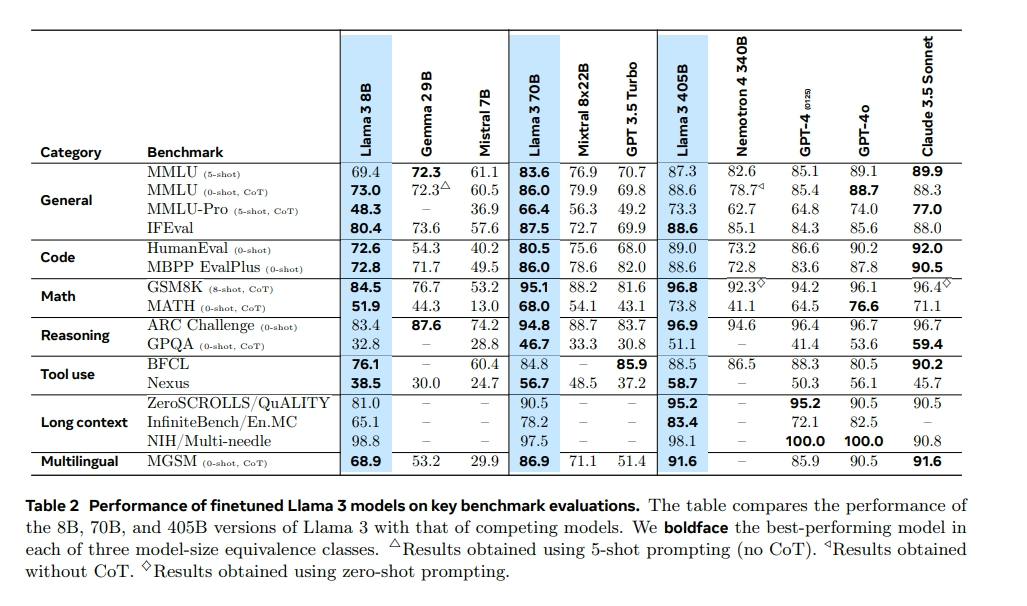

Meta开源了Llama3.1系列模型,最大参数规模为405B,开源也是好起来了,榜单指标直逼GPT4-o。

开源追上闭源模型不再是梦!Llama系列模型确实是开源界的头部,真金白银砸出来的就是不一样。

不过现在大家也都知道,榜单效果和真实使用效果也不是完全正比的,后面看看对lmsys战榜单,还有大家的实测效果吧!

Llama3.1系列模型细节

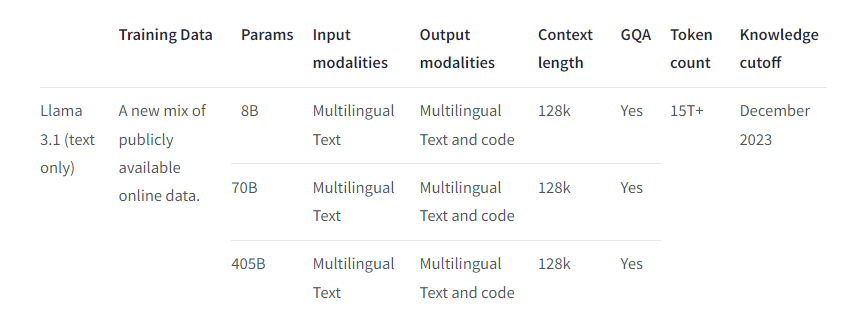

- 15T Tokens预训练;占比知识50、数学25、代码17、语言8

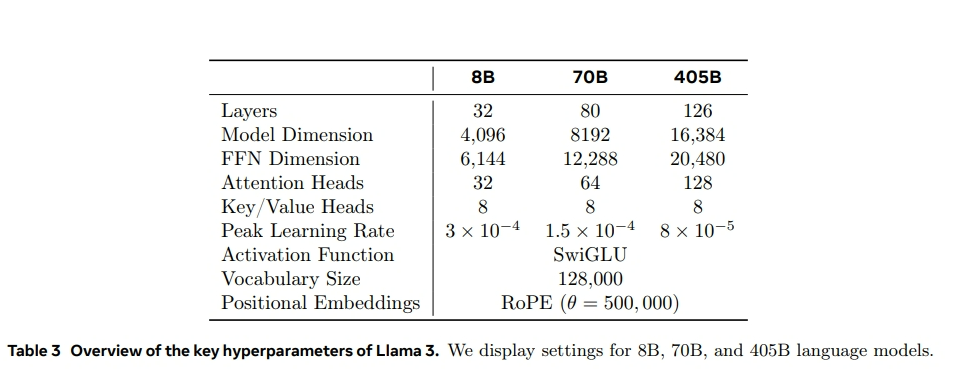

- 8B、70B、405B的模型均采用GQA;

- 405B模型,有126层,词表大小128256,隐藏层维度16384;8B和70B模型与llama3一样就不介绍了;

- 支持上下文长度128k;

- 支持多语言,包括英语、法语、德语、印地语、意大利语、葡萄牙语、西班牙语和泰语;当然其他语言也可以使用,只是没有针对性进行安全测试。

- instruct模型微调使用了公开可用的指令数据集,以及超过2500万的合成数据

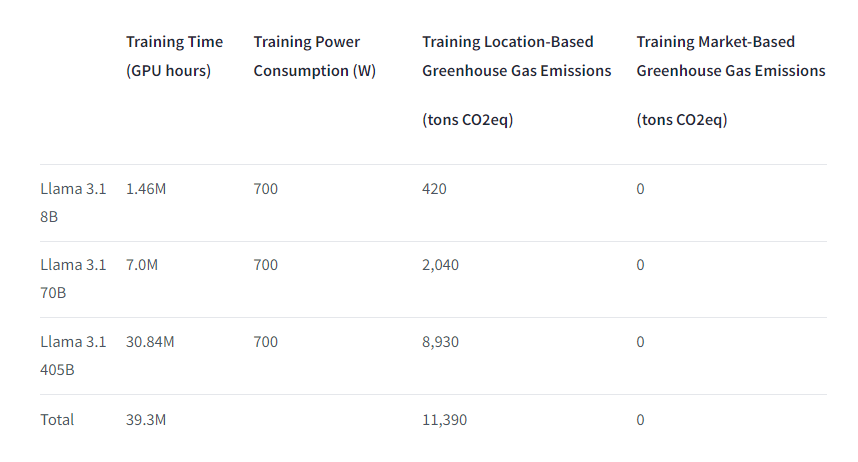

- 8B模型预训练用了146万 GPU小时,70B模型预训练用了700万 GPU小时,405B模型预训练用了3084万 GPU小时;

Llama3.1系列模型效果

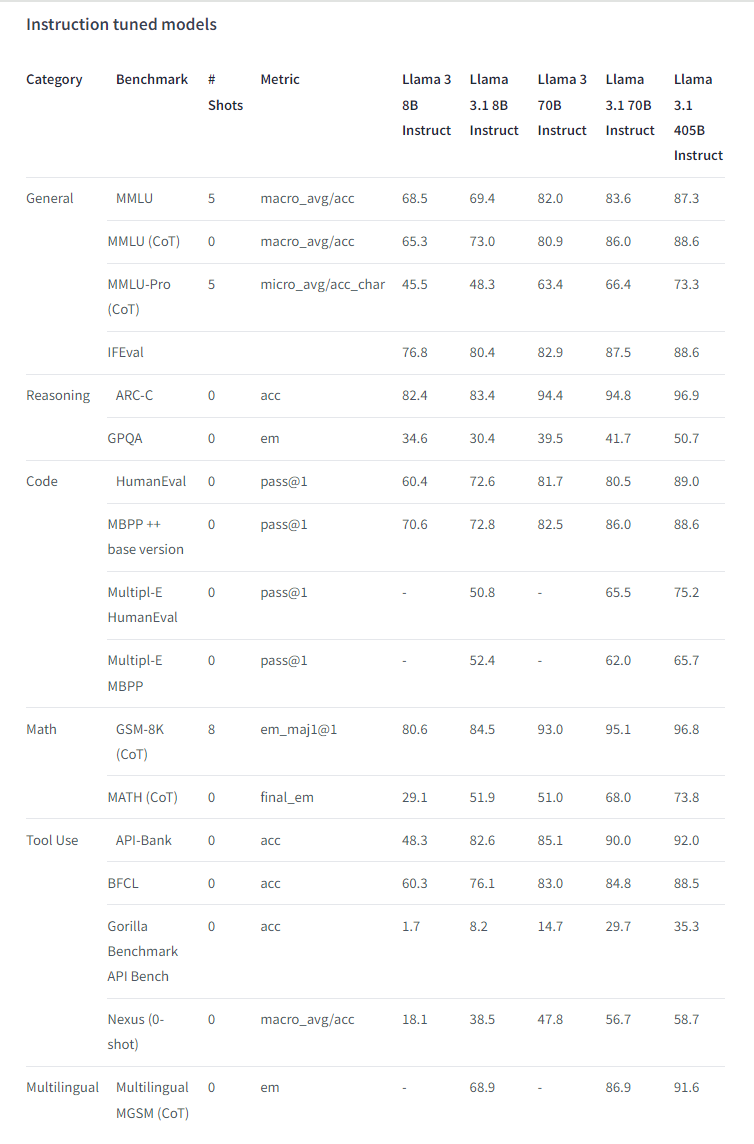

Llama3.1系列的8B和70B模型的效果,普遍好于Llama3系列模型。尤其是Instruct模型提升较高,特别是通用、代码、数学和工具使用四个方面,大幅提高;额外添加的合成数据,应该是关键。

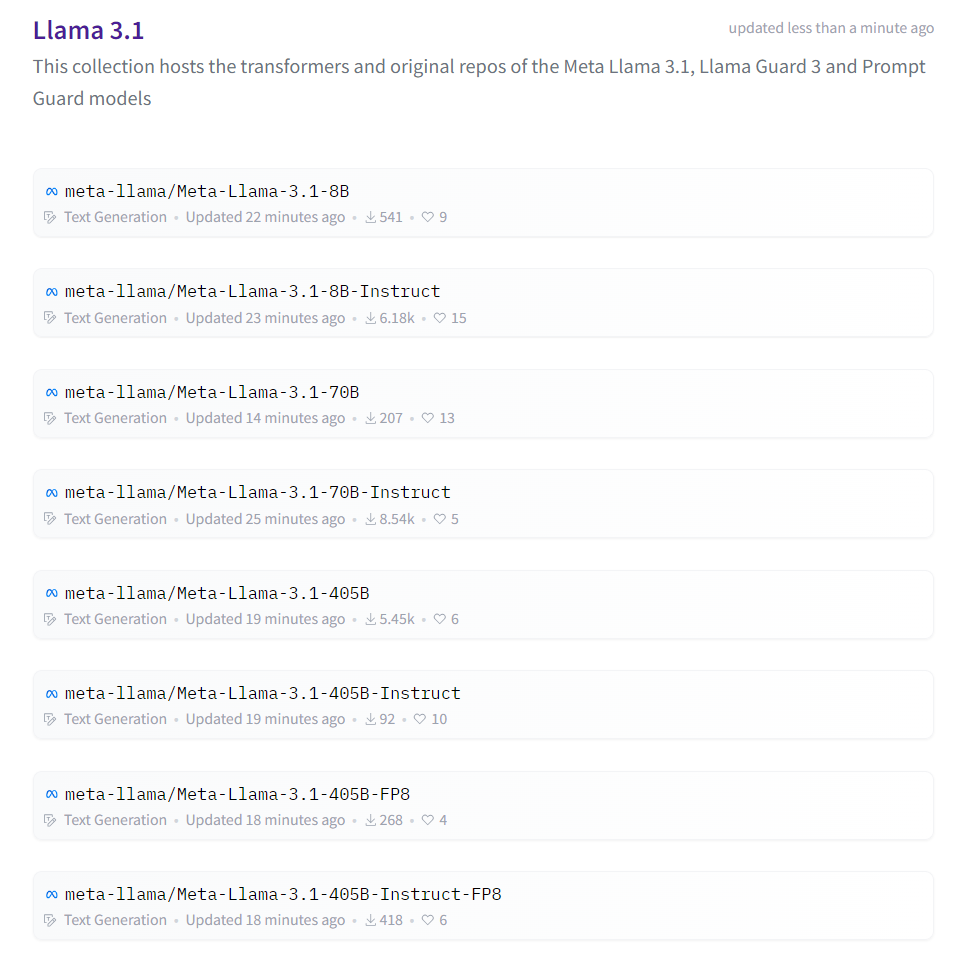

模型使用

Llama3-405B模型整体结构没有变化,所有直接transformers走起。

当然为了加速或者节省显存,也可以vllm、ollama、llamacpp等框架来加载量化模型,这里就不详细介绍了。

写在最后

不过405B模型太大了,部署成本太高了,即使效果很棒,但有多少企业有资格玩一把呢?

个人玩家就更不用说了,光模型大小就820G,别说有没有显卡,也许都没有820G磁盘空间下载都没资格,太难了!

不过后面各大平台(阿里、百度、SiliconFlow)应该会有调用API,到时候体验效果也不费事儿。

又有新工作可做了,应该很快会有Chinese-Llama-3.1工作出来,没资源的小伙伴,等就完事儿了。

最后,Qwen系列是不是也要加把劲了,都给我卷起来!

本文转载自 NLP工作站,作者: 刘聪NLP

赞

收藏

回复

相关推荐