港中文提出CLongEval中文基准测试集,准确评估大模型长上下文能力

论文题目:

ClongEval: A Chinese Benchmark for Evaluating Long-Context Large Language Models

论文地址:

https://arxiv.org/abs/2403.03514

代码地址:

https://github.com/zexuanqiu/CLongEval

01 研究背景和贡献

为了使 LLM 能够支持更复杂和多样化的应用,越来越多的研究致力于扩展 LLM 能够处理的上下文窗口。为了评估这些 long context LLM 支持长上下文能力,目前英文领域有几个数据集被提出(如 LongBench, L-Eval, LooGLE)。

然而,在中文领域,对于 long context LLM 能力评估的研究还有些滞后。目前只有一个双语基准 LongBench 可用,中文部分仅有平均长度约 13K 个字符的 1000 个测试实例。基于中文领域缺乏高质量评估数据集的现状,这篇论文提出了一个基准测试集,以准确评估 LLM 在中文领域的长文本上下文处理能力。

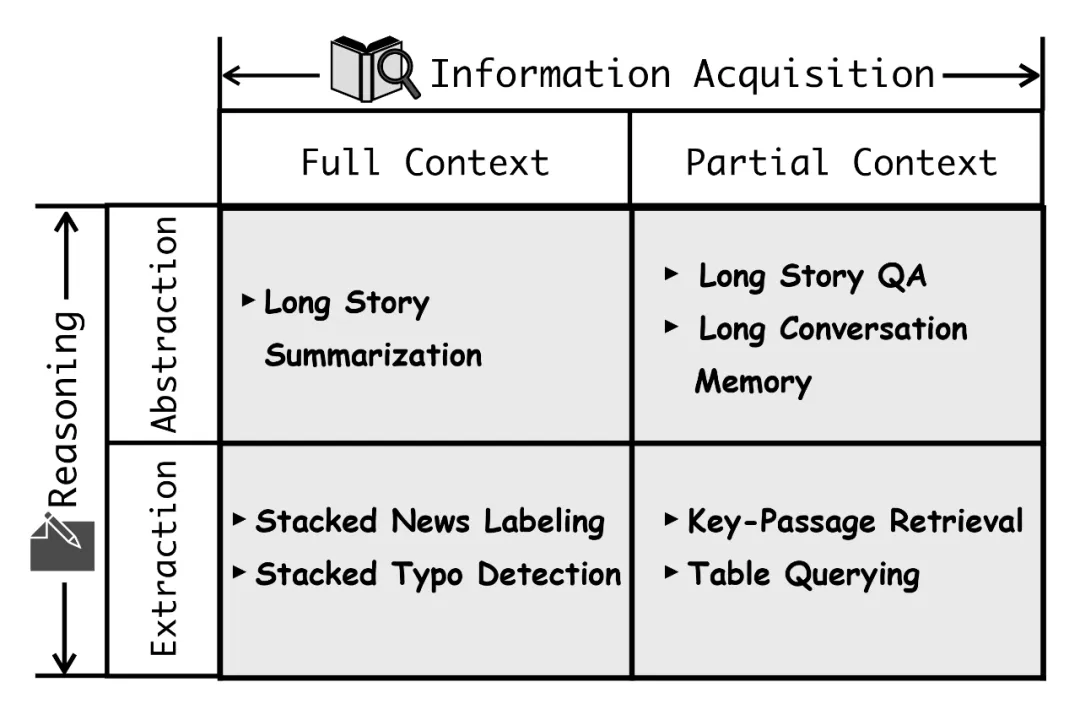

论文提出了 CLongEval,一个包含了 7 种 NLP 任务、覆盖 4 个能力维度的中文长文本能力测试集。以确保对模型能力的综合评估,作者首先对 LLM 处理长文本所需的关键能力进行了拆解。

如下图所示的框架,基于于人类自身解决问题的范式,作者将 LLM 在解决长上下文任务时所用的基础能力分解为:1)在部分上下文(Partial Context)或者全部上下文(Full Context)中识别和获取关键信息的能力;2)基于获取的全部信息,以抽取式(Extractive)或者抽象式(Abstractive)推理出答案的能力。

在这些基础能力的维度上,作者构建了了 CLongEval 基准测试集。该测试集包含了 7 个任务共 7,267 个测试样本,包括长篇故事问答(Long Story QA)、长对话记忆(Long Conversation Memory)、长篇故事摘要(Long Story Summarization)、新闻标注(Stacked News Labeling)、错别字检测(Stacked Typo Detection)、段落检索(Key-Passage Retrieval)和表格查询(Table Querying)。

其中,长篇故事问答和长对话记忆均为全新标注的数据。长篇故事摘要由 GPT-4 进行辅助标注。其余 4 个任务由公共数据集重构得来。

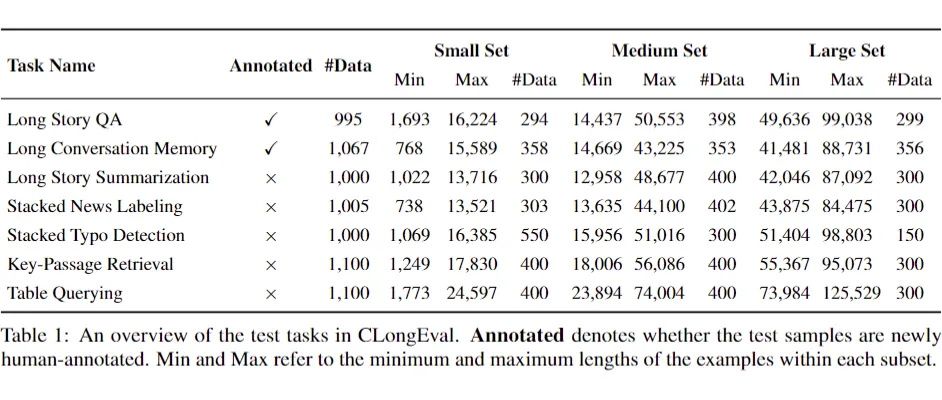

由于目前 LLM 支持的文本长度窗口(context window)差异较大,为了确保基准测试集的适用性,CLongEval 按照输入文本的长度构建了三个子集:small set、medium set 和 large set。small set 主要包括长度在 1K 到 16K 个 token 之间的测试数据,medium set 是 16K 到 50K 个 token 之间,而 large set 包含的数据扩展到 50K 到 100K 个 token。下表展示了数据集的具体统计信息。

02 数据集构建

以下是 CLongEval 包含的测试任务。每个任务针对测试一种上文提到的基础能力。

- 长篇故事问答: 该任务要求模型根据长篇故事中的部分上下文来回答问题,考察模型能否利用部分上下文信息进行阅读理解。模型需要在输入中找到有关的上下文并进行抽象推理来得到正确答案。作者在 153 本中国叙事小说中提取了 200 个不重复的故事,并根据故事长度分配了相应数量的问题。最终共标注了约 1K 个问答对。

- 长对话记忆:这个任务旨在评估模型的长期记忆能力,考察模型能否利用部分上下文信息进行阅读理解。该任务的输入为用户和伴侣聊天机器人之间连续多天的对话记录,模型需要准确地回答关于特定日期对话内容相关的问题。数据包含 80 个虚拟用户和伴侣聊天机器人之间的 140 天对话记录,和人工标注的约 1K 个问答对。

- 长篇故事摘要:作为自然语言处理的经典任务,摘要生成需要模型能够正确理解完整的长上下文并进行信息整合。作者首先将 BOOKSUM 数据集翻译成了中文,之后使用 GPT-4 辅助将 BOOKSUM 数据集中每个片段的摘要整合成总摘要。该任务包含 1K 个测试样例。

- 新闻标注:该测试任务要求模型能对输入的新闻做正确的分类。目标是评估语言模型能否理解完整的输入,并进行信息抽取。每个样例的输入包含多篇新闻以及对应的索引,输出是对每篇新闻的类别标签。该任务包含约 1K 个测试样例。

- 错别字检测:该任务要求模型识别出长篇输入中存在的所有拼写错误。目标是评估语言模型能否理解完整的输入,并进行信息抽取。错别字构造来自于日常打字常见错误类型:同音错字。错字的数量和输入的长度成正比:small set 为 10 个错字,medium set 为 20 个错字,large set 为 30 个错字。该任务包含约 1K 个测试样例。

- 段落检索:该任务是为了考察模型在长上下文中抽取所需信息的能力,尤其是准确返回复杂搜索结果的能力。数据集中每个样例都是一个被序列化为字符串的 JSON 对象,其中包含多个键-段落(key-passage)对。这个任务和常见的键-值检索任务类似,区别在于这里检索对象是具有实际语义的自然语言文本,而不是随机生成的 128 位 UUID 字符串,因此更具有挑战性。该任务包含约 1K 个测试样例。

- 表格查询:该任务是为了考察模型在长上下文中抽取所需信息的能力,尤其是在长上下文中执行复杂查询的能力。数据集中每个样例由多个使用 Markdown 格式排列的表格组成;期待模型可以在长上下文中定位到目标表格,并根据查询条件从该表格中得到输出。该任务包含约 1K 个测试样例。

03 实验结果

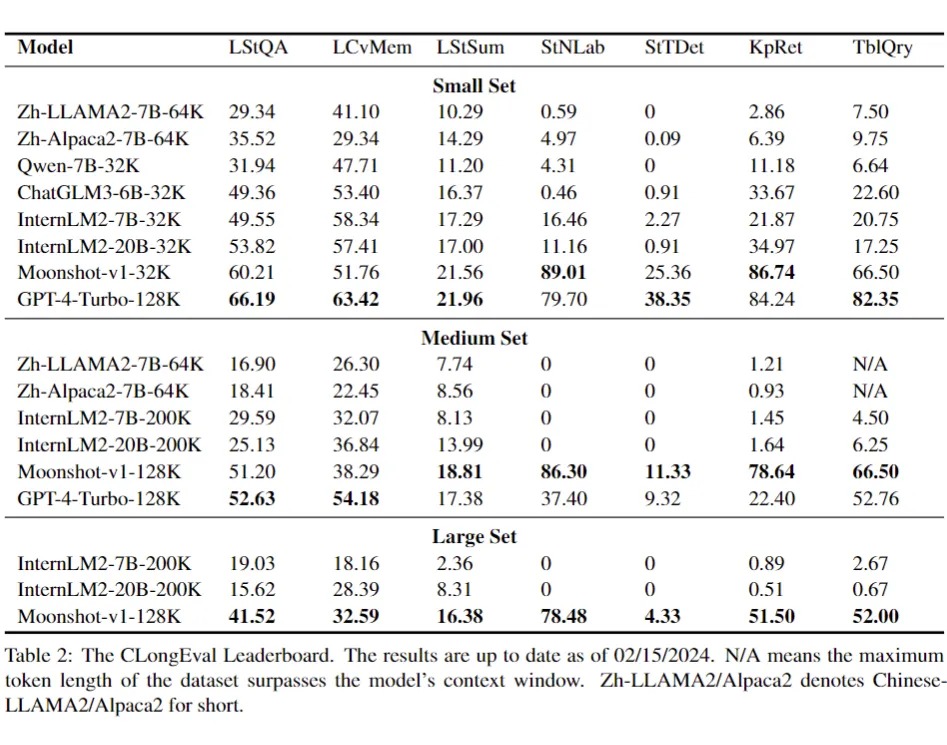

下表为主实验结果,展示了 6 个开源模型和 2 个闭源模型(GPT-4-Turbo 和 Moonshot-v1)在 CLongEval 上的表现。

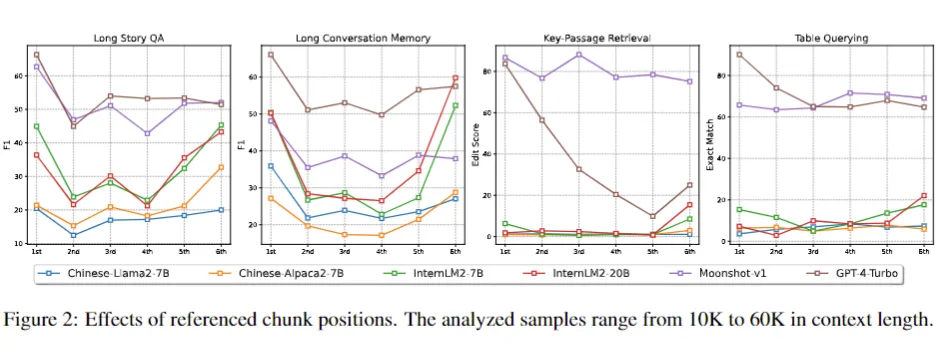

作者分析了参考答案在上下文中的对应位置对模型性能的影响,结果如下图所示。作者在需要部分上下文的四个任务上进行实验,发现在长篇故事问答和长对话记忆这两个任务中,“Lost in the middle” 这一现象较为明显。

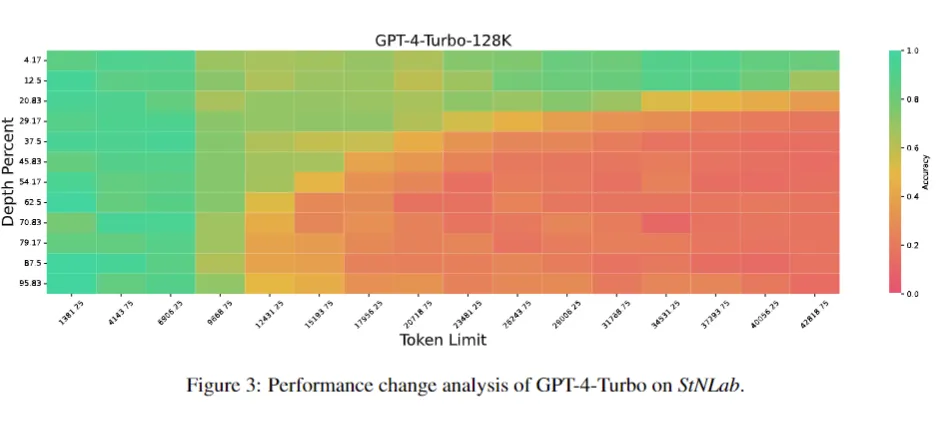

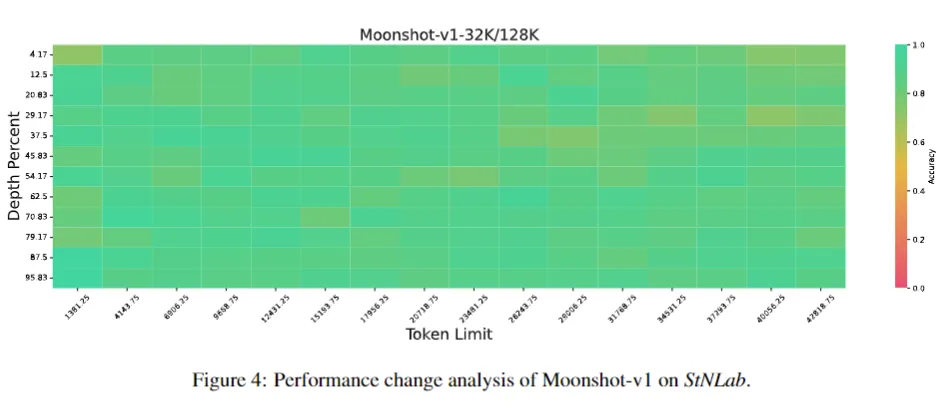

下面的两张图展示了 GPT-4-Turbo 与 Moonshot-v1 在新闻标注这个任务中不同位置与不同深度的分类准确率的可视化分析。可以发现,Moonshot-v1 的表现更加稳定。

更多实验结果以及分析请参考原文。

本文转自 PaperWeekly ,作者:让你更懂AI的