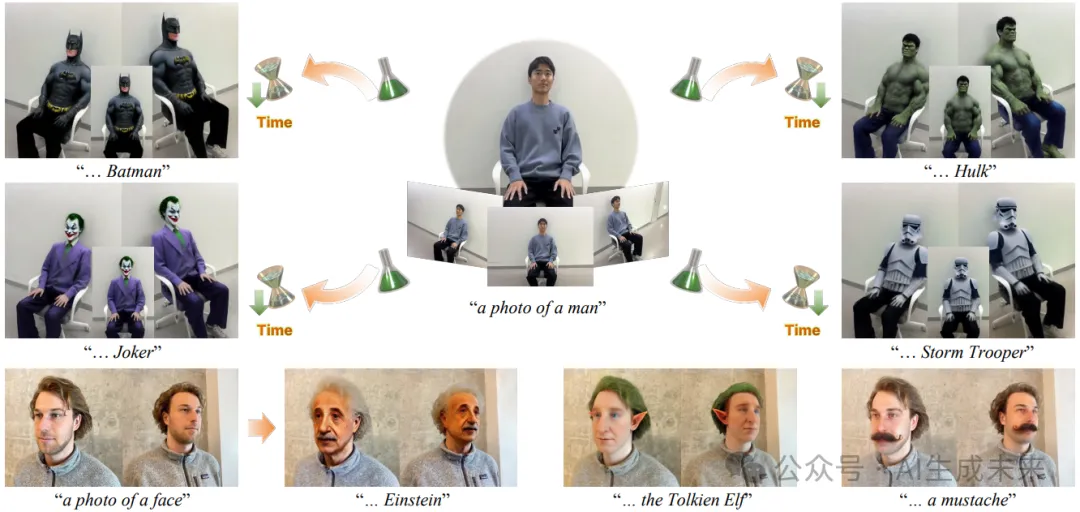

超越所有NeRF方法!快速和高质量的3D编辑和身份保持新策略:DreamCatalyst

论文链接:https://arxiv.org/pdf/2407.11394

github链接:https://dream-catalyst.github.io/

亮点直击:

- 本文通过将DDS解释为SDEdit过程,提出了一种3D编辑的一般公式,并提出了一种用于快速编辑和质量改进的专门公式。

- 在一般的3D编辑任务中采用了递减时间步采样,这是一种在3D生成任务中常用的加速训练速度的采样算法,解决了以往工作中面临的挑战。

- 首次引入FreeU用于3D编辑,以增强可编辑性,克服重新加权编辑目标公式中固有的权衡。

- 编辑的速度和质量优于当前最先进的NeRF编辑方法。

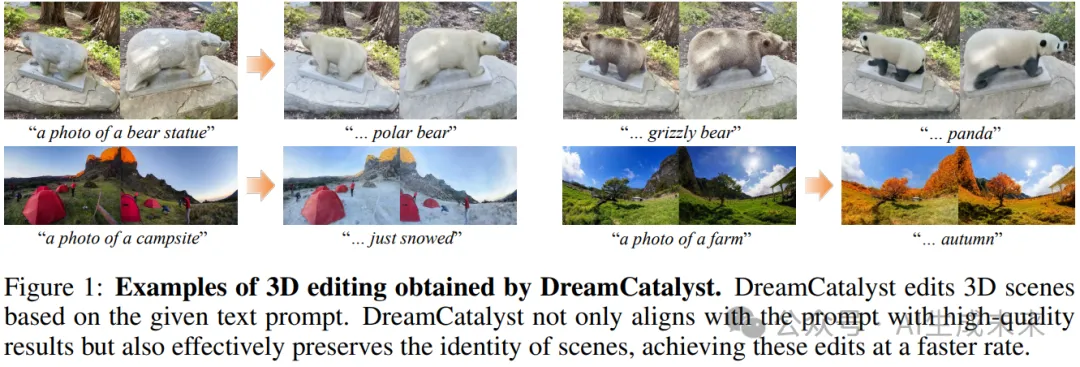

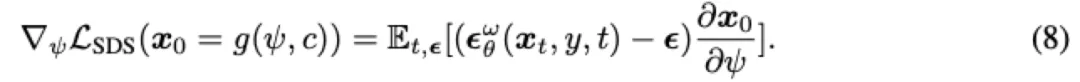

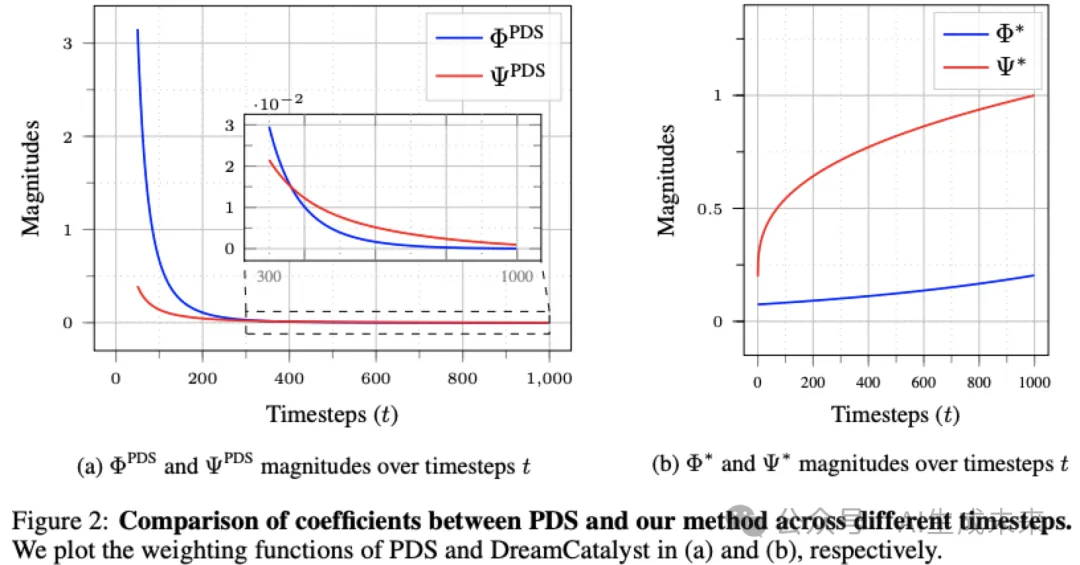

得分蒸馏采样(SDS)因其固有的3D一致性,在文本驱动的3D编辑任务中已成为一种有效的框架。然而,现有基于SDS的3D编辑方法由于偏离扩散模型的采样动态,导致训练时间过长且结果质量低下。在本文中,本文提出了DreamCatalyst,这是一种将基于SDS的编辑解释为扩散反向过程的新颖框架。本文的目标函数考虑了采样动态,因此使DreamCatalyst的优化过程成为编辑任务中扩散反向过程的近似。

DreamCatalyst旨在减少训练时间并提高编辑质量。DreamCatalyst提供了两种模式:

- 快速模式,仅需约25分钟即可编辑NeRF场景;

- 高质量模式,在不到70分钟内产生优质结果。具体来说,本文的高质量模式在速度和质量方面均优于当前最先进的NeRF编辑方法。

DREAMCATALYST

动机

本文旨在设计一个目标函数,类似于PDS(Perceptual Diffusion Sampling),包含一个显式的强身份保留项,同时与扩散时间步的作用对齐,并允许应用递减时间步采样。为了实现这一目标,必须在大噪声扰动中强调身份保留,并通过重新加权公式12中的每一项,在小扰动水平上不发生偏离。然而,随机潜在匹配的公式本质上隐含了一个身份保留项和DDS(Diffusion-Denoising Score Matching)损失的梯度,使其无法直接调整系数。因此,本文提供了DDS的新解释,并通过这一视角引入PDS的一般公式来重新加权这些项。

此外,本文提出了一种专门的公式,与扩散时间步的角色对齐,并支持递减时间步采样。这种专门的公式主要有两个优点:

- 通过考虑扩散时间步的作用,本文的公式可以生成细节丰富的3D编辑结果;

- 通过扩散友好的采样,递减时间步采样极大地减少了训练时间。

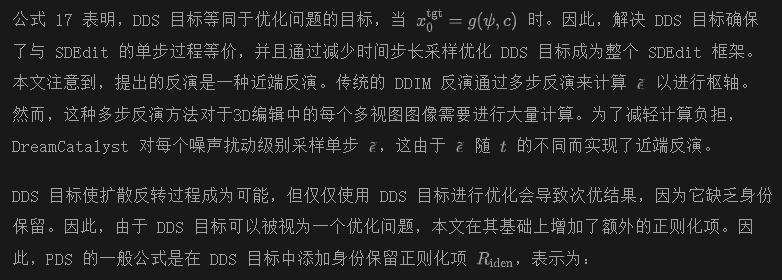

PDS 的一般公式

本文揭示了反向SDEdit过程和DDS(Diffusion-Denoising Score Matching)之间的关系。DreamCatalyst的关键见解是,DDS的目标等同于基于单步DDIM(Denoising Diffusion Implicit Models)的SDEdit采样。

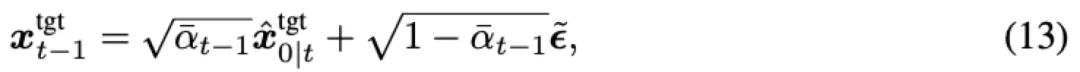

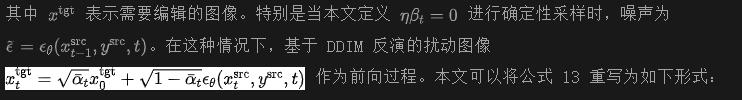

上述公式通过解决随机采样噪声的随机微分方程(SDEs)实现随机编辑。然而,最近的编辑研究利用DDIM反演来保留源身份。通过结合SDEdit和DDIM调度来保留源身份,基于DDIM的SDEdit采样定义为:

尽管SDEdit的单步去噪过程在扩散过程中通过公式13已经很清楚,但受到Dreamsampler(Kim等人,2024年)的启发,本文可以将该过程解释为如下的优化问题:

其中:

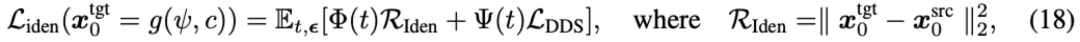

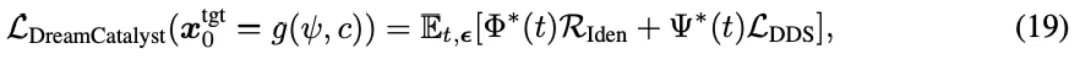

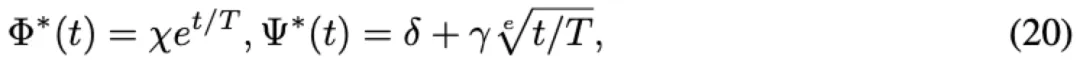

基于 SDS 的扩散友好编辑

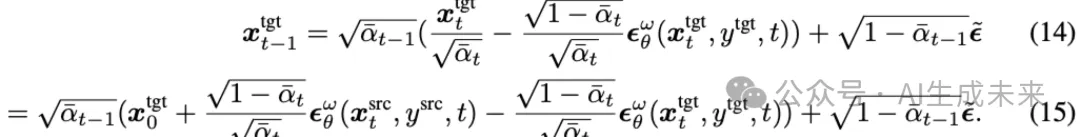

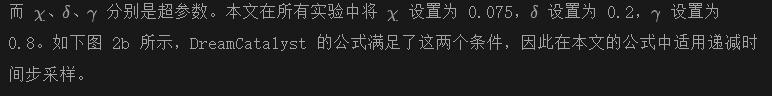

在本节中,本文提出了一个专门的公式(公式18),该公式考虑了扩散时间步的作用以及与递减时间步采样的对齐问题。DreamCatalyst中的公式设计旨在满足两个条件:

- 在高时间步中强身份保留

- 在低时间步中减少身份保留。

第一个条件是,在高时间步中强身份保留,可以减少源特征在高噪声扰动水平下的信息丢失。这个条件使得可以利用递减时间步采样。第二个条件是,在低时间步中弱身份保留,这有助于在扩散过程中合成细节。满足这两个条件的DreamCatalyst专门公式如下:

其中,

本文注意到,满足两个条件能够实现有效的3D编辑,如上图1所示。本文将更优设计选择的探索留给未来的工作。

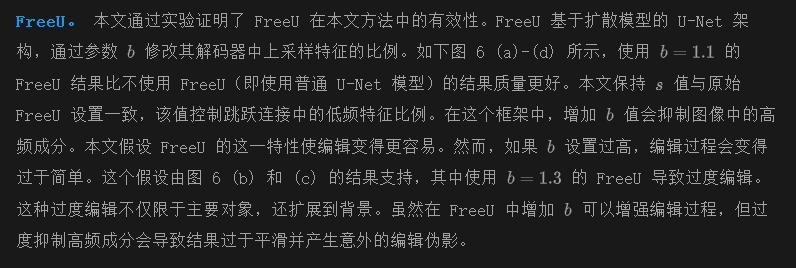

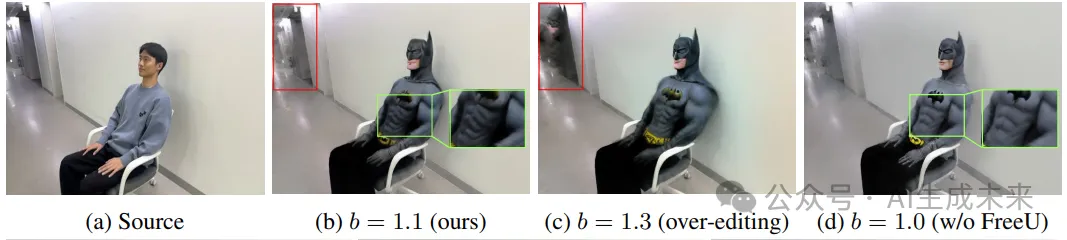

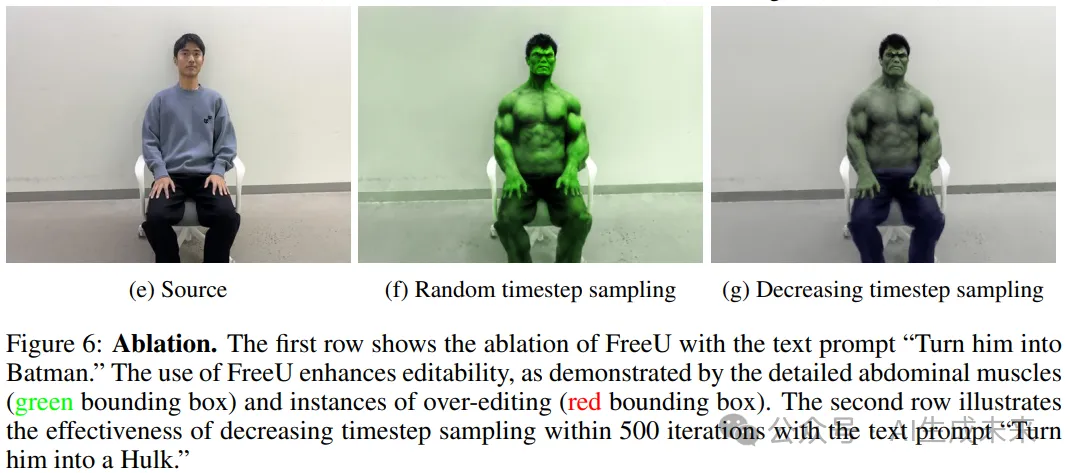

使用 FREEU 增强可编辑性

尽管使用所提出的损失函数的SDEdit过程改善了编辑质量,但目标函数的设计因固有的权衡而仅能带来有限的改进。在编辑任务中,可编辑性和身份保留是众所周知的权衡。修改模型架构提供了一种替代方法来增强编辑质量,带来了仅通过损失函数设计无法实现的性能提升。

本文引入了在3D编辑中使用FreeU,以在不增加额外内存使用和计算成本的情况下增强可编辑性。FreeU通过放大包含大量低频信息的骨干特征来抑制高频特征。放大骨干特征强调了低频特征,从而相对减少了高频特征的影响。结果,通过抑制高频特征,提高了可编辑性,因为高频特征的锐利特性被平滑处理,边缘特征被削弱。此外,身份保留对应于低频域,通过放大骨干特征得以维持。综上所述,FreeU在不牺牲身份保留的情况下增强了可编辑性。

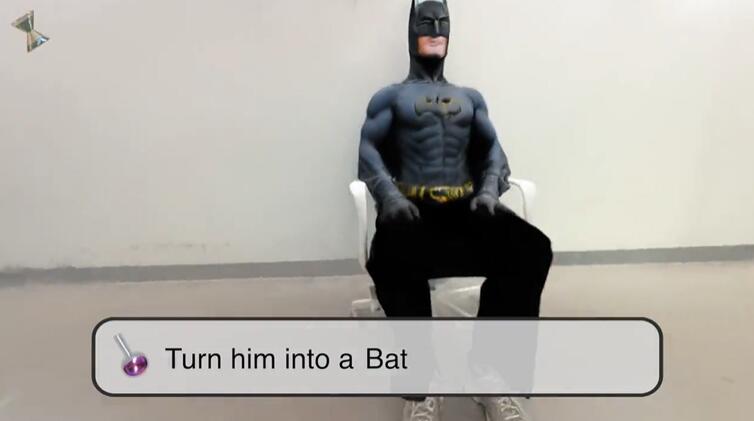

REAMCATALYST 中的文本指导

定性评估

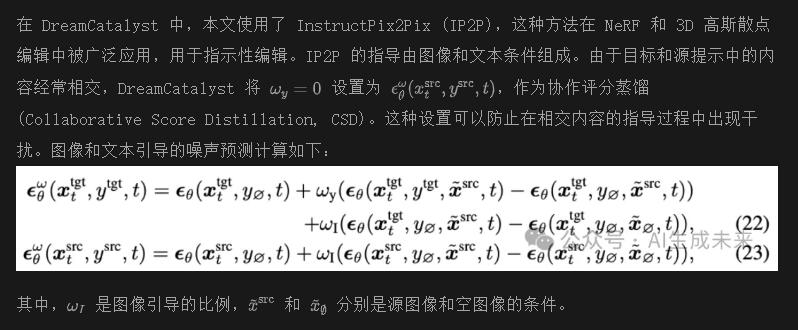

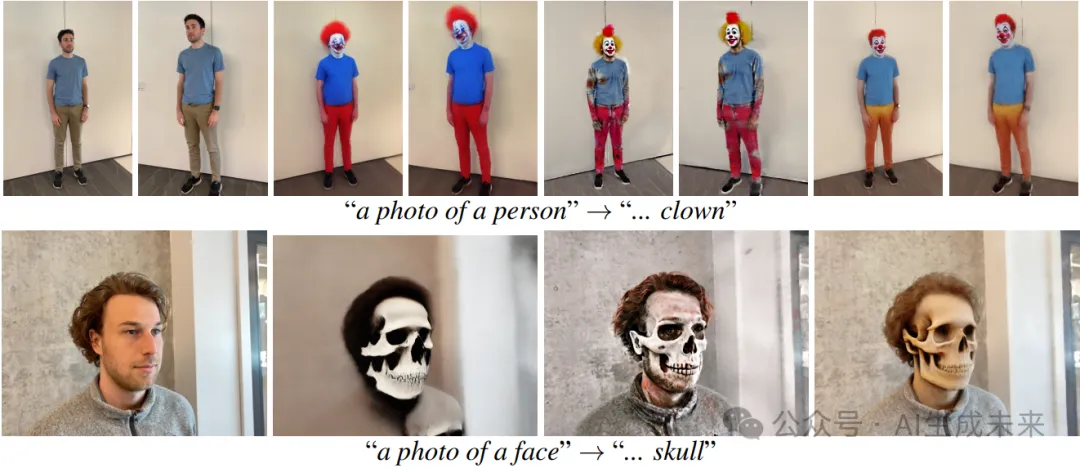

在下图 4 中,本文展示了与基线方法的定性比较。虽然基线方法产生的背景模糊且过度饱和,但 DreamCatalyst 很好地保留了源场景的背景。此外,与基线方法相比,DreamCatalyst 合成了更详细、更逼真的编辑结果(例如,基线方法生成的郁金香模糊且缺乏细节)。PDS 似乎可以很好地编辑主体,但其结果往往过度饱和且不够逼真,背景更容易模糊或改变颜色。因此,DreamCatalyst 在保持源场景身份的同时,具有更优越的可编辑性,超越了其他基线。

定量评估

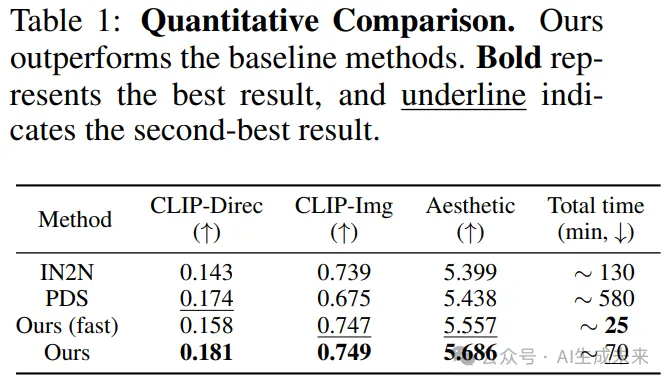

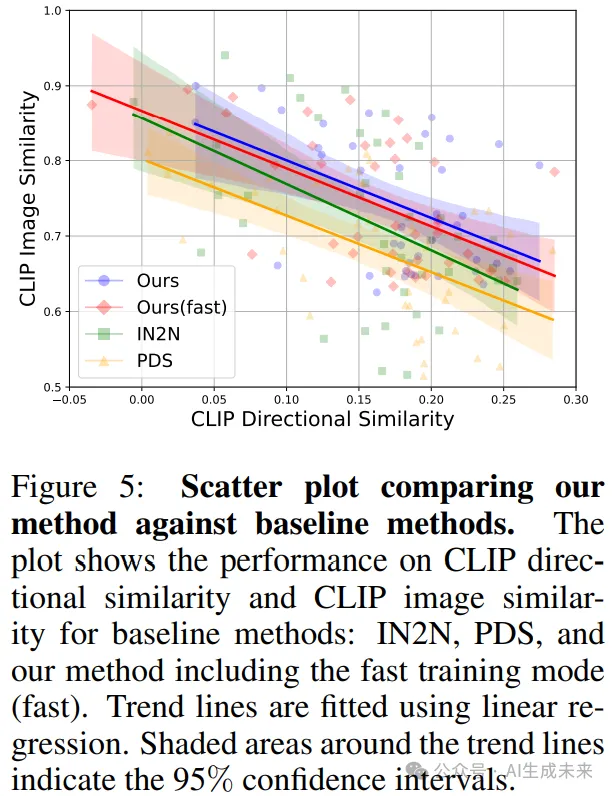

本文使用 CLIP 方向相似度、CLIP 图像相似度和美学评分来评估 DreamCatalyst 和基线方法。CLIP 方向相似度衡量图像与文本的对齐程度,CLIP 图像相似度评估身份保留的水平,美学评分则表示编辑质量。如下表 1 和下图 5 所示,DreamCatalyst 在所有指标上均获得最高分。此外,本文还测量了每种方法的编辑时间。为了公平比较,本文将所有方法的分辨率设置为相同。DreamCatalyst 的快速模式比最新的基于 SDS 的编辑方法 PDS 快约 23 倍,高质量模式则比 PDS 快约 8 倍。尽管 IN2N 在二维空间中进行编辑,比直接的三维编辑方法所需时间更少,但即使在高质量模式下,DreamCatalyst 仍比 IN2N 快 1.85 倍。

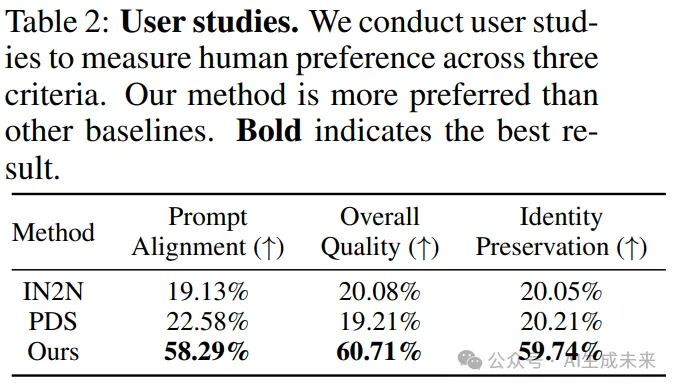

用户研究

本文进行了用户研究,如下表 2 所示,因为专门用于评估 2D 图像的指标不足以评估 3D 场景。对于每个问题,参与者被要求从基线方法和 DreamCatalyst 的结果中选择最佳视频。本文选择了 15 个文本提示来评估三个标准:(1)提示对齐,(2)整体质量和(3)身份保留。每个标准的问题如下:(1)“在编辑视频时,哪个视频最符合文本提示并展示高质量?”(2)“在编辑视频时,哪个视频展示了最佳的编辑质量?”和(3)“在编辑源视频时,哪个编辑过的视频最好地保留了源视频的背景和身份?”为了收集人类偏好数据,本文利用亚马逊 Mechanical Turk 对 50 名参与者进行了调查。结果表明,DreamCatalyst 在所有标准上都比基线方法更受欢迎,优势明显。

消融实验

减少时间步采样。 在本节中,本文展示了减少时间步采样的有效性。为了公平比较,实验设置相同,每次使用 500 次迭代,除了时间步采样算法外。如上图 6 所示,减少时间步采样的编辑结果收敛到细节丰富的结果,而随机时间步采样的结果则表现出过饱和的颜色,并且在相同编辑时间内未能保持背景一致性。因此,减少时间步采样可以更快地收敛。

结论

本文提出了一种用于3D编辑的通用公式,通过揭示反向SDEdit过程和DDS之间的关系。基于这一公式,本文引入了DreamCatalyst,它考虑了扩散过程的动态性,通过基于SDS的方法作为反向SDEdit过程来编辑3D场景。此外,本文建议在分数蒸馏中使用FreeU,以克服公式中固有的可编辑性和身份保留之间的权衡。结果表明,DreamCatalyst实现了快速且高质量的3D编辑。通过比较分析和用户研究,本文证明了DreamCatalyst在性能和编辑速度上均超越了最先进的方法。

本文转自 AI生成未来 ,作者:AI生成未来